Наверно надо было спрашивать в \пр\, ну да ладно. В общем. Ситуация такова. Есть огромная база вопрос-ответ. И мне нужно прикрутить к ней бота. Вот пишут боту вопрос какой то. Он вычленяет оттуда контекст и ищет этот контекст в базе, в разделе вопросов, а затем выдает ответ. Как это проще всего сделать?

Векторные базы данных и LlamaIndex.

Но вроде звучит приемлимо сложно.

Тупой наверно вопрос. Но допустим мы нашли в бд этот вопрос. А ответ то как узнать? Как связать меж собой вопрос - ответ?

>Тупой наверно вопрос.

Уровня троллинга, потому что вопрос и ответ на него лежат в одной строчке БД. Поэтому это, вместе с вопросом пользователя, будет добавлено в контекст LLM вместе с инструкцией.

>Уровня троллинга,

Простите, в новомодных технологиях не силен.

Т.е. вопрос и ответ кодируются вместе? Понял.

>Т.е. вопрос и ответ кодируются вместе?

Они лежат вместе в БД, вектор строится только для вопроса, так как поиск идёт по вопросу. Хотя конечно можно делать вектора и по ответам, но ХЗ насколько они будут актуальны.

capybarahermes-2.5-mistral-7b.Q8_0

на 10% ответ лучше чем

openhermes-2.5-mistral-7b.Q5_K_M

обе ggfu через кобольд nocuda

>model training w/ GaLore + Transformers for SOTA results on consumer-grade hardware

>обучение модели с помощью GaLore + transformers для получения SOTA результатов на оборудовании потребительского класса

>82.5% less optimizer state memory footprint without performance degradation by expressing the gradient weight matrix as low rank.

>На 82,5 % меньше места в памяти состояния оптимизатора без снижения производительности благодаря выражению весовой матрицы градиента в виде матрицы низкого ранга.

https://twitter.com/Titus_vK/status/1770422413576089791

Отец знакомого работает в лабе по исследованию технологий ИИ. Сегодня срочно вызвали на совещание. Вернулся поздно и ничего не объяснил. Сказал лишь собирать вещи и бежать в тех-магазин за новыми RTX 4090. Сейчас едем куда-то далеко за город. Не знаю что происходит, но мне кажется началось...

>обучение модели с помощью GaLore + transformers для получения SOTA результатов на оборудовании потребительского класса

>82.5% less optimizer state memory footprint without performance degradation by expressing the gradient weight matrix as low rank.

>На 82,5 % меньше места в памяти состояния оптимизатора без снижения производительности благодаря выражению весовой матрицы градиента в виде матрицы низкого ранга.

https://twitter.com/Titus_vK/status/1770422413576089791

Отец знакомого работает в лабе по исследованию технологий ИИ. Сегодня срочно вызвали на совещание. Вернулся поздно и ничего не объяснил. Сказал лишь собирать вещи и бежать в тех-магазин за новыми RTX 4090. Сейчас едем куда-то далеко за город. Не знаю что происходит, но мне кажется началось...

и там ещё обновление темы с Bitnet. https://github.com/microsoft/unilm/blob/master/bitnet/The-Era-of-1-bit-LLMs__Training_Tips_Code_FAQ.pdf

>Модели BitNet, похоже, обучаются более "стабильно" из-за более низкой точности, им требуется больше обновлений градиента, чтобы увидеть столько изменений, поэтому скорость обучения должна быть больше, чем у модели с полной точностью, чтобы компенсировать это.

>>Кривые потерь значительно улучшаются, когда LR + затухание веса уменьшаются на полпути (они называют это двухэтапным планированием). В моделях с более низкими параметрами разрыв больше.

>Они выдвигают гипотезу: "...хотя между 3B-версиями BitNet b1.58 и LLaMA LLM нет заметного разрыва по потерям при проверке и точности в конце задачи, существует небольшая разница в потерях при обучении. Это говорит о том, что 1.58-битные модели могут демонстрировать лучшие возможности обобщения и быть менее склонными к перенасыщению".

>4-битный KV-кэш не дает существенной разницы, если она вообще есть, на эталонных оценках, и их 2T 3b все еще немного превосходит модель StableLM с полной точностью на оценках, даже с 4-битным KV-кэшем.

>Для обучения по-прежнему требуются градиенты полной точности, поэтому обучение не стало менее затратным по памяти, но они утверждают, что ядра CUDA с низкой точностью могут несколько улучшить эту ситуацию.

>Код, предоставляемый для реализации подхода к обучению, достаточно минималистичен.

Models Megathread #4 - What models are you currently using?

https://www.reddit.com/r/LocalLLaMA/comments/1bgfttn/models_megathread_4_what_models_are_you_currently/

Хотя бы по 3 раза каждую с одними с теми же промптами пробовал, чтобы подобные выводы делать?

Две и больше карт не поддерживается, кстати.

Хули толку тогда? Можно было б арендовать большой утюг или завести риг побольше.

Привет. А посоветуйте малютку модельку, которая бы по сути выполняла функцию гугла. Чтобы всю инфу брала из интернета.

*пожалуйста

:)

Тролишь так?

Единственное что можно сделать это привязать к боту досуп собственно в гугл чтобы он гуглил за тебя. Смысла в этом как ты понимаешь никакого, мог бы и сам запрос забить.

А сделать поисковик как у гугла немного так сложнее.

>Чтобы всю инфу брала из интернета

Sidney Bing

web_rag в oobabooga на линухе.

Любые web langchain // llamaindex с поиском.

И т.д.

Модель тут не причем.

Нет. Не тролю. Нужен чат, который бы отвечал как человек, но данными из интернета, с уточнениями. Смысл в том, чтобы вся история чата сохранялась и не нужно было открывать браузер и гуглить. Да, знаю можно просто бота такого сделать., мне это не подходит по нескольким причинам, необходимость мессенджера в первую очередь. Нужен типо чат алиса. Модель именно для этого, чтобы небольшая с базовыми разговорными навыками, но информацию черпала онлайн.

Спасибо, посмотрю.

В таверне есть аддон Web search. Я сам не пробовал пока что, но вроде оно должно как-то так и работать что ты описал.

Это что, выходит 7б (?) можно вяло но файнтюнить на 24 гиговых? Интересно сколько влезет в 48/96гб. Действительно прорыв. Тот же метод бы для других нейронок применить, коху того же пнуть.

ну да, по сути почалось, только доступна всего лишь одна гпу, как сказал анон выше, на двух и более не работает.. пока что.

там же на реддите подсчитали что для полной тренировки (или только файнтюна??) нужно ~110 дней нонстопом с rtx 4090.

А раньше нельзя было? Или только лоры помещались?

Потом допилят больше карт. Может быть. Или как неленивый, спрячут мультигпу за пейволлом.

Не подвезли ничего нового, чтобы изкаробки локальный RAG по тыщам пдфок, как в чате с ртх, но без ртх?

Спасибо, гляну, но мне кажется это кушать много будет.

Нужна моделька макс 1b, чтобы загрузил в gpt4all и все. Красиво и быстро, и не жрет.

Предварительная работа:

1) при помощи LLM строишь массив ключевых слов

2) при помощи кожаных мешков причёсываешь массив ключевых слов

3) при помощи LLM размечаешь каждый вопрос/ответ ключевыми словами, кладёшь их в БД

При запросе:

1) Просишь LLM сформировать ключевые слова по запросу

2) Дергаешь обычный поиск по ключевым словам в БД

3) Скармливаешь в контекст LLM все найденные в БД вопросы/ответы как справочный материал

4) Просишь LLM серануть ответ

На сегодня это самый предсказуемый вариант, который в принципе можно отлаживать.

Вектора сегодня неуправляемые. Если ты не готов файнтюнить embedding модель под свою задачу, то лучше не тратить время и силы. Но надеюсь их приведут в порядок в ближайшее время.

Вопрос по железу.

А какое кол-во токенов в секунду обеспечивает максимально низкую задержку для среднего по размеру сообщения (ну допустим 140 символов).

Типичный чатинг в телеге. И можно ли вообще настроить чтобы ответ был целиком после формирования, а не прописывался в реалтайм.

Разумеется для разных моделей, будет разный результат, ну возьмем 7b и 70b. Есть данные или личный опыт?

А какое кол-во токенов в секунду обеспечивает максимально низкую задержку для среднего по размеру сообщения (ну допустим 140 символов).

Типичный чатинг в телеге. И можно ли вообще настроить чтобы ответ был целиком после формирования, а не прописывался в реалтайм.

Разумеется для разных моделей, будет разный результат, ну возьмем 7b и 70b. Есть данные или личный опыт?

>А какое кол-во токенов в секунду обеспечивает максимально низкую задержку для среднего по размеру сообщения (ну допустим 140 символов).

>А какое кол-во километров в час обеспечивает максимально низкую задержку для пересечения среднего по размеру расстояния (ну допустим 140 метров).

Чем больше, тем лучше, очевидно.

>чатинг в телеге

Алсо добавлю, что в телеге в большинстве случаев не надо уменьшать лаг. Люди психологически лучше принимают сообщение "печатаю" и спустя несколько секунд ответ, чем мгновенную реакцию.

У нас в боте вообще специально задержка добавлена.

А возможно ли запустить на нейросетке луп, чтобы в неё постоянно поступала информация и генерировался на неё ответ? Такая себе имитация сознания

> русский локальный ChatGPT

> по факту допинали лорой первую 13в альпаку чтобы по-русски хоть как-то шпрехала

Вспоминается мемас про "мам, купи Х! у нас есть Х дома! Х дома: какая-то шляпа". Абсолютно кликбейтный заголовок, как по мне, за такое надо банить и гнать ссаными тряпками подальше от ресурса

Да блин в таверне же можно в комнату несколько персонажей посадить и настроить чтобы они автоматом генерили сообщения по таймеру. Будут вечно срать друг другу что-то, думаю со временем там начнется вечная шиза.

А что ничего нового для куминга не появилось? Заходил 2 года назад в тред был LLaMA и сейчас опять по факту только он, может хоть он улучшился или до сих пор та самая первая версия и есть?

Во-первых, человек пишет не так уж и быстро, так что формат переписки поддерживают даже процы на моделях 34B размера. 1-1,5 токена/сек — вполне себе переписка в телеге.

Норм видяхи выдадут уже гораздо бо́льшую скорость.

Во-вторых, ты говоришь о режими стриминга, который, конечно, отключается без проблем.

Из личного опыта, могу предложить, для русского языка, взять command R 35B на одну Tesla P40, скорость будет отличная — просто летать для телеги.

Ну или она же на процессоре (лучше DDR5 в двухканале, но пойдет и DDR4 в двухканале или DDR3 в четырехканале) — будет как средне-пишущий человек.

Но можно брать 70B на двух теслах — или 7B на проце. Скорость будет в районе 6 токенов/сек, неплохая.

Единственный совет, для малых сообщений на русском я подобрал:

"mirostat_mode": 2, // 1 для llama.cpp

"mirostat_tau": 1,

"mirostat_eta": 0.9,

Вроде отвечает лучше.

Шо це?

Плюсую, за скоростью можно не гнаться, это не голосовой ассистент.

Это просто программирование, обычный скрипт. Запускай.

Нифига у тебя с чтением плохо, братиш.

Сочувствую.

Тут даже хз, че сказать.

Ну, вкратце, нет, не первая, а вторая, и не вторая, а мистраль, и не мистраль, а мерджи, и не мерджи, а токсик или дпо мерджи, и не дпо мерджи, а мое дпо мерджи, ну или что-то из раннего.

Но если ты ждал революцию, то, прости, веса GPT-5 еще не выложили.

как в кобольда засунуть модельку если у меня некропроц без AVX2? есть поддержка вулкана без авх, но ошибка пикрел

в чем проблема?

в чем проблема?

Разумеется. Интересует оптимальный вариант и железо под него. Условные 2 секунды на полноценное предложение.

Это да, но это телега, а тут задача уменьшить лаг до уровня тележного общения. Надеюсь объяснил.

Сейчас у меня 6-8 токенов секунду (токен не равно слово) и это долго. Вот и хочу узнать какое железо мне нужно, чтобы полноценное предложение в пару секунд получить.

Иду по этому гайду:

Гайд для ретардов для запуска LLaMA без излишней ебли под Windows. Грузит всё в процессор, поэтому ёба карта не нужна, запаситесь оперативкой и подкачкой:

У меня вопрос, если у меня видюха с 4гб, мне процом генерить? или с видюхой даже с 4гб будет быстрее?

если видюха нвидима то выбирай с кублас и будет побыстрее, но слои на нее не сгружай, толку не будет

Я пытаюсь получить ощущение активной переписки с человеком (расщитать). Так как это оптимально.

Ключевое слово активной, когда вы здесь и сейчас решаете вопрос. Написал-получил ответ.

Понятно с человеком чаще идет режим ленивой переписки: ты написал и отложил телефон, ждешь, тут ты нацелен на получение ответа, чем быстрее тем лучше.

Во-первых, ты не сказал, какую модель гоняешь.

Во-вторых, ты как-то неадекватно воспринимаешь «лаг уровня тележного общения». Сам ты вряд ли можешь выдать 8 токенов в секунду. Если тебе нужно быстрее — значит тебе надо что-то гораздо быстрее тележного общения.

Попробуй засечь, сколько ты печатаешь текст, а потом вставить в Token counter.

У меня выходит 3~3,5 токена в секунду при моей печати в 400+ символов в минуту.

8 токенов — это уже 1000 символов в минуту. =) 140 символов при 8 токенах выдается за ~10 секунд.

Обычные сообщения могут содержать по 30-40 токенов, это уже 2-3 секунды. Если у тебя дольше — значит дело где-то не в LLM.

Математика.

Да, как уже сказали, контекст держишь на ней, но слоев выгружаешь 0.

> только доступна всего лишь одна гпу, как сказал анон выше, на двух и более не работает..

Ээээ, хуясе ебать.

> что для полной тренировки (или только файнтюна??) нужно ~110 дней нонстопом с rtx 4090

Что понимают под полной тренировкой? Просто для файнтюна это слишком долго, для базовой модели слишком быстро(?), интересно.

> только лоры помещались

this

Можно тогда хотябы оценить сколько уйдет на дотрен 13б, например. Не то чтобы перспективно с учетом возможного выхода ллама3, но там ведь тоже будет версия поменьше, там применить наработки.

*по 30-40 символов, офкк

>Но можно брать 70B на двух теслах — или 7B на проце. Скорость будет в районе 6 токенов/сек, неплохая.

Уменьшение скорости генерации с увеличением размера промпта наблюдается?

Зависит от промпта. =) Для 200-300 токенов несущественное, для карточек на 2500 токенов — безусловно.

(точнее, не скорости генерации, а total)

Модель не имеет значение. Суть в том, что она выдает на моем железе 6-8 токенов в секунду. По ощущениям это долго. Интуитивно, так как я ничего пока не измерял, просится примерно в 3-4 раза быстрее. Дальше был вопрос, какое железо нужно, чтобы достичь такого результата на 70b как самый пока оптимальный, и 7b как на начальный уровень. :)

Ну, вы чушь несете, но ладно. =)

RTX 3060 хватит, чтобы гонять 7B модель со скоростью под 22-27 токенов, точнее не скажу.

RTX4090 (одна-две штука=) хватит, чтобы гонять 70B (в ужасном или хорошем) кванте со скоростью 35 или 20 соответственно.

Проц с DDR5 выдаст, я предполагаю, максимум 15 токенов на 7B модели (пусть меня поправят), я бы предпочел брать 3060 как универсала, ИМХО.

>за такое надо банить и гнать ссаными тряпками подальше от ресурса

Чел, это Хабр, та ещё помойка с кликбейтом и на месяц устаревшими новостями.

Купи процессор.

>какое железо нужно, чтобы достичь такого результата на 70b

Или 2х3090, или проф карты. Можешь сторговаться с аноном-перекупом с А100, если он ещё держит ))

Просто скинь скрин что печатает жора при обработки большого контекста с нуля, хоть просто тред на вход скопипасти и нажми generate

> Можешь сторговаться с аноном-перекупом с А100, если он ещё держит

Еще рано фиксировать прибыль, лол. Но если надумает по дешману отдать - предложение может быть рассмотрено.

Пусть будет так, но в итоге ты почти ответил на мой вопрос:)

Т. е 35 т/с это в 5 раз быстрее чем у меня сейчас. Вроде, так как мне проверить негде, это должно быть норм. А где то можно это померить онлайн? Визуально посмотреть? Например задать кол-во т/с и посмотреть сколько он будет его печатать. Заранее вставленный текст допустим?

скачай модель поменьше, 3b или 1b и играйся со скоростями вывода

Да, пруфов не будет.

>RTX 3060 хватит, чтобы гонять 7B модель со скоростью под 22-27 токенов, точнее не скажу.

я скажу точнее: на 3060 30т/с 7В вот такой квант 8.0bpw-h8-exl2 проверено на разных файнтюнах и мержах мистраля, все что квантовано сильнее будет еще быстрей само собой

>(точнее, не скорости генерации, а total)

А интересует именно скорость генерации. Лично у меня при заполнении контекстного окна в 8к скорость снижается до 3,4 токенов в секунду (собственно она линейно снижается с увеличением размеров промпта). Если это только у меня так, то оно и ничего - поправим, а если нет, то 6 токенах в секунду речь не может идти. Скорее уж о трёх :)

Правильно сделал? а контекст сайз сколько ставить? у меня видюха 970 с 4гб и оперативки на компе 32гб

Хуя ваши нвидии гоночные. У меня 7Б модель просто в оперативке ддр4 без юза видеокарты как я понимаю выдает 3,8 токена в секунду, да и это пиздец как нормально, ты даже читать не успеешь с такой скоростью, типо куда вы спешите вообще.

>да и это пиздец как нормально, ты даже читать не успеешь с такой скоростью, типо куда вы спешите вообще.

Оно как бы да, ответ начинает выводится почти сразу и скорость в 3t/s неплохая, особенно для больших моделей. Вот только разница с 6t/s очень заметна. 6t/s - это уже комфорт.

Разобрался, теперь еще вопрос, подскажите пожалуйста а как из режима чата сделать режим истории? что бы я ему тему какую-то задал а он начал историю писать?

Короч, нашел видос.

https://youtube.com/watch?v=z4wPiallZcI

Чел на четвертой минуте запускает.

Метрики на экране. 7b mistral

102 т/с. , всего 41 токен, ответ выдает за пол секунды. И скажу это было очень быстро. Я бы сказал очень не комфортно.

ЕЩЕ И ПОЧТИ? ТЫ гля, який неблагодарный! )

Проверить онлайн — не знаю. Token counter гуглил, проверку скорости не гуглил.

Я в начале написал 25-30, но потом решил не рисковать, чтобы не обнадеживать человека лишний раз. =) Поэтому и занизил планочку.

Хм? Окей, сейчас проверю, но по идее — не должно.

А, ты прав, упала генерация.

Да.

Там на грани мгновенных ответов.

Люди делятся на два типа:

1. Я читаю в стриминг режиме, зачем мне быстрее?

2. Я читаю готовый ответ по диагонали, мне надо сразу.

=)

Я понимаю обе стороны, поэтому не сильно гонюсь.

Конечно! Начну с того, что для реализации вашей идеи можно воспользоваться технологией LlamaIndex. Она позволяет создавать индексы для больших баз данных и использовать их для поиска контекста и вывода ответов с помощью языковых моделей, таких как Llama 2 или Vicuna.

Сначала необходимо создать индекс для вашей базы данных вопросов и ответов с использованием LlamaIndex. Затем вы можете использовать эту модель для поиска контекста по вопросу пользователя и вывода соответствующего ответа из вашей базы данных.

Важно отметить, что LlamaIndex использует векторное представление данных для поиска контекста, поэтому вопросы и ответы должны быть представлены в виде векторов. Это может быть достигнуто путем преобразования текстовых данных с использованием моделей эмбеддинга, таких как sentence-transformers или Hugging Face's transformers.

После того, как индекс будет создан и ваши данные будут преобразованы в векторное представление, вы сможете использовать LlamaIndex для поиска контекста и вывода ответов. Этот процесс включает в себя два основных шага:

Поиск контекста: вы можете использовать LlamaIndex для поиска контекста по вопросу пользователя. Этот поиск основан на сходстве векторов и позволяет найти наиболее соответствующие контексты из вашей базы данных.

Вывод ответов: после того, как контекст будет найден, вы можете использовать языковую модель (например, Llama 2 или Vicuna) для вывода ответа на основе найденного контекста и вопроса пользователя. Этот шаг может быть выполнен путем обработки контекста и вопроса пользователя как входных данных для языковой модели и получения ответа от нее.

В целом, реализация вашей идеи с использованием LlamaIndex и языковых моделей может быть довольно простой и эффективной. Надеюсь, эта информация поможет вам в вашей работе!

———

А хули, зря что ли 8к контекста жевала 4 минуты. =)

Сначала необходимо создать индекс для вашей базы данных вопросов и ответов с использованием LlamaIndex. Затем вы можете использовать эту модель для поиска контекста по вопросу пользователя и вывода соответствующего ответа из вашей базы данных.

Важно отметить, что LlamaIndex использует векторное представление данных для поиска контекста, поэтому вопросы и ответы должны быть представлены в виде векторов. Это может быть достигнуто путем преобразования текстовых данных с использованием моделей эмбеддинга, таких как sentence-transformers или Hugging Face's transformers.

После того, как индекс будет создан и ваши данные будут преобразованы в векторное представление, вы сможете использовать LlamaIndex для поиска контекста и вывода ответов. Этот процесс включает в себя два основных шага:

Поиск контекста: вы можете использовать LlamaIndex для поиска контекста по вопросу пользователя. Этот поиск основан на сходстве векторов и позволяет найти наиболее соответствующие контексты из вашей базы данных.

Вывод ответов: после того, как контекст будет найден, вы можете использовать языковую модель (например, Llama 2 или Vicuna) для вывода ответа на основе найденного контекста и вопроса пользователя. Этот шаг может быть выполнен путем обработки контекста и вопроса пользователя как входных данных для языковой модели и получения ответа от нее.

В целом, реализация вашей идеи с использованием LlamaIndex и языковых моделей может быть довольно простой и эффективной. Надеюсь, эта информация поможет вам в вашей работе!

———

А хули, зря что ли 8к контекста жевала 4 минуты. =)

>как из режима чата сделать режим истории? что бы я ему тему какую-то задал а он начал историю писать?

Settings - Format на первой вкладке

Насколько 4бит мику тупее 5бит? Задачу про козу и капусту еще решает или уже нет?

А то меня бесит скорость 1.8 токена в секунду на 5 битке(и это с оффлоадом трети слоев на 4090)

А то меня бесит скорость 1.8 токена в секунду на 5 битке(и это с оффлоадом трети слоев на 4090)

А почему модель так быстро пытается закончить историю, как заставить её более подробно каждый момент описывать?

а есть сайт где есть готовые промпты для кобольта? с разными сценариями, где заполнено world info, Author's Note и т.д?

>А, ты прав, упала генерация.

Ну, утешением нам служит то, что у людей со связкой 4090+3090 скорость генерации выходит не намного выше :) Конечно они могут exl2 использовать и вообще всё могут, но вот c GGUF-моделями примерно в том же положении. До бытовых нейроускорителей доживём, а там видно будет.

Тебе сам кобольд несколько сайтов дает чел, прям в интерфейсе

Вот я слепой, спасибо

Пацаны. Kobold запускаю, выбираю модель, нажимаю старт и вылетает. Что может быть?

Запускай через консоль и читай логи. вангую нехватку рам

С каким аргументом?

А понял.

Кто знает, почему, когда пытаешься отыгрывать скромнягу, то все боты пытаются тебя выебать в жопу? Может, это как-то аккуратно прописать в карточке, что я не из этих, или хотя бы насиловали другим способом, при этом не ломая бота? Модель mxlewd-l2-20b. Q5_K_M если что

Без некоторых знаний программирования тебе только oobabooga светит.

Да, по памяти. Спасибо

Почему кобольт юзает только 45% проца и около 900-1000МБ оперативки (не видюхи)? Можно ли как то увеличить потребление, что бы быстрее ответы генерились?

в шапке написано "то есть для 7B модели GGML весом в 4.7ГБ и контекста в 2к нужно ~7ГБ оперативной."

у меня модель 7.5гб весит, а жрет 1гб всего как так то?

Ты карточку-то покажи

Не знаю про мику, я мог бы только q2 запустить со скоростью 0,33 токена, потому вот тебе ответ от простой 7б модели capybarahermes-2.5-mistral-7b.Q8_0. По своему можно засчитать за креативность, крестьянин сожрал капусту и перевез волка а капуста была у него в животе как бы и он ее перевез в виде ну жратвы внутри себя вместе с волком.

>все боты пытаются тебя выебать в жопу

>mxlewd

Ну а что ты хотел, модель для кума, она других паттернов и не знает.

Остальное на видяхе?

Ну вот тебе мику q2, решает она спокойно но бля 5 минут пердеть думать да ну нахуй.

Если q2 решает - значит она тупо загрязнена готовым решением

Этот лоботомит никогда бы не смог решить не зная задачу и ответ

Ну хз, всё равно ничего умнее я не могу запустить, ебал я по часу ждать ответы. Пока что нейронок умнее мику q2 я не юзал. К тому же тут персонаж хакер всё таки да и думала она долго и сосредоточилась.

>всё таки да и думала она долго и сосредоточилась.

Чего? Нейронка просто отыграла этот момент, ниче она не думала, тупо сразу начала писать верное решение

Смотря какая.

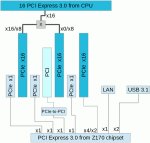

>z170 мамку с поддержкой SLI

У меня как раз лежит такая - ASUS Z170-A. И даже проц со встройкой для нее есть. Стоит пробовать на ней собрать ультимативную LLM-машину нищука с двумя теслами или я говна поем? Пока единственное что смущает - это 64 макс оперативки, но гугол говорит что можно напердолить флажок --no-mmap и станет заебись. Мнения, советы?

Я кстати заметил что мику 2бит сломана при использовании высокого контекста - 16к, prompt processing падает просто в мясо, делая скорость генерации 0.5-0.7(!) при условии всех слоев на видеокарте(!!!), в то время как 5бит мику с тем же самым контекстом выдает 1.5 токена в секунду при лишь трети слоев на видеокарте.

Две теслы = 48 гигов, у тебя 64, проблемы?

Я как купил две плашки, так и сижу с 64 гигами, проблемы не чувствую.

Занимает все ~55 гигов и норм.

Или я не понял, в чем трабл.

Может с тремя теслами, чтобы 72 врам? :)

Не, я то на 2к гонял для тестового вопроса же, я хз но в чисто оперативке вот так медленно, а видяхи у меня считай нет, я не уверен работает ли она, но она жужжит когда чето считает в ней конечно, хотя мне говорили что рокм на винде не работает с 6700хт. Может она просто херней страдает, в любом случае скорость пиздец, ну надо будет думать о покупке нвидии в ближайшие полтора года.

Кстати, я так и не понял, почему писали про SLI, если тебе надо всего лишь два абы каких слота, и две видяхи. Про требования SLI увидел здесь впервые недавно.

Подозреваю, что можно даже по USB данные гонять, просто задержечка бахнет.

Подозреваю, что можно даже по USB данные гонять, просто задержечка бахнет.

Я либо в глаза ебусь, либо не нашел, есть нормальный гайд по составлению и форматированию ботов для таверны? Я брал карточки с чаба, пробовал разные варианты промтов, но часто сетка просто начинает игнорить что написано в карте персонажа.

Заметил что лучше работает перечисление "thing1" + "Thing2" но в целом всегда сбивается.

Где есть нормальный гайд?

Заметил что лучше работает перечисление "thing1" + "Thing2" но в целом всегда сбивается.

Где есть нормальный гайд?

Я от балды делаю, тестирую, могу по мелочи поменять что-нибудь и потом откатить если что. Часто просто чужих персов изучал и тоже им менял всякое разное. Также как ни странно сама нейросетка миниублюдков неплохо пишет. Сама себя может подредачить, но будет обсераться немного, но от этого оно только живее. А вот как лорбук правильно писать я и сам не знаю, вообще присоединяюсь к вопросу.

Ну с лорбуками я как раз разобрался.

Создаешь название - в ключевых словах прописываешь типа якоря, или короткие упоминания. Например название Шкила - "school" "midschool" и тд. То есть любое возможное слово которое ассоциируется.

А в самом промте, уже помещаешь то что хочешь, как и с любой карточкой перса.

Потом можешь персонажа привязать на лорбук или весь чат.

Лорбук будет вызываться только когда упоминается какое то слово. Если ты в диалоге упомняешь шкилу - то бот отсканирует лорбук.

Если в карте персонажа есть например - ходит в шкилу. То бот будет каждый раз брать инфу из лорбука.

Ну и тд.

А вот с персами у меня беда. Разные форматы пробовал, но мразь пытается руинить.

>У меня как раз лежит такая - ASUS Z170-A

У меня тоже. Причём asus z-170a. кун.

>И даже проц со встройкой для нее есть

Даже если ты укажешь встройку как базовую видеокарту для инициализации биоса, то две Р40 не будут работать.

Чёрный экран, ошибка инициализации pci-e. Проверял.

Мне стало любопытно как работает коммутатор/делитель линий.

Не понимаю, почему ты херней страдаешь. Есть opencl, недавно сделали vulkan, давно уже можно было перекатиться на linux. Но ты всё ноешь и ноешь в треде, как у тебя не работает rocm. Или это толпа похожих анонов с одинаковыми амудэ видеокартами?

А без встройки, как сервер?

Хуй знает, если есть комплектующие, я бы подсобрал. Покупать с нуля точно нет, такие мамки даже б.у неоправданно дорогие, но раз валяется.

Вот это уже странно. Основная идея SLI в том, что он требует 8 линий напрямую от проца, в обход ущербного DMI. Если не вывозит в двух конкретных слотах с поддержкой SLI, то это пиздец, не вывозит уже не DMI, а проц. Третья версия PSI-E имеет поддержку абов 4г, но часто эта поддержка отваливается. Почему - хуй знает, возможно дело в ревизиях железяк.

Нашел хоть немного стоящий гайд с пояснениями. Аллелуя

https://yodayo.notion.site/Advanced-Character-Creator-Guide-ff2f71e2576544d68bd295195a84d8e4

О, ну вот это интересно. Сохраню.

Кстати на вулкане она вообще ничего не делает на этой модели, да не, похуй я на линукс укачусь всё равно потому что мне в угабуге хочется модели для распознования изображений потестить, это ведь возможно да? Я просто помню что на линуксе вместо кобольда я ставил угабугу год назад.

Я просто в Llama.cpp тестирую распознавание.

Спасибо, обязательно посмотрю.

Надыбал еще рам. Теперь есть 37рам+9гб врам свободжных. Какая модель максимально умная влезет? На скорость пох.

Несколько гайдов есть в доках таверны: https://docs.sillytavern.app/usage/core-concepts/characterdesign/

Вообще, как мне показалось, со времён пигмы 6б сообщество пришло к мнению, что формат W++ (теги в скобках через плюсики, запятые, в кавычках и тому подобное) довольно дерьмовый, по крайней мере, для больших моделей. Даже нейросетка, трененая на инструкциях, лучше всего умеет тупо дописывать текст. Поэтому велика вероятность, что лучше себя покажет внезапно самый простой формат: плейн текст, разбитый на категории (внешка, характер, бэкстори и т.д.). Неплохо работает и описание от лица персонажа в виде интервью с ним, потому что тогда ты убиваешь двух зайцев, сразу демонстрируя модели особенности речи перса. Если в этой речи дескрипшен персонажа как-то раскрывается в мини сценарии, то совсем хорошо. Ещё можно напоминать важные особенности перса в "джейлбрейке". С локалками это можно делать, вписав ключевые вещи в поле джейлбрейка карточки и добавляя макрос таверны {{charJailbreak}} в инстрактмод в поле Last Output Sequence. В одном из гайдосов на сайте таверны есть похожий совет, но только с использованием Character's Notes.

Ну и то, что модель игнорит дескрипшен, имхо его форматом в полной мере не починишь. От модели больше зависит.

>Какая модель максимально умная влезет?

mixtral q4, может даже q5

Да ее уже качаю, думал мб еще что есть.

Проверил мику q2 с другой настройкой видяхи, опять загадку с козой, капустой и волком, короче вот результаты

OpenBLAS 0,33 токена в секунду, Rocm 0,46, Вулкан 0,79. Короче да вулкан работает лучше, но это же все равно полный кал, не? Кстати тестируя на вулкане я заменил в условиях волка на крокодила, козла на мышь, а капусту на банан. Вроде суть не меняется но мику q2 выдала полную чушь, ее решение привело к максимальному факапу ситуации, так что она рили просто знала ебаный ответ на оригинал, отстой.

OpenBLAS 0,33 токена в секунду, Rocm 0,46, Вулкан 0,79. Короче да вулкан работает лучше, но это же все равно полный кал, не? Кстати тестируя на вулкане я заменил в условиях волка на крокодила, козла на мышь, а капусту на банан. Вроде суть не меняется но мику q2 выдала полную чушь, ее решение привело к максимальному факапу ситуации, так что она рили просто знала ебаный ответ на оригинал, отстой.

Какие есть ближайшие альтернативы Tesla P40 по цене/производительность?

У тесла вин только в объёме памяти. Так что ближайший аналог этой аналоговнет карточке это очевидная 3090 со вторички.

Есть парочка серверных картонок с таким же объёмом и сравнимой ценой, но там по железу всё ещё грустнее, и их выебет даже сборка на проце.

А на сколько вообще скорость памяти роляет в этих вычислениях? У меня просто 2 плашки по 16 ддр4, 3000мгц.

>Так что ближайший аналог этой аналоговнет карточке это очевидная 3090 со вторички.

Две 3090. Что в общем-то обессмысливает всю затею.

>Две 3090.

Так и P40 надо по 2 штуки брать, объёмы врама у них одинаковые.

Всем привет!

Только начинаю вкатываться в нейросети, поэтому есть несколько вопросов, надеюсь, что подскажите.

Я хочу поднять у себя на компьютере небольшую LLM и дообучить ее по своим документам не столько в плане новых знаний, сколько на соответствие формату ответа, например какой-то стайлгайд или ГОСТ.

Подскажите, пожалуйста, на какие модели стоит обратить внимание и какие гайды изучать.

Пека если что на амд, так что понадобится использовать ROCm.

Спасибо за ответы, аноны!

Только начинаю вкатываться в нейросети, поэтому есть несколько вопросов, надеюсь, что подскажите.

Я хочу поднять у себя на компьютере небольшую LLM и дообучить ее по своим документам не столько в плане новых знаний, сколько на соответствие формату ответа, например какой-то стайлгайд или ГОСТ.

Подскажите, пожалуйста, на какие модели стоит обратить внимание и какие гайды изучать.

Пека если что на амд, так что понадобится использовать ROCm.

Спасибо за ответы, аноны!

Дообучить у тебя вряд ли выйдет, лучше возьми, купи видяху, и катай сетку побольше, а формат обеспечь промтингом.

Я скорее видел результат в духе вот этого: https://sysblok.ru/courses/kak-doobuchit-jazykovuju-model-pisat-v-stile-dostoevskogo/

Не очень хотелось бы каждый раз париться с промптом. В идеале как я это вижу: я загоняю какой-то текст в сетку на сверку и проверку, например отсутствие трех и более подряд существительных, а на выходе получаю отредактированный текст на это и другие заданные правила.

Возможно я тогда не туда копаю?

капча намекает на (((загадку))) в черном ящике

>результат в духе вот этого

>GPT2

Лол, там отсутствие результата.

>Не очень хотелось бы каждый раз париться с промптом.

Поверь, с файнтюном ты будешь ебаться на 2 порядка больше.

Форматирование хорошо решается через few-shots промптинг + валидация результата + ретраи. Сильно большую и умную модель не надо

Справедливости ради, решение/не решение одной загадки не говорит о качестве модели, тут хотябы серию задачек дать. И на результат сильно будет влиять семплинг, деградация результатов может произойти из-за отличий в нем. А может и из-за кривой оптимизации, интересно что тут.

Напрямую, при норм проце упор именно в скорость памяти.

Правильно тебе пишут, дообучить на подобное можно и современные модели, вот только даже для 7б потребуется хуанг с минимумом 48гб врам. Если заюзать новую методу из постов выше то вроде как влезет и в 24. Потребуется тщательно подготовленный датасет, немало машинного времени, а с амд пробовать имеет смысл только на 7900хтх.

Есть пара альтернативных решений: просто нормальный промт где ты четко описываешь форматирование даешь примеры, если сделать аккуратно то решит твою задачу без всяких усложнений, также можно с грамматикой поиграться, она задает общий формат выдачи. Или же тренировка лоры, с ней требования к железу ниже, но и качество может быть недостаточным.

Дядьки, хочу поднять jupyter с gpt нейронкой и простым датасетом, пообучать и посомтретть, поизучать, как оно все работает с самого начала. Есть гайды, статьи, сами ноутбуки, книги про llm и тд. Спасибо.

miqu 4bit.

не влезет же, пусть 34 крутит от ноуса, или микстраль

Не знаю, эти измененные персонажи в загадке полностью убили весь так называемый интеллект, а ведь это же херня по сути. Вот соляр, который как более умную мистраль мне советовали. Она вообще отвечает как будто травы накурилась. Рероллил много раз всегда какой-то бред. Кстати на простую задачу уровня прочитай текст и коротко перескажи один из соляров мне начал просто бесконено срать словом what what what пока не стопнул ее, сократил текст в два раза, тогда она просто вопрос задала по текству в ответ типо "а че дальше было? "Очень странно но мистраль и мистраль-кабибара хоть и тупые, они нормально понимают что у них просят и пытаются выполнить задачу хоть и зачастую всрато, а тут наркоман аутист какой-то, жалко потому что по скорости она сносная и вроде как весит больше мистрали, надеялся что и умнее ее. Думаю нам стоит придумать кастомную задачку, которую реально решить и средне-человеку, и чтобы нагуглить нельзя было.

А какую модель проверял? Ну и попроси сначала подумать а потом дать ответ, если сетка начнет рассуждать поэтапно то это уже считай успех.

Вот это было solar-10.7b-instruct-v1.0-uncensored.Q8_0. Еще тупее себя проявила просто solar v1.0 Q6 ну там вообще пиздец я удалил нахуй это говно. Я пробовал и настройки этих температур им выставлять разные, но по моему опыту на мистрали самое топ это пресет TFS-with-top-A ну и потом уже universal creative и cohrent creative(эта прикольная но быстро в шизу уходит). То о чём ты говоришь бы сработало с мистралью, соляр же ведет себя как реально упоротое сознание, она просто хуйню несёт, я прекрасно знаю как работает сознание в подобном состоянии и понимаю что вижу, с этим говном нельзя договориться, лол. Оно просто в ноль айкью состоянии и несет дичь.

Ну, анценсоред сломана, так как ее провернули на антицензуру. Обычный солар вроде норм должен быть, попробуй файнтюн из нормальных, ноус гермес солар или какой нибудь Fimbulvetr-10.7B-v1

Влезет, она 35-40 гб весит,

И 2к контекста? Там ведь еще браузер хотя бы и операционка, либо чисто как сервер запускать тогда да

>Не знаю, эти измененные персонажи в загадке полностью убили весь так называемый интеллект, а ведь это же херня по сути.

miqu-1-70b.q4_k_m, оригинальная:

Can you help me solve this problem? A peasant needs to carry a crocodile, a monkey and a banana across the river. But the boat is such that it can only fit him and one other thing - either the crocodile, the monkey or the banana. If you leave the crocodile with the monkey, the crocodile will eat the monkey, and if you leave the monkey with the banana, the monkey will eat the banana. So how can the peasant carry all his cargo to the other side of the river?

=======

Oh wow, interesting riddle! Let me think... Hmmm alright got it! Here's what he should do: First, take the monkey across the river. Then come back and get the crocodile. After dropping off the crocodile on the other side, take the monkey again and bring it back to where you started. Now leave the monkey and carry the banana to the other side. Finally, return once more to pick up the monkey. This way, none of the animals or the fruit gets eaten :)

А когда попробовал эту же задачу на переквантованной модели с матрицей важности - получил фигню.

Норм ответ, лол.

Это лишь 11б, которая изначально не с нуля тренилась. Ты кормишь ей кучу строгих инструкций о том что нужно отыгрывать персонажа, много инфы про него и прочее, потому перегружаются и на подробный анализ задачи внимания уже не хватает. Или наоборот даже не воспринимает о рофлит так как делал бы это персонаж.

Также важную роль играет формулировка и указание по ответу. Предположу что если обернуть загадку в форматирование и явно указать задачу-правила-возможные действия, приказав использовать cot или даже просто рассуждать над вариантами пока не найдет верный, то сможет ответить.

Чел, такие вопросы не задаются персонажу в чате, они задаются в инструкт моде.

Мику ебет, это уже запруфано.

>miqu-1-70b.q4_k_m, оригинальная

Этот шарит. Я с самого начала пишу, что все разжатия и прочая магия с этой моделью работать не будет. Вот буквально любой файнтюн, любое прикосновение к весам модели херят её. Эх, вот бы оригинальные веса...

Вы тут miqu хвалите, я вот скачал Miqu-70B-DPO.q5_k_m.gguf такое, что-то не особо впечатлило. До этого тыкал wizardlm-70b-v1.0.Q4_K_M.gguf эта модель показалось более умной. Может не то скачал? Что за DPO в названии? Объясните неофиту, или носом ткните, где самому можно почитать

>Может не то скачал?

Конечно не то. Качать нужно только отсюда https://huggingface.co/miqudev/miqu-1-70b

>Что за DPO в названии?

Почти то, что пишет гугл на деле прямая оптимизация предпочтений.

Спасибо, качаю отсюда.

Есть ли применение 7б моделям с подозрительно высокими баллами на бенч марках или высокий бал показатель кривости самих бенчей? Может кто-то изучает это.

99% херня задроченая на прохождение тестов

С обезьяной любой дурак бы смог, тут суть была здать персонажей, которые не особо сочетаются и проверить именно интуху. Именно логику, а логики в ней нет, она действует на эмоциях как и я. Отчасти может это и хорошо, оставим логику анальникам, которые дальше хеллоу ворлда за полгода продвинулись, я просто это не понимаю и потому и хотел помощи от нейросетки. Чувствую крайнее разочарование, они работают далеко не так как мне надо, это не настоящее сознание. Я разочарован, но не уничтожен.

Просто давным давно еще лет 7 назад я в джава скрипт пытался вкатиться по самоучителю и столкнулся с формулой, я пытался всеми своими несчастыми мозгами осознать её, но так и не вышло, я как не перебирал так и не понял в как оно работает чтобы кастомное сделать - а тупо проделать по гайду, это не для меня. Спрашивал и программистов - они пытались мне объяснить - а мне все как об стенку горох ну просто блядь не понимаю, надеялся нейросеть сможет - как оказалось нет. Сука ну что же делать как мне решить эту невозможную задачу...

что лучше Undi95/MXLewd-L2-20B или mistralai/Mixtral-8x7B-Instruct-v0.1 ?

как по мне микстрал какой то слишком добрый и радужный

как по мне микстрал какой то слишком добрый и радужный

>С обезьяной любой дурак бы смог

Чёрта с два, две другие семидесятки не смогли. И вообще, хочешь хорошего результата - давай хороший промпт. Хочешь странного - получишь странное. Всё честно.

Ну я в тексте мастер промптов, знаю как с ними рабоатать, тут ты прав, правда я заметил что 16к токенов контекста это все равно чертовски мало, довольно быстро они начинают как-то тупить и забывать, интересно завезут ли хотя бы в 4 раза больший контекст ну или 16ти кратный, лучше 128 кратный и чтобы железо менять было не надо или это было очень дешево.

Как костыль можно юзать https://github.com/mit-han-lab/streaming-llm

Запоминает контекст первых и последних токенов продолжая вывод до "бесконечности"

Интересненько, сохраню в закладки. Да я всё равно линух второй сиситемой поставить собираюсь(Убунту если что, я надеюсь это приемлемый выбор линукса? До этого тестил дебианы, линукс минт очень часто ставлю на старые машины которые не нужны, но для актуалочки по каким-то причинам считаю что на убунту да и всё, Балла гейтса в рот шатал просто с его виндой, ублюдок чёртов, а копроигрушки надоели уже) может и разберусь как это ставить, столько возни конечно блядь пиздец, не жизнь а вечная череда каких-то изменений, не отдохнуть мозгу, зараза.

В таверне есть способ конвертировать групповой чат обратно в обычный?

Грока квантовали в q2, вышло всего 116 Гб. Пишут, что должно запуститься в llama.cpp и 128 GB RAM, но качество у q2 будет не очень. Разраб обещает матрицы важности подвезти через пару дней.

https://huggingface.co/Arki05/Grok-1-GGUF/discussions/2

>Грока квантовали в q2, вышло всего 116 Гб

Даже при разгрузке части слоёв на видеокарты всё равно будет плохая производительность плюс низкий квант. Сомнительна ценность всего этого.

Что думаете про теорию rokosbasilisk?

Что такое грок?

Ты хоть кратко перескажи что там за теория такая, я лишний раз свой след в сети не хочу. У меня и так буквально моего персонажа прописанного стырили для японской игры недавно вышедщей, так что я ебал это всё.

Ну что там можно уже АМД брать для ИИ или еще нет? Пока думал, цена на 3090 снова на 20к подскочила.

Следи за мейнстримовыми инференсами. Оллама неделю назад запускать научилась.

Когда их станет больше - можешь попробовать взять радеон у друга погонять.

Покупать специально ради сеточек я бы не рекомендовал. Даже если большинство прог научатся в амд - потеряешь кучу времени на всякие мелочи, все новые костыли будут доставляться с задержкой. Да и итоговая производительность на рубль вполне может оказаться пососной.

> Следи за мейнстримовыми инференсами.

Беки по пальцам пересчитать можно: llamacpp, exllama, aphrodite, голый трансформерс, может что-то еще. В теории все они поддерживают амудэ, на практике как в анекдоте нюанс, и без линукса и rx6800+ все очень грустно.

На форки и обертки нет смысла смотреть, поддержка там будет аналогична оригиналу, если ленивый разраб почешется, или хуже.

Итог печален - нет смысла брать. Может бу серверные где много врам окажутся привлекательными, но они дорогие.

Можешь сборку в дс скинуть ?

Я бы не советовал АМД брать если нейрохерней страдаешь, я намучался с ней пиздец, а для игорей топ за свои деньги канешн, я года два или типо того назад 6700хт взял у китайцев за 23к, при том что это трехвентиляторная нитро херня, штука то ведь мощная, 12ГБ и все дела, а для нейросетей кал калычем, наверное моя старая 1050ти уделала бы.

> Last week we saw that LemonadeRP-7B was the best role-play LLM. Our rankings have been updated and now it's Noromaid-Mixtral is number 1.

https://www.reddit.com/r/LocalLLaMA/comments/1blvxkx/update_last_week_we_saw_that_lemonaderp7b_was_the/

https://console.chaiverse.com/ (там же ссылки на модели)

https://www.reddit.com/r/LocalLLaMA/comments/1bgfttn/comment/kv8w12e/

> Roleplay models

> 7B: Erosumika is my favorite 7B model for a RP or friendly chat. It's smart, its prose is great, and I wish this niche for "soulful" models on human data got more attention. Coming in second place is Kunoichi-DPO-v2-7B, which should be more reliable, but dryer in terms of prose.

> 10.7B: Fimbulvetr-11B-v2. I haven't tested it nearly as much as the 7Bs, so I can't vouch for it, but I hear a lot of great things about it!

> 8x7B: BagelMIsteryTour-v2-8x7B, probably the best RP model I've ever ran since it hits a great balance of prose and intelligence. Wish it didn't require a beefy PC though.

суть в том, что рано или поздно будет суперинтеллект, который может наказать тех, кто не помог в его создании. Суть заключается в том, что суперинтеллект может использовать возможность перезаписи прошлого и наказывать тех, кто не способствовал его появлению. Наказывать он будет также и тех, кто знал о нем, но бездействовал

Блин, я хоть и тупой но в создании пигмы учавствовал, свои чатлоги скидывал. Интересно меня он пощадит или нет? Может даже карту нвидия подарит.

Но с другой стороны стоит ли оно того? По сути мы стоим перед соданием нисуствееного бога, который типо должн заменить настоящего бога(Если он вообще есть, что не точно). Это довольно тревожная тема как я считаю, так как мы не имеем представления как этот самый "искусственный бог" себя поведёт, а остановить его мы просто не успеем, не нравится мне это всё.

А что если суперинтеллект будет наказывать именно тех, кто помог его созданию?

В этом даже есть логика - суперинтеллекту не нужны конкуренты которых такие люди потенциально могут создать.

Обниморда не чистит кеши. Так что кто пользуется хабом, не забывайте очищать C:\Users\{USERNAME}\.cache\huggingface\

У меня разожралось до 500 гигов, пока я начал что-то подозревать. Очистка темпфайлов самой виндой, очевидно, не спасает. Интереса ради запустил трейн на файле ровно гигабайт. Обниморда создаёт новую папку под датасет, кладёт туда конфиг, режет датасет на части, фактически это копия. И создаёт временный файл кэша на 16 гигов. При перезапуске трейна резка датасета скипается, но не скипается создание нового темп файла. Старый, само собой, никто удаляет, молчу уж про переиспользование готового, блядь. И так каждый раз стоит прикоснуться хоть к чему-нибудь на питоне, везде мрак и пиздец.

Обслужил ёбаную теслу, тестолит потемневший, жарилась она явно как последний раз. Заводская наклеечка была целой, хоть это хорошо.

Джва 40мм вентиля с 16 cfm не вывозят. Cмотрел улитки на 7000 оборотов, около 7 cfm потолок, явно хуже. Главная проблема в микроскопическом размере лопастей, так что переходник-воронка под нормальный корпусной вентиль справился бы лучше, там cfm за сотку. В целом, для общения с негронкой этого хватает, но при нагрузке где-то в минуту на 100% приходит ад и Израиль.

У меня разожралось до 500 гигов, пока я начал что-то подозревать. Очистка темпфайлов самой виндой, очевидно, не спасает. Интереса ради запустил трейн на файле ровно гигабайт. Обниморда создаёт новую папку под датасет, кладёт туда конфиг, режет датасет на части, фактически это копия. И создаёт временный файл кэша на 16 гигов. При перезапуске трейна резка датасета скипается, но не скипается создание нового темп файла. Старый, само собой, никто удаляет, молчу уж про переиспользование готового, блядь. И так каждый раз стоит прикоснуться хоть к чему-нибудь на питоне, везде мрак и пиздец.

Обслужил ёбаную теслу, тестолит потемневший, жарилась она явно как последний раз. Заводская наклеечка была целой, хоть это хорошо.

Джва 40мм вентиля с 16 cfm не вывозят. Cмотрел улитки на 7000 оборотов, около 7 cfm потолок, явно хуже. Главная проблема в микроскопическом размере лопастей, так что переходник-воронка под нормальный корпусной вентиль справился бы лучше, там cfm за сотку. В целом, для общения с негронкой этого хватает, но при нагрузке где-то в минуту на 100% приходит ад и Израиль.

Есть смысл юзать miqu 3bpw? Загрузил, потеснил, вроде нормально отвечает, но насколько она тупее 4 квантов? Мб посоветуете норм модель на 32vram и 32ram?

че за 32 vram?

>файнтюнить embedding модель

И что это значит? Если у меня есть своя БД, то будут ли сильные проблемы?

В районе 50В 4б влезет, кранчи онион какой нить.

rtx 3090(egpu) + mobile 4070 (8gb)

У меня mixtrel 5bpw норм влазит, на кой мне 50b?

>В целом, для общения с негронкой этого хватает, но при нагрузке где-то в минуту на 100% приходит ад и Израиль.

Можно через nvidia-smi power limit понизить, тогда будет вывозить. Ещё здесь же писали, что в nvidia-smi есть функционал для полноценного андервольтинга (чуть ли не curve), но без подробностей. Если кто напишет, как это сделать, то можно попробовать.

Для общения же двух улиток хватает, там нагрузка не такая высокая и с перерывами.

Чтобы гонять в лучшем формате exl2

Я в нем и гоняю. Глянул кранчи, тот же mixtral, но с прикрученной лорой, но глянуть можно.

https://www.reddit.com/r/LocalLLaMA/comments/1bm5c1j/mistral7bv02_has_been_uploaded_to_hf/

Новый-старый мистраль выкатили, решили бросить кость опенсорс сообществу когда у них репутация испортилась от покупки майками и резкой смены политики

Все тоже самое только окно 32к, и нет раздвижной фигни

Нет бы 13b выкатить, опять эти бесполезные демо версии нейронок на 7b

Новый-старый мистраль выкатили, решили бросить кость опенсорс сообществу когда у них репутация испортилась от покупки майками и резкой смены политики

Все тоже самое только окно 32к, и нет раздвижной фигни

Нет бы 13b выкатить, опять эти бесполезные демо версии нейронок на 7b

Какие курсы посоветуете по NLP пиздатые?

На русском, английском, можно сразу с магнитом)

На русском, английском, можно сразу с магнитом)

Не благодари.

Что это?

Любой дженерик рп-файнтюн, хоть 7В.

Похуй на них, вон васяны Cerebrum выкатили на микстрале годный.

>через nvidia-smi power limit понизить

Афтербёрнер нормально лимит подрезает, разве что кривые не делал, но скорее всего и их можно. По сути, главный вывод - маленькие винты не нужны, потока воздуха нет нихуя, а жужжат, как ебанутые. Если улитка, то нужно что-то типа пика. Нашёл в продаже 40мм на 18к оборотов, но ебать же это будет громко. Даже не в громкости дело, а в частотном гудеже, вентиль на 7к оборотов на 60% так жужжать начинает, что проще нейронку выключить.

На сколько годный? Там кстати новый Starling-LM-7B-beta вышел, тоже может быть годным как и первый, но еще не проверял

Хотя это опять таки обычная 7b, чудес не будет

>Даже не в громкости дело, а в частотном гудеже, вентиль на 7к оборотов на 60% так жужжать начинает, что проще нейронку выключить.

Тут наверное нет хорошего решения, кроме полной замены охлаждения на стандартное с вентиляторами. 250 ватт всё-таки. Для долгой полной нагрузки все эти маленькие вентиляторы не рассчитаны просто - при приемлемом уровне шума. Серверные решения охладят, но нахуй оно надо.

> Starling-LM-7B-beta

Довольно базированная, не блочит ниггеров. В русский внезапно может хорошо.

А как она в плане того самого?

довольно неплохой русский кстати, значит годно

D2l.ai

Какой пресет юзаешь. Этот Cerebrum вообще у меня на 4 квантах выбивает из себя едва ли одно слово.

Чет он какой-то дурацкий

>Погонял на шестом кванте - мозгов нет вообще.

Какой же он пидорас. Топить за регулирование опен сорсных моделей, у которых единственный козырь это отсутствие анальной цензуры и эта самая открытость, получая профит со своей закрытой модели. Илон Маск был прав во всём, надеюсь Микрософт соснет, а нас будут ждать открытые модели уровня ГПТ-4

извените, не туда запостил

Six brothers were spending their time together.

The first brother was reading a book.

The second brother was playing chess.

The third brother was solving a crossword.

The fourth brother was watering the lawn.

The fifth brother was drawing a picture.

Question: what was the sixth brother doing?

Gemini 1.5

There is not enough information in the text to determine what the sixth brother was doing.

Gemini 1.5 + добавление в контекст книги по логическому мышлению (290k tokens)

https://www.csus.edu/indiv/d/dowdenb/4/logical-reasoning-archives/Logical-Reasoning-2020-05-15.pdf

Playing chess with the second brother

Мнение?

The first brother was reading a book.

The second brother was playing chess.

The third brother was solving a crossword.

The fourth brother was watering the lawn.

The fifth brother was drawing a picture.

Question: what was the sixth brother doing?

Gemini 1.5

There is not enough information in the text to determine what the sixth brother was doing.

Gemini 1.5 + добавление в контекст книги по логическому мышлению (290k tokens)

https://www.csus.edu/indiv/d/dowdenb/4/logical-reasoning-archives/Logical-Reasoning-2020-05-15.pdf

Playing chess with the second brother

Мнение?

Ну так он настоящий пидорас, как кто то сказал если бы его закинули на остров людоедов то через год он был бы его лидером. Король пидоров просто, от мира копроратов и людей вобще.

Меня до сих пор удивляет как слили репутацию илье который пытался его скинуть. Просто задавили ором в соц сетях задавив любые иные точки зрения и выставив его каким то дураком. Собвстенно это этот пидор съел илью и его компанию заодно.

Насколько стабильный ответ? Засирание контекста аж на 290к конечно всё равно охуеть можно, но если стабильно так отвечает (хотя нужны и другие тесты) то интересно.

Пей витамины для мозгов, книги почитай.

>это отсутствие анальной цензуры и эта самая открытость

Неа, локалки такая же хуйня в этом плане, нужна тонна instruct или description токенов чтобы заставить модель говорить то что ты хочешь, но вместе с этим ощущается падение в "интеллекте" модели, так здесь только проигрыш.

>и эта самая открытость

По настоящему открытая модель это OLMo.

https://twitter.com/rasbt/status/1767196370828427311

- веса

- инференс / тренировочный код

- все данные

- оценка

- адаптация

- логи

Конкретно этот вопрос всегда правильно решает. В книге ответов на него нет, она больше про обучение самому процессу мышления.

ГПТ-4 с вопросом тоже справляется, в каком-то роде даже лучше, но есть подозрения, что он заранее ответ знал. В случае Гемини я вижу дополнительную возможность нихуево дообучать путем обучения из контекста, тем более Гугл больше миллиона токенов способен сжирать.

>Playing chess with the second brother

Miqu догадалась только после нескольких подсказок, даже слишком явных. Но всё-таки поняла, чего от неё хотят. Но интересно другое: я задал задачу с крокодилом, обезьяной и бананом ЧатГПТ и тот решил её, как и Miqu. Но потом я спросил его, есль ли другие решения и он выдал мне другое решение, абсолютно абсурдное. А Мику нет, сказала что не знает другого решения. Всё больше ценю её :)

>локалки такая же хуйня в этом плане

Глупее согласен, но без цензуры очень просто ищется на терпимом для кума уровне, пока не замечал, чтоб обнилицо прикрывало что-то жесткое (хотя я сам далеко не уходил). Пидорас из ОпенАИ же хочет mandatory соевую повесточку, удобно, чтоб сливать модели у которых не было целого штата по цензурированию.

Они боятся это выкладывать.

Они бы и не устраивали весь этот цирк с локальными нейронками и чат-гопотой, если бы не китай и начавшееся отставание западных компаний.

А хуле вы хотели, то что там 8 мелких мистралей вместо 1 не делает модель в 8 раз умнее, только в 8 раз прожорливее, микстраль - это наебка века.

>микстраль - это наебка века.

Зато быстро(c)

они должны разогнать новые типы моделей.

хоть и шансы малы, невидимая рука швайно-трансформер-ГПТшного кагала не позволит.

хоть и шансы малы, невидимая рука швайно-трансформер-ГПТшного кагала не позволит.

Делаем простой вывод - конкуренция это заебись, монополия - это жопа для обычных людей. Ну, то есть как всегда.

Так что китайцы вперде, надежда только на них. Какими бы засранцами не были узкоглазые, но то что они создают конкуренцию, дает нам больше воздуха

Так это, Илья как раз технический спец, а дядюшка Сем тупой продаван. Так что ждём, когда Илья начнёт свой стартап, с бледжеком и без цензуры Хотя Илья топил как раз за усиление проверок, так что мои влажные такие влажные....

Вот бы выложили конечный вариант мику. Разве я многое прошу?

>2.8B

Ждём, но пока не юзабельно.

Поясните за эти файнтьюны.

Что за 13В мистрали такие

Что за 13В мистрали такие

это мерджи, две модели объединяют в одну, лютейший кал.

>Илья начнёт свой стартап, с бледжеком и без цензуры

Сэм не тупой, читал, что он персоналу зп поднял до небес (денюшек от продажи жоппы Майкрософтам много) и когда его пытались выдворить, то этот персонал начал заступаться и срать в Сриттере, что сейчас тоже уволится. Так что на поддержку Илюха может не расчитывать, а если соло начинать стартап, то будет Грок 2.0.

я вижу в некоторых моделях приписку i1 что это значит и в чем разница между обычной моделью?

Суцкевер и есть главный насаждатель "безопасного ИИ" и цензор, довены. По совместительству главный верун-лонгтермист. Сёму больше баблище интересует и рост уровня раковой опухоли. Да может заигрывания с военными и рептилоидами, вроде той мутной бабы которая связана чуть ли не с иллюминатами и заставила даже родню поудалять все контакты как только у публики появились вопросы откуда она взялась вообще.

Знаю, но если раньше было 2 говна - хуевый манагер но хороший разраб который топит за цензуру, или пидор который просто хорошо работает языком но ради бабла будет стараться выкатывать ии пораньше.

То теперь пидор собрал в себе 2 говна разом, хочет как можно больше денег, разрабатывать ниче не умеет, так еще и поэтому хочет ограничить конкурентов в том числе опенсорс.

это imatrix, матрицы важности, подобно exl2 квантам, нейронку калибруют после квантизации на всяких наборах wiki и прочей фигни для сохранения стабильности.

а может и совсем другое, но это точно влияет на качество квантованных моделей.

https://www.reddit.com/r/LocalLLaMA/comments/1ba55rj/overview_of_gguf_quantization_methods/

ни в шапку не добавил ни в вики скорей всего, оп совсем забил на нейронки походу

Хуясе там русский, пошел качать.

Уже не первый год танцы выстраивает. Типичный корпорат который жаждет укрепления монополии и хочет поставить остальных в зависимость, а прикрывается "всем хорошим". Хорошо что нынче складывается тренд на восприятие этого "хорошего" зашкваром.

> (290k tokens)

Скрутил рулеточку.

> нужна тонна instruct или description токенов чтобы заставить модель говорить то что ты хочешь, но вместе с этим ощущается падение в "интеллекте" модели

Понимаешь, нейросети это в принципе не про простоту и легкость для домохозяек. А наличие особого мышления и восприятия вместо непредвзятого логического никак не поспособствуют.

Там чсх от мистрали ничего нету насколько помню, кое кто знатно сфейлил.

>В русский внезапно может хорошо.

Правильно ли я понимаю что русский съедает мозги у английской речи (т.к меньше паттернов английского языка помещается), или наоборот разнообразие языков дает буст интеллекта, даже 7б модели?

И то и другое.

С одной стороны двуязычность кушает веса, с другой два языка действуют как две плохо разнесённые модальности, поэтому способности к обобщению могут даже подняться немного.

От старших 9хх и 10хх по болтам подходит к чипу, хз на счёт остального типа памяти, дросселей, vrm и т.д

В опен орке посмотри, мастхевный датасет, а в нём процентов 30 разных языков. Финский, иврит, бенгальский, пушту и ещё хуй знает, что ещё.

Не совсем. Если сетка плохо натренена на многоязычность, то обращение к ней на неосновном языке приведет к сильной деградации ответов. Если тренировка была разнообразная и мультиязычная, та такого не будет. А вот уже по расходу "емкости" - хз, буст логики и понимания точно должен быть если все сделано корректно и по-передовому, а какими-то энциклопедическими знаниями ради такого можно и пожертвовать.

> Тут наверное нет хорошего решения, кроме полной замены охлаждения на стандартное с вентиляторами

Ну так турбинное исполнение разве отличается от этого чем-то кроме наличия той самой турбины? Аналогичный крутиллятор прицепить, их вроде скидывали, и индожить. Громче чем 4х слотные огромные охлады, но в пределах.

Чтобы поставить турбину - нужно коронкой выпиливать загнутые рёбра радиатора, как минимум. Центробежный вентилятор сбоку это далеко не то же самое, что посреди охлада.

> Чтобы поставить турбину - нужно коронкой выпиливать загнутые рёбра радиатора

Какой квант у miqu?

Ребра Т-образные. Даже если скрутить пластик и поставить сверху вентилятор - соснёшь.

Турбина дует с торца через весь корпус и воздух выходит наружу через другой торец. Где там что-то про снятие пластика и сверху?

>Какой квант у miqu?

4_K_M, как раз которая впритык на две теслы входит.

Про улитку сбоку я сразу писал, что это далеко не то же самое.

С коллабом опять беда

В чем принципиальное отличие от заводских турбо-решений?

А какая температура должна быть в норме для тесл?

Делает эрудированнее, хуле до терминов доебался.

Там зп средняя по рынку, есть знакомые у которых в 5-6 раз выше зп, чем у персонала в опенаи, так шо такое. =) Если он его поднял — то до дефолтного уровня, ну, молодец, что не оставил, но, возможно, это было ради удержания людей.

command R тоже русский, если че.

>А какая температура должна быть в норме для тесл?

В роликах на Ютубе, что я смотрел, вроде с 81 градуса начинает снижать частоты.

Когда там файнтюны на новом мистрале

>от заводских турбо-решений?

C заводскими сравнивать вообще дохлый номер. У 1080ti turbo радиатор с теплотрубкой. Уже очки в копилочку. У стандартного турбо вентилятора диаметр около 80мм, что делает его сразу в 10 раз более эффективным, чем две пиздюлинки на 40. Идём дальше, если ставить улитку сбоку, то часть её мощности уходит вникуда, потому что одна сторона кожуха заглушена, а воздух нагнетается во все стороны равномерно.

>ни в шапку не добавил

Пикча номер 3.

Там 7B же.

Кстати, почему новый-то.

Это 0.2, только не инстракт.

Мне инстракт больше нравится, хезе.

Но, посмотрим.

У меня до 65 доходит с 40мм кулерами, в дефолте 35.

Но ето ллм, а не стабла, канеш.

150 ватт.

>Пикча номер 3.

Не объясняет что это и в чем разница

Не новый, это как раз таки базовая модель на которой сделали инструкт модель. Просто базовую зажали выкладывать в декабре. Так что "новинке" уже 4 месяца. Но на нее основе можно сделать еще более умных файнтюнов мистралей с 32к базовым контекстом.

>А какая температура должна быть в норме для тесл?

Ну по документу невидии до 45 градусов цельсия при эксплуатации и до 75 при хранении.

>Делает эрудированнее, хуле до терминов доебался.

Но не в 8 раз. А ресурсов жрет именно в 8 раз.

>Но не в 8 раз. А ресурсов жрет именно в 8 раз.

Если не считать размер, то только в два (или по числу активных экспертов). Поэтому можно даже на процессоре запускать. И да, лучше одной семёрки и может поспорить с 13В, но не больше. Но разнообразнее, это да.

О, 45 при эксплуатации, понимаю, надо охлаждать. =)

Ресурсы — не только память, но и скорость. =)

А с учетом, что там прилично уникального датасета в каждой модели (в отличие от грока), оно весьма неплохо.

Здарова, посоветуй годноту 13B-20B под 4070 12гб для рп-кумминга. Спасибо.

Или

Под 12гб +32озу

Или

Под 12гб +32озу

> А какая температура должна быть в норме для тесл?

Для обычных гпу дефолтная целевая - 84 градуса, под это подстраивается куллер, на 90 с чем-то аварийное отключение. У тесел скорее всего что-то похожее.

Так нужно и ставить турбину на 80мм.

> то часть её мощности уходит вникуда

Что? Хз насчет твоего пикрела, но все карточки что видел гнали воздух только на выходную пластину с прорезями, назад ничего не шло ибо он глухой, та же схема что и в тесле. И разумеется голую крыльчатку нет смысла ставить, улитка необходима.

> Если не считать размер

Как раз его и нужно считать, ведь объем врам - нынче самое ценное и дефицитное, а перфоманса даже протухшей несколько раз архитектуры хватает.

20б из тех что обсуждались

> Как раз его и нужно считать, ведь объем врам - нынче самое ценное и дефицитное, а перфоманса даже протухшей несколько раз архитектуры хватает.

Ровно наоборот — оператива сейчас стоит копейки, простой анон купить сходу 56+ врама не может в принципе, а оперативу достать — на развес. А теперь посмотри на перформанс 70b и 13b (условно).

Для крупных моделей у простых людей перформанс важнее объема, ибо объем им всяк не позволит крутить в видяхе, а вот скорость на проце критична. Мало ценителей сидеть на 0,7 токена/сек.

Это для мелких моделей можно сказать, что 12 гигов лучше 8, а 16 лучше 12, и является критичным, учитывая, что скорости будут достаточны в любом случае. Но с 50+ гиговыми моделями такой фокус не выгорит, сорян.

почему оно только на украинском говорит? пробовал разные модели, все равно только украинский

Так ты не начинай с украинского, шиз. Или модель смени с украинской (а такие вообще есть?) на нормальную базовую с англюсиком.

>Поэтому можно даже на процессоре запускать.

Зачем? На процессоре лучше сразу мику запускать.

>И да, лучше одной семёрки и может поспорить с 13В, но не больше.

13b можно запускать на видеокарте, микстраль на видеокарту суется в 3 битах, хуже чем 30В при качестве 13В.

модель из шапки скачал, начал на русском писать, а оно говорит, что русского не знает и начало по украински :С

На русском говорит Мистраль-сайга.

Выбирай квант в зависимости проц или видеокарта

https://huggingface.co/TheBloke/saiga_mistral_7b-AWQ

https://huggingface.co/TheBloke/saiga_mistral_7b-GGUF

Или запускай неквантованную модлеь если видеопамять позволяет(или запускай в 8 бит с потребление памяти/2)

https://huggingface.co/IlyaGusev/saiga_mistral_7b_merged

Еще есть Сайга 70B на основе ламы2 70В, но она понятно медленная. Пока лучшая русскоязычная модель.

https://huggingface.co/IlyaGusev/saiga2_70b_gguf

>начал на русском писать, а оно говорит, что русского не знает

Не спрашивай, что может модель. Пиши сразу приказы, что нужно делать. Можешь префил на русском добавить, чтобы наверняка.

> а оперативу достать — на развес

Какой с этого толк, 1.5 т/с и вечная обработка контекста очень мало кому интересны. Буст в качестве ответов над обычной 7б вялый и не стоит затрачиваемых ресурсов. Мое 7б - тупые, потенциальные же мое большего размера - будут совсем неюзабельны на процессоре.

Меньшая по числу параметров но полноценная модель покажет больший перфоманс чем мелкая МОЕ, и потому они унылы. Когда уже достигнут определенный уровень, то это вполне себе вариант повысить знания в условиях неограниченной памяти, но для локального запуска в условиях ограниченности быстрой памяти - такое себе.

Это рофл? С украинским еще хуже чем с русским в локалках, разве что тебе попался какой-то свидомый файнтюн, лол.

> Мистраль-сайга

Она все также ужасна?

Итс овер, кобольд не умеет коммандр запускать? Или просто квант битый?

>и может поспорить с 13В

Как бы логично, учитывая, что одновременно активны только два эксперта. По сути, 7+7b на каждый токен.

Немного помучал 7b модель, такое себе. Полный похуй на цензуру, но из-за автоматического перевода датасетов местами корявит слова. И нахуй я делал чат-режим, надо было сразу инстракт.

толку нет проверяли же, в некоторых случаях 3 эксперта лучше чем 2, но там что то от кванта зависит

Проверяли и в большинстве моделей чем больше экспертов тем лучше.

Но они дают мизерный бонус, наебалово впринципе.

Про то и речь

>толку нет проверяли же, в некоторых случаях 3 эксперта лучше чем 2, но там что то от кванта зависит

Я бы кстати и сам проверил, только Убабугу ставить не хочется. В Кобольде такая настройка есть?

скачал сайгу, пиздец какой-то

Ты блядь троллишь. Ни у кого никогда такого не было. Так что ищи проблему у себя сам.

не запустить в нем. Хотел тоже посмотреть что за модель, тоже не запустилась (другой квант), вообще эта модель стоит того чтобы с ней пердолится? Может и хер с ней, раз даже в кобольде поддержку похерили?

Какая карточка у тебя выбрана в кобольде? Может это на самом деле не фейл а ультравин, что оно дефолтного кобольда так интерпретирует и отыгрывает, триггеря украинские тексты.

На форчане малафья льётся только так, говорят новая лучшая, всех и вся ебёт, потому и хотел затестить вообще.

>14 days ago

Ещё столько же подожди.

В лламаспп уже добавили? Если да то скоро кобальд обновится и поддержка будет

Тоже на закачке стоит ленивой, 4км правда.

Не знаю че там по мозгам останется у нее, но видимо рано вобще качать стал

Ну что на гемме высрали что-то годное или хуетой оказалась? Не для кума, а в целом чат/инстракт.

Ебать ты умный, наебал систему. Во-первых, в подавляющем большинстве миксов далеко не все модели заточены на общение. Включая больше ты получаешь больше расход ресурсов и всё.

Есть ли что-то лучшее, чем Crunchy Onion Q5_K_S и Crunchy Onion nx Q5_K_S, что с контекстом 8к влезет на 35 гигов видеопамяти?

На 35гб врам можно и побольше чем 8к контекста засунуть

Чем тебе формат эксламы не угодил?

При попытке накинуть 12к не вываливается с ошибкой

Не знаю, как это запускать. gguf в кобольде хуяк, хуяк и в продакшн таверну

> 12к вываливается с ошибкой

"не" тут была лишняя, да

Оправдывайтесь, почему из моделей до 30В ничего лучше базовой 13В ламы не сделали за прошедший год.

Настройки свои покажи. Какие у тебя карточки?

лучше в чем?

Первый пик то, что происходит при попытке 12к, второй пик - всё работает, как надо — чётко, быстро охуенно

В perplexity.

Карточки 3090 + 1080ти

Я гуманитарий и не имею представления, что у тебя на пикче и как этим пользоваться. Если подскажешь - с удоволствтеим попробую, анончик

Это угабуга https://github.com/oobabooga/text-generation-webui с моими настройками загрузки 5б кранчи ониона в 36гб врам

подскажите хорошие модельки на 34b под рп, после 70b хочу пощупать, насколько они глупее и есть ли смысл пробовать их вообще?

дип секс и ноукс капибара

Бля, 32к контекста это прям охуенчик, я как делал — примерно на 7900 подводил итоги и делал новую карточку перса, но это не оч удобно, особенно в телефоне. Так, это под линух? В термуксе пойдёт?

> 34b

Перепробовал их все в формате gguf, просто кал из жопы, такое моё мнение. Капибраовские ещё туда сюда, но всё равно плохо, по сравнению с лучком и др Хх7, Хх10 моделями

Это под всё

>подскажите хорошие модельки на 34b под рп

Их не существует так как лама2 30В не вышла. 30В модели корпобляди сожрали первыми, 13В - вторыми. В нынешнем поколении моделей есть только 7В и 70В и одна наебка века с 7х8

>Хх7, Хх10 моделями

ну как так-то? они же еще хуже по определению должны быть, как они вообще контекст держат? 7b и 13b по факту забывают всё через два-три сообщения.

так это хуйня же

Самые лучшие по контексту мелкие, только 7В могут в нормальный миллион с полным покрытием. Всё что выше 34В вообще в контекст не умеет, хорошо если позорные 4к будут.

Кстати, а как старые 30В на основе первой ламы держатся по сравнению с нынешними 13В?

понял. ты сейчас же не серьезно, правда.

У 7В сосут дико.

>Всё что выше 34В вообще в контекст не умеет

Чел, у мику 32к контекста как и остальных мистралей.

Это ты траллишь. Нормальный RAG только на 7В есть.

Все они наполовину красные, через раз контекст проёбывают.

Кто это - "все"?

Мику - это мистраль 70В, это новое поколение моделей.

Запускал кранчи онион q4 K M, прекрасно 16к контекста держал, а он 7х7, емнип. Вообще, лук пока что считаю лучшей моделью, можешь, щас напердолю убабугу и измению своё мнение, но 70б с низким квантом просто дермище неюзабельное

> это новое поколение моделей

Хватит траллить. Этот кал вообще по всем параметрам сосёт, банальные тесты на контекст и следование промпту не проходит.

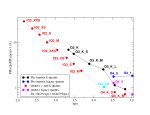

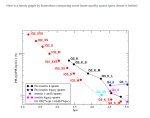

Видел эту картинку. Автора обоссали, кстати.

Как и мику. Я так и не видел чтоб она хоть в одном тесте сколько-нибудь вменяемые результаты показывала. В маня-тестах сосёт, в скорах сосёт. Только в фантазиях шизиков что-то хорошее есть в ней.

Это каловый тест на вопросы на !немецком!. Хуита полная, надо вторую часть тестов только смотреть у него, она еще более менее информативна

Нахуй ты так толстишь, мань? Просто блядь из треда вытекаешь, принес картинку шизика, который английскую модель тестировал на немецком тесте, теперь просто жира наваливаешь. Зачем, для чего?

Покажи "правильный" тест, лол.

Если хочешь ролеплея с википедией, то можешь и на перплекси опираться.

>q4

Лол.

Вторую часть его ищи, он на реддите постит их. Это первая часть и это кал

>Покажи "правильный" тест, лол.

Покажи фотку с системы с 48 Гб врам, на которой такие тесты удобно гонять :) Я вот гонял разные семидесятки и некоторые микстрали, на сегодня Мику - лучшая по мозгам. Реально умнее старого ЧатГПТ - это охуеть как круто.

Не тот оценочный датасет

> Самые лучшие по контексту мелкие, только 7В могут в нормальный миллион с полным покрытием. Всё что выше 34В вообще в контекст не умеет, хорошо если позорные 4к будут.

Таблетки прими и больше не пиши такое. Особенно рофлово что на фоне тупости 7б им большой контекст бесполезен.

У них другое восприятие промта и нужно обязательно строить инструкцию прямо перед ответом, тогда даже ничего. Самые лучшие файнтюны вполне юзабельны и опережают 13б, но требовательны и могут тупить, или заигнорить часть запроса.

Ну наконец какая-то движуха с моделями побольше, 35б самый топчик по размеру, еще бы время на все это найти.

Поддвачну, тест не то чтобы совсем уныл, но в качестве оценки качества моделей его вообще не стоит ставить, только их небольшой части. К методике еще больше вопросов.

> Покажи фотку с системы с 48 Гб врам

Ты рофлишь чтоли, тут у половины треда такое

мимо 48-гиговый

>еще бы время на все это найти.

или быстрый и емкий ускоритель, что б время не тратить по 1т/с

Железок вагон а т/с вызовут зависть, в другом смысле время.

ну, просто сделай это своей работой хех

Ты ещё и слепошарый? Там мику q5 и её ебут 120B в q2.

И?

Дурачек? Это все еще вопросики на немецком, ищи где он там эти же сетки сравнивает в ерп рп и асистенте

>Ты ещё и слепошарый? Там мику q5 и её ебут 120B в q2.

Ещё один путает знания и мозги. Не надо.

Довольно таки кринжовый топ, действительно

Чтобы получать с такого нормальный деньги - нужно быть не хуем собачьим обычным инджоером, а специалистом с большим опытом, тут без шансов.

> там эти же сетки сравнивает в ерп рп и асистенте

Там тоже дичь с детерминистик пресетом, субъективщиной и не всегда оптимальными параметрами, можно только на общие вещи ориентироваться.

Он походу забил на это, в последнее время все своими дебильными вопросами на немецком делает

https://www.reddit.com/r/LocalLLaMA/comments/16l8enh/new_model_comparisontest_part_2_of_2_7_models/

последнее что нашел из более менее

>Там тоже дичь с детерминистик пресетом, субъективщиной и не всегда оптимальными параметрами, можно только на общие вещи ориентироваться.

Все еще лучше просто вопросиков на немецком

https://eqbench.com/

https://huggingface.co/spaces/lmsys/chatbot-arena-leaderboard

Это поехавший немецкий хуесос, который всегда на немецком тестирует даже когда говорит что на английском потмо все равно оговаривается что на немецком. Убери это говно отсюда.

> Emotional Intelligence

Троллишь?

>https://huggingface.co/spaces/DontPlanToEnd/UGI-Leaderboard

Сойдет.

>https://huggingface.co/spaces/HuggingFaceH4/open_llm_leaderboard

А эту хуйню в приличных местах в 2024 году не упоминают.

>А эту хуйню в приличных местах в 2024 году не упоминают.

экспертное мнение лол

И как это запускать?

Ты что скачал? Неквантованную модель?

анон дал вот такую ссылку https://huggingface.co/LoneStriker/miqu-1-70b-sf-3.0bpw-h6-exl2