посоны, что за ошибка? Возникает при попытке аутпейнта двумя способами (poor man и mk2)

Молодец, спиздил картинку и гордо выложил ее здесь.

Визуально: генерирует аутпэйнт, но в конце картинка пропадает. Я так понимаю, не может сохранить.

Проверь указанные расширения картинок в настройках

Как победить такую хрень?

После установки https://github.com/adieyal/sd-dynamic-prompts при отключенной сетке запуск SD зависает на "Installing requirements for Web UI". Если подрубить сеть, то запускается без проблем.

После установки https://github.com/adieyal/sd-dynamic-prompts при отключенной сетке запуск SD зависает на "Installing requirements for Web UI". Если подрубить сеть, то запускается без проблем.

где, как?

Единственная настройка стоит по умолчанию

ввод .png, удаление до чистого поля ситуацию не меняют

инпейнт работает.

https://pythonz.net/references/named/keyerror/

Как я понимаю, питон хочет вызвать список расширений а он пустой почему-то

Перебил насильно в скрипте на «.png», ошибка та же

Обнови расширение или снеси и поставь его заново.

какой апскейлер посоветуете, ятобы увеличить конечное качество пикчи?

4x-UltraSharp попробуй, новый какой то, говорят хороший

О, тутор здорового человека, статьёй.

Положил в закладки

Не знаю постили или нет.

>RReyes04 commented 2 days ago

>This is related to Civitai, any model you downloaded today is corrupted and will not work. Let's hope they fix whatever is causing this. Your old models should work, or models downloaded from huggingface. Edit: I'm 90% sure of this.

>RReyes04 commented 2 days ago

>This is related to Civitai, any model you downloaded today is corrupted and will not work. Let's hope they fix whatever is causing this. Your old models should work, or models downloaded from huggingface. Edit: I'm 90% sure of this.

Там есть некоторые невнятные моменты, например, не очень ясно, как рассчитать количество повторов и эпох или связь этих параметров с количеством картинок в датасете. Но в целом неплохой автор, можно почитать.

Выглядит как 3д рендер, это без контрол нет и без имг2имг?

А как называется расширение, которое из картинок составляет промпт? Из головы вылетело...

А кто-нибудь вял себе Midjourney? Интересно было бы сравнить с СД.

Нажми на Interrogate CLIP в img2img

Нет, не оно

вообще без ничего. мне пиздец лень контролнеты и латнент каплы пробовать, хотя и нужно было бы. просто выставил ползунки как на пикче сверху, влупил батч каунт штук на 50 и сижу жду, пока они мне в папочку падают. процентов 80 получаются без явных дефектов.

По поводу вуалей.

Сделал множество тестов.

Шлемы, лыжные очки, пузыри.

И область лица никогда ничем не перекрывается полупрозрачным, типа блика или эффекта стекла. На 4й очки убивают лицо в хлам.

Даже если командовать, что лицо внутри бутылки, за бутылкой, оно всё равно будет прорисовываться без препятствий.

вот мы и нашли невыполнимую команду, анончики

3е по запросу лица за зелёным пыльным стеклом. Всё налипает на лицо.

лучшее, что удалось выжать с хоть каким-то подобием бликов на глазах и эффектом стекла.

ну расписывай

Сначала пилишь хайрезфикс через R-ESGRAN 4x с денойзом в ~0.35. в зависимости от важности деталей ставишь множитель от 2 до 3.5. можно ещё накинуть tiled vae, если памяти не хватает и если нужно прям много текстуры. А потом уже пихаешь в exstras и апскейлишь в Ultrasharp 4x или Latent.

Забавы ради сделал два запроса на русском.

«охуенный» — это в основном что-то вкусное и русское

«бургер» — что-то русское

То есть где-то в датасетах русский язык вкидывали

«охуенный» — это в основном что-то вкусное и русское

«бургер» — что-то русское

То есть где-то в датасетах русский язык вкидывали

Сначала пустырь с двумя разными хайрезфиксами, из одного оставил чёткую траву, из другого более мягкие и неаккуратные горы. Совместил в фш, нарисовал маску в центре и прогнал в инпаинт тем же промптом, но с абберацией

>ставишь множитель от 2 до 3.5

на этом месте я нипонел.

это где у меня тут такой множитель?

Бред, все работает, у него просто видимо хард сыпется уже

upscale by, у тебя сейчас так и стоит, на два

хм, у меня латенты только в хайрезфиксе есть. Как их добавить в обычный список апскейла?

Не, он все правильно написал. Копченые файлы на 20 байтов меньше.

Кидай линк на пример неработающих чекпоинтов

>any model you downloaded today

>commented 2 days ago

Так, у тебя нету чего-то в апскейле или в хайрезфиксе? Там это чуть-чуть разное. R-ESGRAN 4x должен быть по умолчанию, и довольно давно. Ultrasharp 4x скачивается, гайды есть на ютубах

Ты ссылки кидай конкретные. Я каждый день чекаю и качаю по 3-5 свежих моделей, все модели за 28-31 число у меня работают.

так а чё, уже можно перекачивать модели по-новой? а то я за последние 2 дня 7 мать его моделей скачал для опытов

Да. Если модель не генерит, а выдает nan error.

хм, одна сегодня с утра вроде выдавала ошибку, я хз какую, я думал может я чего наворотил

>According to Civitai discord this has been fixed ~14h ago.

>commented 2 days ago

Лор это тоже касается, кстати. Насчет ТИ хз.

Вкат тру нейроартом.

И быстровыкат халтурой, дабы не травмировать фотошизов, импотентов и прочих антихачистов.

Временно решено костылём.

Точнее это баг, из-за которого ошибочно используется не основное расширение файла а для гридов. А оно было не указано.

Нельзя оставлять поле расширений для грида пустым.

https://github.com/AUTOMATIC1111/stable-diffusion-webui/issues/9255 — багрепорт.

пачка вариантов Latent есть в хайрезе

мужка голого сделай

>модель пока работает только с моделью SD 2.1 или основанными на ней

Бамп

Че не так то? Добавил больше шума, получил больше изменений.

Не работает

Ух ты, а у тебя IQ выше сотки наверно, умеешь в примитивную дедукцию и чтение.

Можно как-то поставить в очередь несколько разных промптов+настройки? Например я хочу 5 совсем разных штук сгенерить, каждая по 50 картинок и свалить по делам. Может есть плагин?

запускаешь несколько раз веб юай и у каждого в окне пишешь разные промпты.

главное чтоб тебе память не забило. попробуй

Характерно красное пятно не выводящееся денойзами. Часто на месте красного пятно появляются странные детали пальцы пинусы и т.д.

Анончеки, дошли ли нейросеткило такого уровня чтобы апскейлить до реалистик стайла игровые текстурки? (Про нормалмапы и прочие карты молчу, но альбедо или дифуз было бы неплохо)

Да

Какой апскейлер тогда выбирать для реалистик рютекстурок? А и эт самое, видел как из картинки делали карту высот, а с текстурками такое можно будет? Просто это все занимает слишком много времени и сложно, а нейросетями можно ускорить процесс в разы, просто дорабатывая в остатке.

Блядь, объясните, по какому приниципу это было определено, что это цопе?

>00123-976043953.png

Москва, центр.

Так он на двач и не выкладывает цопе, только за деньги на зарубежных ресурсах.

prompts from textbox/file

https://github.com/AUTOMATIC1111/stable-diffusion-webui/wiki/Features#prompts-from-file-or-textbox

тебе же давали ссылку на доки

1. vae подключал?

2. seed менял?

Так а конкретно эти пики могут быть классифицированы как цопе? По мне так выглядят тянки молодо, но хуй их поймешь сколько. Тянка может так и в 20 выглядеть, если худая.

есть специальные модели для апскейла категорий, типа земли, стенок. Если такая существует — бери.

Ну или модели, натасканные на фоторил.

Мне бы знать где ее брать

аноны, есть варик генерить постоянно фотки одной тян? Имею большой опыт продвижения онлифанс и тг каналов моделек, могли б сколлаброироваться

Давай Лесли Нильсена

Делай лору да генери сколько фантазии хватит. А вообще, это наверное работа моей мечты. Главное чтоб тян была не страшная.

бля я не ебу чем вы тут занимаетесь мне даже на чатгпт регать лень

мне нужен чел который будет мне генерить фотки бабы и будем с ним 50/50 прибыль делить

Как это работает? "fts" ключевое слово, "thighhighs" - класс. Почему по ключевому слову не генерится?

Тут простое правило - всё, что постит этот чел это цопе!!!

99% нейродрочеров генерят баб. Больших, маленьких, жирных, тощих, 2д, 3д, молодых, старых, арт, фотореал. Есть Сталиношиз, он может нагенерить теюе бабу с усами. Давай конктретику, что хотел?

Просто какую нибудь бабу мне нагенерьте, можно выдуманную можно реальной лицо взять

и постоянно ее нюдсы генерить

я с этого с одной бабы 100к+ в мес смогу делать

потестил модель на базе сд 2.1, да соски не рисует идеально, пальцы редко есть небольшие проблемы, но генерация 30 сек сразу в 768х1024, никаких дабл-ёбл, реакция на промт типа освещения, бэкграунда, эффектов гораздо лучше чем у топ 1.5 модели

А аниме писичку сможешь продать?

не, нужна типа настоящая баба

Если не можешь продать аниме-писичку, тогда грошь цена твоим навыкам продавца пизды!!!

На данном этапе развития нейронок нельзя получить вменяемый результат. На всех фото будет разное тело, разный размер груди или разный пельмень. Окружение не повторить, если только не вписывать в существующий интерьер. Не будет повторяемости. С лицом тоже будут проблемы с повторяемостью, либо на оборот - будет одно и то же выражение. Причёска, одежда тоже будет с проблемами. Думай.

понял, тогда пока с живыми письками страдать(

А сколько фото в месяц нужно? Может я сам сфоткаюсь, за полтос то и ноги побрею.

я могу генерить такое, от реал фото не отличить, лицо всегда одно и тоже будет, любое выражение, почти любые позы, селфи т.д., но зачем мне ты в этой схеме?

ну сколько ты заработал без меня на этих фотках?

я на такой фигне не зарабатываю, у нас тут есть в треде продавцы говна на artstation, у них спрашивай.

ну я думаю там копейки

а я пацанам нормальные бабки предлагаю

Скажи название модели, пожалуйста.

Как в принципе делать так, чтоб никто не доебался, но и не генерить ебаных старух?

>лицо всегда одно и тоже будет

Ресторе фейсовика сразу видно - издалека. Продавец пизды, не подписывай с ним контракт, он тебя наебать хочет.

Можешь генерить что угодно, главное не выкладывать в тред офферы извращенцев-педофилов, которые предлагают купить у тебя цопе, которое ты выложил на зарубежных сайтах. Как бы, главное не кичиться тем, что ты генеришь цопе.

Я не про тред и не про оферы и вообще я цопе как раз не хочу генерить. Я про галереи да и просто пикчи на девианарте, например. Чтоб там не доебались. Чтоб не доебался товарищ майор. Кроме откровенно детских пропорций вроде размера туловища к голове какие еще признаки могут быть? Хотя и тут можно скахать, что это просто карлан. Или доебываются если уж совсем очевидно, что цопе, типа несформированные тела, маленький рост, тематика.

И да, кто-нибудь знает вообще, что допустимо, например, в законодательстве РФ? Голые сиськи можно? Голые письки? Хуй поймешь ведь. На тех же вконтактах дохуя эротики с голыми бабами, хотя откровенного порно, где ебутся поменьше.

У вас спина белая.

>Кроме откровенно детских пропорций вроде размера туловища к голове

Ты всё перечислил уже. Делай картинки, чтобы люди не были похожи на детей.

Эротика это норм, чтобы не было прям откровеньщины - раскрытая пизда, хуй в ней, хуй во рту, в очке и что-либо подобное. А просто красивое женское тело, где не раскрыта пизда во всей её "красе", это можно. Ну хуй, конечно, тоже нельзя голым держать, ибо это приравнивается к открытой пиздец во всей её "красе". Короче, то что касается половых органов это нельзя, а грудь можно, вот и отталкивайся от этого.

У тебя коленки сзади грязные.

Это так тупо, что я со смеху укатился.

>2

туда же.

Давно тебя не было в уличных гонках.

Я не могу совладать с АИ, слишком много, а надо всё знать!

Интересно прямо про открытую пизду. А если полупрозрачные трусы, то есть видна верблюжья лапка, но при этом в трусах, то такое можно? Ты, кстати, откуда эту инфу взял? Мне бы хотелось поговорить с человеком, кто в теме.

Ну так гугли различия эротики и прона.

А если, например, девушка в такой позе, в которой пизда раскрывается, например раздвинутые ноги, но при этом она в трусах, такое можно?

Artius

Лучше пол часа в треде педо-тряску устраивать, чем загуглить за минуту уголовный кодекс рф.

Да одно дело гуглить, другое дело что хуй знает как тот же товарищ майор определяет. Например вконтаче есть много открытых групп с голыми бабами, то есть там и письку видно и сиськи, но при этом "открытой пизды" и хуев я там не видел, и каналам уже по 5 лет. Возможно, ты прав и голую бабу можно рисовать, включая пизду, просто хотелось нюансы выяснить у какого-нибудь знающего.

И вообще ты так сексуально рассказываешь, я бы с тобой поняшкался :3

И это при том что на этом ебучем пиксиве горы действительно порно с детьми в анимешном стиле, где их ебут во все дыры толпой и по одиночке. А у того Антона только целомудренные девочки в кружевах и купальниках были

Ну так у японцев отдельные правила, тоже ебнутые правда. Но мы живем в Россиюшке и интересно про нее узнать, плюс про сервисы, на которых хостимся, например, девианарт. Кстати, какие ру площадки можно использовать кроме вконтача?

Ты, пидор-цопешник, поняшкался бы и с собакой!!

Аноны, осторожно, какой-то пидарас пихает трояны в файлы. Будьте осторожны и думайте своей головой.

Отсюда:

https://teletype.in/@stablediffusion/models_for_SD

>качать что то по двачерским ссылкам.

Сам ты цопешник! Хотя против рисованного цопе ничего не имею, в отличие от товарища майора. Реальные дети же при его создании не страдают, соответственно ничего плохого в нем нет. Но пока товарищ майор этого не понимает, избегаю.

Так ты скажи в какие именно файлы. В safetensors насколько мне известно, нельзя ничего запихнуть, только в пикл.

Посоны, не подскажете где последнюю версию Bstaber взять?

>против ... цопе ничего не имею

Так и запишем: "Айпи под постом 197682, не имеет ничего против цопе."

тврщ майор

Artius SD 2.1 768 vs 1.5 model самизнаетекакая, генерация сразу 768x1024, без фиксов. 1.5 пришлось перебрать много сидов чтобы получить результат без даблёбл и деформаций

То шутка, товарищ майор, первое апреля же.

Пошёл нахуй!

мимостарлей

А на 768 порнуху можно генерировать? Они же вроде что-то там поудаляли. Или умельцы уже перетренировали?

чисто прон как URPM нет, эротику и всё что угодно да

нюхай

Контролнеты в помощь.

Как же меня трясёт от стандатроного анямеебала в деливирирате и подобным пиздоглазым миксам. Анон ты молодец.

Лол.

Что тебе показалось смешным, чмоня?

Нахуя тебе кирпичи?

А лизать можно?

чтобы не делать вручную

Тайлинг включил?

И вообще, нахуя тебе один дефьюз, там уже можно полноценные материалы генерить сразу с нормалкой, рафнесом и высотой.

https://www.youtube.com/watch?v=_SDBAWDkO7c

Н-но... это не попочка...

нет, только нюхать. это ценный товар, пока не купил, не трогать.

попочки только по четвергам

насколько по качеству получается хорошо? а там мне нужны текстуры для ретекстура и один хуй надо из других собирать. Но вещь полезная, не знал. Изучу

>00152-2569775374.png

Это ботинки на вырост?

Это пирог?

A что за модель?

Эта лучше, она лучше передаёт страдание тни.

>Это пирог?

Это тянский растворитель.

но зачем? едва ли ты найдешь дрочеров, которые это купят

Что за модель братишка? хочу котов на генерировать. Или что лучше посоветуешь для котиков, ещё бы их очеловечивать немного, чтобы они какие ни будь дела делали, как monster hunter.

1 Да 840000

2 На некоторых seed, а на некоторых нет. Логика появления не понятна.

у меня сложилось впечатление, возможно ложное, что когда я высталвяю большой батч, на 50-100 пикч, то всевозможные артефакты вроде красных пятен, мозаичности, пикселизации, начинают появляться ближе к концу генераций. алгоритм может "уставать"? или можетэто от того, что видяха греется от долгого цикла загрузки и артефакты идут?

бля кому что, а долбаебу парашу генереную продать, для вас нужен отдельный тред котёл в аду где вы своим говном обмажетесь

и ладно бы сидел тихо и никуда не постил говнище это, так блять обязательно в каждый тред это на притащить

Нужно им в /wrk/ рядом с Толокой тред создать.

https://civitai.com/models/22922/lyriel

но у меня там ОЧЕНЬ специфический промпт и лоры, так что не знаю чем это поможет

азазазазазааззаз

Вы что тут, все тайно перекатились на 2.1? 🤔

Да. Нет, только один семен.

поясните коротко за инпейнт модели. что такое и чем отличается от обычных?

Вот нахуя?? Скажи, а?? Ты же это не продашь. Нахуя такое генерить?

умри в аду хуйло

От того и злой такой, что генеришь что-то, а потом это что-то не можешь продать.

Он там орет, не отвлекай лучше.

Все просто, это модели с упором на инпеинт. Для инпеинта лучше выбирать их.

а почему не инпейнтить сразу на обычной? один хуй поверх готового рисунка елозить. в чем суть отличия что для него надо целую модель отдельную?

это не я

диффундирую два дня, про одиозного товарища на букву Х, уже узнал, он кажется очень явно форсит свою модель, канал и все остальное, но вот для такого контента, кажется, realistic vision на порядок лучше. какой моделью письки сиськи делаете?

Все ссылки ведут на huggingface официальных моделей, где он там трояны увидел интересно?

вивернмикс

консистентфактор

для мультяшных отдельные

Аноны, сорри за тупой вопрос, а можно ли держать локально на компе не одну версию сд, а 1.5 и 2.1, но раздельно? Чтоб в каждую через свой батник заходить

>не продашь

Да что ты несёшь

>Нахуя такое генерить?

Давай, покажи нам как надо генерить.

хз, я тоже если честно, разницы особо не заметил

> письки сиськи

Модель грузина, очевидно же.

я в своем посте написал, что грузин, кажется, просто форсит свою модель, потому что на нее завязаны его бабки - бусти, ютуб канал, etc

Тем не менее - это ответ на твой вопрос.

я тот же ньюфаундлер из поста про сиськи чуть повыше. Я сделал в винде виртуалку на убунте через wsl. Видеокарта туда прокидывается, и собственно все работает также как винде, только изоляция больше кмк. Ты можешь поднять 2 виртуалки для разных моделей. Могу гайд пильнуть, если вдруг кому это нужно

Вот, что может img2img в SD.

Ебать ты шиз

1-2

Превратил скрин в мыло

ща попробовал без лор, может я грузинскую кухню готовить не умею, но не меняя промта так получилось.

Возвращайся на artius, если не умеешь. В чем проблема?

Ты просто забыл добавить секретные промпты на кожу и реалистичность. Они есть на бусти Хачатура за чисто символическую цену в 500 рублей.

если бы. В этом способе есть преимущество - если чето идет не так - все сносишь к хуям и ставишь заново за 15 мин + решение проблемы с полной изоляцией разных окружений.

Восстанавливается из бэкапа без всяких виртуалок

один хуй на вид хуйня. нейронки совсем не понимают содержимое оригинальных картинок, чтобы можно было сделать что-то реально годное

Как ее не проси, а шрам на лицо модель не может налепить.

Опередил

Зависит еще от того, как это все описывалось в промпте.

Голенькую давай

охуеть. когда там уже интегрируют ВИАР с АИ?

хочу Скурим с еблей от первого лица!

>но зачем? едва ли ты найдешь дрочеров, которые это купят

двачую неадеквата

На 4-ой неправильное разрешение задал, вот необрезанные варианты.

Дорисуй в img2img немного, через генераций 100 может будет нужный вариант.

э гёл. э врач, [too soon], [[[wow]]]

Охуеть на первом пике нильф вышел идентичным оригиналу. Вот сука как это получить? Потому что изображение получается либо таким же мылом если не большим, либо полностью перерисовывается

Аноны, объясните, чем Э гёрл отличается просто от гёрл?

> пробал пальцы

> одел чулок на пузо

> ус отклеился

> идентичным оригиналу

Приступаем,

проиграно

ЭммОчка?

Используй специальную модель для инпейнтинга, она также помогает и в img2img, ставь Euler a, так как у других самплеров с этим может быть плохо.

Можешь посмотреть как писать промт у вот этого реддитора

https://www.reddit.com/r/StableDiffusion/comments/11d61cv/antoinette_marie_from_the_dark_brotherhood/

Этот некропидор и мои пикчи поудалял, я говорю схуяли, он говорит - ща я ваще удалю твою модель, это я тебя ещё пожалел. Хуесос.

мы тут слишком тупые, в отличие от хача, который очень умный, в отличие от нас, поэтому не смодем объяснить в чем отличие никакого

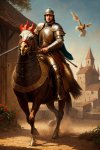

Маска были кинута только на бабцу и ебало мужука в доспехах.

Ты первый день здесь?

вторая АГОНЬ

Ага, теперь вижу. И на ебальце солдата (?) сзади тоже маска.

Видимо, инпейнт делался в один шаг, было не до мелочей.

это мемас)

>инпейнт

аха

Со слов Хачатура, который и открыл эту закономерность, с токеном "э" попадание в промт 100%, без него 70-80%

>с токеном "э"

это токен на жирнющий троллинг.

эн идиот

Во, уже интереснее, продолжай, раздевай

Заебало диффундировать... Просто почиллю с вами в тредике пикрандом

Да это явно art by frank frazetta.Очень уж он уважал такие синие картинки с оражевыми огнями.

В целом-то нормально, чо.

Это потому что ты диффундируешь за хуй моржовый, а мог бы зарабатывать на продаже пикантных сетов и был бы стимул

Ебать инпэйнтинг модели работают с маской ахуенно!!! Хули вы молчали то так долго про эти модели?????????????????????

Как думаете, RTX 5090 намного лучше с нейронками будет работать?

она в мою квартиру не поместится

Да уже отдельные видюхи будут для нейронок.

Новый кал для контрол нета:

https://www.youtube.com/watch?v=Tzt_RevMgnA

ну я бы пробовал сменить вае, узнал бы, нет ли в модели встроенного вае, конфликтующего, попробовал бы отключить лоры, другую модель, полумать, нет ли тэга, который может вызывать «крупные мазки краски». Тот же masterpiece например. Особенно если CFG больше 6

слишком большая разница между возрастом лица и тела, и размеры не стыкуются сильно.

2 мелко, 3 крупно, 4 мелко

> полноценные материалы

Неполноценные скорее всего.

если они генерятся на базе цвета, то это говнина, которая делает ямы в тенях и на тёмных элементах, например более тёмном кирпиче, чёрных пятнах леопарда, чёрных чешуйках змеи…

Зашёл, посмотрел,

да, говнина типовая. Тут была тень на альбедо-генерации, тень подчистило а глубину не выправило.

Это можно было делать из фоток годы назад. 2я картинка по мнению сервиса это кожа змеи с чёрными и белыми чешуйками.

Короче второсортная поебень на дальние планы.

даже вот такая недорогая процедурка смотрится привлекательнее!

Какая модель? Лору на раздвигание ног юзаешь?

> Лору на раздвигание ног юзаешь?

Нет.

> Какая модель?

Во избежиние подрыва вселенского масштаба, просто скажу, что 2-я на цивитае, найти несложно.

>2-я на цивитае

> 6 days ago

Блядь, вот почему нельзя взять тот же сет что и в 1.5 и обучить его на 512+? Ебаные цензуродауны, выпустили 2+, которая нахуй никому не нужна.

>Блядь, вот почему нельзя взять тот же сет что и в 1.5 и обучить его на 512+? Ебаные цензуродауны, выпустили 2+, которая нахуй никому не нужна.

Так у тебя в руках все инструменты для обучения, хули ты визжишь, долбоеб?

>долбоеб

Долбоёб тут только ты. Все существующие модели строются на базовой и берут на себя все недостатки базовой. А чтобы обучить БАЗОВУЮ модель тебе нужен сет из миллиардов изображений и кластеры с видеоускорителями.

>у тебя в руках все инструменты для обучения

Да, сейчас из кармана достану суперкомпьютер.

Ты не понимаешь разницы между лорой и обучением базовой модели?

Слишком глянцевые, обработай их шкуркой, с большим зерном.

Товарищ посмотрел в будущее и охуел

Я генерирую поштучно.

У меня не настолько мощный кудахтер чтобы перепробовать все варианты.

>можетэто от того, что видяха греется от долгого цикла загрузки и артефакты идут

Видюхе (исправной) похуй на размер батча. Иногда выставлял под 1000 на ночь и ничего.

ничоси. у меня там 100 максимум. это где надо подкрутить, чтобы больше стало?

Никто не запрещает залезать в ui-config.json

Туда бы еще тигров или львов

Кончились все.

Еба. Там еще и на пророка есть лора. Шарли есть в треде?

О, вижу ты анон шарящий, а есть ли наши времена уже не вручную методы создания текстурных карт?

RTX 2080 super 8gb подходит для генерации картинок?

На высоких денойзах обычные модели генерят слишком другое изображение, а инпейнт модели стараются вписываться в оригинальное.

ЛазуМикс.

Процедурки были и остаются топовым по трудозатратам и качеству «неручным» методом.

Посмотри как делают свои материалы polygon.com, они рассказывали немного. Там и фото и фотограмметрия и алгоритмы для очистки. И понимание настроек всех.

В разработке предсказательный метод, который с видео или пачки фоток может восстановить глянцевые полимерные материалы, типа кожзама. Основная прелесть метода в умении отсекать блики. Но это пока эксперименталка.

да

на модели без инпейнта попытка заменить сиськи приводит примерно к такому, приходится многократно через низкий денойз крутить

о, фрида затесалась

Да. Пока идёт полезность и хайп, ультимативные способности картонок офигенно востребованы.

Да и в разработке всякие нейропомогаторы тридэшникам,

А вы тоже презираете хачатура на дваче хотя смотрите все его видосики, моделите на делиберэйте и подписаны на бусте? Я да, ведь зависть у русского в крови.

>презираете

Я его обожаю, он мой ровесник, он говорит на моём языке, моими словами, то что я хочу услышать. Тупые, пидристичные думеры идут нахуй, а свою постиронию пускай себе жопу засунут, ебланы безрукие.

лингво-хач снова в деле посоны, все по кафедрам!

А масштабные поля сражения или типа того в этой хуйне рисовать можно? А то судя по треду это только селфачи всякие и фотки блядищ

ну що там, когда третья часть уже выйдет?

Пошел на хуй отсюда.

таблетки принять с утра забыл, шиз?

ну и как это продать дрочерам? Милфы не самый ходовой товар

Я совсем недавно поставил себе SD и не могу понять какую лучше модель надо использовать, чтобы можно было нормально переодеть ЕОТ на ОДНОЙ пикче с помощью impaint?

фотореалистичную инпейнт модель

Версия модели одна, но при загрузке на выбор 4 разных варианта. Поясните в чём разница между вариантами?

Лесная братва

как нарисовать камшоты на коже без лоры? промпты не особо помогают.

(sweaty skin shine:1.2), (cum driping on face:1.2), (cum driping on breasts:1.2)

если брать порнушную модель, то там аздники распидорашивает, они кроме тела нихуя рисовать не могут. Лоры начинают еабальники во весь экран рисовать, а мне нужно члоб в кадре были другие люди, эксгибиционизм же.

максимум что выходит это мокрую кожу с капельками пота сделать, но на буккаке и камшоты это нифига не похоже.

чтобы впарить дрочерам пикчи с милфами чтобы меня не забанили на девиантарте за слишком красивых девочек нужно добавить фетишей, блядь

(sweaty skin shine:1.2), (cum driping on face:1.2), (cum driping on breasts:1.2)

если брать порнушную модель, то там аздники распидорашивает, они кроме тела нихуя рисовать не могут. Лоры начинают еабальники во весь экран рисовать, а мне нужно члоб в кадре были другие люди, эксгибиционизм же.

максимум что выходит это мокрую кожу с капельками пота сделать, но на буккаке и камшоты это нифига не похоже.

чтобы впарить дрочерам пикчи с милфами чтобы меня не забанили на девиантарте за слишком красивых девочек нужно добавить фетишей, блядь

Новая модель сд ещё не вышла? С 2B параметров

>Милфы не самый ходовой товар

шариш

В чём прикол спамить промптом с превьюхи модели?

Что-нибудь своё когда будут сочинять?

продолжайте

Хоспаде, шож они все такие уроды-то!? Ещё и кивают все ну нахуй, жуть какая-то.

купил бы доступ к библиотекам таких пикч за 2 бакса в месяц на девиантарте?

Бери satensors и которая поменьше размером. Pickle считается устаревшей, потенциально небезопасной, может нести в себе исполняемый код.

Есть какие-то эффективные настройки / промпты для inpaint чтобы убрать из рук персонажа объект?

Я пробовал empty hand, empty hands в промпте, holding object in hands в негативе - никакого толку. Пробовал разные настройки masked content, разный denoising strength - нихуя. Единственные рабочий для меня метод - это тупо генерировать сразу большую пачку вариантов через inpaint чтобы просто по рандому хотя на одном из них рука была пустой и затем уже дальше от этого варианта работать. Но может есть какие-то более эффективные методы?

Я пробовал empty hand, empty hands в промпте, holding object in hands в негативе - никакого толку. Пробовал разные настройки masked content, разный denoising strength - нихуя. Единственные рабочий для меня метод - это тупо генерировать сразу большую пачку вариантов через inpaint чтобы просто по рандому хотя на одном из них рука была пустой и затем уже дальше от этого варианта работать. Но может есть какие-то более эффективные методы?

Замажь объект в мс пэйнте. Потом в инпейнт кидай, чтобы подровнять.

Спасибо

кароч в пизду фотореализм, анимешникам быстрее мамки зайдут.

С сегодняшнего дня в аасортименте нашего аукционного дома слегка залежавшиеся милфы, в виду тогоэ. что лолей всех уже раскупили. налетай не звай, мамки тоже с огоньком, приласкают, обогреют, всему научат, за опт скидка.

С сегодняшнего дня в аасортименте нашего аукционного дома слегка залежавшиеся милфы, в виду тогоэ. что лолей всех уже раскупили. налетай не звай, мамки тоже с огоньком, приласкают, обогреют, всему научат, за опт скидка.

алсо это мамки тех самых лолей, которые пошли с молотка ранее

дрочерам нужно давать сеттинг, описать на что они собраются пиструны дергать, чтобы у них фантазия разыгралась

>купил бы доступ к библиотекам таких пикч за 2 бакса в месяц на девиантарте?

Нет, милф я могу сам нагенерировать на порнхабе бесплатно в любых позах посмотреть. Платить есть смысл только за арт, которого нет в свободном доступе. Мне интересны картинки, в которых гармонично сочетается несочетаемое, маловероятное или невозможное в обычных условиях.

https://www.youtube.com/watch?v=6nthXso6iOE Хруст конечно красава, раскрыл секрет апскейла, теперь я наконец-то могу делать 8к uhd hyperdetailed photo

Один вопрос - НАХУЯ?

ты будешь печатать эти пикчи?

алсо у тебя один хуй вышла размытая пикча. где резкость проебал?

я буду зумить чтобы рассмотреть каждую детальку, каждый прышь

Это потому что он БУСТИ-ХУЮСТИ хачу не проплатил, все секретики он там выкладывает

Это потому что он БУСТИ-ХУЮСТИ хачу не проплатил, все секретики он там выкладывает

топ детализация, Хруст гений

заебал спамить хуйло

Не будешь.

Не будет.

всё хуйня, давай по-новой. пока четкие ресницы не запилишь, не возвращайся

Апскейл скунетом в экстас напоминает слегка.

Ало!, это эффект от художественной фотографии и объектива, ты слепой совсем?

Пережми в жипег.

Это теперь филиал Бизнес Молодости по продаже говна?

после того, как ты создал картинку, добавь (cum:1.4) через инпейнт с подключением порно модели на инпейнтинг.

[a girl | a giraffe]

Ало!, это эффект от художественной фотографии и объектива, ты слепой совсем?

Процедурки же это по типу тех которые созданы в сабстенс дизайнере? И не поспоришь, но зачастую все эти схемы материалов платные а денежек тратить на это лишних нету, ну а если ещё и говорить про ретекстуры игр где геометрия объектов делалась исходя из текстурок, то там и того генераторы использовать неудобно. Вот и хотелось бы приспособить нейросети, а в остатке уже остальные карты сделать не проблема, лишь бы дифуз ьыл с более менее ровным светом

Не оправдывайся, хуйтограф.

(long neck) в негатив нужно добавлять.

Воо. Так гораздо лучше.

И без вирусняков, в отличии от дваче-версии.

Жилетка Васермана проебана, дизлайк.

Галя Гадотина?

Получилась, хотя прописал Alyx Vance.

Всё так. А более мелкая версия это pruned: вырезаны неиспользуемые в данной модели веса, которые в полной оставляются на случай дальнейшего обучения.

щас бы что-то качать по ссылкам от Хача, лол, ни в коем случае не ставьте скрипты которые он пиарит на бусти и тем более не качайте его говно софт

https://www.virustotal.com/gui/file/6b0c302a49d77215c47800a6666a5e1c3993e6b18e109f0946a94eeb9e6b6d18

Семен, в трусах у него тоже ковыряешься?

Одержимый хачем еблан.

Внесите хача в спам лист, заебал свою хуйню тут рекламировать.

Не подтягивается с гугл диска модели. Дваче-сборка.

Модели лежат: «Мой диск(ну главная самая) →SD →models»

В сборке указываю: MyDrive/SD/models

маму ебал?

Модели лежат: «Мой диск(ну главная самая) →SD →models»

В сборке указываю: MyDrive/SD/models

маму ебал?

хруст не оправдывайся, не буду я качать твою малварь даже не пытайся

Да ты уже подхватил вич от меня, поэтому и стал моим личным хейтерком.

Не я дизайнера web UI маму ебал (хотя вангую эту хуйню сам разраб хуярит). Я готов с хуевым UX смириться, но хуярить compressed font это пиздец.

Зачем к мальчику пришел?

Под models должна быть еще и Stable-diffusion

мда уж, есть пиздатая идея нафайнтюнить базовую 2.1 под определенную узконаправленную задачу, которую пока не реализовали, но датасет на ~2 ляма пикч конечно никакой халявный колаб не потянет

Это по умолчанию на двачесборке стоит, я не дядя Педуард.

для генерации сетов КРАСИВЫХ ДЕВОЧЕК под продажу, очевидно же

Господи, это же тралинг, да? Ну не может же Виталий Александрович быть таким говноедом и любителем тугой струи в лицо? Ладно если бы это был 14 летний Виталик, я бы понял, может парень без отца рос и всё такое.

нет, вообще с фап-контентом не связано, поэтому я вряд ли отобью вложения, если даже разверну его потом в качестве saas

Хочу драг рейсинг на этих колесницах в этом сеттинге.

На первой лора или какие-то художники прописаны?

Установил лору, где она появиться то должна? Не могу даже интерфейс найти.

Хачатурный лев. https://www.youtube.com/watch?v=vl7JZW8Vmek

Вахтер не спит.

Хочу трахнуться с хачатуром, но чтобы мы оба были в образе голубоглазых анимешных тянучек.

Schizo, please. В отличие от тебя, я подписку на промпт не покупал, и собирал/использовал этот стиль еще с прошлого года. А ты нихуя, кроме полной копипасты промптов еще не высрал. И нет, там нет ни одного токена из грузинского льва, кроме самого слова lion.

Поговорил с GPT.

хруст не оправдывайся, не буду я подписываться на твой говнобусти, и не проси

нет.

на вот водяную девку и не кипишуй мне тут

Ты всё еще переживаешь за 250р? Не верну.

Бля, верни!

нахуй ты это генеришь даунич? это никто не купит, писец ты сын говна рофланебало

отрабатывать промпты то как-то надо

Хуй тебе. Покупай новый промпт, если старым не умеешь пользоваться.

А разговоров то было, мол в цирке не выступает

Зачем отвечаешь залетному бомжу с /b/ у которого бомбит с тех кто картинки успешно продает?

И тебя б тож трахнул :3

Нихуя фоотореал, это сд 2.1?

себя трахни ёпта сын собаки

Лол.

херня, дилебирате бы лучше в 100 раз сделала,на 2.1 моделях сидят говноеды биомусорные

Yuri Ivanovich Pimenov

Ах ты сучка агрессивная! :3

Спасибо, броу.

на 2-ом пике надо срочно ей помочь выдавить эти черные угри на еблете

https://civitai.com/models/15303/rmada-merge-sd-21-768

Потому и не смею своими руками прикасаться к модели от сверхчеловека для сверхлюдей

да

>платные

базовых много очень бесплатных. Под SD и Blender.

Но и с ними надо разбираться.

В играх альбедо пекут с шейдеров. То есть накидывают процедурно и пекут на единую карту, потом докрашивают. И могут добавлять в диффуз какие-то тенюшки типа AO

Можно пробовать роллить нейросеточные текстуры через Блендер, там есть аддон на SD с проекцией, кажись, но качество по итогу сомнительное.

так плагин и написан для 23+

Ахахаха. А цивитаи ты тоже сам сердечки себе ставишь?

Докладываю. Обе две лоры на фикс контраста годно работают.

очень заметно, что у миджорнея скрытые тэги на

эмэйзинг интрисинк детэйлс 4к 8к реалистик текщерз и фантастик-лора

пик3 справа мж

очень заметно, что у миджорнея скрытые тэги на

эмэйзинг интрисинк детэйлс 4к 8к реалистик текщерз и фантастик-лора

пик3 справа мж

Всё дело в Айше.

А точнее сколько ей было годиков когда с ней делали всякое

эээээ, ти, ти гдие живешь? давай встрэтимся! адрэс свой пиши я щас подейжаю

Ребята, у меня проблема, решение которой я ищу уже месяц. Я пытаюсь обучить лору в колабе и когда дело доходит до тестирования, оно вместо моего запроса генерирует рандомную хуйню и мне приходится добавлять к своему выозву более абстрактные понятие и тогда оно хоть и отдалённо, но делает что-то похожее на то чему я его обучал, тоесть оно обучилось тому что я ему обучал, но оно не генерирует это, хотя и знает как оно выглядит. В чём дело??? Я уже спрашивал в техно, но там всем похуй.

нам тоже похуй, пиздуй в онимэ тред, там помогут

Подробнее, нам не похуй.

https://colab.research.google.com/github/Linaqruf/kohya-trainer/blob/main/kohya-trainer.ipynb

Я пробовал и другие колабы от кохи, но там где написано Лора выдаёт ошибку с памятью

это не я.

покупай подписку на Девиантарте за два бакса в месяц и тогда поебемся

О, ну наконец годнота на 2.1 поъехала.

Пик 1. Почему у них в Фокусиме номера на авто арабские?

Совсем fuckусима

это не 2.1 это делибирате

хуяте.

во дурак, юзает 2.1, попробовал бы на делиберате те же промты вышло бы пизже отвечаю, 2.1 для быдла, делиберате для элиты

зарепортил

Зарепортил семёна-дауна.

мандаринка тян

Да ты же ебанутый на всю голову и не там ищешь проблему. Вообще забудь про какие-то вызовы тестирования в колабе. Просто делай лору и тестируй уже готовую хоть в коллабе, хоть скачивай на комп, там уже тестируй, приноси и показывай в чём проблема.

Она поди даёт не молоко, а сок

для 2.1 есть openpose или что нибудь похожее?

Дурашка, вот делиберат, с трейдмарковым жженым пластиком. А там явно 2.1, причем первые годные пикчи на 2.1 за этот тред. Кто бы мог подумать, что результат от промптера зависит, а не от модели?

Почему у 2.1 версии такая скудная поддержка комьюнити? Три годных фотореал модели, да пара десятков криворуких лор. Неужели все что касается SD крутится только вокруг дрочки и проногенерации?

Урезан датасет.

>Неужели все что касается SD крутится только вокруг дрочки и проногенерации

Помимо дрочки вырезаны все художники и ещё дохуя всего, нахуй оно надо.

дообучай на вырезанном, лол.

Ага, на каждую хуйню свою лору.

ты, наверное, нюфаня, и даже не знаешь, что почти все модели дообучались на дефолтной хуёвой sd1.5....

Каким образом ты дообучишь стилям десяткам тысяч художников. У тебя поди дома суперкомпьютер с датасетом на 100 лямов картинок и кластер с ускорителями.

а нахуя мне десятки тысяч художников? что-бы кривыми руками подсирали? вот заебца вырезали этих криворучек и генерировать нормально стало. а если мне понадобиться, допустим, ложкин какой-нибудь, или хуи лошадиные - без проблем обучу.

>даже не знаешь, что почти все модели дообучались на дефолтной хуёвой sd1.5

Обучение своей модели на базовой ≠ обучение на новом датасете.

>а нахуя мне десятки тысяч художников

>что-бы кривыми руками подсирали

Ясно, тебе вообще нихуя не нужно, тогда пиздуй в миджорни

пиздуй в анимэ, там художники есть.

Ясно, слит. Слит в миджорни.

>только вокруг дрочки и проногенерации?

как будто что-то плохое

>на дефолтной хуёвой sd1.5

Ой блядь, кто впустил долбоёба в тред?

Ты это WLOP в лицо скажи.

Дообучение - это урезание, чтобы добиться большей стабильности. А в 2.1 урезать и так нечего.

кек

Хороший фильм

До чего техника дошла.

лол, так на делибирате анатомия,освещение, гладкость,четкость и качество арта гараздо лучше

Сиси и пись.

https://dtf.ru/howto/1660668-obuchenie-modeli-s-pomoshchyu-lora

Нихуя не понял. Ну выполнил я необходимые пункты. Нажал Launch. А где мой интерфейс, чтобы я тыкал как дебил?

И ещё вопрос, куда картинки для обучения загружать-то. В гайде этом вообще про это нихуя не было. Была только загрузка текстовых описаний.

Нихуя не понял. Ну выполнил я необходимые пункты. Нажал Launch. А где мой интерфейс, чтобы я тыкал как дебил?

И ещё вопрос, куда картинки для обучения загружать-то. В гайде этом вообще про это нихуя не было. Была только загрузка текстовых описаний.

Ах, да, речь про LORA.

ЦОПЄ

Бля весь это видимо и с картинками. На пике просто были только текстовые описания думал ток про них речь. Маму ебал.

зарепортил дауна опущенного

Просто не спеши, читай внимательно, и все получится.

что значит moomin?

Она?

ну а кто ж

Да я хз кто это, просто вебмку схоронял, забавная.

Свинячья версия Дорочки.

хм, openpose на sd2.1 не идеально, но работает

пацаны ловите гет

чё забавного?

Хует, анимешник

Ложкин - бог.

сдрисни, аватарка

Ты миджорнист, чел.

кто?

Это оскорбление, ты должен был оскорбиться.

Ебать рот.

это ты тот еблан, который только буквами срёт и провоцирует на срач а треде для картинок?

Ну симпатичная такая тяночка. Милая.

Твои картинки где, разоблачитель?

Изи гет

бля

вот

красавы, как всегда просрали

Свинжорни?

ебать ты серишь, как обычно....

Двач - это свободное общение.

Лол. Кажется 4 предыдущих поста куда-то потерялись, в других тредах нихуя. Не иначе заговор.

Ах вот оно что. Свои погромистские навыки применил?

То что он тебя изнасиловал, не отменяет факт что Хачатур - лицо Русского стабле диффузии.

> Хачатур - лицо Русского стабле диффузии.

только для васянов, для которых гитхаб - чеченское имя

Двачеры - те же васяны, только дрочат не вечерами после завода, а целые дни напролет.

Что такое Ликорис?

Сорт оф лора. Только пока никто не придумал, для чего это надо. Какие-то манятесты на уровне погрешности.

Охуенная японочка. Лижу сосу, а потом ебу в ротик тебя :3

ебать ты даунич сын собаки рофланебало

Да сука ты заебал.

спокойной ночи, гето-проебщики

Главное что не отдали его твоим грязным бимбоунитазным, анимешноподобным шлюхам.

почему никто не дифунирует контент с этой няшей?

ты молодец что в таком низком разрешении скинул картиночку, а то я бы блеванул

Бля, анончик, Я ТАКОЙ ЖЕ КАК И ТЫ, тоже хочу онлифанс завести нейробабе, но как до меня написали - очень тяжело добиться стабильно хорошего, похожего результата.

НО, я примерно нашел два варика наебать систему, они самыми адектатными выглядят.

В целом, ничего военного, можем скооперироваться на каких-то условиях. Кста, а там при регистрации акка на онлифансе просят верификацию с паспортом, это ж можно с помощью фотошопа пройти, или у тебя все модели подтверждают личность реально?

Почему опять без ануса?

Переделовай или уноси это ничтожество без ануса.

выглядит как 3д рендер

вериф сделать реально а вот реал фото диффунировать это не реально

проблема даже не в бабе которую ты сдиффунируешь, а в окружении где она будет находиться, это постоянно делать фотки с боке и размытием, но всё равно хуета идея, пока сд модели не могут выдать фото которые не отличить от реальных, особенно если это нюдсы, портреты и селфи ещё можно как реал фото сделать, но не более того

Кстати можно же самому фотаться, а потом через img2img и лоры/модельки что-то мутить из своих фоток. Еще если парик надеть.

Сирус бизнес уровня /b, проще уж свой трапо инстаграм завести, лол.

делибирате с тем же промтом лучше, качественее делает. топ модель всё-таки

Я правильно понимаю, что 40xx видеокарты прямо ДОХУЯ лучше 30xx за счет более новых тензорных ядер и их большего количества?

Если я вместо своей 3060 возьму 4070 на 12 гигов когда она выйдет, я же прямо ДОХУЯ в скорости генерации выиграю? Раза в 2.5 или даже 3 быстрее будет?

Если я вместо своей 3060 возьму 4070 на 12 гигов когда она выйдет, я же прямо ДОХУЯ в скорости генерации выиграю? Раза в 2.5 или даже 3 быстрее будет?

>А то судя по треду это только селфачи всякие и фотки блядищ

Так потому что в треде и сидят два с половиной кумера, нонстоп генерящие блядищь.

Скорость хуета а вот количество видеопамяти нет. Хуанг говном кормит с 12гб на 4070 и 16 на 4080. Например text2video в разрешении 320х320 жрет 16 гб видеопамяти. 4090 безальтернативный вариант.

Сам думаю брать ли 4080 или оно окажется хуйней из за 16 гб vram

и дохуя дороже. ты готов переплатить дохуя дороже, чтобы генерировать писечки?

>ControlNet Stop Motion Animation - Automatic1111 Extension

>https://github.com/gogodr/sd-webui-stopmotion

>https://github.com/gogodr/sd-webui-stopmotion

>два с половиной кумера

Это всё одна вниманиеблядь обидевшаяся на двач. Не стесняйся репортить.

А что не ради писечки, в конце концов?

> 4090 безальтернативный вариант.

Кто бы с этим спорил. Но таких денег у меня нет. Перейти на диету из одной гречки и макарон ради 4090 я не готов... Будь я успешным и хорошо зарабатывающим - конечно взял бы 4090.

Смотря сколько будет это самое дохуя.

Рекомендованная розничная цена у нее 600 баксов. Понятное дело, что на старте продаж за рекомендованную цену продавать её не будут.

Но все же 3070ti прямо сейчас можно взять за 60к в том же ДНС. А значит, чтобы 3070 хоть кто-то покупал - она должна стоить не дороже 50к (если рубль еще больше не наебнется). За 50к или меньше я бы наверное купил.

Все равно видеокарт от Nvidia на 16+ гб дешевле сотни тысяч рублей мы не увидим раньше 50й серии, и это если предположить что рубль не улетит в ебеня.

Я конечно и на 3060 себя не то чтобы прямо плохо чувствую, но ради прибавки в скорости в х3 или близко к тому, 50к был бы готов отдать. Даже меньше, если 3060 на авито продать потом.

И шо, это по вашему не достойный онлифанса контент? Я с вами только растроился, вынашивал эту идею онлифанса пару недель, вот сделал модель на дримбусе, в целом, говнище конечно.

Кста, все, почему-то, советуют делать копии моделей на основе лоры, это оправдано чем-то, кроме конечного веса модели?

Ужоснах.

Теоретический концепт предлагаю - для повторяемости окружения - юзаем контролнет+накиданый в 3Д интерьерчик

тянку как повторяемой сделать - это посложнее - опенпоз может+ лора (в теории можно на тело интересующей комплекции натренировать, благо референсов голых тянок хоть жопой жуй

остается лицо - тот сложнее. чтобы не попастся нареальное лицо - юзаем метахьюман, для создания образца лиц,а дальше через какой-нибудь фейслаб, или в самой же нейронке на готовое лицо генерим все остальное...

да, процесс трудозатратен, но в теории результат может быть годным, если кто попробует, отпишитель, на каком этапе косяки всплывают нерешаемые

Какие промты нужно прописывать, чтобы нагенерить милф с телом как на 1й или 4й, но не со старым лицом? Может есть какая-то специальная модель под милф?

Автоматик как всегда в своем духе. Накидал за 3 дня 1.5 триллиона комитов и съебался, оставив поломаный вебуи.

Заскучали по совочку?

https://civitai.com/models/26888/therewasnosexintheussr

https://civitai.com/models/26888/therewasnosexintheussr

>1.5 триллиона

Все бежали, и я побежал?

Куда? Я на a9eab23 сижу. Но экстэншены один за другим скоро перестанут старый коммит поддерживать, и тогда их тоже нужно откатывать, canvas-zoom уже там, например.

Ну так он один не справляется. Я вообще в ахуе как он так держится.

> не справляется

Ну поучаствовать три дня в коммитовой оргии у него сил хватило же. Мне кажется уже полгода подряд каждую неделю в issues всплывает предложение разделить на stable и dev.

здаров чуханы, чё там, заработали уже на тропический остров?

запили его трахающего свинью

ага,умеет, только там на 1 фотку убито несколько часов инпейнта и фотошопа, за день может 1-2 пикчи делает

с толщиной лямок в зеркале проебался

та по ходу вообще с одеждой в отражении проебался

Сори если вопрос очень тупой, но я никогда раньше не обновлял webui и вообще не пользовался git ранее.

Я могу что-то проебать при обновлении webui?

Стоит переносить модели и изображения куда-нибудь, чтобы они не проебались при апдейте?

Я могу что-то проебать при обновлении webui?

Стоит переносить модели и изображения куда-нибудь, чтобы они не проебались при апдейте?

так я про то и писал что даже казалось бы в самом идеальном варианте можно увидеть что это генерация из-за корявого окружения

Как перестать скачивать лоры и модели и начать диффундировать?

Там и с волосами проёб. Вообще у SD с отражениями туго, она их как бы диффундирует, что при думскролинге отражение, как отражение. Но если рассматривать - нихуя не то. Та же хуйня и с пальцами и зрачками. Сутки инпейнта не скроют ебучие пальцы от диффундатора, но для обычного дрочера зачастую хватит одного прохода инпейнта.

Если вопрос только в памяти то есть старенькие теслы, на кеплере и максвеле, но там производительность конечно та еще, + боль с охлаждением, зато можно взять 24гб за "копейки"

Бля, вот это уровень, я понимаю. Хочу так же.

если делать контент для слепых умственно отсталых инвалидов дальтоников ни коим образом не хочу оскорбить каких либо инвалидов то пойдет, иначе - сам понимаеш... последняя не настолько страшно как остальные выглядит, но качественной это ее не делает...

ну ты ж сам видиш анонче, что оно выглядит так, шо токо в страшилки реквизитом добовлять... на онлифанс надо фап-контент, а на такое даже 12 школьник-спермотоксикозник который прон никогда не видел не будет фапать, не говоря уже про то, чтобы кто-то платил за такое

Сука, это что за модель? Охуеть там фотореал. Как он апскейлит интересно?

Чтобы что?

> на такое даже 12 школьник не будет фапать

Ох уж этот максимализм.

дрочил-по-книжкам-эммануэль-и-история-мадам-о

печально вообще так-то что стабильности вообще нет,

Кста. кто знает, Posex может не работать из за необновленной версии автоматика?

этого двачую, нужна стейбл ветка, где плагины совместимы и не надо каждые 3 дня обновляться а потом смотреть как оно все поломалось

ну, на предыдущем арте пальци довольно таки неплохие...

так-то на дрочеров ориентироваться затея так себе, поскольку комерческая ценность таких картинок КРАЙНЕ МАЛА

олды на месте вижу...

книжка так-то это другое...

> пальци довольно таки неплохие

Ну если не присматриваться, то и отражение вполне нормально, и зрачки, и даже даже трусы сидят на пизде, а не на куске мяса, к которому хирургом из фильма кевина смита про моржа, приделаны конечности. Но опять же, для диффундатора, который постоянно с такой хуйней сталкивается, и оно само в глаза бросается, это лучше заметно, чем для обычного дрочера.

> книжка так-то это другое...

Ну хз, в 12 лет таки проще на кривую картинку передернуть, там много не надо же. Алсо, если уж на хентаи всякие с октопусами есть своя аудитория, то на анкэни крипоту диффундированую тоже найдутся, может даже целое поколение фанатов появится.

СД ХУЙНЯ, НИЧЕГО В НЕМ НЕ ПОЛУЧАЕТСЯ ТАКОГО ЗА ЧТО БУДЕТ ПЛАТИТЬ.

БЫСТРЕЕ УДАЛЯЙТЕ!

ЭТО НЕ ПРИНОСИТ НИ КОПЕЙКИ!

УДОЛИЛ БЛЕАТЬ Я СКОЗАЛ!

БЫСТРЕЕ УДАЛЯЙТЕ!

ЭТО НЕ ПРИНОСИТ НИ КОПЕЙКИ!

УДОЛИЛ БЛЕАТЬ Я СКОЗАЛ!

Я в детстве жил в деревне и там сортир был на улице, а так как дома дрочить было палевно, дрочил в сортире под вонь говна и копошение опарышей снизу. Так вот я однажды начал представлять, что из говна вылезает говнотян и начинает мне жестко отсасывать. С тех пор меня начало это возбуждать. А вы говорите интернет плохо влияет на мозги детей. Не было тогда интернетов.

> из говна вылезает говнотян

Скажи спасибо, что не медведь.

надиффундируйте МЕДВЕДЬ-ТЯН!

Лижу писечку

да можно так же если посидеть в инпейнте и фш, как пример чиcто генерации в 2 прохода txt2img i2i, без controlnet, инпейнтов, фиксов и апскейлов

rookie numbers

на ещё

бля, не туда. Это лизуну -

Расскажи с каким семплером, апскейлером и параметрами ты делаешь апскейл? Валар хуету выдает, ldsr выдает какие-то ебаные пятна рандомные. Да еще и семплеры хуй знает какие выбирать, потому что эйлер делает слишком гладко, керас слишком мультяшно.

Не хочу девотек! Хочу властную зрелую госпожу, которая сядет мне на лицо и будет заставлять меня задыхаться.

Кстати об отражениях. SD их не только сама рисовать не особо хочет, но даже всячески их пытается перерисовать, если ей уже подать хуйню из гимпа. Только на низких денойзах типа 0.2 не пытается отражению ебаное леопардовое платье нарисовать.

МОЧЕРАТОР!!!

новый символ треда, а не эти ваши сталины и слаяночки

Хуй знает, слишком старая, можно что-нибудь в районе 25? :3 И чтобы взгляд был такой что типа "лижи эту киску"

а что не так? все одеты

да тебе хер угодишь

Сделай проще. Возьми пару-тройку активных рандомных инстаграмщиц. Качай их фотки и морфи одну в другую. Бери лицо со среднего результата и хоть в фотожопе хоть фейссвапом вставляй в пронконтент. Получившееся говно выкладывай на онлифанс. Может кому-то зайдёт такая хуйня.

Вот эта уже заебись. Лижу писечку и ляхи вокруг.

Сколько уже поднял денех, если не секрет?

Вдувабельно

а sd2.1 свиней нормально генерирует

я на новых аккаунтах пока монетизацию не включил. сначала надо немного аудитории набрать, а потом можно и окучивать. думаю через недельку можно начинать стричь

такс, а шо за средства для морфа есть? а то я с деревни, у нас там чистой дифузией принято пользоваться

>такс, а шо за средства для морфа есть?

Я локально этим пользуюсь https://github.com/alyssaq/face_morpher

Хватает

новый символ треда, а не эти ваши сталины и слаяночки

новый символ треда, а не эти ваши сталины и слаяночки

Запили его пиратом на корабле в окружении команды.

проиграл

В естественно среде обитания лучше генерируется. Кстати, эта лора сильнее других vram забивает. У меня щас пекарня на орбиту улетит.

Лора с встроенным вишмастером?

>такс, а шо за средства для морфа есть?

Если локально лень ставить и ебаться, то вот:

https://facemorph.me/

Хуй знает, safetensors. Памяти жрет, как сразу три лоры, даже ютубчик на паузу ставить приходится.

LORA

1. Закончил обучение через kohya ss. Что дальше делать?

2. А куда надо было вставлять слово-триггер? Я указал project_name но это не оно вроде. Найти не могу.

1. Закончил обучение через kohya ss. Что дальше делать?

2. А куда надо было вставлять слово-триггер? Я указал project_name но это не оно вроде. Найти не могу.

новый символ треда, а не эти ваши сталины и слаяночки

недавно вкатился в тему генераций, сразу скачал модель Deliberate и купил подписку на бусти создателя, 500 руб это копейки, он реально гений, это лучшая модель, теперь делаю шедевры, а чего добился ты?

А я бесплатно копипасчу в этом треде все промпты на делибирайте и прогоняю их в других моделях, чтобы показать всем, как я ненавижу делебирайте.

вот например настоящие фото, без подписки я бы так не научился делать

не понял ответ, у меня только Deliberate скачана, другие модели за чем вообще нужны?

я делаю порно и собираю на тропический остров например. алсо на хачевской модели порно хуевое, дрочеры такое не купят

> не понял ответ

Зря потратил 500р. Успешные пацаны промпт на делибертат в этом треде спрашивают и ненавидят грузина.

В *.txt должно стоять первым словом.

найс усы, пчёл

я лору сделал на тян своей мечты и теперь буду фапать, каеф

по кайфу сидеть в утонувшем и небампающемся треде?

Твои предложения? Бамплимит 500, перекат с 1000. Можешь рискнуть перекатить, но скорее всего новый тред потрут.

/b тард не палится

По сути все тематики такие вне зависимости от борды, года и степени популярности темы

охуеть Иллюминати уродов хуярит вместо людей

Где взять качественных референсов на голую тян для трейна?

Пробовал пихать рандомбап, но у них соответственно разные груди и получается мутная хуйня вместо сосков. Вроде когда-то видел на порнолабе как раз рефы на белом фоне, но сейчас не могу найти.

Пробовал пихать рандомбап, но у них соответственно разные груди и получается мутная хуйня вместо сосков. Вроде когда-то видел на порнолабе как раз рефы на белом фоне, но сейчас не могу найти.

>Где взять качественных референсов на голую тян для трейна?

О времена, о нравы. В далеком прошлом люди сохраняли картинки, что в душу запали. Но души давно задушили. Ищи.

спасибки

> fisheye

ftfy

щас бы делиберейт лучшей моделью был бы, с перетянутыми цветами и пластиковыми текстурами...

для артов еще куда не шло...

Кому отлизать, Госпожа?

серьезно. это "фото"? я вот не пойму, вы там через ЧБ телевизор 50х годов смотрите, или через телефон начала 2000х, или вы не видите? половина лица выжжена в хлам. половина с перетянутым красным. такие "фото" брак стопроцентный ни на что не пригодный...

и вот что интересно, с делиберейта красных оч много...

как сделоть этим женщинам освещение, как у

господина в этом треде?

а то вроде лоли есть. а качества нет.

какие лоры качать?

господина в этом треде?

а то вроде лоли есть. а качества нет.

какие лоры качать?

Это освещение модели Иллюминати. Я её удаляю нахуй, она все беальники перекашевает в одну и ту же уродскую физиономию

а чо хач не учит пользоваться другими моделями?

хорошо стол получился мраморный. чё за модель?

Глубоко похуй что там выжжено или нет. Они сами по себе вызывают отторжение свей пластиковостью и однообразием ебальников не смотря на an european woman или asian girl у тебя в промпте.

А ты неплох.

>Выбирай,правда или Действие?

Лучше дождаться 5090, уже на подходе и явно учтут нынешние веяния с нейронками.

просто нюдесы на рутрекере может быть пак референсов для художников, не помню много там именно нюдесов или нет, но там не порнушные референсы

ага, смотри чтоб не порезали вообще тензорные простым смертным

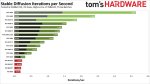

Топ 10 сэмплеров исходя из анализов 80к промптов с цивитаи. Карасегоспода, доколе?

Время появления, скорость.

>Топ 10

>11

Как обычно...

Ой да куда они денутся. Раньше делали ставку на майнеров, но облажались. Сейчас будут делать ставку на нейронки, это просто очевидно, при том что спрос есть и будет.

Уже кочаю! Страшные они там конечно, но что делать. Сделаю свой делиберате, без анимеговна и пластика.

Нахуй вообще этот 2M Карась нужен, можешь пояснить? Сижу на Euler a, для апскейла юзаю SDE Karras, брат жив.

нравится, модель от хача?

теплое с мягким путать не надо, среди майнеров основная клиентура была далеко не простые пользователи а бизнесмены с ангарами и блатными розетками, и спрос на майнинг был ввиду возможности получения прибыли от такового,

тут же ситуация кардинально иная - гонять нейронки в пользовательских масштабах прибыльно не будет, (имеем в виду тупо сдавать мощностя), те кто на самих нейронках зарабатывает те конечно будут зарабатывать, но мы не о том, так вот, к чему я веду, в таких объемах как майнинг, гонять нейронки не будет никто, более того, для годных нейронок нужны огромные объемы памяти, а "петиции" намекают, что открывать нейронки широким массам не сильно то и хотят, а для компаний которые занимаются нейронками. видяхи пользовательского сегмента нафиг не нужны, в виду малых объемов памяти и меньшей надежности, для них и так делают тензорные видяхи с граздо большим обемом памяти и возможностью объединения (так то 96Гб Vram на двух картах уже доступно)

Всё это, конечно, правильно. Но станут ли они добровольно отдавать рыночек красным, как это сделали синие, решив, что 8 ядер достаточно всем? Если учесть, что многие покупают процы от красных из рассчета "лишние ядра не помешают, может потом понадобится", будут ли буряты из нвидиа насильно разбивать линейку на проф карты, которые могут, и геймерские карты, которые не могут?

ну охуеть теперь. какой-то лохпидр спиздил мою пикчу с удаленного акка. как его зарепортить блядь?

>мою

АХАХАХАХАХААХ

Не пизди, такое говно точно никому бы не всралось

>в таких объемах как майнинг, гонять нейронки не будет никто

Нейронки будут гонять в больших объёмах чем майнинг.

> а "петиции" намекают

Это хуйня, которой подотрут жопу как производитель, так и потребитель. Миром правят бабки. Спрос рождает предложение. А если ты не можешь удовлетворить спрос - то уходи с рынка, найдётся тот кто сможет.

в смысле, блядь? моя пикча сделанная по моей же ЛОРЕ

ща буду маляву катать, вообще охуеть блядь, впревые у меня пикчи пиздят

обычно было наоборот

>спиздил мою пикчу

Свои "якобыправа" ты сможешь подтвердить только промптом и сразу же лишишься якобыправ как только выложишь этот промпт.

>моя

>моей

попустись, черт

ты датасет лайон5б собирал? или может ты владелец всех пикч из этого датасета? а базовую сд 1.5 ты тоже тренировал? дримбуз тоже ты написал?

мне кажется ты просто хуй сосал

ты чо бля! щас наберу промпт как тебя в сраку ебут, чорт!

А давай!

На нормальной модели попробуй

он после войны, ветеринар, травмирован, на ферме отдыхает, такова художественная задумка, Вуичича не знаешь что-ли

Шо, опять дэлыбрэйт доставать?

А хули делать

Когда эти рукожопы оптимизирует свой сайт? Даже на моём суперкудакторе сайт безбожно глючит, как будто на самом сайте встроен майнер.

рыночек и так разбит на проф и непроф сегменты, прям отдавать они не станут конечно, но и размывать границу проф и не проф сегмента тоже не станут, как не крути видеокарты из верха линейки стоят как чугунный мост, и прирост памяти не геймерском сегменте не настолько активен (а че, игры ж не используют столько памяти)

никогда, у них скоро деньги закончатся с их-то расходами на cdn

и в топе пикчи от лучшей модели в солнечной системе

реалистиквижон? у меня сайт не грузит

>Нейронки будут гонять в больших объёмах чем майнинг.

кто и где их гонять будет в больших объемах? при текущей тенденции ухода в облака, когда найти приложение работающее без интернета и не сливающее данных найти все сложнее и сложнее, а сегмент персональных компьютеровсдает позиции, и все на смартфоны укатывается, где opensource места нет, и корпорации решают кто и что и где гоняет...

ШШШ! Не пали годноту! Пусть быдло дальше задрачивает хачеперделку.

так говориш буд-то кто-то не знает...

(so foto 1.2 real]]

neg.

(((much plastic:1.6, (so not cool)1.2

Мне от ваших картинок хочется лизать

так я и не пытался фото сделать, там в промте накидано токенов на арт

Почему на всех твоих генерациях одно и то же деревенское ебало доярки? На себе лору обучила?

это artius sd2.1 у него с разнообразием лиц не очень

хз, Edge Of Realism,Neurogen и то лучше будет чем реалистик этот, вообще большинство моделей в топе цивиты это перехайпленое уныние.

А сталиных умеет?

на artius sd2.1 сталина не делал, вот rmada merge, эти 2-е модели на базе сд2.1 самый топ, artius для эротики, девок, rmada для артов в стиле миджорни, многие промты с миджорни даже лучше делает

>artius для эротики

Понятно. Значит artius можно не качать, нахер этих тёлок!

Эротика там только для привлечения внимания. На деле рисует такую хуйню, что лучше даже не пробовать.

А как для inpainting лучше выходит, если описывать все изображение целиком или только закрашенную область?

по какому промту он херню рисует? сколько не юзал, очень классно генерит, на промт реагирует очень отзывчиво

По эротическому.

а, ну в плане сосков и других интим частей согласен, идеально он сразу не сделает, но для этого инпейнт есть

Чел, ну не может 2.1 в обнаженку, палево же с инпейнтом. Да и лица пиздец, дохуя шума от сэмплеров. Единственное, где у 2.1 действиетльное есть преимущество - это пикчи с низким освещением, там действительно 1.5 не сравнится.

Двочую rmada - хороший микс.

1.5 выигрывает только в возможности генерить прон, в остальном говнище унылое, 2.1 генерация сразу в 768х1024 и выше без дабл ебл, больше эффектов, лучше освещение и стилизация артов, арты всегда на любом промте получаются более креативными и атмосферными.

вот я пример сравнения 2.1 и 1.5 делал 1.5 просто убожество

На всякий случай посчитаю это троллингом, который ИТТ в каждом втором посте, если не чаще.

Очевидно, проблема в промпте, а не модели, а так же в преимуществе 2.1 с темным освещением. Если тебе нужно именно имитировать миджорни, тогда 2.1 тебе больше поможет, в большинстве других случаев 1.5 справится лучше.

лол, в каких лучше кроме прона? давай примеры

> давай примеры

Пролистай тред, там, где не 2.1 - там 1.5. Если лично тебе оно не нравится, по какой-либо причине, включая закон Бэйкона (плохие манеры/национальность автора модели, на которой картинки были сгенерированы) - это не значит, что это плохой арт, это просто значит, что лично тебе это не нравится.

Перезалив годноты, попавшей под раздачу.

хахахаха найс сливаешься, не вижу больше смысла что-то тебе доказывать, сиди на 1.5 и дальше и верь в сказки ютуберов

срочно диффундируйте ебальники продавцов воздуха, а также и ебланов, которые на это ведутся

бамп вопросу

https://promptbase.com/ так уже давно и маркетплейс промтов есть ало

и судя по траффику буржуи нехило так покупают

кайф, пошел продавать дамп на 250к промптов с цивитаи

и сразу местным анонам-продавцам говна , хер вы получите выплату с этого сайта

найс попытка слить конкурентов

По ситуации. Если ты что-то заменяешь с высоким денойзом - описывай конретно то, что должно получиться. Если просто фиксишь с низким денойм пальцы/глаза/еще чего - можно оставлять тот же промпт, особой разницы не сыграет.

Зависит от конкретного случая. Если, например, фото простое, где баба стоит ровно и сиськами в камеру, то порой достаточно простого naked woman, если же она повернута к камере задом, то часто приходится уточнять, что спиной к камере, иначе на жопе пытается рисовать сиськи или еще что-то явно лишнее, и получается поехавший треш вместо фап-контента.

Вот этот анон намного лучше объясняет, что почем:

ору, там лютая модерация промтов которые ты хочешь продать,в основном покупают промты для миджорни, и выплаты только на Stripe, который доступен только для tier1 стран

>в большинстве других случаев 1.5 справится лучше.

хорошая шутка, оценил

Прикрепляй ко всем своим постам "ору", пожалуйста.

Схоронил. Так и хочется поняшить ей пузико)

Helen Mirren. Няш, на здоровье. С ней кстати нуде контент есть в Калигуле Брасса.

>Helen Mirren

Я видел её на цивитае, но это не совсем она, конечно) Но, тоже неплохо, напеки ещё.

Сам не лайкнешь, никто не лайкнет.

Хоть бы не позорился так с фотошопом.

ПроАНАЛизируй это...

Это ни на что не похоже.

> на цивитае

Посмотрел на эту лору, не сказал бы, что там сильнее похоже, чем тут.

Хотя нет, если глубже копнуть, там есть нормальные пикчи, просто первые на голом 1.5 сделаны.

Копай медицинскую тему, она там очень органична, больше ню)

Как насчет чашечки кофе с утреца?

Смотри, если ты делаешь only masked, то нейронка не будет значить ничего про картинку вне пределов данной маски. Но если у тебя денойз ниже 0.5 и ты просто проводишь only masked по лицу, то нейронка будет понимать, что это лицо и без промпта.

тредом ошибся, онимэ помойка в другую сторону

Что значит на подходе? Вот 4070 - да, на подходе, через неделю выходит. А у 5090 еще даже даты выхода нет. Пишут, что "в лучшем случае" она выйдет осенью 2023, но мне кажется с учетом того, что они еще даже 3ье поколение толком не продали, ждать их раньше зимы не стоит. Плюс кожанка еще и цену на карточки поднимает с каждым поколением. У меня на 4090 то бабок нет, откуда они у меня на 5090 будут. Я максимум могу 4080 взять - но тогда останусь вообще на нуле и буду на еде экономить. А вот 4070 по карману не так сильно ударит, если будет продаватся по цене более менее близкой к рекомендованной.

Скоро их не станет, ведь на civitai появилась галерея картинок с промптами.

станет, в массе sd никто кроме китая и тир3 недостран не пользуется, нормальные люди из США и Европы юзают миджорни по подписке, для них купить промт за 5 баксов это не деньги

Шизоид-конспиролог, плиз.

Одна из фич 40xx видеокарт это новый DLSS 3, использующий ИИ и те самые тензорные ядра для того чтобы выдавать охуенную прибавку к ФПС с минимальной потерей качества. По-сути, зеленые держат рыночек именно засчет DLSS и RTX в играх, а так эффективности даже игровых видеокарт в работе с ИИ и 3д графикой. Потеряв это преимущество - они объективно будут нахуй не нужной никому кроме фанбоев тыквой, потому что по сырой производительности в игрушках без всяких ИИ технологий и лучей - АМД гораздо лучше Нвидия, по-крайней мере в расчете на бакс.

Урезать тензорные ядра - это рыночное самоубийство для зеленых. Нахуя им это делать?

Дело говорит.

> АМД гораздо лучше Нвидия

Ну как CUDA-ядра придумаете, тогда и приходите.

ну що, посоны, кажется, живём. выходят модели и обновления на базе 2.1, контролнет для неё же, хайп разгорается, так что имеем шансы на хороший набор моделей.

куда они выходят? в помойку? 2.1 пару моделей мердженых обрубка за пол год вышло и всё, и то они неспособны нормально даже голую тянучку сдифунировать, годятся только для картинок собачек и котиков. 1.5 это топчик, нам больше и не нужно

(((very sun.)))

с вас 100 баксов, суки! с каждого!

вот это апскейл, моё почтение, Христ красава

Аноны, вопрос на стыке моделей, а кто пробовал использовать Лору натренированную на лицо в анимешных моделях? Как добиться лучшего результата и сходства? может какого-то автора указывать определеного?

онимэ тред в другом месте, не туда запостил

не знал про этот токен, помогло. Куда бабки отправлять?

Надо тренить лору на аминешной модели типа Anything v3 с аминешной vae, и (возможно) будет тебе счастье.

А фотолору пихать в аниме - ну, будет странненько.

Спасибо, не подумал сразу о тренировке на анимешной модели, попробую. В принципе, результат я получаю при весах 1.2 скажем неплохие, т.е лицо угадывается, подхватывает родинки и некоторые мелкие детали, но интересно было как сделать ещё лучше

Еще можно пойти путем проф. Макакяна и попытаться стилизовать прямо через промпт - добавлять токены anime, cartoon, art by #художник_нейм.

Анимешные модели сами по себе дают именно композиции и подходящую стилистику общей рисовки, ну и плюс более качественную прорисовку и композицию рук-ног, в обычной модели при попытке вытянуть промтами аниме к нему подтягиваются основные проблемы модели

Bastard Ai Anime Октокуру из лоры рисует так:

<-----

Надо немалую фантазию, чтобы узнать.

Те процессоры и эти видеокарты - не одно и то же. Если в первом случае это просто камни на одной архитектуре и совсем немного узкоспециализированных либ, использующих отдельные расширения наборов инструкций, то в случае с видеокартами это платы и толстая обертка из драйверов, либ и другого софта. На которую амд забили хуй. Даже если ты вдруг захочешь купить самую охуевшую видеокарту от амд, потому что больше тензорных ядер и памяти, то ты соснешь, потому что софта нет и карта либо не работает, либо выдает унылую производительность.

А софт просто так никто переписывать-доделывать не станет. Даже сейчас запуск сота нейронок на ртхах - побочный эффект: пишут под ашки вшки, но из-за той же архитектуры оно работает и на ртхах.

Научите апскейлить как хач. Скиньте уже кто-нибудь что он там на Бусти-хуюсти продает, не будьте крысами!

Семен, угомонись уже.

>вот из ахегао? из дат э тайп оф чииииз?

всегда в слюни на этом месте

Миджерни официально запретил генерацию Си Зинпина. Ну и пошли они нахуй тогда, шлюхи ебаные

Помогите разобраться, пожалуйста.

Допустим у меня есть негативный промпт:

(deformed hands and fingers:1.5)

1.5 усиление будет распространятся на весь текст "deformed hands and fingers" или только на слово "fingers"?

А в случае (((deformed hands and fingers))) как будет работать?

И будет ли эффективней использовать отдельно deformed hands и deformed fingers или вместе?

Допустим у меня есть негативный промпт:

(deformed hands and fingers:1.5)

1.5 усиление будет распространятся на весь текст "deformed hands and fingers" или только на слово "fingers"?

А в случае (((deformed hands and fingers))) как будет работать?

И будет ли эффективней использовать отдельно deformed hands и deformed fingers или вместе?

Есть тут кто пользуется моделью URPM?

Какого хрена колаб качает два гига, весто четырёх?

Причём, если качать модель вручную, то качается четыре гига.

Какого хрена колаб качает два гига, весто четырёх?

Причём, если качать модель вручную, то качается четыре гига.

> 1.5

Всё, что этих в скобках.

> (((deformed hands and fingers)))

Так же, только будет 1.3 вместо 1.5

> будет ли эффективней использовать отдельно

Попробуй, разницы особой нет. На каких-то генерациях будет лучше, на других хуже.

Спасибо! А может ты или еще кто-то может подсказать насчет Textual Inversion моделей - их можно использовать с любой моделью или с какими-то конкретными?

Вот скажем вот эти две:

https://civitai.com/models/4629/deep-negative-v1x

https://civitai.com/models/7808/easynegative

Их можно использоваться с любой моделью у которой base model это тоже SD 1.5 - или только с какими-то особыми моделями под которые эти Textual Inversion модели делались?

Согласно описанию по твоим ссылкам, первая - для всех 1.5, вторая - возможно только для аниме.

а ну заапскейльте пикчу в два раза с добавлением четкости и большей детализации

МОЧЕРАТОР, на четвертой пикче ЦОПЭ!

Языком залез в чашечку

найс, какая модель?

>не будет знать ничего про картинку вне пределов данной маски.

не совсем так. Нейронка знает в пределах плитки, учитывая паддинг

блядь, АИ реально тупой. я только что полчаса ебался с этой хуйней потому что не мог понять схъуяли оно начало вмне диффундировать черно белые пикчи. в итоге виной всему оказался промпт "black and white laced corset"

SOOOOQAAAA

SOOOOQAAAA

слышь, я последние 500 рэ потратил не для того чтобы какому-то онимэшнику просто так взять и слить всю годноту

Ах ты сучка!

>АИ реально тупой

>я только что полчаса ебался с этой хуйней

ВНАТУРЕ

Я купил его говно за 500 рублей, хотел для лулзов сюда всё слить, а там нихуя-то и нету, только ссылки на гайды из этого и анимэ тредов. Пишу в поддержку бусти хочу рефанд сделать.

пиздун, я вот реал купил и всё там есть, топ файл со стилями крутыми и куча видео гайдов с приват инфой

Пруфай, или репорчу за рекламу говна.

Обнаружены фото ИТТ семена, который в одиночку сражается с неверными и нечистокровными.

>НЕЙРОСЕТЬ ИЗОБРАЗИЛА ПОЛИТИКОВ В ВИДЕ ГРИБОВ!

Посоветуйте моделек не для прона

делиберейт v2, остальные модели в принципе не нужны, на ней можно сделать всё что ты захочешь

>не для прона

туда ли ты зашел, мальчик?

Благодарю

Мне пока убереалистика хватает... тещу

>пик

Тот самый анон в сд треде среди генерирующих порнуху

Зеленский у нас фуриеб получается?

фуриёб не у нас, а в анимэ треде

бля нахер ты прорисовываешь лица на размытом бэкграунде даунич, это пиздец просто как убого выглядит

Смешно же

тя ебет

офигеть ты сын собаки, смешно ему

Хихи

никогда не понимал этих фуриёбов, это реально типы с другой планеты, с такими лучше не связываться

оно само, блядь так делает. мне потом в фотошопе приходится ЗАМЫЛИВАТЬ НАХУЙ ВСЕ ЁБЛА НА ЗАДНИКАХ

либо при апскейле замыливать автоматом

пишешь просто в промте: logo и всё

parameters None

Абулий ворует экзифы.

лол, никто тебе не сольет на дваче эти стили, успокойся, все кто покупал подписку адекватные люди которые знали на что тратят деньги, и не для того чтобы это потом слить в паблик и лишиться обновлений

Промптовор, ты?

> кто покупал подписку

> адекватные люди

В голос. Местные дауны уже промпт не могут составить?

Немного Хлоюшки

Я ж не прошу весь csv-файл, один пропмт только.

короче караси всё же ебут

Как эта хуйня работает? Откуда она знает как разные объекты выглядят? Она в интернет обращается? Я правильно понимаю, что одна модель натренирована рисовать в одном конкретном стиле?

неправильная статистика. где (((very sun.))) ?

чем ДПМ++ 2М Карась отличается от ДПМ++ СДЕ Карася?????

Быстрее.

Пиздец. Первые 12 вообще не использую, кроме full body изредка. Кто все эти мастерписи и реалистики добавляет?

1girl, мастерпись - это всё что вам нужно знать о типичных юзерах sd

Ультимативный промпт гигачад эдишн:

masterpiece, best quality, 1girl, solo, looking at viewer, realistic, 8k, sharp focus, photorealistic, long hair

negative:

low quality, blurry, bad anatomy, worst quality, text, watermark, normal quality, ugly, signature, lowres

sampler: DPM++ 2M Karras

size: 512x768

steps: 20

cfg scale: 7

пошёл продавать короче на промптбейсе, а вы и дальше сосите жопу

Который из них? А по качеству что?

2м

Примерно одинаковое.

Хуета, надо все 50-топ токенов заводить, и в негатив тоже.

Да

почему с ним выходят только пиздоглазки на любой модели?

потому что в топе токены из бурудатасетов

https://danbooru.donmai.us/tags?commit=Search&search%5Bhide_empty%5D=yes&search%5Border%5D=count