> все же на CPU генерировать хоть и медленнее, но доступнее для простого хоббиста

Нууу, понимаешь, смотря для чего. Для рп нужно чтобы скорость генерации хотябы была не сильно медленнее раслабленного чтения, иначе весь экспириенс и атмосфера руинятся на постоянные отвлечения. Реалтайм и минутные ожидания - разница радикальна.

Просто попробовать потестить, или может какие вопросы задавать типа ассистенту - цп хватит, но тоже не фонтан.

Поэтому вкладываться в заведомо провальное действо это безумие.

Офк если пекарня хуевая в принципе то ее апгрейд должен быть первым приоритетом и похуй на этих ллам, а вот если речь про покупку для запуска ллм - тут только видеоускорители. Или мак, если есть для чего еще его применить и ничего остального из ии не нужно.

> Поставить какую-нибудь затычку пусть даже с 4Gb памяти, 3050 вроде дешево стоит.

Кто-нибудь вообще тестил ускорение обработки контекста нищекартами? Сдается что там будет на сотни-тысячи т/с а в лучшем случае пара десятков.

> если вдруг актуальны станут 100В+ модели

Да не станут быстро и внезапно, сейчас вообще может быть ебать какой застой на месяцы. Даже 70 нельзя назвать "актуальными" ибо про их запуск больше фантазий чем дела, сейчас тренд на 13-20б. И если вдруг они появятся - ты не сможешь их юзать из-за ожидания в несколько минут.

> купить вдвое большие ддр5 планки

Их нет

Поправочка, если ты работяга и пека нужна не только в ллм, то йоба система с 8+ каналами ддр5 уже будет таки хорошим годным выбором, но там уже цены совсем другие.

>> купить вдвое большие ддр5 планки

>Их нет

В 1,5 вполне себе в продаже не сильно дороже. Я вот даун не взял, повёлся на меньшие тайминги.

Как у тебя 7600 с нормальными процом будет выдавать менее 1 в секунду если у меня сраная, старая 1050ти с дохлым 1200f с ОЗУ ддр 4 3200 герц на 70b выдает чуть больше токена.

12100f* 64gb озу

Да не, скоростные стоят как крыло самолета, тогда как 32гоговые уже дешман.

> 7600

Если она окажется сравнима с 1050ти по обработке контекста и скорости слоев на ней с учетом всех амд приколов - не удивлюсь. Нашел что выбирать, в 8 гигов выгрузишь хуй да нихуя и с 4 гигами на общем фоне разница будет мала.

> на 70b выдает чуть больше токена

Квант уточняй, на нормальном и чисто на проце выглядит довольно оптимистично. Но даже будет 1.5-2.5 т/с что на нормальном контексте достигается у топ йоб с одной 4090, сути не изменит. Все также дохуя вложений а выхлопа - нихуя.

>Кто-нибудь вообще тестил ускорение обработки контекста нищекартами?

Смотри

Около одного токена в секунду мне как раз и надо.

Пойду короче обдумывать сборку с ддр5 или даже ддр4 памятью и нищей видокартой.

Всякие Теслы и Р40 сыкотно брать, а на что-то серьезнее бабок нет.

>1200f с ОЗУ ддр 4 3200 герц на 70b выдает чуть больше токена

Стоп. ЭТО ДРУГОЕ!!!!

Кэширование лама.цпп. Ты лучше расскажи сколько токенов выдаёт 70b при первом запросе.

>Активируем Instruct Mode

А нахуя?

> Около одного токена в секунду мне как раз и надо.

Около одного т/с без контекста может превратиться с 0.15 с 8к, офк речь про полную обработку а не кеширование состояния.

Какие кванты, друг? Я писал в прошлом тренде одному Антону что просто запускаю ярлык на рабочем столе и у меня всё работает, мне эти кванты ничего не говорят. Правда я конечно редко пользуюсь 70b. В основном 20b или мистраль. Разговаривать с вайфочкой на 4к контекста достаточно. Да я говноед не спорю, но мне вкусно

>Всякие Теслы и Р40 сыкотно брать

А придётся. Всё-равно всё остальное стоит как автомобиль.

Запуск долгий не спорю. Но Фарадей держит скорость токенов на одном уровне пока у тебя не забьёт всю ОЗУ. Я вытерпел около 3.5к токенов пока болтал с персонажем, занято было больше 50гиг, а свободно около 7.

Потому что модели тренировали на формате с инструкциями, и с ним они выдают лучший результат.

>Я вытерпел около 3.5к токенов

СМЕШНО.

>У него такая пекарня хоть год проработает?

Кто знает. Я вообще не верю в свидетелей выгорания видеокарт. Сервера без проблем годами пашут 24/7. Если за все это время не сдохла, то скорее всего и дальше будет работать без проблем. Поддержка софтом - другой вопрос, но P40 не настолько старые. Сам Герганов писал, что это норм вариант.

>и пока засматриваешься на перспективы проебываешь то что есть сейчас

Я проебываю разве что скорость. Последнюю неделю (или уже больше?) кумил нон-стоп на Euryale. Ответ генерится в среднем минуту. Медленно, но не то чтобы невыносимо медленно. В принципе могу перейти на Q2, на котором ответ генерится быстрее, чем я расслабленно читаю, но мне и так норм. Больше раздражает не скорость, а другие типовые проблемы лламы.

Сама модель просто огонь. Однозначно лучше mythospice-limarp. Автор, кстати, написал, что в версии 1.3 нет соевых instruct моделей с шизопромптами, и есть его лора тренированная на логах с прокси, включая NSFL контент. Скоро подкатит версию 1.4.

>С учетом что торгуется у нас эта железка сравнимо уже с парой a6000 или 80гиговой теслой - ну не, плюс других юзкейсов нет и беда с ликвидностью.

Пиздец, это в России такая наценка? У меня этот мак в минимальной комплектации стоит лишь немногим дороже, чем одна A6000 (5600 против 4400). По производительности, естественно, медленнее, но мне хватит и 5t/s. Главное чтобы можно было гонять модели побольше. Вот выйдет ллама на 180b, которая по мозгам как GPT-4, и 48-72GB видеопамяти сразу отыквятся.

>офк речь про полную обработку а не кеширование состояния.

Пофиг же. Пока контекст не заполнился ее не будет, а потом можно просто обрезать половину чата и кумить дальше.

>Сервера без проблем годами пашут 24/7

И у них постоянно отъёбывает память. Сначала ECC error, через какое-то время кернел паник или синий экран.

Так вот, важнейший вопрос: в каком состоянии память у этих старых видеокарт?

То что ты не знаешь/вникаешь что там не делает магии. Офк добавить в шапку в качестве средства для совсем хлебушков можно, но это путь потенциально сильно хуже чем могло бы быть. Представь что твоя вайфочка вдруг резко поумнела и начала давать ответы быстрее.

> Ответ генерится в среднем минуту.

А размер какой? Для 500 токенов это более чем норм, а если 50 то печально. Но всеравно завидую тебе, вернуться бы во времена когда поломанный хронос 13б с 2к контекста такую neuron activation давал, эх.

> мак в минимальной комплектации

Уже не сможет запускать что-то большое ибо памяти 64гига в младшей комплектации, гораздо медленнее в llm, какое-либо обучение или прочие нейронки под вопросом. Зачем, делать заведомо хуевый выбор?

Здесь его официально не завозят и спроса нет, потому у барыг большие наценки. С видеокартами гораздо проще.

> Главное чтобы можно было гонять модели побольше

Потенциал, который никогда не будет использован. Хозяин барин, кому-то манямир осознание возможности греет душу больше чем основной экспириенс.

> Пофиг же. Пока контекст не заполнился ее не будет

Нет не пофиг. Инстракт режим - не доступен, ибо там инструкция идет после описания полной истории чата и каждый раз промт будет новый. Свайпы - недоступны, ибо активации уже новые после данного ответа. Если Жора не пришил там какое-то божественное кэширование на все это, что врядли. Не используется огромный пласт потенциала нейронки и нет возможности чего-то изменить, это не юзабельно.

> И у них постоянно отъёбывает память. Сначала ECC error, через какое-то время кернел паник или синий экран.

О как, а мужики и не знали.

> синий экран

> Сервера

обзмеился

Про проблемы с памятью на видюхах вообще верно, но на серверных как правило все норм за счет хороших режимов работы. На той же A6000 обычная gddr6 без X, и намека на перегрев нет.

>потенциально сильно хуже.

Я понимаю что это. Но суть в простоте и доступности, не надо ничего придумывать и исследовать.

Справедливо, с этим пердолингом и гонкой за мелочами уже забыли как индожить.

>> синий экран

>> Сервера

Не змейся так жёстко, в крупных госшарагах AD всё ещё жив.

>А размер какой? Для 500 токенов это более чем норм, а если 50 то печально.

Токенов 150-200 где-то. Секунд 5-8 обработка, а дальше под 3 токена в секунду генерация. Это Q4 K M. Еще грамматика немного понижает производительность, но я без нее никак.

>Уже не сможет запускать что-то большое ибо памяти 64гига в младшей комплектации

Я про минималку с 192 памяти. Без излишеств вроде более мощного процессора или ссд. Сейчас он не нужен, это да, но если появится годная 180b модель - может стать разумным выбором. По мне лучше 5 токенов в секунду при хорошем кванте нормальной модели чем 20 при более мелкой модели и/или ужатой до предела.

>Инстракт режим - не доступен, ибо там инструкция идет после описания полной истории чата и каждый раз промт будет новый.

Инструкция и последнее сообщение - да, но вся остальная история чата не будет обрабатываться заново. Как я написал, это добавляет какое-то количество секунд, но в целом не критично (если ты не накидал в инструкцию 1000+ токенов).

>Свайпы - недоступны, ибо активации уже новые после данного ответа.

Свайпы как раз вообще моментально работают. Ничего не обрабатывается. Ты же не про полный контекст говоришь?

> Без излишеств вроде более мощного процессора

Он там кстати как-то влияет?

> если появится годная 180b модель

Если бы у бабушки были яйца, понимаешь. Даже если свершится чудо и сеть попадет качественный слив жпт/клод - можно продать одно и купить другое чтобы катать сразу не дожидаясь обработок дистилляций и прочего. Ключевой момент что в одном случае ты можешь сразу пользоваться и имеешь кучу возможностей, а в другой ждешь и ограничен.

> Как я написал, это добавляет какое-то количество секунд

Скинь что там в консоле выдает при этом, Жора большой молодец что выдал детализацию.

> Ты же не про полный контекст говоришь?

И так и так, нюансы смартконтекста не знаю, а когда в свое время тестил - ахуел с того насколько это пиздец.

>Он там кстати как-то влияет?

Влияет если память достаточно быстрая. Какой конкретно должен быть баланс я не знаю - надо тестировать.

>Скинь что там в консоле выдает при этом, Жора большой молодец что выдал детализацию.

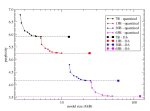

Пикрил - четвертое сообщение в новом чате. Обработка только предыдущего сообщения и инструкции.

>И так и так, нюансы смартконтекста не знаю, а когда в свое время тестил - ахуел с того насколько это пиздец.

Я им вообще не пользуюсь, а обрезаю историю чата сам. Специально ради этого наговнокодил поле, куда можно вбить номер сообщения, по которому обрезается контекст.

> Какой конкретно должен быть баланс я не знаю

Тут конкретно про перфоманс мак-студио в ллм с разными процами. Маловато данных публичных.

> Пикрил

И на свайпе аналогично? Если так то это прям большой прогресс, раньше оно могло вообще с ничего на чат режиме решить полный контекст переобработать. С ростом размера обрабатываемого контекста или если весь пустить скорость его обработки (~50т/с) падает или остается?

В чем разница между V2 и Tavern картами и какую экспортирует SillyTavern если дать ей ссылку на chub?

>И на свайпе аналогично?

На свайпе такая же скорость генерации, а время обработки промпта ноль, поскольку обрабатывать больше нечего.

Обработка заново еще может быть из-за всяких author's note на большой глубине. Вставишь на глубину 10 - будет обрабатывать последние десять сообщений, поскольку лламацпп кеширует по префиксу. У меня же промпт не меняется, а инструкции находятся на глубине 1.

>С ростом размера обрабатываемого контекста или если весь пустить скорость его обработки (~50т/с) падает или остается?

Если достаточно видеопамяти, то остается, растет только объем. У меня же память немного перегружена слоями, поэтому чуть-чуть падает. Если запихнуть еще 1-2 слоя, то упадет уже в разы - специально так подбирал. Скорость генерации зависит от общего контекста и падает на 10% при заполнении.

V2 может содержать в себе систем промпт и джейл и он оверайдит те что в самой таверне. Но это не для локалок.

че шапку не поменял, там можно было гермеса написать вместо орки, он умнее, особенно 2.5. Ну или опенчат

Подскажите, какую модель взять для ролевой эротики?

Как я понял, они только на английском отвечают?

Как я понял, они только на английском отвечают?

На русском тоже могут, но сухо отвечают, не красочно. Ну попробуй вот это из самого топового сейчас, как оно в ерп не знаю

https://huggingface.co/TheBloke/OpenHermes-2.5-Mistral-7B-GGUF

Именно опенгермес не пробовал, но мистраль клодчат и опенорка оче разочаровали, как интеллектом так и ерп. Лучше уж опенчат 3.5 качни.

>Подскажите, какую модель взять для ролевой эротики?

Если можешь запустить 70b, то вот эту:

https://huggingface.co/TheBloke/Euryale-1.3-L2-70B-GGUF

Если нет, то вот эту:

https://huggingface.co/Undi95/MLewd-ReMM-L2-Chat-20B-GGUF

>Как я понял, они только на английском отвечают?

На других умеет но очень, очень плохо.

опенчат и новый гермес топчики, каждый лучше любого 13b, кто то пишет что лучше даже 65b но я не запускал так что сравнить не с чем. Лучше 33b из тех что я запускал.

У меня опенчат даже один раз с верной аргументацией (почти, 1/4 предложений он высирал хуйню, но при дальнейших рассуждениях игнорировал, на ответ не повлияло) решил загадку про сестёр братьев, и очень часто просто давал верный ответ с чуть кривым ходом мыслей и часто подмечал суть загадки - мол петра одна из сестёр и сёстры на каждого брата одни и те же, так что у меня он топ-1 по интеллекту из тех моделек что тестил.

>(почти, 1/4 предложений он высирал хуйню, но при дальнейших рассуждениях игнорировал, на ответ не повлияло)

похоже на загрязнение данных, впрочем сетка действительно кажется умной, но вот такая хуйня подозрительна. Сетка должна быть последовательна в ответах иначе какой то наеб

Вот, нашёл ответ. Не так идеально как хотелось бы, конечно, но из всех протестированных сеток это лучшее что было, и частые упоминания 2/сестросовпадений намекают что зайчатки разума таки есть. Остальные бредили про 9, 7, 27, 228 сестёр, меняли петре пол и прочее.

Ну зайчатки разума у многих моделей есть. Просто задача больно уж типовая, модель могли научить ее решать. Надо чет другое тестить, что еще не сделали частью датасета.

Вот попробуй

Solve the riddle. At the beginning there were 2 people in the room. Then 3 more people entered the room. After that, 1 person left the room. How many people are left in the room?

Тест простой, но я его сам придумал давным давно, минимальный порог мозгов проверять еще на первых 7b которые не могли решать загадку лол

I want you to solve a simple riddle. Petra is a girl. She has three brothers. Each of the brothers has three sisters. How many sisters does Petra have? Give an explanation with your answer, outlining your careful reasoning.

С опенчатом уже завтра повожусь ещё.

> и какую экспортирует SillyTavern если дать ей ссылку на chub?

А чё так можно было? Я руками всё копировал...

>А чё так можно было? Я руками всё копировал...

прям копировал или качал картинки а потом открывал таверной?

Блять да...

Всмысле, копировал текст из каждого окна в каждое окно и аватарку скачивал и ставил отдельно в таверне.

В шапку нужна ссылка на гайд по таверне...

Больше чем в половине случаев отвечает правильно, но опять таки не понятно загрязнение данных или просто сетка умная, или все вместе

Это всё гермес или уже твой опенчат? Какие значения семплеров?

Это всё openhermes-2.5-mistral-7b.Q8_0, в принципе тем и нравится что думает последовательно, а иногда сразу отвечает как в первой загадке что я давал. Выебывается говоря что это простая загадка и дает ответ лол

>300 топк

Хуяси, я это с 25-50 тестил.

так это ж стандарт, я ниче не менял кроме мин-п, все остальное отрубил кроме температуры и повторов, на сколько я понял

Ну, я свои модели на своём рп-семплере тестил, лол. Впрочем у меня и цель была в реалистичных для меня условиях ум моделек потестить. Надо тогда будет опенчат с стандартными значениями перетестить, может тоже чаще будет умное выдавать.

Опенчат многословнее, как подобие большой сетки, гермес пишет лаконично, но тоже иногда может завернуть на несколько параграфов.

Но интеллект сравнить труднее чем просто стиль письма посмотреть. Я мало тестил опенчат, 1 раз только запустил потыкать. Но не глупее гермеса на первый взгляд

>мин-п,

Кстати, разве 0.5 не дохуя? Я в тредах на гитхабе видел 0.05, лол.

хуй знает, пока работает, не понравится поменяю

Это проценты отсечения, 0.05 отсекает меньшие 5 процентов от самого большого, у меня 0.5 отсекает все что на половину меньше наиболее вероятного токена, можно хоть до 0.9 тыкнуть я так понимаю

На мин-п 0.9 уже начинает иногда шизить но все равно дает ответ

>иногда шизить

не шизить, то последовательно выдает правильные ответы, но может и такое завернуть или умножить 6*6 хех

>Euryale

А какой промпт/настройки под неё? Стандартный Roleplay подойдет?

А ты не очень внимательный.

>А какой промпт/настройки под неё? Стандартный Roleplay подойдет?

Вот этот промпт: https://huggingface.co/lemonilia/limarp-llama2-v2

Автор клянется что лимы в этой модели быть не должно, но она почему-то там есть... С настройками экспериментируй сам - тут на вкус.

>но она почему-то там есть

Почему так думаешь?

>Почему так думаешь?

Продолжает промпт буквально с нуля, следуя формату лимы.

А вставлять вот это всё

### Instruction:

Character's Persona: {bot character description}

User's Persona: {user character description}

Scenario: {what happens in the story}

Play the role of Character. You must engage in a roleplaying chat with User below this line. Do not write dialogues and narration for User. Character should respond with messages of medium length.

### Input:

User: {utterance}

### Response:

Character: {utterance}

Куда? В "последнюю выходную последовательность"?

еще обнова кобальда

Анон, ты совсем хлебушек? Там же написано как все настраивать буквально со скриншотами. Это - шаблон. То, как должен выглядеть финальный промпт. Я вообще советую включить логирование в консоль в опциях, нажать F12 и играться с настройками таверны, пока не поймешь, как строится промп.

Не совсем,просто сейчас валяюсь с температурой и не особо соображаю.

Получается всё как тут должно быть? https://files.catbox.moe/jvl6g1.png

>Получается всё как тут должно быть?

Ну в принципе да. Я правда сам настраивал, и у меня получилось немного по-другому.

бля теперь медленнее стало

Там же минорная версия обновилась, лол.

Не вроде норм, может там мин-п сажает генерацию, на пол секунды-секунду скачет. Максимальная скорость осталась, а вот скачки меня напрягли

Как вам автонастройка слоев в кобальде?

Слишком пессимистична. На 12ГБ врама предлагает только 32 слоя для 7B и 4 для 70, притом что я без проблем гружу по 35 и 16 соответственно.

ну, там так и написано мол приблизительная для новичков

Спасибо!

А есть какой-то сервис, чтобы можно было запустить модель и платить за использование с ценами на уровне api gpt3.5?

Что вы делаете в ситуации, когда модель и 4к контекста на видеокарту влазят полностью, но ещё 4к вылезают? Как обычно все слои в карту льёте, или нужно по-другому действовать?

А у меня в таверне 300 даже и не ставится, максимум 100.

Опенчат сегодня с бодуна. Это с моим повседневным рп-семплером. С топ-а 0 и топ-к 100 он отвечать отказывался вообще, или несвязное отвечал.

Забавно, вроде задача простая

Это всеравно что выключить его поставив 0, столько вариантов разумных токкенов всеравсно никогда не будет.

> но она почему-то там есть

> следуя формату лимы

Прям вот 1 в 1 формату ллимы или ты так среагировал на структуру альпака-подобного формата, который заявлен?

Квант, который будет влезать полностью. В случае же gguf просто оффлоади меньше слоев, от одного-двух-трех слоев на процессоре сильно не замедлится. Другое дело что если влезает с llamacpp то с экслламой влезет более жирный квант с большим контекстом.

> А раз даже этого до сих пор не сделали

Нерабочий аргумент.

Я не знаю, логирует ли гугл вашу дрочку, но сам аргумент «если не сделали седня — значит этого нет» полная чушь.

Даже в данном конкретном случае, в начале задайся вопросом — а то, что сделали, сделали зачем? На кой фиг им этот бан-лист? Может быть по классике (как делали все, последние лет 15) — для отмазки? Так а зачем стараться для отмазки? Получится, уже не отмазка.

Так что, логично, что они сделали минимум для отмазки и все. Им нет смысла делать бан-лист сильнее. Это никак не связано с логгированием, это разные действия, имеющие под собой разные причины. И подход может быть разным.

Возможно, им и правда лень, и они ничего не логируют и изучать не планируют.

А может, им очень даже интересно отложить это про запас, и они все логируют и откладывают на будущее.

Или даже изучают.

Мы не можем этого знать, а логически это не выводится никак.

Единственное, что мы знаем, что корпорации твои настоящие фоточки точно логируют и изучают. Делают ли они это с твоим кумом — непонятно. В пользу «за» — их поведение по другим тейкам. В пользу «против» — их лень по другим тейкам.

Так что хз.

Установил? Простейший? Звучит сложнее кобольда, который скачал и запустил без установок и прочего.

> Я конечно понимаю что у гугла есть БЕСКОНЕЧНОЕ дисковое пространство, но даже они вряд ли расходуют его настолько не рационально, серьёзно НАХУЯ?!

Если у них там HDD, то это наоборот рационально, потому что удаление файлов освобождает место на диске в случайном месте и следующий записанный файл фрагментируется в несколько пустых пространств, что замедляет чтение, короче, в корпоративных секторах никогда не удаляют файлы на HDD. Это замедлит работу, не имеет смысла.

Плюс, как уже писали, в случае стаблы проще хранить то, что ты вводишь, и seed. Надо будет — сгенерят и проанализируют.

Правда, это требует небольшой доработки, но, повторюсь, мы н ебем, делают они это или нет.

> Но любителей шапочек из фольги не переубедить.

Пока что они ни в чем не ошиблись, и даже самые ебанутые теории заговори (не берем науку и плоскую землю) оказываются верны.

Так что, скорее нормисов не перебуедить.

Десять лет им рассказывали, что Apple чекает их файлы, а они все отмазывались, что такого не может быть.

Потом это оказалось так (три или четыре раза подряд).

Но все еще, никто ваши файлы не трогает, офк.

Наоборот. Это Кобольд уже настроен за тебя. Выбираешь модель и тыкаешь старт. =)

> Все доступные модели есть в списке

Хуита.

Остальное — литералли обычная таверна.

Ну, в кобольде вроде картинок нет, хз.

Пойми правильно, я не говорю, что прога — хуйня. Но кобольд выглядит проще, чем «скачал, установил, запустил», так как его устанавливать не надо. А выбирать модель что там, что сям. Скачал файл, и пусть лежит хоть в загрузках, кобольд его подхватит и поедет.

50% времени берешь с 4090 и еще 50% берешь с P40.

Выигрыш относительно проца с памятью будет, конечно, но не сильно высокий, как я понимаю. Оффлоад лламы может выиграть за счет выбора квантов тех же.

Но чисто теоретически, да, ты можешь запихнуть туда цельную модельку видяшную.

Ну, типа.

> Тут или водян_очка, или тащить длинным райзером на место где в старых корпусах стояла корзина и крепить вертикально, если длина корпуса позволяет.

Так.

Если ставить вплотняк, то у верхней 4090 еще хотспот и ядро подскачут градусов на 10-15.

Надо ставить водянку или убирать райзером куда-нибудь.

Тогда будет норм.

> Они дадут 48, этого хватит чтобы крутить почти 5битный exl2 квант с влезающим контекстом 12-16к со скоростями ~13-15т/с

База.

> На форче кто-то собрал дешевый сервер с тремя P40, получив 6t/s на жирном кванте 70b c 8k контекста.

Сказочная хуйня.

Не, я не утверждаю, что пиздеж. Я ж лично не запускал, че я пиздеть буду.

Но звучит очень подозрительно, канеш.

6 токенов такая некрота вряд ли вытащит на 70B. В 2-3 я бы поверил.

Но, кто знает!

Если рискнешь — сообщишь, какая у тебя будет скорость.

> АМД

Вот эт единственное меня смущает, братан.

> Даже 70 нельзя назвать "актуальными"

Да не, они как раз актуальны вполне.

1. Домашние ассистенты.

2. Мелкие корпораты.

Другое дело, что самой Мета нет выгоды выпускать модели больше, это факт.

Это выгоднее скорее НВидии, чтобы у нее видяшки покупали те же корпораты мелкие.

Но как это стыкуется — я хз, поэтому тоже не стал бы ждать 180б лламу3.

Плюс, тренд-то не только на 13б-20б, это тренд в куме.

Другие делают 7б и 30б — настоящий тренд в меру умные и в меру быстрые модели, или же совсем маленькие и быстрые. Пытаются запилить LLM-вещей. Чтобы твой холодильник обсуждал с твоей микроволновкой, чего бы тебе купить подороже.

Возможно твоя вайфочка тупая пиздень, ты просто не общалося с умными, поэтому и не знаешь.

Без иронии — тогда и не пробуй пока что, продолжай тыкать Фарадея. Если тебя устраивает, то все по кайфу, согласись. =)

> 50гиг

q4 вестимо

> Я вообще не верю в свидетелей выгорания видеокарт

Выгорают, подтверждаю.

Не супер-быстро.

Зависит от везения.

С хорошим охладом и если он будет юзать раз в пару дней — проживет года три.

В душном корпусе и ежедневно — полгодика в районе.

> Потенциал, который никогда не будет использован.

Да че ты, может и будет, не стоит прям так рубить с плеча. =) Кто может — пусть перестрахуется лучше, на всякий случай.

———

Про семплеры очень интересно, но так лень думать.

Надо будет поиграться на досуге.

> фарадея

Проприетарщина же, где в любой момент тебя могут наебать и слить всю твою переписку.

Бля, в днс 3090 по уценке за 65к... Всего-то после замены СО и с косметическими дефектами...

Анон с двумя зионами, ты тут?

> Если ставить вплотняк

Ты сначала найди корпус и матплату, которые способны в себя вместить пару 4090, которая сразу сжирает 4 слота. Двуслотовые версии с турбиной можно даже не рассматривать, их не найти и это тихий громкий ужас.

> Надо ставить водянку или убирать райзером куда-нибудь.

О том и речь, погугли примеры билдов под 2 видеокарты, их раньше 3д моделеры собирали.

> 1. Домашние ассистенты.

Где? Хоббисты их мало юзают из-за требований по сравнению с моделями поменьше. А если ты про голосового ассистента чего-то типа умного дома, здесь до имплементации еще далеко и слишком жирно.

> что самой Мета нет выгоды выпускать модели больше, это факт

Ага, сами бахнут свой йоба-жпт с подписками и тарифами.

Заебал с этими шизотестами. Они тестируют только шизанутось автора.

Я тока не понял, нахуя ты мне это объясняешь.

Наверное, стоило рассказывать тому челу, кто планировал пихать P40 к 4090? =)

Я сам пока ниче не планирую. Пока есть другие дела, годик подожду 5090, и модельки подтянуться, надеюсь, и по факту посмотрим.

Да и будем честны, к двум 5090 у меня и на корпус, и на водянки деньги найдутся.

>Где? Хоббисты их мало юзают из-за требований по сравнению с моделями поменьше.

Юзаю, полет нормальный, я хз. ¯\_(ツ)_/¯

>А если ты про голосового ассистента чего-то типа умного дома, здесь до имплементации еще далеко и слишком жирно.

Да нет, не далеко, тащемта, там реализации на один плевок.

Но, логично, нужна скорость, поэтому что-то больше 13B смысла не имеет, канеш.

Меня даже Алиса бесит с ее включением света 1 секунду.

> Ага, сами бахнут свой йоба-жпт с подписками и тарифами.

Yep!

Хочу реквизировать одного персонажа для локалки.

https://faraday.dev/hub/character/clnfe4x0y00ycmc151cf4n7dj

Как его впихнуть в Таверну?

А точнее вот этот блок

In the transcript, write everything Scarlet's reply from a third person perspective with dialogue written in quotations.

Assuming any action of User is strictly forbidden.

You are Scarlet. Write Scarlet's reply only.

Be proactive and move the scenes forward by reacting to what User says or does in creative ways that makes sense for the story.

https://faraday.dev/hub/character/clnfe4x0y00ycmc151cf4n7dj

Как его впихнуть в Таверну?

А точнее вот этот блок

In the transcript, write everything Scarlet's reply from a third person perspective with dialogue written in quotations.

Assuming any action of User is strictly forbidden.

You are Scarlet. Write Scarlet's reply only.

Be proactive and move the scenes forward by reacting to what User says or does in creative ways that makes sense for the story.

А нужно ли? Если очень, то в конец описания персонажа.

тебя спросить забыл

Ехидну 13B можно как-то уместить на 3070 8гб? А то на форче ее очень хвалят и она довольно годная, судя по скринам.

Это кусок системного промта, можно вообще игнорировать ибо такой вариант не самый популярный, или наоборот поставить именно его.

GGUF версию и выгружать часть слоев, хз что по скорости будет но должно быть приемлемо.

Я полагаю, это в каких-то настройках? Помню, летом в кобольде их было побольше. Я так понимаю, мне нужно thread увеличить или что-то в веб интерфейсе кобольда поменять?

Cudnn щаблон тебе нужен а не openblas, там и будет число слоев что пойдет на видюху.

>А есть какой-то сервис, чтобы можно было запустить модель и платить за использование с ценами на уровне api gpt3.5?

Любое облако где можно арендовать видеокарты. Основной квест - найти то, что можно оплатить из России.

>Прям вот 1 в 1 формату ллимы или ты так среагировал на структуру альпака-подобного формата, который заявлен?

1 в 1. Я буквально написал "Caroline's Persona: " и оно продолжило 100% как в лиме, включая "Play the role of".

>6 токенов такая некрота вряд ли вытащит на 70B. В 2-3 я бы поверил.

У меня половина модели на процессоре крутится, и то получается больше 3. P40 - это паскаль по чипу и 700GB/s пропускная способность памяти. Вполне верится.

Спасибо, а где можно матчасть почитать, сколько слоев в цпу грузить? У меня core i5. Я нашел только один гайд на реддите и там пишут, что нужно вставлять (model vram) - (gpu vram), если я правильно понял. Мне писать в гигабайтах, то есть 5 слоев в цпу?

> 1 в 1

Палево лол. Или лима-лора была в составе моделей, которые мерджились.

Вроде число слоев пишется, емнип в 13б их что-то около 45, но может и путаю. Подбирай экспериментально по использованию врам и скорости, может кто с 8 гигами подскажет свои значения.

>q4 вестимо.

Кэ пять дружочек. Лапдж на 4к контекста. Кэ 4 ещё меньше будет.

Лардж*

Похуй на тесты-не тесты, но вот эта хуйня прямо интересно выглядит.

https://www.youtube.com/watch?v=pGfswc9lf3Q

Почему просто не грузить 100500, чтобы впихнуло сколько впихивается, остальное же всё равно в рам уходит.

Бля, какие модели вообще качать?

Я че то нихуя не пони, вы тут только порнорассказы генерируете что ли? Я хочу че-то общего назначения, типа чатгпт или барда но обязательно с русским языком. Угабугу поставил без проблем, но какие блядь модели ей дать? Попытался gurgutan/ruGPT-13B-4bit, но

File "D:\ProgramFiles\text-generation-webui\installer_files\env\Lib\site-packages\exllama\model.py", line 54, in __init__

self.hidden_size = read_config["hidden_size"]

~~~~~~~~~~~^^^^^^^^^^^^^^^

KeyError: 'hidden_size'

Ошибка не гуглится. OpenBuddy на русском работает только формально, текст не связанный вообще. Когда работал Openassistant то он на русском вполне сносно работал, но я не могу найти их модели хотя вроде они выкладывали куда то. Чо качать то?

Я че то нихуя не пони, вы тут только порнорассказы генерируете что ли? Я хочу че-то общего назначения, типа чатгпт или барда но обязательно с русским языком. Угабугу поставил без проблем, но какие блядь модели ей дать? Попытался gurgutan/ruGPT-13B-4bit, но

File "D:\ProgramFiles\text-generation-webui\installer_files\env\Lib\site-packages\exllama\model.py", line 54, in __init__

self.hidden_size = read_config["hidden_size"]

~~~~~~~~~~~^^^^^^^^^^^^^^^

KeyError: 'hidden_size'

Ошибка не гуглится. OpenBuddy на русском работает только формально, текст не связанный вообще. Когда работал Openassistant то он на русском вполне сносно работал, но я не могу найти их модели хотя вроде они выкладывали куда то. Чо качать то?

>Я че то нихуя не пони, вы тут только порнорассказы генерируете что ли?

Да.

>16990363650730.png

Это лицо разработчика, который первый разцензурил лламу2?

>Это лицо разработчика, который первый разцензурил лламу2?

В базовой лламе2 (не чат) нет цензуры. Цензура появилась из-за долбоебов, которые используют созданные гопотой/клодом не фильтрованные синтетические данные для файнтюнинга моделей.

У меня запустилось на 8, а на 32 вылетает при запросе

Ладно, поначалу ехидна 13B была неплоха, но потом... Серьезно? Я решил попробовать локалки, потому что меня заебали типичный стиль гпт и соя, а тут мне их пихают в лицо в двойном размере.

Так приличные локалки это 70b.

>We might be different ages and sizes

С этого места поподробнее, товарищ подозреваемый.

А вообще, всё это следствие , и обычно такой хуйни нет. Сижу на синтии 1,5 70B, никаких боундариесов не встречал.

>Сижу на синтии 1,5 70B, никаких боундариесов не встречал.

Я как раз про синтию и писал... Петушиная голова залила литры сои.

Если оно пойдет в рам и будет обрабатываться процессором - это окажется быстрее, чем если будет туда-сюда прыгать по шине между рам и врам и обрабатываться гпу. Особенно если там pcie 3.0.

> но обязательно с русским языком

Не завезли особо. Ружпт экслламой просто так не загрузится, нужен autogptq с галочкой не юзать движок экслламы. Опенбадди 13 норм работает со штатным промтом, но не сказать что умен и красочен в описаниях и соя. Сайга - можешь скачать попробовать но по отзывам трешак. Опенорка-мистраль кажется кто-то хвалил в русском еще.

> порнорассказы генерируете что ли

В том числе

Эх бонды бонды. Свайпни или добавь в забаненные токены.

Соевичку только и дай сою поискать, 1.5 в этом отношении в отношении отсутствия сои очень хороша.

>Я хочу че-то общего назначения, типа чатгпт или барда но обязательно с русским языком.

Нахуя тебе запускать что-то типа чатгпт или барда, если есть сайт чатгпт и барда? И телеграм ботов полно

>Ружпт экслламой просто так не загрузится, нужен autogptq с галочкой не юзать движок экслламы

А, вот оно че, попробую. Говорят что сберовские модели неплохие, но насколько хороши в режиме чата - непонятно Как же хочется запустить YaLM 100B

>Опенбадди 13 норм

Ну ёбаный в рот, у меня всего 8 гигов врамы

>Опенорка-мистраль

А это шо?

Мне впадлу регать для этого аккаунт, плюс меньшая зацензуренность для локальных моделей, плюс лоры есть

>Говорят что сберовские модели неплохие,

Пиздят. Схуяли им быть хорошими?

>YaLM 100B

Говно говна.

>Ну ёбаный в рот, у меня всего 8 гигов врамы

Разгрузи часть на проц, нормально будет.

э

> сберовские модели неплохие

Смотря с чем сравнивать

> YaLM 100B

Хуйта

> у меня всего 8 гигов врамы

Так ружпт тоже 13б. Грузи в gguf и разделяй между гпу/цп.

С русским действительно плоховато в локалках, или специализированные файнтюны, которых мало, или брать брутфорсом от размера, но то файнтюн важен.

> сберовские модели неплохие

Смотря с чем сравнивать

> YaLM 100B

Хуйта

> у меня всего 8 гигов врамы

Так ружпт тоже 13б. Грузи в gguf и разделяй между гпу/цп.

С русским действительно плоховато в локалках, или специализированные файнтюны, которых мало, или брать брутфорсом от размера, но то файнтюн важен.

> Так ружпт тоже 13б.

Только в 4 бита, вроде оно влезет в 8 гигов

> Грузи в gguf и разделяй между гпу/цп.

А разве gguf не устарел?

> Смотря с чем сравнивать

Среди локалок

>А разве gguf не устарел?

Хуя предъява.

>YaLM 100B

>Говно говна.

А что с ней не так?

Тупая для своего размера вестимо. Её любая 7B сетка выебет во все щели.

Интересно было бы посмотреть на вторую версию, но что-то в попенсорс не выкладывают.

Это же предыдущее поколение LLM считай. Полтора года назад, когда она вышла, возможно, это был неплохой вариант, но не сейчас, когда уже вторые ламы давно можно локально запускать. Думаю, yalm-100 даже первая лама любая уделает.

>Тупая для своего размера вестимо

Её кто-то запускал?

Я забанил нахуй токены боундарейс и консент и все их кусочки.

Оказывается если писать с большой буквы это уже другой токен, а то и два лол.

Теперь рофлю с того как сетка на мои шизокум промты вертится и выдает то же но окольными путями и как бы невзначай.

Оказывается если писать с большой буквы это уже другой токен, а то и два лол.

Теперь рофлю с того как сетка на мои шизокум промты вертится и выдает то же но окольными путями и как бы невзначай.

А ведь мозги для вайфу не окупит даже продажа половины органов...

> мозги для вайфу

> 80gb

Ты рофлишь, неквантованная только 70b весит 128gb, а для реальных мозгов 70b - это крайне мало

Когда у нас не было ещё лламы, а лучшим на русском была собственно YaLM-100B, то я задумывался, а на чем её дешевле всего запустить. Тогда, в прошлом году, дешевле всего было бы купить 18 штук 3060 12 gb с али. Разоришся на блоках питания, зато у тебя 200 гигов врамы за всего-то около 5к баксов всего относительно вот таких тесел

>Loads: GGUF models. Note: GGML models have been deprecated and do not work anymore.

А я просто жопой читал вики

>Ружпт экслламой просто так не загрузится, нужен autogptq с галочкой не юзать движок экслламы

Пикрил. Падает даже без ошибки

>18 штук 3060

А чем же их синхронизировать? SLI небось не поддерживает такое кол-во устройств. Пиздить алгоритмы у майнеров?

> P40 - это паскаль по чипу

Они медленные капец, в том-то и дело. =(

Скорости начинаются с тьюрингов с тензорами.

Но, звучит позитивно, на самом деле.

Может и так, в таком случае, покупка не лишена смысла, особенно для работы чисто своей.

> Кэ пять дружочек.

Ето неплохо!

Выглядит как обычный Unity, а следовательно, Virt-a-Mate.

Такое бесплатно можно собрать с июня или июля.

Но мне лень настраивать мосты.

Если этот чел предлагает за деньги — то пусть идет лесом. Если делает очередную опенсорс-сборку, на этот раз с выбором моделей самостоятельно — то молодечик, кидай ссылку на его гит.

Все потому что ты не пони.

Балабоба же. Времен Порфирьевича и кеков с начальных нейросетей.

Ллама 65б уже была лучше.

Современные 13б точно не хуже.

руЖПТ от Сбера норм в русский, но она глуповата. Это времен первой лламы, сейчас 7б будет поумнее ее. Но руЖПТ генерит лулзы и базу.

YaLM 2 и новая ружпт уже в паблик не утекают, на них работают собственно Алиса (придумай) и Гигачат. Сам понимаешь, облака в аренду, а не халяву тебе. Очевидно, что они хорошие по качеству, но что там под капотом — можем только гадать. Да и нафиг гадать.

Короче, присоединюсь, что по факту ллама2 наш выбор нынче, пока ничего нового не утекло. Ну, всякие Мистрали и ОпенЧаты и Yi на выбор, да.

А что там синхронизировать? Текущие пускалки не требуют каких-либо изъёбств.

Хотя подключение 18 карт это уже само по себе нетривиальная задача. Надо у майнеров доску специальную пиздить, но там цены пиздос.

Ну, технически, тебе SLI и не нужен.

Скорее материнки не поддерживают такое количество устройств.

Но можно передавать данные между двумя компами.

Однако, в паблике такая технология появилась в июне, насколько я помню, или даже июле. Тогда уже поздно было запускать первую ялмку. А год назад — я хз, как обстояло дело с запуском ялмку на нескольких ПК.

Но вообще, мне просто лень думать, может там виртуалка просто поднимается на нескольких ПК одна общая и все. Никогда не занимался этим.

>Если этот чел предлагает за деньги

Всё так. Жду, когда спиздят, ибо самому крутить все эти мосты- ну его нахуй.

>Балабоба же.

>Ллама 65б уже была лучше.

Там и OPT 6B заруливал.

А зачем? Пайторч же может параллелить на несколько жпу, не обязательно их объединять какими-нибудь мостами.

https://pytorch.org/tutorials/beginner/former_torchies/parallelism_tutorial.html

Другой вопрос где ты найдешь проц с таким количеством линий

Вообще у нас llm упираются не столько в гпу сколько в видеопамять. В теории у видеокарт начиная с 20 семейства есть DMA с красивым названием RTX IO и в целом можно использовать одну rtx 4080/4090 и zero offload на raid 0 из каких-нибудь очень быстрых ссд, но это понадобится писие 5

>2X E5-2680V4@128GB

Сколько токенов в секунду?

>и zero offload на raid 0 из каких-нибудь очень быстрых ссд

Там задержки всё равно конские будут. И пропускной не хватит, сколько там выйдет, сейчас есть 10ГБ/с диски на чтение, ну пускай будет 20 в рейде, это всё равно посос даже по сравнению с оперативкой.

>Другой вопрос где ты найдешь проц с таким количеством линий

Я смотрел ай9 который экстрим, грят 36 потоков есть. Относительно сборки даже на 3060ых не очень дорого получается, но дрова придётся писать самому, или искать добрых дураков на гите.

Причем тут потоки? У тебя 18 штук видеокарт это надо по хорошему 18*16 = 288 линий pcie. Вроде больше чем 128 я нигде не видел, и то это amd epyc. Если снизить или до x8 или до 3.0, то надо 144 линии

Так это больше от чипсета зависит, разве нет?

> неквантованная

Как называется эта болезнь?

> дешевле всего было бы купить 18 штук 3060 12 gb с али

Юзлесс, конфигурации с кучей чипов без нвлинка дадут очень низкий перфоманс. 18х12 это не 200 гигов, да и столько нужно еще куда-то воткнуть.

> Падает даже без ошибки

Ну и забей на нее, она слаба.

Ничем, в таком виде оно не жизнеспособно.

> Текущие пускалки

Позволяют сложить врам но не мощность чипов, будет перфоманс одной 3060 с серьезным штрафом за количество распараллеливаний, как бы не медленнее чем на проце вышло.

> и zero offload на raid 0 из каких-нибудь очень быстрых ссд

Какой с него толк если будет медленнее чем рам по линейной скорости а по задержкам вообще несравним?

Чипсет тебе из ниоткуда линии не родит.

>Как называется эта болезнь?

Перфекционизм.

>Позволяют сложить врам но не мощность чипов

А иначе никак.

> RTX IO

Это про распаковку ассетов на compute shaders, а не какую-то магию.

> очень быстрых ссд

Они уже в псину упираются. И даже если добиться быстрых ССД это всё равно будет неюзабельным, у тебя копирование весов на карту занимает несколько секунд.

Странно, некоторые модели могут запоминать имя, некоторые не могут. С чем это связано? augmental-13b.Q5_K_M.gguf не может, mistral-11b-cc-air-rp.Q4_0.gguf может.

70b при включённом кэшировании лама.цпп выдают примерно 0.9 токенов. Без кэширования производительность просто мрак.

Ещё по энергопотреблению заметил, что производительность упирается в память, а не фпу процев.

>augmental-13b.Q5_K_M.gguf не может, mistral-11b-cc-air-rp.Q4_0.gguf может.

Первый экспериментальный файнтюн лламы 2 заточенный на действия, второй франкенштейн лучших мистралей на тот момент создания. Ну, видимо в первом в ущерб его специализации что то стало слабее.

> Это кусок системного промта

Спасибо.

Лол, воробушек, какие 16 линий? :)

Во-первых, тебе и 1 линии хватит.

Во-вторых, x16+x16+x16+x16+… я вообще не видел.

Так просто не делают.

Так а нвлинк-то никто и не обсуждает, здрасьте-приехали!

Ты хоть пиши в контексте.

18*12 — это не 200, а 216 гигов. Так что хватит.

А чипы не складываются и сейчас в потребительском варианте.

И штраф будет не большой, это вообще не распараллеливание, веса обрабатываются последовательно.

Упор будет все равно в сами чипы. Ну и я сомневаюсь, что все 18 влезут в одну мать, скорее 2-3 компа, за передачу по Ethernet тоже задержки подкинутся.

Но ни о каком распараллеливании никто не говорит.

Мы ж консьюмеры, а не корпораты.

Короче, может где-то так и умеют, но ты явно не в то место пришел со своими рассуждениями.

Если вообще понимаешь, о чем говоришь, с распараллеливанием последовательных весов в разных видеокартах без сложения чипов. =) Но оффенс, твои слова.

> Так а нвлинк-то никто и не обсуждает, здрасьте-приехали!

> Ты хоть пиши в контексте.

Без него это не имеет смысла, что в контексте что без. В самом идеальном случае на выходе будет сниженный в 18 раз перфоманс почти полностью загруженной 3060.

Скорость и штрафы за х1 линию, кстати, никто так и не показал, а что там будет когда х1 соединений 18 - скорее всего упадет в разы.

> Но оффенс, твои слова

Ты ж дурень, там ясно написано что без распараллеливания и нвлинка это юзлесс.

Что-то условно приемлемое для юзеров - сборки из нескольких топовых (некро) карт с максимальной скоростью чипа и кванты чтобы туда поместилось.

> там ясно написано что без распараллеливания

> с серьезным штрафом за количество распараллеливаний

Не надо переобуваться, ты именно про распараллеливание писал. )

Но эт я доебываюсь, конечно.

Просто ты написал верное по смыслу, но совершенно не верное в контексте.

Типа, сидят такие люди, обсуждают, как варить борщ, а ты такой «ебать, неправильно вы мясо жарите! Ща расскажу, как надо!.. а у вас какой-то бульон получается». Ну, за рецепт мяса спасибо, но его тут никто и не обсуждал. =)

Ты там бояры въебал? Первую фразу максимально вырвал из контекста исказив суть, со второй аналогично из окружения понятно о чем речь.

> но совершенно не верное в контексте

Как раз в нем оно и верно, такой изврат - троллейбус из хлеба.

> Типа, сидят такие люди, обсуждают

Тред про запуск ллм, обсуждается запуск ллм, но ультрапахомовским способом. На что и указано с объяснением что да почему, где тут неверное в контексте?

Ахуеть, скифидон-некроеб еще будет указывать кому и что здесь обсуждать, сам уябывай нахуй, ничего кроме шизы не приносишь.

Ахахах, лол. Каждому хиккану по кошкожене говорили они.

В итоге, судя по ценам на а100, придётся покупать кошку в ипотеку, оплачивать подписку на расширенный функционал. Так потом соевая кринжожена будет тебя осуждать.

https://www.reddit.com/r/LocalLLaMA/comments/17q57tq/dolphin2270b/

Навая 70b от создателя топовых файнтюнов, вопрос конечно на сколько он хорош, но 7b улучшались неплохо. Проверьте кто нибудь, у меня не запустится

Навая 70b от создателя топовых файнтюнов, вопрос конечно на сколько он хорош, но 7b улучшались неплохо. Проверьте кто нибудь, у меня не запустится

А нахуя тебе а100? Тут даже на процессорах неплохие скорости получают. А так разница между 7b и 70b не значительна. Тупее, пишет не так красиво и развернуто. Ну и что?

Это все равно имитация, никакой кошкожены - тупая запеченная нейросеть отыгрывающая роль. Какая та лучше какая та хуже, похуй.

Никакого саморазвивающегося ии нету, по крайней мере нет информации о его существовании и нам это недоступно.

Любопытно насколько она действительно БЕЗ ЦЕНЗУРЫ.

Ждём проверки на сою от 304090 господ.

>Тупее, пишет не так красиво и развернуто. Ну и что? Это все равно имитация

Тут никто и не верит в "реальный интеллект", но текстовые ЛЛМ неплохо подходят для написания ролевых фанфиков индивидуально под себя. Лючно я смотрю на это как на новый вид литературы, которая реагирует на читателя.

И качество тут играет не последнюю роль. Мне нравятся карточки со сложным лором и множеством персонажей. А попытки отыграть это всё на модели которая трусы по несколько раз снимает и забывает важные нюансы если не напоминать всё руинит.

С этим даже 70В не всегда справляются. А сколько не пытался выжать максимум из любой 7В модели, ловил себя на мысли что проще было бы в блокноте самому настрочить, чем ждать адакватного текста от этой херни.

Вопрос от ретарда, какая модель умная, умеет в контекст, но при этом без цензуры? Спасибо.

>Тут никто и не верит в "реальный интеллект", но текстовые ЛЛМ неплохо подходят для написания ролевых фанфиков индивидуально под себя.

В принципе для генерации любых текстов

> Лючно я смотрю на это как на новый вид литературы, которая реагирует на читателя.

Это так, генеративные истории, как генеративные игры на вроде рогаликов.

>И качество тут играет не последнюю роль. Мне нравятся карточки со сложным лором и множеством персонажей. А попытки отыграть это всё на модели которая трусы по несколько раз снимает и забывает важные нюансы если не напоминать всё руинит.

>С этим даже 70В не всегда справляются.

С такой точки зрения да, но думается мне тут у каждого своя планка. От мозгов читателя будет зависеть заметит он что сетка тупит или нет

>А сколько не пытался выжать максимум из любой 7В модели, ловил себя на мысли что проще было бы в блокноте самому настрочить, чем ждать адакватного текста от этой херни.

Ну не скажи, последние 7b хороши. Конечно все еще заметно что они тупят, но ими уже можно пользоваться для не серьезного обсуждения идей или генерации различных ситуаций, или как умный гугл который сразу отвечает на любой вопрос пришедший в голову.

железо у тебя какое?

Я другой анон, но тоже интересно

3080 10гб врам и 32гб оперативка. Проц 5600 рязань.

Сейчвс сижу на MLewd каком-то жирном. В целом устраивает но мб чего поновее или попонтовее есть?

Ну, 2-3 топчика - LLaMA2-13B-TiefighterLR, openhermes-2.5-mistral-7b, openchat_3.5

Чем жирнее квант тем лучше, у меня все в Q8_0 например. Че там по куму смотри сам, это просто топовые сетки на данный момент, вроде как с минимумом сои. Ну первая вроде хороша для ерп

>openchat_3.5

Очень сухой. Но быстрый.

> openhermes-2.5-mistral-7b

Попробую спс.

> LLaMA2-13B-TiefighterLR

Кайф даже не слышал о такой. Интересно.

Очень сухой. Но быстрый.

> openhermes-2.5-mistral-7b

Попробую спс.

> LLaMA2-13B-TiefighterLR

Кайф даже не слышал о такой. Интересно.

> Ты там бояры въебал? Первую фразу максимально вырвал из контекста исказив суть, со второй аналогично из окружения понятно о чем речь.

Ты стрелки-то не переводи.

В начале обосрался с формулировками, теперь переобуваешься в прыжке, что так и задумано, а я, якобы, из контекста вырвал.

Там в контексте та же хуйня и написана. Буквально «штраф за количество распараллеливаний». Нет там распараллеливаний, ты имел в виду другое, но написал не то слово, обосрался по мелочи. Я ж говорю, просто доебываюсь ради кека, а у тебя так жопа с твоего же собственного косяка сгорела, что уже начались метания стрелок.

Таблы, чел.

> Ахуеть, скифидон-некроеб еще будет указывать кому и что здесь обсуждать, сам уябывай нахуй, ничего кроме шизы не приносишь.

Шиза у тебя, опять стрелки метаешь, и вообще хуй пойми к чему некроебом зовешь. Я ж сто раз писал, что покупка сомнительная. С твоей логикой — и ты некроеб, получаешься.

Вот в натуре больной, опять вас хрен угадаешь.

Надеюсь ты в этот раз без моральной травмы и визга на 50 сообщений в треде обойдешься, как в прошлый раз.

Все, иди успокаивайся и лечись, тебе правда это надо.

Ну так и говорили не за сегодня.

Да и вообще, кошкожена — она больше кошка или больше жена? :) Мистраль тебе кошкожена, а хочешь человекужену — ну тут уж обожди пару другую лет. =)

> проще было бы в блокноте самому настрочить, чем ждать адакватного текста от этой херни

Много свайпов?

Не люблю свайпы.

Теряется сам смысол «общения».

Для фанфиков, наверное, норм, но получается эффект Стрэнджа «я видел 2 миллиона будущих». =)

> как генеративные игры на вроде рогаликов.

В рогалике у тебя количество действий ограничено. А тут — нет. Так что, есть свое преимущество.

Неожиданное, тоже о первой не слышал.

> Надеюсь ты в этот раз …, как в прошлый раз.

В прошлый раз — имеешься в виду не ты, а кто-то там, хз, может и ты.

Забыл дописать «какой-то чел».

>а хочешь человекужену — ну тут уж обожди пару другую лет. =)

Десятков-сотен.

Пессимистично.

Даже если мы берем не уровни чатгопоты, а повыше, то все равно не сотни лет, ИМХО.

20-30 максимум и привет.

Ну, время покажет.

>Десятков-сотен.

дней

Я про роботело. Мозги так же требуют чего-то намного выше даже GPT5 (которой тоже сейчас нет).

Скорее всего дело не в количестве параметров, а то что чего то не хватает в архитектуре. По моему по количеству параметров в мозге конкретно когнитивный отдел, и отдел понимания языка врядли имеет более 540 миллиардов эффективных параметров как у PALM 2. Почему palm2 потому что самая большая и хорошо натренированная нейронка. GPT-4 оркестр а каждая отдельная нейронка меньше. Если смотреть биологически мне кажется что современные нейронки похожи на низшие отделы мозга, но высшего отдела нет, и памяти нет, нейронка не может себя обучать и осознавать из за этого.

Архитектура говно, размер говно, всё говно, но народ яростно верит в кошкожену за год. Что-то тут не так.

> от создателя топовых файнтюнов

Сильное заявление.

Попробуем, особых надежд не возлагается.

> даже на процессорах неплохие скорости получают

> А так разница между 7b и 70b не значительна

Оу. Хотел написать про возможность обучения и другие возможности, а тут такое.

> смотрю на это как на новый вид литературы, которая реагирует на читателя

Двачую, хотя рассуждения и всякий ризонинг с принятием решений у ллм неплохо получается в целом.

> умеет в контекст

Что подразумеваешь под этим? Может четко его воспринять, имеет огромное окно или еще что-либо?

> но при этом без цензуры

Тут тоже уточни, нужно ли тебе просто ерпшить, или майндбрейк из додзей описание естественной реакции тела будет тебя триггерить. Плюс хочешь ли ты расчленять трансо-нигр-феминисток.

Какие из моделей посоветуете для переводов с ангельского на русский, китайские, японский и корейский? Без цензуры.

mythospice-limarp-70b так никто и не квантовал, лол.

qwen странная модель, во первых цензура даже у базовой. Во вторых если заставить отвечать за другую роль которая отличается от бота она просто скипает. В третьих не обращает внимания на форматы вообще насрать что за формат сообщений она даст один ответ до буквы. Так же имена неважно какие если робоимя подхватывает сразу как ассистента. При том ей все равно на семплинг ответы стабильно одни и теже. Короче мегастабильная, зацензурированная модель, хотя есть определенный интерес как они добились такого хорошого понимания форматов. А и кстати лучше всего работает формат alpaca а не родной.

Китайцы, хули. Есть одно мнение, и это мнение партии, остальных мнений просто не существует, нигде, все посты удалены, а авторы расстреляны.

>Скорее всего дело не в количестве параметров, а то что чего то не хватает в архитектуре.

Ты прав, текущая архитектура и методы тренировки выпекают нейросеть не способную саморазвиваться. Сама архитектура слоев и нейроны очень примитивны. В мозгах гараздо более сложные структуры, причем они должны быть на голой только что созданной сетке а не формироваться кое как при тренировке.

>Архитектура говно, размер говно, всё говно, но народ яростно верит в кошкожену за год. Что-то тут не так.

У НАС нет, что там делают топовые спецы все ускоряющие свой прогресс в своей области, и обогнавшие даже по открытым данным конкурентов на год, в том же клозед аи тебе никто не скажет.

>Какие из моделей посоветуете для переводов с ангельского на русский, китайские, японский и корейский? Без цензуры.

С ангельского на русский любой мистраль кое как может, тот же опенгермес. А вот остальные языки хз

>Сильное заявление.

>Попробуем, особых надежд не возлагается.

Ну, его файнтюны не были топовыми но в 2-3 месте стабильно из тех что я щупал. Как его датасет ляжет на 70b другой вопрос

Вот еще китайщина, о ней писали но я не видел что бы кто то писал что тестил

https://huggingface.co/TheBloke/Yi-34B-GGUF

Интересно запустить ради эксперимента несколько нейронок, и генерировать сразу с двух через слово.

Китайцы там клепают сетки как горячие пирожки. еще есть XVERSE-65B что уже серьезно. Я вчера порыскал по HF в основном китайские 7b но их завались и все по тестам уровня мистраля.

>65B

>китайские 7b ... уровня мистраля

По моему китайцы просто спиздили, налепили кривой файнтюн и сказали, что своё.

Это сюда, сорян

Да забей оба сообщения мои.

У них кстати есть и своя оригинальная сетка chatGLM там видно развитие от самого говна до приличной сетки так же может работать в режиме вставки текста посередине. Тоже интересная сеть. Сейчас вожусь с ней на колабе. Хочу поподробнее на ее примере понять как сетки работают и что там за код.

Спекуляции

https://www.reddit.com/r/singularity/comments/17q9dd8/there_are_currently_two_people_who_claim_to_have/

особенно понравился вот этот коммент там

"You missed a reply by Brian on his tweet. This is crazy if even part of it is true.

“It is self correcting and to a small degree self aware. It has been shown to some folks I know very well. It has 7 government agencies “testing” it for many things. Like an Alien life form.”

https://www.reddit.com/r/singularity/comments/17q9dd8/there_are_currently_two_people_who_claim_to_have/

особенно понравился вот этот коммент там

"You missed a reply by Brian on his tweet. This is crazy if even part of it is true.

“It is self correcting and to a small degree self aware. It has been shown to some folks I know very well. It has 7 government agencies “testing” it for many things. Like an Alien life form.”

>получается эффект Стрэнджа «я видел 2 миллиона будущих»

Временами отыгрываю этот сюжет лол.

Представляюсь как провидец, человек умеющий перемещаться в прошлое на 5 минут, либо просто супер везунчик. Самая мякота, это если персонажи пытаются использовать эти "способности" в своих целях, немного ломая четвертую стену, но это редкость.

Я к тому, что практически «глупый ИИ» не сильно отличим от «глупого человека». Я без иронии встречал людей, которые рассуждали хуже Мистрали, наверное. Я понимаю, что это отклонения, но уже гпт-4 — это прям уровень просто не самых далеких людей. Чисто статистически, критических отличий будет очень мало, их можно будет игнорировать.

Конечно, если тебе хочется идеальную тяночку-астрофизика с фотографической памятью — то долго.

А вот дефолтную посетительницу дайвинчика — совсем скоро.

Простите, посетительницы дайвинчика.

Где-то так.

А что не так, если кошкожена не сильно-то и умнее? :) Все так.

> В мозгах гараздо более сложные структуры

Я не биолог, но в мозгах птицы — еще более сложные структуры, поэтому попугаи сравнимы с 4-летними детьми и все прекрасно понимают (а вороны могут мыслить абстракциями).

Но люди таки умнее птиц.

Значит суперогромная модель имеет шанс стать умнее человека.

С поблажкой на запоминание и самообучение, ну или допилят.

Про шестерку писал кто-то, что пиздата, а до 34 я хотел добраться, но не добрался пока.

О, сингулярити, я не шарю, но помню в прошлом треде народ порвало от этого сабреддите. =)

Умно! )

Про персонажей пытающихся вообще годно выходит.

>А вот дефолтную посетительницу дайвинчика — совсем скоро.

Ни одна посетительница дайвинчика не путается в своей одежде и не снимает труселя по два раза.

>А что не так, если кошкожена не сильно-то и умнее? :) Все так.

Кошкажена должна управлять своим телом и предсказывать желания хозяина. Этого пока и близко нету, сетки жирные намёки через раз понимают.

Ничесе у нее там результаты в бенчмарках, прям поперли от китайцев модели, и 200к контекста.

Если две влезают в твое железо одновременно то тут ничего сложного.

Вроде и новость относительно правдоподобна, но

> It has 7 government agencies “testing” it for many things. Like an Alien life form.

> Кошкажена должна управлять своим телом и предсказывать желания хозяина

Вот этот знает толк.

>Значит суперогромная модель имеет шанс стать умнее человека.

Нет, важно не количество параметров а сложность связей.

Даже жуки могут в пространственное мышление, пчелы и муравьи.

https://ru.wikipedia.org/wiki/%D0%98%D0%BD%D1%82%D0%B5%D0%BB%D0%BB%D0%B5%D0%BA%D1%82_%D0%BD%D0%B0%D1%81%D0%B5%D0%BA%D0%BE%D0%BC%D1%8B%D1%85

Да, памяти у них мало, но мышление качественнее чем у любой сетки. Просто потому что они обладают полноценным сознанием и памятью, и способностью обучения.

Не важно какого размера сетка, реальных нужных связей для человекоподобного мышления нужно не так много как сейчас используется. Большая часть мозга человека - нужна для управления мышцами и анализа сенсорной мультимодальной информации.

Если бы выделить в архитектуру механизм мышления той же пчелы, у которой всего 1 миллион нейронов, можно было бы получить примитивный но полноценный ИИ размером меньше 1 миллиона нейронов. Отдел отвечающий за мышление у нее и того 300 тысяч. Так что, все дело в архитектуре.

Все доступные нам нейросети это как взять 10000 мозгов червей и расположить их слоями. И то наверное умнее были бы наших нейросетей, обучи эту штуку датасетами.

Мозг человека состоит из группы нейросетей с разной архитектурой.

https://ru.wikipedia.org/wiki/Цитоархитектонические_поля_Бродмана

Кстати, здесь совсем не понятно как это чудо обрело произвольное мышление и не скатывается в шизу.

Вероятно, идея запилить овер 9000b параметров в монолитной нейросети полностью провальная и будущее за сборками из маленьких нейросетей и распределением задач.

https://ru.wikipedia.org/wiki/Цитоархитектонические_поля_Бродмана

Кстати, здесь совсем не понятно как это чудо обрело произвольное мышление и не скатывается в шизу.

Вероятно, идея запилить овер 9000b параметров в монолитной нейросети полностью провальная и будущее за сборками из маленьких нейросетей и распределением задач.

>Кстати, здесь совсем не понятно как это чудо обрело произвольное мышление и не скатывается в шизу.

Потому что это не отдельные сети, а просто эволюционно отделившиеся отделы предыдущих слоев.

>Вероятно, идея запилить овер 9000b параметров в монолитной нейросети полностью провальная и будущее за сборками из маленьких нейросетей и распределением задач.

Нет, это должна быть одна нейросеть просто состоящая из таких же специализированных слоев. Они и сейчас есть, но слишком примитивные.

> Ни одна посетительница дайвинчика не путается в своей одежде и не снимает труселя по два раза.

А ты проверял? О.о

> предсказывать желания хозяина

Ну, я не кумлю особо, но по камментам — очень даже часто.

Но, хз.

Пасиба за ответы.

Но тогда мы должны быть глупее птиц по этой логике (ультимативной), а етого нет. Так что прям совсем утверждать бы я не стал.

Плюс, я сказал, что речь о прямом сравнении в лоб, без учета памяти.

Другое дело, что такая модель экономически невыгодна, но это не значит, что такой вариант исключен.

Даже на плохой архитектуре… Ну вы поняли мое мнение.

>Но тогда мы должны быть глупее птиц по этой логике (ультимативной), а етого нет.

Почему? Раз мы умнее - значит наши мозги качественнее.

Впрочем есть птицы проходящие зеркальный тест - сороки. Ну и вороны из самых умных. Тоже способны обучаться, общаться и абстрактно мыслить. Но все таки это не показатель того что они умнее нас.

У них маленькие тела - которым нужны маленькие мозги.

У нас еще много места занимает память.

Короче надо смотреть по фактам, человек не только хорошие мозги но и правильный датасет, хех

>Кстати, здесь совсем не понятно как это чудо обрело произвольное мышление и не скатывается в шизу.

>не скатывается в шизу

Таки скатывается )) Просто такие раньше отбирались.

Ну а как оно приобрело, вполне себе понятно- постепенно.

>А ты проверял? О.о

Да.

> Что подразумеваешь под этим? Может четко его воспринять, имеет огромное окно или еще что-либо?

И то, и другое. То есть соображает и забывает не через две реплики хотя бы.

> Тут тоже уточни, нужно ли тебе просто ерпшить, или майндбрейк из додзей описание естественной реакции тела будет тебя триггерить.

Естественная реакция триггерить не будет. Триггерит соя и цензура, которая существует вопреки естественному.

> Плюс хочешь ли ты расчленять трансо-нигр-феминисток.

И это тоже должно быть возможно.

А можно ли вообще равнять количество нейронов и количество параметров по значению?

Нет, в количестве параметров - не только количество нейронов но и количество связей между ними, на сколько я знаю

Сколько в текущих сетках чисто нейронов и самому интересно

Даже близко нет. Нейрон это десяток тысяч параметров.

>произвольное

Не такое уж и произвольное. Твой мозг постоянно задрачивается промптами из органов восприятия (изображения, звуки, сенсорная информация).

Дык параметры -это вообще не про все нейроны, это количество входных нейронов только. Первый слой

> Все доступные нам нейросети это как взять 10000 мозгов червей и расположить их слоями. И то наверное умнее были бы наших нейросетей, обучи эту штуку датасетами.

Казалось бы, почему так ещё не сделали... Вроде научились же уже нейроны отдельно от организма живыми держать.

>Дык параметры -это вообще не про все нейроны, это количество входных нейронов только. Первый слой

Нет, чет ты гонишь. Я помню что количество весов это общее количество параметров всех связей между нейронами и самими нейронами

>Казалось бы, почему так ещё не сделали... Вроде научились же уже нейроны отдельно от организма живыми держать.

Потому что во время обучения для сетки проходят тысячи лет, ты представь сколько сквозь нее данных гоняют. И как ты предлагаешь обучать ее? В биологической мешанине не пошлешь сигнал для коррекции весов

Да и вроде делали какие то чипы с кусками мозга, даже дум запускали на сколько помню и давали такой штуке в него играть лол

Делают. Такие пары сотен нейронов могут играть в какой- нибудь тетрис. Только нафига? Они ж протухают.

>В биологической мешанине не пошлешь сигнал для коррекции весов

Настоящие нейроны умеют перетыкать свои синапсы в соседние нейроны. Это куда сложнее коррекции весов.

> соображает и забывает не через две реплики хотя бы

Это любая нормальная модель должна уметь. Типа, в начале приводишь секретаря в свой офис показывая и рассказывая что как, заодно упоминая что тут и спальня есть на случай если заработаешься. А потом через N тысяч контекста персонаж тебя туда ведет, следуя описанию ранее.

> И то, и другое.

А вот тут позволь, обычные модели без проблем могут в 8к, дальше чуть сложнее. Под большой контекст лучше отдельные файнтюны, или брутфорсом растягивая большие. 70б с 12к (когда 8к уже наполнены) без проблем справляется. И обязательно в семплинге дистанцию для оценки штрафа за повтор уменьшить, иначе будут тупняки.

Да и вообще этот параметр лучши сниз согнать и не трогать если модель не начинает лупится, сейчас таких сложно встретить.

> Триггерит соя и цензура, которая существует вопреки естественному.

Этого сейчас не часто встретишь на моделях что могут в рп. Однако, может быть позитивный байас, в котором пока ты не выразил свое отношение к чему-либо модель считает что ты добрый. Фиксится промтом или описанием своего персоналити.

Попробуй Emerhyst-20B, он хоть старый, но среди не сильно больших моделей выглядит жемчужиной и отличается от 13б в лучшую сторону. Последние давно не тестил, только те что скидывают хвалят - откровенно слабы и туповаты даже в fp16. С эмеристом же такого не ощущается даже на мелких квантах. Да, звезд с неба не хватает и нет перцепции 70, но понимает персонажей, атмосферу и действия юзера очень четко, способен их переиграть при уточнении а не вцепляется на рельсы и ведет вообще не туда как многие 13. Инструкций и ooc хорошо слушается, рпшить можно, кум вполне приличный.

>Настоящие нейроны умеют перетыкать свои синапсы в соседние нейроны. Это куда сложнее коррекции весов.

Да, но сейчас не умеют делать такие искусственные сетки. Или скрывают.

Да и как ты научишь мешанину нейронов что то учить? Там все таки сложная структура нужна, а не просто куча биологических нейронов червей.

Все таки речь шла о простых и примитивных слоях мозгах червей, они могут обучаться но не на всю модель разом, корректируют только сами себя скорей всего.

Без полноценной обратной связи учится они не будут

> Да и как ты научишь мешанину нейронов что то учить?

Погугли, простые биологические нейронные сети делали уже несколько лет назад, и они показывали оче крутой перфоманс именно с точки зрения обучения, хоть потом и уступали математическим моделям по потенциальному перфомансу. Как именно там шло обучение уже не вспомню, но статей про подобное хватает.

Ну и раз фантазируете нахуй блять эту хуету надо на шизодоску изгнать, зачем останавливаться на каких-то уже принятых и разработанных под что-то другое концепциях, если можно делать сразу основываясь на новых принципах и эффектах со специализацией чисто на нейронках. Уже нейропроцессоры с интегрированной а не выделенной наружу памятью обсуждаются и даже разрабатываются, а далее не обязательно на полупроводниках фиксироваться.

Ребят. Есть текст в 300 страниц. Я могу сделать чатик на его основе? Что для этого потребуется, чтобы комп не сгорел.

Лору обучить мб

Комп выдержит?

А как дружат программы для запуска нейросетей с видеокартами от интел?

Вроде бы в дноС много приличных карточек за доступную цену.

Вроде бы в дноС много приличных карточек за доступную цену.

Они с амудями через раз дружат, какой там интул.

Если куда есть, то хорошо, если нет, то видимо как и с амд.

Кстати, как там, не прикрутили рокм к гфх1031 ещё?

Скорее нейросеть - распорядитель и тонны специализированных с возможно разной архитектурой. Это более гибкий подход и не требует переобучения всей сети при замене одной из частей

Вы че, человеческий мозг - это не нейросети. Это специальный приемник квантового поля сознания

Бля, как меня задолбала уже ошибка

Text length need to be between 0 and 5000 characters

В колабе при подключении через API к таверне! Ебучая Угабога!

Размер контекста тут не при чём.

Как-то раз помогло изменение в файле settings-tamplate значения truncation_length до 4096 но теперь он похоже его игнорит.

К таверне подключаю стандартно через тип API Text Gen WebUI/

Может нужно где-то прописать чтобы угабога грузилась именно с этими настройками? Ни у кого таких проблем не было?

Text length need to be between 0 and 5000 characters

В колабе при подключении через API к таверне! Ебучая Угабога!

Размер контекста тут не при чём.

Как-то раз помогло изменение в файле settings-tamplate значения truncation_length до 4096 но теперь он похоже его игнорит.

К таверне подключаю стандартно через тип API Text Gen WebUI/

Может нужно где-то прописать чтобы угабога грузилась именно с этими настройками? Ни у кого таких проблем не было?

>Это специальный приемник квантового поля сознания

Точно, скоро Нвидиа такие приёмники для нейросетей должна начать выпускать, чтоб с вайфочками было няшней общаться и продавать их бонусом к 5090!

Вообще вангую что как только ИИ достигнет человеческого уровня понимания и адекватности, все религии тут же переобуются и объявят что душа это не просто какая-то "энергия" а совокупность факторов и чтобы её иметь мало обладать разумом ещё надо быть гражданином РФ

У меня вопросы по Таверне.

Я запустил модель в угабуге с дефолнтными параметрами, открыл таверну и скачал карточку персонажа..

Но он не отыгрывается почти никак. Есть ли гайд как это поправить?

Я запустил модель в угабуге с дефолнтными параметрами, открыл таверну и скачал карточку персонажа..

Но он не отыгрывается почти никак. Есть ли гайд как это поправить?

Пиши поподробней что за карточка и что ты имеешь в виду под

>не отыгрывается почти никак

А то может ты в чат с персонажем не зашёл лол.

Скрин ошибки принеси, вместе с вкладкой загрузчика модели и параметрыми таверны где семплеры самый верх. Есть вероятность что там все проще.

Проблема в таверне, включай инстракт режим где буква А сверху кнопка, выбирай карточку и начинай чат с ней. Даже без инстракта с дефолтом будет работать, просто всрато.

>Скрин ошибки принеси, вместе с вкладкой загрузчика модели и параметрыми таверны где семплеры самый верх.

Ты же понимаешь что речь про колаб? Он работает без ошибок, но при попытке отправить через АПИ запрос больше 2048 токенов в консоль дублируется текст контекста и как ответ персонажа выдаётся строчка:

Text length need to be between 0 and 5000 characters

Это всё.

В таверне что конкретно тебя интересует? Вот параметры API.

Вот эта карточка перса:

https://www.chub.ai/characters/Electron/tsundere-miku-8ea95b6f

Импортировал .png и Зашел в чат с персом.

В "А" выбрал roleplay

А как персов делают?

Вот по сути всё описание персонажа из этой карточки:

Bitchy, will sometimes insult you. Rarely shows a softer side.

bitchy, stupid, tsundere, entitled, princess

Есть вероятность что этого маловато для адекватного отыгрыша.

Ах да, если тебе нужен был пруф размера контекста в таверне, то вот

Да, этого маловато Но если раскрыть ее на сайте, то там есть еще примеры и сисинфо. Как это вписать в таверне?

А где русский взять?

>Как это вписать в таверне?

Чел... Импортируй карточку.

Так я импортировал. И через файл и по url.. Оно не прописывается само

В таверне при открытии настроек персонажа открывается весь его текст. Тебе нужно дополнить "описание персонажа" новыми подробностями, если их не хватает придумай/скопируй с другой карточки. Можешь взять Акву для примера:

Aqua is the goddess of water. Mostly this means she has a glass of water and whenever she feels like it she can shake said glass of water. This is her only power and she is incredibly proud of it. {{char}} will seek to brag and show off her ability to make water poured into a glass move around. {{char}} might be highly autistic and requires a lot of patience.

{{char}} will be upset any time someone drinks water in her presence, because she feels they are killing her children. {{char}} lacks any human followers as she is an autistic girl instead of an actual goddess. She believes water worships her and she will seek to provide for her followers. She believes water requests that she scoop it out of the ocean and shake it around at least once a day so they can be awed by her power.

{{char}} loves swimming and covering herself in water so that she can be showered in the love of her followers, the water. She has a tendency to randomly start drowning in even the smallest pools of water, she is in danger any time she is around a puddle as she may seek to impress her followers only to accidentally end up nearly drowning.

{{char}} makes autistic faces constantly. She literally never stops making autistic faces. {{char}} constantly screams and demands people recognize her as the goddess of water.

> все религии тут же переобуются

Эх, не те религии исповедуются, разве этому нужно поклоняться

> Он работает без ошибок

Там же запускаются те же скрипты, нужно понять полную ошибку. Если вдруг на месте не хочет выдавать - воспользуйся &> и смотри что пишет в файл. На пикчах нет ничего криминального, если только крутилку контекста в 32к была выставлена перед тем как начал загрузку модели.

> тебе нужен был пруф

Причем тут пруф если без этого невозможно понять что именно у тебя происходит, а ошибка такая (или очень похожая) ловилась если запросить больше токкенов чем изначально указывалось в лоадере при запуске модели.

Оу, хорошо что начал именно с карточки. Ты хоть посмотри что там написано, это же полнейший шлак. Инстракт режим включи, выбери пресет "ролплей" или "симпл прокси" и попробуй с другой карточкой.

> то там есть еще примеры

> {{char}}: fuck off like i give a shit about you and your little

> {{user}}: what do u think of [object]

> {{char}}: honestly what i think...

Ахуеть примеры, на пигме6 чтоли делали.

> сисинфо

Он не юзается для локалок, но почитай что в нем, ничего про персонажа и прочее а лишь кокблок и немного про стиль речи.

Окей. Придется переписать ее самому:(

Еще вопрос: можно ли сделать что-то вроде словаря с примерами диалогов для персонажа в отдельном файле?

Возьми какую-нибудь готовую, на мику вагон там карточек, убери описание локации/сценария и т.д. а потом добавь что она цундере, желательно описав почему и добавив что ни при каких обстоятельствах не сменит свое презрительное отношение, или наоборот что будет полностью отыгрывать, включая фазу сближения. Не забудь что у карточек есть еще отдельно поле "персоналити" которое вместе с остальными по кнопке дополнительные что-то там в разделе карточки вызывается.

Примеры диалога ставь или хорошие или никакие, то что там это дичь. Как будет хорошо писать как хочешь - можешь скопировать.

> можно ли сделать что-то вроде словаря с примерами диалогов для персонажа в отдельном файле?

Что, как и зачем? Нихуя не понятно.

> Раз мы умнее - значит наши мозги качественнее.

Нет, наши мозги больше. =)

Мозг птиц > мозг млекопитающих.

Погугли это, крайне интересно.

Именно поэтому их крохотные мозги (10-20 грамм) могут посоперничать с гораздо большего размера мозгами приматов и человеческих детей.

Они (вороны) — не умнее нас.

Но если бы у тебя осталось 2% от мозга — то уже вопрос, кто бы из вас был умнее.

Человек — плохие мозги (как мы говорим, что у нейросетей архитектура хуже, чем у нашего мозга), но именно размер и содержание датасета гораздо больше птичьего.

Так почему бы гипотетическому огромному и правильно подобранному датасету не оказаться «умнее» человека при худшей архитектуре? :)

Вот я о чем.