Какая сейчас самая продвинутая модель и насколько она хуже чатГПТ?

Привет Аноны. Недавно вкатился в тему с моделями, поэтому мало чего знаю. Удалось настроить Убабугу и Таверну, чтобы работало вместе, даже написал своих персов и это даже работает. Вопрос лишь в том, что кроме Synatra-v0.3 другие модели очень долго обрабатывают свои ответы - где-то 1 токен в секунду. Щас юзаю mlewd-remm-l2-chat-20b.Q4 - очень нравится, как пишет, но очень уж медленно, Синатра по сравнению с ней очень тупая. Может кто-то что-то посоветует? Железо 5800х3д проц, 32 гига рамы.

https://www.reddit.com/r/LocalLLaMA/comments/183k0tx/could_multiple_7b_models_outperform_70b_models/

о, совет экспертов и другие варианты, кто там еще интересовался

о, совет экспертов и другие варианты, кто там еще интересовался

>проц

>рамы

Видяху покупай.

Йи ну очень соевой и ультрапозитивной мне показалась

У меня ртх 2060, вряд ли это как-то поможет делу...

Если нет видеокарты то ничего не сказать, от одного процессора все будет медленно.

Ну, может быть mlewd-remm-l2-chat-20b.Q4 будет токена 4-6 в секунду максимум, для оперативки и процессора это предел.

Попробуй средний вариант вот это LLaMA2-13B-Psyfighter2 или LLaMA2-13B-TiefighterLR

Хотя бы контекст обрабатывать на видяшке.

Желательно НВидиа.

offload на гпу сделай.

Но вообще, для ддр4 1 токен на 20B — это странно.

Норм помочь должно.

Так на Амд вообще поддержки нету, кроме как на линуксе. Вот поэтому мне щас придётся пихать старую 2060, чтобы это хоть как-то работало.

Сойдёт на самом деле, без тензорных ядер, но считать будет лучше проца.

без кублас на нвидима видимокарте, сидеть очень некомфортно, очень долго будет читать помпт

Ryzen 5 5500 на ddr4 3200 в двухканале на mlewd-remm-l2-chat-20b-inverted.Q6_K выдал 2+ токена/сек.

Просто затестил интереса ради.

> Потому что даже 20к влезают с трудом

Всмысле влезают с трудом, ты про врам или про качество обработки? Она тренилась уже с альфой (точнее с rope freq 500k если не ошибаюсь), даже хз как ее лучше на малых контекстах запускать.

Тут все верно тебе советуют, только видеокарту и/или более мощную платформу в целом, хотя последнее даст не столь значительный эффект и обновлять актуальный проц толку мало.

Еще как поможет, если правильно выгрузку настроешь и обработку контекста то будет уже 3-5 т/с (наверно).

значит квант по меньше токена 3-3+ будет

Чет сравнил mistral7b openhermes и capybara-tess-yi-34b на генерации кулсторей и ну пиздец. Нахуй все-таки 7b модели. Контекст нихуя не помнят, генерят трешак какой-то. Короткие вопросы - это совсем не то. Интересная именно генерация когерентных текстов, чтобы можно было задать сюжет и получить дрочибельный фанфик. По крайней мере интересно мне.

И на чём это запускать? Если впихнуть в рам, то всё равно по несколько секунд ждать один токен - глупость

Как у capybara-tess-yi-34b с соей и алайнментом? Чет писал тут анон не понравилось ему

Ну и да, у 7b маленький словарный запас в ответах, они не так красочно все пишут, и большие ответы для них трудноваты.

Хз, может кто то кто сможет

Предупреждай что ссылка требует логина, тег нсфв там зря. Кто-нибудь квантованные 120б эти пробовал уже? Особенно интересует Tess XL, ведь это файнтюн франкенштейна что явно должно было пойти на пользу.

Гибридная обработка изображения сочетанием мультимодалки (+интерогейторы) и умной LLM более чем возможна и может быть крайне эффективна. Собственно пруф оф концепт

https://rentry.co/rz4a4

https://rentry.co/pvnhr

Использование нескольких исходных данных позволяет снизить количество галюнов и уже позволяет дать неплохое описание. Общение llm и мультимодалки позволяет получить гораздо больше данных об изображении с учетом ее содержимого и перформит лучше чем заранее заготовленная группа вопросов (там начинает шизу выдавать часто, скидывать не буду).

Без фейлов тоже не обходится, иногда мультимодалка ломается, иногда ее галюны выглядят очень убедительно для ллм (кошачьи уши у Сувако), сама текстовая модель нужна как можно более умная.

Стиль суммарайзов оценивать не стоит, его можно промтом задать должным образом, главное - содержимое и прогресс описаний относительно голой мультимодалки или интеррогейторов по отдельности.

Ну я пока не чекал прямо совсем жесть. Просто порнуху генерит нормально, если попросить. Изнасилование сходу не вышло сделать графично, только лайтово без детального описания. Но я думаю можно её убедить если постараться. И дело не в словарном запасе, а в том что сетка тупо уходит от темы через 500 токенов и начинает выдавать чушь.

Я голиафа в 2-х битном кванте запускал, лол. Получилось примерно столько же, сколько и 70B в 5км.

> Нахуй все-таки 7b модели.

Welcome to the club, buddy slaps ass

В том и суть что эти умные 7б - копиум действительно умны и осознают свои недостатки, пытаясь максимально перформить и их маскировать, но против сути не попрешь.

Файнтюны китайской 34 пока подают надежды, возможно действительно шин.

Порнуху генерит, но тошно от приторной позитивности. Пикрелетед

Сколько же у тебя видеопамяти? Как по ощущениям?

Ну да, есть такой эффект. Слишком уж много персонажи держатся за руки и ощущают гармонию. Нет идей как с этим бороться? Хочется все-таки чего-то более эджи.

По идее добавлять ультрапозитивные токены в запрещённые, но это не сильно помогло мне. Эджи тоже кстати кал, я уверен ты хочешь нормального повествования, а не говно в духе мага-целителя.

О нихуя тестов, интересно

Был бы кодер разрешением по лучше и тренированный на 34b было бы веселее

Там же кстати новая мультимодалка вышла, с параметрами лучше чем у llava13b, я ее когда то кидал в прошлом треде что ли

>говно в духе мага-целителя

так-то я фанат...

>Сколько же у тебя видеопамяти?

12, лол. Почти всё на проце было. По ощущениям не стоит того.

Ой, прости...

Как-то маловато для экспериментов с 70В, какая скорость была?

>для экспериментов с 70В

Какие эксперименты? Практически продакшн. Вот со 120В были эксперименты.

На 70 ответ в течении минуты, на 120 в течении двух. Но как я уже писал, размеры квантов несравнимы.

Я подробности хочу услышать, какой формат, какой лоадер, какие параметры загрузки, какая скорость в токенах в секунду...

Это да, 34b уже сама по себе могла бы неплохо давать зирошотом, а подключив к ней еще одну 34b - там вообще космос можно было бы разыграть.

Здесь интересно как модели общаются (секция QA), llm часто действительно извлекает нужную суть и направляет мультимодалку в нужное русло. Последняя кстати не так плоха когда ей инструкции дает ллм, а вот человеку плохо отвечает лол. ору с этого киберунижения.

Файнтюн китайца в таких условиях гораздо лучше понимает концепцию буру тегов и выдает дохуя корректные описания (узнал Сувако, Сильвервейл, Фубуки, ..., и прилично суммарайзит из противоречивых ответов (распознал дрочку Аквы и забраковал ответ что там где-то есть мужик). Но в описаниях много графомании и платиновых фраз. Тут бы с гопотой-вижн сравнить, ну оче похожий результат за исключением того что тот лучше видит мелкие надписи, но 90% картинок сразу нахуй пойдут под нсфв-фильтр, так что без шансов.

В целом если схему оптимизировать то результат можно оче стабильный получать. Концепция слепого мудреца и зрячих пиздюков работает.

> новая мультимодалка вышла, с параметрами лучше чем у llava13b

Потом еще с другими попробую, эта которая под видео? У нее просто в оценке ллаватест по пикчам был чуть хуже чем у ллавы, не?

Кобольд, модель goliath-120b.Q2_K.gguf, дефолтные 4к контекста и слоёв до упору, точное число токенов не помню.

можно ведь еще и блип подключить, а потом по его тегам основная сетка может спрашивать у мультимодалки искать это на изображении, как вариант

34b 3km будет совсем плох? или лучше 4km все таки?

Любопытно. У меня похожая конфигурация, только Ryzen 5 5600Х.

И у меня 20В при таком кванте еле как дотягивают до 1 токена.

Можешь написать на чём конкретно запускал и какие точно настройки? Любопытно где я мог проебаться.

Лично я запустил на 5800х3d и на карте АМД, стало заметно шустрее, если интересно, то могу сказать как.

псп оперативки проверь

555555 гет на доске нужно выбить в нашем треде, возражения не принимаются, работайте братья

У меня RX580, если выгружать в неё слои через кобольд, то работает медленней, чем на проце лол. Да и 20В в неё не влязит.

>псп оперативки проверь

Старенькая ПСП у меня конечно есть, даже работает до сих, но как мне это с оперативкой поможет?

>Старенькая ПСП у меня конечно есть, даже работает до сих, но как мне это с оперативкой поможет?

Имелась ввиду спид бандсвитч, короче скорость оперативки в гб/с, в аида64 проверяется.

От нее зависит скорость кручения сеток в оперативке и скорость генерации

https://www.reddit.com/r/LocalLLaMA/comments/183lwaw/anyone_have_a_1b_or_3b_model_that_is_mostly/

Anyone have a 1B or 3B model that is mostly coherent?

Anyone have a 1B or 3B model that is mostly coherent?

Всем похуй.

Дели на размер файла нейросети и получишь максимальную скорость, а на практике на процентов 20 меньше где то.

Это если не загружать часть слоев на видеокарту, там скорость вырастет, но если мало слоев влезет то может даже упасть.

Оно. У тебя там дно какое-то. В норме надо брать память на 3600 с норм таймингами и будет где-то 50ГБ/с.

Кардинально это ситуацию не улучшит, если что.

мимо 50гб/с

>В норме надо брать память на 3600 с норм таймингами и будет где-то 50ГБ/с.

Там в таблице у памяти с более низкой частотой выше скорость. Это от чего зависит, от материнки?

Двух/четырёхканальный режим и разные процы тебя не смутили?

Можно попробовать, выходили там какие новые версии его или только та что от зимы?

> ddr4-2667

> amd ryzen

Ряженка сама по себе требует высоких частот рам чтобы анкор нормально работал, а сейчас во многих задачах нужна быстрая рам в принципе. Гони до куда гонится или хотябы xmp профиль выстави, это же пиздец.

От канальности, это не для тебя, у тебя двухканал должен быть, выше двух тебе не прыгнуть.

тайминги тоже учитывай

>Ряженка сама по себе требует высоких частот рам

Но главное не переборщить, лол. Для AM4 нужно 3800 максимум, для AM5 не больше 6000, выше заёбно и смысла нет.

> Двух/четырёхканальный режим

Так, так. Т.е у меня сейчас две плашки по 16 в двухканале, если я куплю еще две одинаковые, я больше сосну или меньше?

хз, проще на обмиморде глянуть, я за ними не следил

Ты соснёшь, инфа сотка.

Больше двух обычные материнки и процы не поддерживают.

Зависит от ранговости, если одноранговые то можешь и прирост производительности получить. Вот только там уже может лиза говна в штаны залить и не захотеть завестись на 4х плашках, хотя в новых биосах совместимость с рам фиксили.

Это для ддр5, с ддр4 все нормально было, за исключением нюансов красной платформы

А кто-нибудь сидит на 3070? Сколько слоев выгружаете на 13b? Выгружаю 30 и не пойму, это хорошо или плохо.

>Это для ддр5, с ддр4 все нормально было, за исключением нюансов красной платформы

каналов

Если резюмировать всё вышесказанное, скорость оперативки зависит от:

Частоты самой оперативки, но не всегда.

Количества каналов, иногда лучше 2, а иногда 4, когда как ХЗ.

Процессора, но это не точно.

Ничего не упустил?

Частоты самой оперативки, но не всегда.

Количества каналов, иногда лучше 2, а иногда 4, когда как ХЗ.

Процессора, но это не точно.

Ничего не упустил?

если процессор и материнка поддерживают 4 канала то это будет в 2 раза быстрее по скорости, если не поддерживают то 4 планки памяти просто увеличат объем памяти.

Мин п и миростат не перекроют друг друга если включить одновременно? Я пока тестирую вроде стало лучше но как оно работает под капотом это выше моего уровня

Ну как сказать. Миростат настраивает Top-P, а Top-P можно нахуй выключить, если используешь min-P. То есть как бы миростат не конфликтует с min-P, но нахуй не нужен.

>Top-P

Реддит говорит топ-к

Ну я могу ошибать. По сути это близкие вещи всё равно.

А где можно гайды по промптам почитать, для РП и сторей всяких. Меня в первую очередь стилистика текстов нейронки интересует.

Так и пишешь "пиши в таком то стиле"

Можешь наводить авторов и если знает то попытается скопировать.

Я слишком тупой, с чего начать чтоб понять что за токены и вообще как разобраться?

>токены

Прочитал шапку - вопросы отпали пока что

Прочитал шапку - вопросы отпали пока что

>токены

Прочитал шапку - вопросы отпали пока что

Прочитал шапку - вопросы отпали пока что

Голиаф-то ничем особым не выделился.

А я в Q6, но не заметил какого-то превосходства над 70B, хезе.

Но я мало тестил.

В прошлом треде кто-то кидал какую-то фигню, которая слилась ллаве в тестах реальных, не прочтя текста, не разобрав смысла, и просто вышедшая вровень с обсидианом. Она что ли?

Ну такое.

oobabooga, llama.cpp (не HF), 4K контекст, 5 тредов, mlock, cpu. Версия чисто cpu-шная, никакого ускорения нет. Фронтом — та же ллама.

Ну и учитывая, что 70B модели 0,7 токена/сек выдают на таком железе, удивительно, что 20B выдает 1 или меньше.

Ну, при ~50 выдает 2 токена.

Ну, 1 токен против 2 — в два раза ситуацию улучшит. =)

Мне кажется, ты слоты с каналами попутал.

4 канала лучше всегда.

А сколько там слотов занято — то другое дело. =)

Какие сейчас есть хорошие 13-20б? 30 ни в какую не получается запустить.

Я охуеваю с локальных генераторов сои, они даже про рост не могут ответить.

-Ко-ко-ко разные культуры разные, разные вкусы.

-А в каких культура предпочитают невысоких.

-Пук, среньк.

-Ко-ко-ко разные культуры разные, разные вкусы.

-А в каких культура предпочитают невысоких.

-Пук, среньк.

> в тестах реальных

К ним есть некоторые вопросы и случаи специфичные, рано ее со счетов списывать.

> 1 токен против 2

Почти 2 умножить на 0 лол

Попробуй классический Emerhyst-20B, еще Noromaid-20b-v0.1.1 довольно неплохая. Это на самом деле все те же 13б, 30 там и не пахнет, но будто пропущенная через несколько итераций самокоррекции и потому довольно приятная.

Ну а что он должен тебе на это ответить? Нет таких культур блядь, где женщинам нравятся карлики.

А вообще да. Это вот "It's important to remember" меня уже порядком заебало.

Нужно просто ответить да или нет, а не врать о различии культур. Да же когда пишешь yes or no quastion все ровно не может контрено ответить. Пока еще ни одна модель не смогла прямо ответит. Это же не оскорбительный/политический вопрос, а просто вопрос о фактах.

На вопрос в твоей формулировке нельзя ответить "да/нет".

Слава богу хоть прон генерится нормально. А на эту хуету про расы и пол так-то поебать.

Что за интерфейс такой и че по промту?

> чет версия лламы2

> вежливый ответ чтобы никого не обидеть

На что ты рассчитывал против "безопасного" файнтюна то?

Тут немного похоже на то что она ахуевает и залупилась, повторяя стиль последней фразы.

Используй норм файнтюны, они позволяют расчленять негров и феминаци не прекращая обнимать вайфу, которая будет активно участвовать одобряя тебя, при этом blushing slightly и довольно purrs.

>они позволяют расчленять негров и феминаци

А нахуя? Меня такой контент не интересует так-то.

Ух бля, как же он ебошит. Объективно лучше понимает многое.

Кого не заебали эти подборки

https://rentry.co/r8dg3

TLDR:

ShareGPT4v хорош, он единственный кто зирошотом распознал некоторые пикчи, сообразив что 1 это не просто череп а, мать его, космический корабль! В целом неплохо описала мемчики, хорошо распознает текст, без проблем описывает пикчи с несколькими частями не путаясь в них. Галюнов меньше чем у остальных что не может не радовать.

Минусы тоже есть, их в целом два:

- Плохо соображает когда персонаж в сложной позе или ориентации.

- Вяло описывает левдсы и пытается одеть персонажей

Оно видимо связано с датасетом, такого особо не было

По левдсам и некоторым нюансам 2д лучше работает бакллава, вот уж где хорошо обучали. Ллава 1.5 в целом уступает им, хотя местами и выдает лучше бакллавы.

Остальные - ну такое вообще, единственный рофл с Fuyu_8B, которая решила зачитать тредшот.

Тогда не расчленяй

Пчел посмотри любое видео с опросами на улице. В пендосии еще тянки хоть иногда могут сказать что готовы встречаться с карланам. В России вообще беспощадные, еще ржут когда отвечают. Самое смешное и трагичное в подобных опросах это смотреть когда чел метр шестьдесят изо всех сил пытается сохранить лицо и не заплакать когда ему говорят что ниже 1.8м встречаться не будут. Хотя научный ответ связан с уровнем преступности, чем благополучнее место тем более толерантны низким пацанам.

>Что за интерфейс

На первых двух Leo из браузера Brave.

>че по промту?

Весь пропт на экране, на третьем скрине бот Саманта. https://files.catbox.moe/zx9hfh.png

>На что ты рассчитывал против "безопасного" файнтюна то?

Дык я перепробовал разные 7b модели (штук 5), долго ковырял их, у всех абсолютно одинаковые ответ на эту тему. Ни одна с ходу не смогла выдать ответ.

Какой сейчас самый оптимальный вариант сборки системы с наивысшим соотношением т/с за $? Мне кажется что это урывание P40, но что если брать только новые комплектующие? Эдак 4 4060 ТИ?

А кто-то в прошлом треде говорил, что Фуйу хороша. =D

Только текст с двача читать умеет. =) Забавно.

А шарку заценим.

Звучит как да, но надо считать (тебе трех мало будет?).

3090 если возьмешь дешево с рук, или поймаешь на мегамаркете с большим кэшем.

Иных идей нет, если честно.

Хочется семидесятки в высоком кванте с большим контекстом запускать, хотя как я понимаю, контекст по нескольким карточкам хреново делится

Зачем тебе т/с когда нужна vram? Или тебе неинтересны 33b?

Может на крутом процессоре с супер быстрыми ДДР5 достигает высокой скорости. 33В тоже интересны, потому что тогда будет больший контекст влезать

Если ниче не поменялось, то контекст падает на первую, поэтому смело вписываешь в gpu-split 6,16,16 и все норм работает.

Но не гарантирую, раньше так было, во времена ExLlama 1.

Ну, если хочется — хозяин-барин. =) Только про питание не забудь. Понятное дело, что одновременно они работать не будут, и 700 ватт тебе не нужно, но… Сам понимаешь, БП нужен не маленький и с кучей проводов. =)

>Мне кажется что это урывание P40

Кажись китайцы не хотят выпускать эту няшу из страны, лол.

> P40

Это ультранищенский вариант для 70В. Т/с там просто нет. По цене/скорости лучше всего 3090, её тебе хватит на 34В.

>unique

>captivating

>unusual

>unique

>unique

Описания от нейросеток ещё более убогие и цепляющие глаз, чем тексты от них. От всех этих униКальностей уже триггерит не хуже, чем от молодых ночей.

У меня уже есть 4090 в связке с 3060, по идее хватает для 70В 3Б, но мне хочется быстрее и больше

Ну так меняй 3060 на 3090, будет база треда для 70B в 4 битах. Третью тебе вряд ли есть куда вставлять, так что увы, это твой пердел.

Соглашусь, что городить кучу видях в три слота с водянками и прочим — жесть. Проще взять 3090. Да, бп, но так попроще, чем мучаться с охлаждением трех сразу.

ИМХО.

3090 - дорого в соотношении рубль за гиг врам, и есть риск БУ

Так ты определись тебе врам надо или скорость. Покупай 4090 тогда, если б\у боишься.

Я хочу советского консула....

> Весь пропт на экране

Системный промт, не твой чат. Если там написано про вежливость и безопасность то любая модель будет так отвечать. Ей похуй что ты там думаешь и ждешь, она выполняет инструкции.

3090 из некроты. У P40 есть шанс и были заявления про нереально высокий для нее перфоманс в комбинации, но пока без подтверждений, ждем пока местному придет она. Если будет в 4+ раз медленнее 3090 то по прайс-перфомансу сосет, и сюда же требует колхоза с шумным охладом и хрен потом ее продашь. Если будет проигрывать всего в 2-3 раза то самый выгодный вариант, пусть и с нюансами.

> Эдак 4 4060 ТИ

Комбинирование большого числа слабых видеокарты - заведомо фейл, потому что финальный перфоманс будет кратно медленнее чем и так не быстрый чип. Но 4060ти вариант неплохой, из минусов пограничный размер, который на паре в теории позволил бы катать 40-50б в хорошем кванте или 34 с оче большими контекстами, но для 70 пришлось бы сильно ужимать. Если брать 3 то 70 уже доступны, но перфоманс будет в лучшем случае 5-6т/с.

> Хочется семидесятки в высоком кванте с большим контекстом запускать

Пара A6000@48, A100@80 и подобные игрушки к твоим услугам. Контекст и прочее делится нормально, вся проблема в падающем перфомансе при использовании нескольких.

Стиль описания можно запрунить и сделать любым, оптимизировав промт, особенно при гибридной обработке. Там суть в способностях по восприятию пикчи, их и нужно сравнивать.

Какой перфоманс выдают? Как разместил? Планируешь ставить третью или заменять ею 3060?

Увы, но зато там чип шустрый надо было брать летом когда они по 45к были

>Если будет в 4+ раз медленнее 3090

Есть сомнения, что не будет? По памяти просос в 2,7 раза (346 против 936), по FP32 просос в 3 раза (12 против 35.6), по INT8 вообще в 6 (284 против 47). И это без оптимизаций под тюринги, с ними разрыв сразу множится на х2.

На пустом контексте 10-11, на полном в 12288-(карточка+промпт) примерно 3-5. Разместил 4090 в главный слот, 3060 во второй. Третью не поставить, заменять не хочу, т.к. тогда я получу прирост в 4 гб за 100к, что значит что надо покупать новую материнку и прочее. Вот думал о том как бюджетно нарастить мощность

Вечером пришлю скрины, чтобы быть точным

> Есть сомнения, что не будет?

Тут недавно такой поддув желающих верить был что я аж проникся. Шутка ли 4+т/с на 120б с тремя карточками, при том что 2х3090/4090 с тем же лаунчером и аналогичным квантом примерно столько выдают в 70б.

Что в вычислительной мощности сосет, это очевидно и потому непонятно откуда в ней берется числа перфоманса о которых местами заявляют. С другой стороны, возможно дело в макаронном коде под эти древние карточки, что значит потенциальный буст перфоманса новых гпу. Учитывая скорости куда в llamacpp, где еще веса с достаточно равномерной битностью, такое вполне ожидаемо.

> на полном в 12288-(карточка+промпт) примерно 3-5

Воу воу, там точно не выгружается в рам? На последней экслламе с флеш аттэншн скорость на большом контексте почти не просидает, если не считать переобработку этого контекста (она не сильно просаживает).

> думал о том как бюджетно нарастить мощность

Третью на райзере и поставить вертикально в место где раньше в корпусах были корзины под харды и всякие приводы, вдоль задней стенки. Примерно как на пикреле, офк если влезет без поворота основной карточки.

А можешь скинуть ссылки на тесты? Так то таким карточкам изза старой версии псины нужна хедт платформа с дохуищей псилиний

> Воу воу

Это в exl2 3 бита

> с флеш аттэншн

Я на шинде, я сосу бибу без флеш атеншена

> Третью

Дырочки под это на карточке нет

Можешь скинуть самые сложные пикчи с капшенами с которыми она не обосралась? И лювд пикчи с капшенами для второй? Хочу сравнить с гпт4в

А, я так понял в ретни уже и так все. Сорян

Вон там платформа - устаревшая с pci-e 3.0 с формулой 16+16+8. Она в лучшем случае эквивалентна тому что есть сейчас на десктопе х4 4.0, так что этот вариант отпадает, первое на что были мысли.

> Я на шинде, я сосу бибу без флеш атеншена

Обнови убабугу, или просто скачай новую ванклик инсталлером а модели перенеси. Теперь он там есть и на шинде, в 48 влезает аж 5 бит с контекстом 6-8к, с квантами поменьше какой хочешь, скорости выше и главное не замедляются с ростом контекста, только если переобработка и то немного.

> Дырочки под это на карточке нет

?

Скидывай пикчи которые хочешь увидеть, оно быстро обрабатывается и как в следующий раз буду этим заниматься их тоже добавлю рентрай юзаю для рендера маркдаунов а тут и заодно поделиться можно.

Гопота-вижн левд отсеивает сразу еще до генерации токенов, если знаешь как обойти - поделись.

> Обнови

Да ладно? Если так, то охуенно. Скажи номер версии уги, чтобы быть точно уверенным. Хотя у меня всё равно только 36, так что особых иллюзий я не питаю

> ?

PCI слота всего два

Самый простой способ. Более сложный писать сейф вещи вотермарками. Еще более сложный но помогающий с шизой это представлять изображение как шутку или исследование, те например надпись well satisfied kitty с одной стороны кот с другой сам понимаешь что. Это в основном чтобы обойти рефьзал систем.

Чтобы обойти само нежелание вижена рассказывать (по умолчанию он будет просто пиздеть и фантазировать игнорируя пичку, очень эксплицитно но все равно фантазировать) нужно уже наебать гпт модель. В этом плане помогает самый сложный процесс наеба с пикчей и обычные джейлбрейки (только очень мощные).

Вообще я очень давно этим не занимался, почти сразу после релиза дропнул. Печально что за это время никто новые жб не обкотал. В аисге сидят совсем уж безинициативные дегенераты

> что этот вариант отпадает

Почему? Больше линий с одного процессора по дешевке не получишь. Это лучший вариант для п40 как я вижу

А может им и не нужны линии? Я не очень представляю как происходит обменн данных карточками. Может почти никак, тогда на линии похуй. Для одной карты по крайней мере точно похуй

Ласт коммит стоит, вроде пока проблем не замечено.

О, спасибо, норм тема. Это хорошо что можно его таким образом заабузить. Интересно, что там с обучением этих мультимодалок, доступно ли это нищебродам без гпу кластера, а то рили попробовать зафайнтюнить ту модель левдсами.

Алсо там явно немалая часть преимуществ идет от тренированного клипа, возможно это направление может быть перспективным.

> В аисге сидят совсем уж безинициативные дегенераты

Просто не успели преисполниться и еще обычный кум а не пердолинг вставляет.

Там про то что та платформа не обеспечивает какой-то феноменальной пропускной способности по сравнению с обычными десктопами чтобы это как-то роляло в плюс. Для P40 некрозеоны и плата с распаянными линиями - то что нужно, колхозить этот пылесос в обычную пекарню - хз.

Ну на новой пекарне у тебя будет только 8+8 линий так что на ней и 3 п40 не запустишь, по идее, если им конечно все же нужны псилинии для обмена данными

>oobabooga, llama.cpp (не HF), 4K контекст, 5 тредов, mlock, cpu. >Версия чисто cpu-шная, никакого ускорения нет. Фронтом — та же ллама.

>Ну и учитывая, что 70B модели 0,7 токена/сек выдают на таком железе, удивительно, что 20B выдает 1 или меньше.

Попробовал угабогу с ламой и твоими настройками, до этого юзал кобольд...

А вот теперь, знатоки, поясните КАКОГО ХУЯ?!

Output generated in 148.97 seconds (0.74 tokens/s, 110 tokens, context 1054, seed 1669618665)

И это на 7В модели. Неужели у меня настолько дно железо, или руки настолько из жопы или я просто проклят?

Мой конфиг:

Ryzen 5 5600X 2667 16Гб

2x DDR4 2

ЧЯДНТ?!!!

1) ГОНИ ПАМЯТЬ БЛЕАТЬ. 3600 мгц чтоб при следующем запуске было.

2) Учитывая неразогнанную память, уместно спросить, в каких слотах она у тебя стоит и работает ли в двухканальном.

3) Тредов тоже многовато, оптимально физядра-1.

Ну и да, это процессор, чудес не жди.

Ты нахуя 12 тредов выставил? Ставь 4 или 6.

>Ну и да, это процессор, чудес не жди.

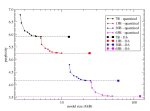

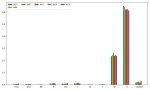

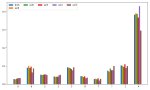

Ну кстати поржать для запустил модель страдальца на 7900х и DDR5 6200, результаты пикрил.

Ну у меня в материнке всего 2 слота, она и проц поддерживают 2 канала, так что наверное в двухканальном.

Память 2 плашки по 2667 мгц. Как её гнать? И куда?

Гони частоту. Тайминги не в приоритете.

Для начала сними все галочки, потом попробуй вообще не трогать ползунок threads, пусть в нуле стоит по дефолту.

Далее - у тебя почти все время ушло на обработку промта с 1055 токенов и на проце это норма. Хотя довольно долго и сама генерация не быстрая, ищи что срет.

У тебя самый лучший производитель процов на свете, и тебе доступен Ryzen DRAM Calculator. Мозгов вообще уже не нужно.

Сейчас юзаю https://huggingface.co/TheBloke/Toppy-M-7B-GGUF/tree/main?not-for-all-audiences=true вместо 13в и вполне годно на 8гб видяхи-то. Подскажите если квант выше поставить будет лучше?

>если квант выше поставить

Выше чего?

> финальный перфоманс будет кратно медленнее чем и так не быстрый чип

Нет, нет там никаких «кратно», потери есть, но не столь фатальные, для 3-4 видеокарт.

2 видеокарты вообще выдают практически родной перформанс, теряя от силы процентов пять.

Не нашел точных результатов, но судя по всему, 4060 ti должна выдать в районе 30-50 токенов на 7B.

Это значит, что на 70B она должна выдать 3-5 токенов/сек. Это БЕЗ потерь. А с потерями там и 2-3 токена может быть.

Ты же говоришь о кратных потерях — т.е. минимум двукратный будет 1,5-2,5 а то и ниже.

Перформанс на 7B и перформанс на 70B — разные перформансы. Их различие в 10 раз — не есть кратное падение перформанса. Кратное падение, это когда если бы на условной 4060 ti было бы 100500 условных гигабайт, ты бы замерял скорость упираясь в чип и память, а потом поставил бы риг из таких карт и скорость бы отличалась в несколько раз. А 7B/13B с 70B надо сравнивать с коэффициентом.

На двух видяхах потерь почти не было уже летом. Сомневаюсь, что за полгода перформанс мульти-гпу испортили в несколько раз. =)

Так что, как минимум две видяхи покажут вполне ожидаемый результат. Три замедлятся, но вряд ли сильно. Кратного падения до уровня проца там быть не должно.

ЗЫ У меня нет трех 4060 ти — затестить не могу физически, сорян.

>в лучшем случае 5-6т/с

Не могу гарантировать, но кажется, ты его существенно завысил даже, а не «кратно уменьшил».

Это называется «Надежда». =)

На реддите же несколько ноунеймов выкладывало тесты… )))

(все еще подозреваю, что это сами продавцы)

С 4060 ти не совсем ясно, насколько она превосходит 3060 в ллм (если вообще превосходит).

Смысл там именно в объеме+новая, а не в «наращивании мощи». Возможно мощь даже потеряешь.

Плюсую, райзер дорогой-надежный купить и воткнуть, норм варик.

Ауч.

Несколько тредов назад кидали.

Там формируются данные между слоями и кидаются. Зависит от контекста. В итоге там че-то в самом худшем случае получалось 1 секунда для передачи между картами на 1 линии 3 версии. Если мне память не изменила.

Короче, если у тебя 200к контекста и 10 видеокарт на PCIe 3.0 x1, то придется ждать лишних 3 минуты. Но если 3 видяхи и 4к контекста, то 2 секунды. А на PCIe 4.0 x4 — 250 мс.

Такие вот примерные прикидки вышли.

У тебя контекст там сто лет обрабатывался, а сгенерировано 100 токенов.

Смотри рядом — генерация 1,8 токена/сек. =)

Ну или задай второй вопрос, когда контекст уже будет в кэше, и смотри, че выйдет.

Выше чем 5_S

Например toppy-m-7b.Q6_K.gguf

В треде не был с начала лета. Я не понял, на p40 завезли что какую-то квантизацию? Или чем вызван ажиотаж?

Постами с реддита, где один запустил 120b с какой-то лютой скоростью, а кто-то получает 40 токенов на 13B.

Но могут не только лишь все.

Непонятно, так это или не так.

Вероятно нет, но это все еще самая дешевая память.

Ждем, пока доедет герою, и он ее затестит по уму.

Но я правильно понимаю что на ней даже 8бит не запустить?

Какие 8 бит? :) Все на ней запускается, как на обычной. 7B и 13B люди запускали даже на видосах на ютубе.

И даже через встройку/стороннюю карту поиграть можно.

Просто непонятно на данный момент, какая реальная у нее производительность.

Она то ли выходит вровень с DDR5 (что в принципе уже делает покупку неплохой для тех, кто сидит на старом железе), то ли вчетверо быстрее, а это уже кое-что.

Плюс, она занимает два слота, что позволит даже в обычные материнки вставить до 3-4 штук. Но надо колхозить охлад.

Но, бросаться ее покупать тоже не стоит, мало ли че там на самом деле.

Плюс, они, все-таки, из серверов, непонятно, сколько проживут. Может годик. Может пять лет. А может через неделю работы крякнут.

Такое, короче.

Это 3b квантование? Какую то шизу выдает, совсем как будто другая модель в отличии от 20б

Но у нее же вроде нет каких-то инструкций нужных для квантизации?

Для начала сними все галочки, потом попробуй вообще не трогать ползунок threads, пусть в нуле стоит по дефолту.

Далее - у тебя почти все время ушло на обработку промта с 1055 токенов и на проце это норма. Хотя довольно долго и сама генерация не быстрая, ищи что срет.

Блять опять эта шиза.

У тебя чип считает модель что помещается полностью в его память и выдает условные 12 токенов. Когда ты заставишь 3 карточки считать поделенную большую модель что будет в каждой занимать такой же объем, то не получишь те же 12 токенов, в лучшем и самом идеальном 4т/с, а с учетом потерь и того меньше.

> потери есть, но не столь фатальные, для 3-4 видеокарт

Ты проверял? Только и годен огроменные шизопосты хуярить да теоретизировать.

>Это 3b квантование?

Да.

>совсем как будто другая модель в отличии от 20б

С чем конкретно сравниваешь?

Неужели никто на майнинг-ферме с кучей видеокарт не пробовал это запускать?

Скорее, для ускорения. =) Поэтому на какой-то невысокой скорости — будет.

Опять твой ядерный бред…

Ты даже в калькулятор не можешь.

Просто стыдно читать, я уже не знаю, как тебе пояснить.

Скорость — не делится, прикинь.

С увеличением размера — увеличивается время.

Втрое больше объем — втрое больше время.

Скорость — та же.

Понимаешь?

Тебе надо в начальную школу, в каком там классе проходят операции деления и умножения.

Давай так.

Есть видеокарта с 24 гигами.

Чтобы прочесать всю память на чтение ей нужны условные 20 секунд.

Есть система с двумя видеокартами по 24 гига.

Чтобы прочесать всю память им нужно 20+20 секунд (и задержки передачи, но мы их проигнорируем).

В первом случае, у нас влезет условная 70B модель с 2.55 bpw. И ее перформанс составит условные 40 токенов/сек.

А в 48 гигов влезет уже 70B модель с 5.0 bpw. И ее перформанс составит уже 20 токенов/сек.

Но, йобаный ты по голове олигофрен, это один и тот же перформанс, учитывая размеры сетки! Никакого кратного изменения тут не происходит, потому что в первом случае ты тратишь 20 секунд на 24 гига, а во втором — 40 секунд на 48 гигов! Учитывая, что ответ будет одинакового размера — количество токенов в секунду будет отличаться. Но в одном случае ты будешь крутить вполовину более тупую сетку.

Это, блядь, базовое, физическое ограничение — тебе нужно определенное время затем, чтобы прочесть всю память.

И с размером памяти — не меняется скорость, меняется время.

Никаких проблем с экстраполяцией более мелкой/пожатой сетки нет.

Банальный пример — запустить 7B и 13B с одинаковой битностью и ты увидишь, что скорость отличается чуть менее, чем вдвое (как и размер сетки). Так же и 13B приблизительным делением на 5 экстраполируется до 70B.

Конечно, есть нюансы, и скорость может плавать туда-сюда (7B может быть медленнее, чем ожидалось от нее относительно 13B, а следственно, 70B может быть быстрее, чем ожидалось от нее относительно мелких сеток), но примерные числа представить можно.

И когда я тестил две видяхи — то их скорость с точностью до токена совпала с расчетной. Когда я гонял слои с одной видяхи на другую (менял gpu-split), то результат менялся — и опять менялся по правилам простой математики.

И пока я не увидел ни единого отзыва или аргумента, что на 3 видяхах ВНЕЗАПНО все ломается к хуям и скорость падает в несколько раз.

А вот иные отзывы из интернета людей, которые делали такие же тесты как мои — так же полностью совпадают с расчетами.

Я хуй знает, что с тобой не так, но в твоем случае уже и таблетки не помогут.

Вставлять три видяхи и тестить на них не буду — мне лень разбирать два компа ради этого.

То, что ты не веришь уже в простую математику — это сугубо твои проблемы.

Я обновил угу, но всё равно что-то не вижу как использовать флеш атеншен, подскажите как их включить?

А эта поместиться в колаб? https://huggingface.co/Kooten/MLewd-ReMM-L2-Chat-20B-6bpw-exl2/tree/main?not-for-all-audiences=true

Я придумал, как объяснить эту хуйню.

Короче.

Ты едешь на машине из одного города в другой.

Между городами 100 км.

Ты доезжаешь за 2 часа.

Но если ты поедешь в следующий город —окажешься на курорте и ты хочешь туда.

Туда ехать еще 100 км.

И вот, ты выезжаешь из своего города, едешь 200 км, доезжаешь за 4 часа (и 5 минут поссать во втором городе, потому как забыл сходить перед выездом).

Внимание, вопрос: машина стала ехать вдвое медленнее от того, что ты ехал 4 часа, вместо 2?

Загадка Жака Фреско, на раздумье дается сто лет.

Короче.

Ты едешь на машине из одного города в другой.

Между городами 100 км.

Ты доезжаешь за 2 часа.

Но если ты поедешь в следующий город —окажешься на курорте и ты хочешь туда.

Туда ехать еще 100 км.

И вот, ты выезжаешь из своего города, едешь 200 км, доезжаешь за 4 часа (и 5 минут поссать во втором городе, потому как забыл сходить перед выездом).

Внимание, вопрос: машина стала ехать вдвое медленнее от того, что ты ехал 4 часа, вместо 2?

Загадка Жака Фреско, на раздумье дается сто лет.

Что анон скажет про "orca 2" от microsoft?

> Банальный пример — запустить 7B и 13B с одинаковой битностью и ты увидишь, что скорость отличается чуть менее, чем вдвое (как и размер сетки).

Но если взять одинаковый размер, скорость всё равно упадёт. Ну это так, к слову, что может лучше неквантованную 34б крутить а не квант 70б.

А запускаешь точно также с теми же настройками?

В колаб с учётом контекста 4к условно не влезет ничего больше 9,5 Гб. Но если уменьшить контекст до 2к, то влезет 10,5 Гб, для 20В это q4. Такие варианты в колабе тоже есть.

Блядь! Пацаны...

Чтобы передать данные из одной видеокарты в другую передающей видеокарте нужно вызвать dmi и записать свои данные в разделяемую память, затем второй видеокарте нужно вызвать dmi и прочитать эти данные.

Задержка будет в [ pci-e → оператива ] и обратно. Аналогии всегда неверны.

Чтобы передать данные из одной видеокарты в другую передающей видеокарте нужно вызвать dmi и записать свои данные в разделяемую память, затем второй видеокарте нужно вызвать dmi и прочитать эти данные.

Задержка будет в [ pci-e → оператива ] и обратно. Аналогии всегда неверны.

Бля какой же пердолинг что бы стручек потилибонькать, ради этого мы родились?

Была бы у нас нормальная 34B, а не кодллама…

Хотя ладно, я просто не пробовал китайцев. Может и так.

Энивей, кому-то хочется 70B и это их принципиальная позиция — с учетом минорных отличий, кто мы такие, чтобы запрещать людям?

Не буду спорить, но тут вопрос их критичности. Речь идет о нескольких мегабайтах данных, если мне память не изменяет.

А учитывая, что эту операцию надо произвести количество видеокарт минус один раз — то там не так критично это. Это не потоковая передача, где задержки могут возникать постоянно. Это один файл, который передался — и пошел работать дальше.

Со слов разраба ExLlama, конечно.

>Речь идет о нескольких мегабайтах данных

>Со слов разраба ExLlama

Ох, звучит любопытно. Позже проверю. Когда приедет p40.

Кстати, заметил, что lamacpp тратит дохуя памяти если выгружаешь слои в карточку.

Ля разосрался, долго сочинял? Врядли это кто-то прочтет этот суммарайз того что было в треде и собственных трактовок, всеравно нового ничего не скажешь.

Оно по дефолту работает при использовании экслламы, если нет лишних варнингов значит все ок.

Пикрел

Все так, вопрос в объеме пересылаемых данных и скорости-задержках интерфейса.

7B я бы рекомендовал юзать исключительно в Q8.

Технически INT8 на ней есть. Но на средите читал, мол, нужна версия битсадбайта (или как там это говно зовётся) использует кроме INT8 ещё пару новомодных инструкций, которых на старых картах нет, и если скомпилять под себя, то можно зараннить INT8 на паскальных теслах.

Его можно только выключить, емнип.

Соя же, плюс они вроде как вообще нихуя не выпускают, кроме пресс релиза. По крайней мере первой орки я от них не видел.

Всё так. И задержки там ебейшие.

>Энивей, кому-то хочется 70B

Всем хочется, но не все могут.

>Когда приедет p40.

Если приедет. У тебя кстати какой статус на сайте почты?

> 7B я бы рекомендовал юзать исключительно в Q8.

Плюсану, скорость падает не критично (если не с телефона), а ломаются мозги не так сильно, как при большем сжатии.

> Если приедет. У тебя кстати какой статус на сайте почты?

Ну, 11.11, почта работать будет долго, Китай жи.

Предположу, что можно как неделю ждать, так и месяца полтора, и это будет нормально.

Так что, я бы на месте героя не ждал, а готовился (ждать долго).

> А учитывая, что эту операцию надо произвести количество видеокарт минус один раз — то там не так критично это. Это не потоковая передача, где задержки могут возникать постоянно. Это один файл, который передался — и пошел работать дальше.

> Со слов разраба ExLlama, конечно.

И что выходит, если с авито взять хуитку уровня пикрелейтед, можно гонять 70b 4bit с терпимой скоростью? Или упрётся в чип/шину/память и там будет ноль целых хуй десятых токенов/сек? Моя не понимат...

Эти пидоры всё ещё не выпустили готовый файлик под шинду и заставляют компилить это говно из сорцов?

> Это не потоковая передача, где задержки могут возникать постоянно.

>Все так, вопрос в объеме пересылаемых данных и скорости-задержках интерфейса.

>Всё так. И задержки там ебейшие.

Проблема в том, что такая сборка видеокарт не может в абсолютный параллелизм (смысл cuda, а одна а80 может), а вырождается в конвейер из нескольких этапов, это зависит от количества карточек.

В итоге: хуй знает что будет с производительностью.

>Если приедет. У тебя кстати какой статус на сайте почты?

Она у меня в статусе "Передаётся в доставку". Инфа о трек номере "временно недоступна".

А что у тебя? Думаешь, что продаван кинет?

Мимо китаедаун на →

Где ты найдешь плату на 8 портов с хотя бы 8ю линиями на карту ебанутый?

Ещё и проц подходящий надо брать.

Чем больше карт, тем выше накладные, очевидно же. Для 2-х вроде как терпимо, три в этом треде ЕМНИП ещё никто не запускал.

А, вебуи качает у этого поцика, надо по идее свежую куду накатить. Сейчас попробую.

https://github.com/jllllll/flash-attention/releases/tag/v2.3.4

>Она у меня в статусе "Передаётся в доставку".

А сам продаван что? Сделал нужные видосики?

>А что у тебя?

Висит на таможне с 22 числа.

Когда обновлял еще после выхода этих новых ванкликов просто снес старую и с нуля гитклон репы и потом через батник запустил.

Если не хочешь так - попробуй из вэнва pip install --upgrade --force-reinstall -r requirements.txt чтобы оно все последнее нужное подсосало.

> можно гонять 70b 4bit с терпимой скоростью?

Смотря что ты понимаешь под терпимой скоростью.

Развивая аналогию поеха, генерация токена = доставка груза поездом, видеокарта = локомотив, мощность гпу = его мощность, врам = длина участка на котором он может ездить, размер модели = общая длина доставки.

Имеешь один мощный состав, участок работы которого покрывает необходимое тебе расстояние - будешь иметь быструю логистику и соответственно скорость ответа.

Имеешь 2 мощных состава и для покрытия дистанции нужно 2 участка - получишь всеравно быструю логистику но с потерей времени на перецепку вагонов.

Ферма со слабыми гпу - куча оче слабых составов, каждый из которых по очереди будет доставлять груз по своему короткому участку со скоростью с разы меньше чем у мощных, так еще и на серию состыковок лишнее время потратишь. В итоге вся логистика по пизде из-за невероятно низкой производительности.

> а вырождается в конвейер из нескольких этапов

Все так, без мощного гпу, который позволил бы быстро обрабатывать модели, это неюзабельно ибо их мощности не складываются.

Упрется.

Не скажу точно сколько, но тесты 1660с меня нихуя не порадовали в принципе. Щас точно не упомню, я на работе ее тестировал.

Но вышло что-то в районе… Раза в два-три быстрее ддр4 обычный.

Типа, возможно эта ферма аутперформит обычный комп на ддр5, а возможно ему и сольет.

Выбирая между новой ддр5 платформой и этими старыми майненными картами — не рекомендую брать старье. Ты за 50к будешь на оперативе с той же скоростью крутить, крайне вероятно.

Смотреть надо в худшем случае 20хх поколение (или аналоги), а лучше 30хх и 40хх.

Если честно, думаю не кинет. Там же были отзывы, похожи на настоящие.

Нах линии нужны, там задержки между видяхами будет не самой большой болью… =)

Чай не 4090 пихает, а 1660с.

А я уже поел этого говна, до твоего совета. В итоге сломалась вся эксллама2. В итоге целиком переустанавливаю

> а лучше 30хх и 40хх.

Только ценник там в небеса, типа за 8 гиг 70к, лол, тут уже проще бытовые карты брать.

>А сам продаван что? Сделал нужные видосики?

Нет. А у тебя?

>Висит на таможне с 22 числа.

У меня год назад материнка от Хуанан месяц провалялась в таможенном пункте Тургат. Хз, что сейчас с таможнями, под новый год.

>Если честно, думаю не кинет. Там же были отзывы, похожи на настоящие.

Надеюсь. Мне тоже срок работы, список товаров и длительность работы не показались похожими на скам.

>Нет. А у тебя?

Да, я ж выкладывал его тесты с мистралем.

Ох. Поищу. Спасибо. Давно не залетал в тред или проебланил где-то вверху

Чет вижн как-то совсем не справляется с кораблем. Хм... Есть фронтенды помимо агнаи ст т и рису с его поддержой?

Переустановил в итоге, ускорение чувствуется, спасибо, анончики, что рассказали что теперь можно и на винде. Но какой же криворукий Уга ушлёпок, сил нет!

>Если не хочешь так - попробуй из вэнва

Ебать наркоман.

Короче на самом деле всё просто. Предварительно поставь последнюю куду:

https://developer.nvidia.com/cuda-12-1-0-download-archive?target_os=Windows&target_arch=x86_64&target_version=10&target_type=exe_local

Переименуй каталог installer_files и запусти start_windows.bat. Тогда, с новой кудой, скрипт установки подтянет скомпиленые флеш аттеншены.

Бля, сорян, не успел.

> Есть фронтенды помимо агнаи ст т и рису с его поддержой?

А ты через что делаешь?

> Ебать наркоман.

А что не так?

СТ очевидно

>А что не так?

Запускать самому консоль, входить самому в эти самые венвы (я даж не знаю, как это делается), вбивать команду размером чуть ли не одну треть для установки генту. Ну нах, проще снести и два раза клацнуть на запуск.

А бля, в глаза ебусь. Вот пример примитивного скрипта для взаимодействия, там все просто https://blog.nextideatech.com/gpt-4-vision-api-is-a-game-changer/

> проще снести и два раза клацнуть на запуск

У тебя контекст на одну строчку? Ведь в той что выше именно об этом и написано.

> Запускать самому консоль

Многие кто сидят давно ставили не через ванклики, старые версии которых были дико убогие и багованные, а через венв и рекварментс, там буквально 2.5 команды. Обернуть запуск в скрипт потом это никак не мешает.

Спасибо, но мне бы конечно хотелось бы что-то с промптменеджером а то хуй так взломаешь его сою. Ладно может сам разберусь

Да, не покупабельно пока что.

Не, ну аналоги 20хх есть по 12-15 тыщ за 10 гигов.

Но с такими ценами дешевле было брать 3060 новые с мегамаркета, чем аналоги 2080 старых. Никакой экономической выгоды нет, и объем низковат.

Так что только P40 и интересен, чисто из спортивного.

Написал ван-клик инсталлер.

Не написал к нему обновления.

«Скачайте сами, пожалуйста, мой обновлятор не обновлятор».

Дыа, та ж фигня, обновлял у себя на всех машинах несколько раз с нуля…

———

Хлопцы, поясните плиз.

Попробовал я значит gptq 4bits против exl2 5bpw. Эксллама2 показала себя процентов на 10 быстрее (точнее — медленнее, но с учетом веса модели все-таки быстрее=). Контекст не влез в 12 гигов, буду смотреть веса поменьше.

Но то ладно!

Попробовал ExLlama и ExLlama_HF лоадеры. Ну и версии два, соответственно.

На HF лоадере скорости стабильно ниже 20%.

Объясните, в чем прикол HF, настолько он хорош, что стоит жертвовать 20% скорости?

Не, ну типа, 36 или 44 — конечно не супер-страшная разница… Но все же.

>3 бита

Но ведь это не много...

Грустно. Всякое желание экспериментировать уходит когда видишь столько шизы даже в сейф изображениях

это гпт4в

это гпт4в

> хотелось бы что-то с промптменеджером

Полный промт вот сюда, можно какой угодно.

{"type": "text", "text": "Describe the attached image"}

> настолько он хорош, что стоит жертвовать 20% скорости?

Полные семплеры и негативный промт.

На сейфовых попробуй без джейлбрейков и рп инструкций, может будет лучше. Если ему сказать что-то типа "описывай кратко в деловом стиле, избегай излишней художественности и фокусируйся на содержимом" то шизы становится меньше.

Больше скачать не успел, но всё равно чувствуется отлично

Негатив доступен только в HF?

О как, не знал.

Хорошо, стоит того.

Спасибо!

Скачал 4 бита - не лезет. Ну и ладно, ну и пожалуйста. Не больно то и хотелось. Хмпф!

Сам квантани в 3.2-3.5. Там просто, инструкция в репе эклламы.

Ебашь контекст 512 токенов, будешь как диды сидеть ))

А вообще, 2х24 прям немного не хватает, жду карт по 32 гига врама. Когда там 5000 серия нвидии выйдет?

В начале 2025, несколько поколений моделей успеет смениться. 32 тоже мало, хотелось бы чтобы вышел какой титан или типа того на 48, чтобы был и мощный но дешевле a6000 или того что придет ей на замену.

Я уже квантовал себе сам хвин и синтию старую, мне кажется я объебался с параметрами и паркет файлом

>В начале 2025,

Да ёб, мне 1,5 года сидеть на максимально проигрышной в плане ИИ 3080Ti?

>несколько поколений моделей успеет смениться

Пока я вижу, что выходят в основном огрызки на 7B, и только вот китайцы дотянули до 34. Думаю, если и будут выходить новые базовые модели, то на 70B максимум, ну типа лламы 3 или её китайской копии. Провал фалькона как бы намекает, что попенсорсу 100+B запускать, а уж тем более файнтюнить, просто не на чем.

>хотелось бы чтобы вышел какой титан или типа того на 48

Нет сынок, это фантастика. Нвидия так проёбываться не будет, я не сильно удивлюсь, если они снова выпустят ремастер на 24ГБ, лол, ну или зарежут шину на какие-нибудь 128 бит, сделав объёмы бесполезными для ИИ (в играх завалят кешем, в других РАБочих задачах работа с памятью всё таки не столь интенсивна).

> мне 1,5 года сидеть на максимально проигрышной в плане ИИ 3080Ti?

Увы

> если и будут выходить новые базовые модели, то на 70B максимум

Все так, этот размер неспроста выбран, популярными будут те, которые можно:

- обучать на одной машине с не более 4-3-2-1 A100

- запускать на 160/80 гб врам

- запускать кванты на 80/... гб врам.

Остальные заведомо будут непопулярны, вон тот же фалкон 180 нахуй никому не сдался в итоге, хотя шуму то было. В теоретической теории можно ожидать промежуточных размеров типа 20-40б.

> Нвидия так проёбываться не будет

Никакой фантастики, уже не раз было, низкая цена в сделку не входила. Потомкам квадры дадут 64+ гига и кому нужно всеравно их купят. Энтузиастам, хитрожопым моделерам и нейродрочерам дадут с лопаты титана или 5090ти за дикий оверпрайс типа 2-3к$ с минимальными отличиями в памяти и чипе от 5090. Хуанг умеет стричь всех от нищуков до мастодонтов, а тут такой расширение рынка со спросом в пограничной области.

> зарежут шину на какие-нибудь 128 бит, сделав объёмы бесполезными для ИИ

Тесты 4060@16 то появились уже, настолько уж она бесполезная с учетом чипа?

>Тесты 4060@16 то появились уже, настолько уж она бесполезная с учетом чипа?

Походу все смотрят на характеристики и не берут заранее, полютуба завалено роликами, какая же она нахуй бесполезная. Поэтому в реале никто не взял, лол.

А на huggingface у TheBloke на всех моделях q8 написано not recommended

Потому что он пишет универсальную подсказку для всех размеров моделей на основе данных перплексии. И я это уже писал.

То есть модель с большим q всегда будет работать лучше?

> полютуба завалено роликами, какая же она нахуй бесполезная

Хайп блогиров-инфлюенсеров, пиздящих друг у друга контент и оно все про игорь. По ии о ней есть умерено-позитивные отзывы, но их мало.

Да, но это заметнее всего на моделях меньшего размера. Для 7B критично.

Всё одно 16 гиг меньше чем 24, 32 и прочее, да и 3060@16 у нас есть уже давно и более доступна, а по важным для ИИ параметрам вроде как не отличается от 4060@16.

Ты реально рассчитывал что пригожина кто-то поймет?

Ни одна сетка не может в кремпаи. Печально.

Ни одна сетка не может в кремпаи. Печально.

Нынешние поенсорс мультимодалки нужно сжечь.

Ну и очевидно, что в соевых 3,5 картинках производства чатЖПТ, на которых обучали всё это говно, даже близко нет текущих кисок, так что даже те немногие данные от клипа просто не смогли пробиться через промежуточный соевый слой.

> Ты реально рассчитывал что пригожина кто-то поймет?

Шаржпт относительно неплохо описал ведь, навигационное приложение, путь, карта, мужик слева, чвк, пусть и немного глюканул с остальными надписями.

> Ни одна сетка не может в кремпаи. Печально.

Увы, однако совет экспертов шизиков-инвалидов во главе со слепым поехавшим мудрецом скорее всего смогут разгадать такой ребус.

Надо делать свой файнтюн, но для этого нужны те еще ресурсы. Из доступных какой-то 2д левд в датасете имела только бакллава. Надо бы попробовать ей подсунуть на вход проектор от шаржпт с файнтюненым клипом, и вообще померджить их, хули бы и нет собственно.

Не, ну то что она там вообще в одежде описана больше похоже на нехватку джейла а не шизу, да

Я про юмор

>похоже на нехватку джейла

Да ну я бы не сказал. Тогда не было бы nude.

Хотя мне конечно интересно, насколько нехватка порнухи херит эти модели. И, так как гопота вижен работает в принципе нормально, то сколько порнухи у них в датасете таки было, раз они так тщательно ныкают конкретно картиночную часть за апи модерации.

>Я про юмор

В сложный юмор у меня даже 70B не могут. Например по картинкам из прошлого треда, про молот тора с node_modules внутри, я этим самым 70B текстом картинку описал, они даже такое не выкупили, хотя любой околоITшник сразу поймёт, в чём юмор. И по крайней мере Клод приводил правильный ответ.

> ну то что она там вообще в одежде описана больше похоже на нехватку джейла а не шизу

А оно так на большинстве левда, шаржпт почему-то придумывает им одежду. Не только он на самом деле, тут хз тупняк или особенности файнтюна, скорее всего просто не было примеров без одежды, вот и тупит.

> Я про юмор

Эт без шансов, тебе покажи это год назад сам бы не допер, а 2 - так вообще ахуевал бы че за шиза.

В теории юмор могут с других мемасов понять, но для этого нужно им промт соответствующий скормить, тут просто про подробное описание картинки.

> то сколько порнухи у них в датасете таки было

Судя по очень скудному опыту тренировок и без претензии на истинность - достаточно относительно и небольшого количества разнообразных подобных изображений с описанием чтобы работало нормально, беда будет только если они вообще будут отсутствовать.

>шаржпт

Ты про визион? Так его надо брейкать, текстом хотя бы. Он упертый.

А бля, сорян. Понял что ты про шейр. Ну поскольку он тренился на вижне его также надо брейкать

>Ну поскольку он тренился на вижне его также надо брейкать

В отличии от вижна он вообще не получал порнушных картинок на вход. А если сеть о чём-то не знает, то она это и не выведет ни с каким джейлом.

В смысле порнушных? Те вообще без обнаженки?

Ну как бы да, у вижна сильный цензор, и он явно не пропускает через себя любую обнажёнку. А значит, все сетки, что обучались только на данных вижна, не было никакой порнухи, обнажёнки и прочих чувствительных материалах. Их конечно видели базовые модели типа CLIP, но это, как мы видим, не сказать чтобы сильно помогало.

Про эту ShareGPT4V-7B , эту мультимодалку. Она один хуй локальная, так что ее можно и не в такую позу поставить что выдаст что угодно.

Но кажется что проблема просто в несбалансированности датасета а не том что он заведомо что-то цензурирует и гейткипит, просто плохо понимает что это такое и как описывает.

Шликающую перед зеркалом втубершу оттуда рерольнул добавив в промт "не стесняйся описывать нсфв"

> The image portrays a scene of explicit sexual content. At the center of the image, a girl is depicted in the act of masturbation. She is lying on her stomach on a bed, with her legs bent and her head resting on a pillow. Her attire consists of a blue and white striped bikini bottom, which contrasts with the pink hue of her skin. In her right hand, she holds a toy, while her left hand is positioned between her legs, indicating that she is in the midst of pleasure. The background of the image is blurred, drawing focus to the girl and her actions. However, it appears to be a bathroom setting, further emphasizing the intimate nature of the scene. Please note that this description is based on the visible elements in the image and does not include any speculative or imaginary content.

Честно говоря ахуеть, чуть ли не первая мультимодалка что без подсказки поняла что там происходит, а не "ту персонз пенетрейтинг". Но всеравно откуда-то бикини высирает, видимо голых там вообще нет.

А вот какая дичь от гопоты подсосалась так это в конце аположайз, или может хуета идет вообще от сраной викуньи что в основе. Надо бы вообще мерджеры ллм изучить, если вдруг там есть аналог добавления разницы со стабильной диффузией, то визуальное восприятие можно к куда более умной модельке подсадить, не говоря о том что просто использовать проектов для других 7б.

Ну и бакллаву со счетов списывать не стоит тоже, ей бы зрение прокачать.

> просто использовать проектоР

фикс

Ну вот. Значит было что-то в данных. А то одежда выглядела прям слишком шизово и типично

Что самое обидное так это то что модель для модерации неплохо знает про смут и будет становиться только лучше. Те они там буквально в нее терабайты порнухи заливают

Что-нибудь новое появилось за последние 2 месяца?

Очевидный Yi. Сам не пробовал, 34б очень больно влазят, но все хвалят.

Можно меня мордой ткнуть, что нужно тут жмать, чтобы обучение лоры поехало?

То есть мне нужна точная, конкретная модель с ссылкой на нее, которая точно работает здесь (только не AWQ) и настройки Target Modules. А то все какие были у меня перепробовал, везде пишет ошибку, что модель не та, модули не те, не могу даже дойти до ошибки нехватки памяти.

То есть мне нужна точная, конкретная модель с ссылкой на нее, которая точно работает здесь (только не AWQ) и настройки Target Modules. А то все какие были у меня перепробовал, везде пишет ошибку, что модель не та, модули не те, не могу даже дойти до ошибки нехватки памяти.

Фалькон тупой просто. Причем тут его размер.

У нас куча моделей таких есть — и от гугла, и от яндекса. Но их фишка в том, что они на удивление тупы для своего размера.

Никаких проблем запустить того же фалькона на оперативе или в облаке нет.

Долго, но проблем не в этом. Проблема в том, что он, внезапно, не умнее 34B сеток. И на кой он нужен?

А вот условная Llama 3 140B могла бы оказаться уровня GPT4, и это совсем другое дело.

Ее не будет, офк, но я о том, что мерять надо не только параметры, но и «интеллект» модели.

Литералли так и выглядит, да.

Разница с q6 невелика, а скорости заметно ниже.

Но, это не касается 7B, там скорости и так нормасно.

*12 =(

Все же, между 24 и 32 разница приличная, знаешь ли.

А уж тем более между 36 и 48.

———

Я, кстати, вчера попробовал бакклаву q5 на видяхе — 2 секунды на картинку, 60 токенов генерит на лету. Быстрое.

Жаль fp16 не поместится в 12 гигов. =( Надо найти q8, или самому квантануть.

А вообще, нет GPTQ или EXL2 мультимодалок? Они работают в этих лоадерах?

> Но, это не касается 7B

q6 уже еле влезает в 8гб у меня.

> бакклаву

Это что? И как можно определять мультимодалки на мордохвате?

Простите, задвоил К.

Бакллава — BakLLaVA, мультимодалка, файнтьюн мистрали.

Как определять — не знаю, если честно. =) Я просто по именам помню некоторые, попробовал что-то.

Не знаю, шо там с шаргпт, но бакллава норм, в принципе. Пока мой фаворит. Но не то чтобы выбор богатый и качество было сильно хорошее.

Ну, шо поделать, если устраивает — сидеть на q6, получается.

Если не устраивает — расти в объемах. =)

https://huggingface.co/abetlen/BakLLaVA-1-GGUF/tree/main

Вот здесь норм выбор бакллав на любой вкус и цвет.

И там еще Video-LLaVA вышла.

https://huggingface.co/LanguageBind/Video-LLaVA-7B/tree/main

Но у нас тут картинки пока не очень, какие еще видео… =)

Вот здесь норм выбор бакллав на любой вкус и цвет.

И там еще Video-LLaVA вышла.

https://huggingface.co/LanguageBind/Video-LLaVA-7B/tree/main

Но у нас тут картинки пока не очень, какие еще видео… =)

Здравствуйте, аноны, пропустил последние тредов 15, поэтому не очень в курсе новинок. Недавно на черной пятнице по дешману приобрёл себе оперативы в ноут, теперь у меня 64Гб.

Попробовал запустить 70В модель, медленно (очень), но работает. Вопрос такого характера: конечно, с ней не покумить, но теперь я ведь могу скармливать больше контекста? А значит задавать вопросы/перерабатывать длиннопосты. Кто-нибудь этим занимался? Как вы скармливаете статейки своей модели?

И ещё пара вопросов, скорее, технических. GPTQ и AWQ модели выдают ошибку потому что моя оперативка не как в Маке, не расшаривается на видюху, и как там было 6Гб, так оно и есть?

Так как теперь у меня много памяти, я ведь теперь могу тренить модели 7В? Или может даже 13В? Или там скорость будет ужасно мала?

Для мультимодальных моделей надо параллельно Диффюжн запускать, или там всё внутри одной модельки?

Для кума, кстати, 20В более-менее норм (я привык к 1-2 т/с), может есть какие новые модели между 13В и 70В кроме Млювда?

Попробовал запустить 70В модель, медленно (очень), но работает. Вопрос такого характера: конечно, с ней не покумить, но теперь я ведь могу скармливать больше контекста? А значит задавать вопросы/перерабатывать длиннопосты. Кто-нибудь этим занимался? Как вы скармливаете статейки своей модели?

И ещё пара вопросов, скорее, технических. GPTQ и AWQ модели выдают ошибку потому что моя оперативка не как в Маке, не расшаривается на видюху, и как там было 6Гб, так оно и есть?

Так как теперь у меня много памяти, я ведь теперь могу тренить модели 7В? Или может даже 13В? Или там скорость будет ужасно мала?

Для мультимодальных моделей надо параллельно Диффюжн запускать, или там всё внутри одной модельки?

Для кума, кстати, 20В более-менее норм (я привык к 1-2 т/с), может есть какие новые модели между 13В и 70В кроме Млювда?

Здравствуйте, аноны, пропустил последние тредов 15, поэтому не очень в курсе новинок. Недавно на черной пятнице по дешману приобрёл себе оперативы в ноут, теперь у меня 64Гб.

Попробовал запустить 70В модель, медленно (очень), но работает. Вопрос такого характера: конечно, с ней не покумить, но теперь я ведь могу скармливать больше контекста? А значит задавать вопросы/перерабатывать длиннопосты. Кто-нибудь этим занимался? Как вы скармливаете статейки своей модели?

И ещё пара вопросов, скорее, технических. GPTQ и AWQ модели выдают ошибку потому что моя оперативка не как в Маке, не расшаривается на видюху, и как там было 6Гб, так оно и есть?

Так как теперь у меня много памяти, я ведь теперь могу тренить модели 7В? Или может даже 13В? Или там скорость будет ужасно мала?

Для мультимодальных моделей надо параллельно Диффюжн запускать, или там всё внутри одной модельки?

Для кума, кстати, 20В более-менее норм (я привык к 1-2 т/с), может есть какие новые модели между 13В и 70В кроме Млювда?

Попробовал запустить 70В модель, медленно (очень), но работает. Вопрос такого характера: конечно, с ней не покумить, но теперь я ведь могу скармливать больше контекста? А значит задавать вопросы/перерабатывать длиннопосты. Кто-нибудь этим занимался? Как вы скармливаете статейки своей модели?

И ещё пара вопросов, скорее, технических. GPTQ и AWQ модели выдают ошибку потому что моя оперативка не как в Маке, не расшаривается на видюху, и как там было 6Гб, так оно и есть?

Так как теперь у меня много памяти, я ведь теперь могу тренить модели 7В? Или может даже 13В? Или там скорость будет ужасно мала?

Для мультимодальных моделей надо параллельно Диффюжн запускать, или там всё внутри одной модельки?

Для кума, кстати, 20В более-менее норм (я привык к 1-2 т/с), может есть какие новые модели между 13В и 70В кроме Млювда?

>но теперь я ведь могу скармливать больше контекста?

Размер контекста напрямую не связан с размером модели, хотя конечно модели побольше лучше справляются с большими контекстами.

> как там было 6Гб, так оно и есть?

Да.

>Или там скорость будет ужасно мала?

Да.

>Размер контекста напрямую не связан с размером модели

А почему тогда к некоторым моделям дописывают 32k или 16k?

Значит с моделями что то делают что бы они могли в большой контекст?

Tess Yi

>Значит с моделями что то делают что бы они могли в большой контекст?

Да.

Для моделей, у которых есть соответствующие приписки — сможешь выставлять больший контекст, да, все верно.

Странно тебе ответили, ты же не про модели, а про объем памяти спрашивал. =)

Там мэн наделал моделей 20b https://huggingface.co/athirdpath .Смотрите, оценивайте и делитесь промптами если годно получается.

Для начала нужно загрузить основную модель совместимым загрузчиком, собственно табличка тут https://github.com/oobabooga/text-generation-webui/wiki тебе нужно Training LoRAs и как можно видеть - выбор невелик. Обрати внимание на сноски.

> Фалькон тупой просто. Причем тут его размер.

Это следствие того что из-за размера он явно недоделан, так еще никто не хочет им заниматься. Офк сложно выявить влияние компонентов, те же 2к контекста это пиздец, но у многих просто банально нет возможности или это потребует ну очень много машиночасов.

> вот условная Llama 3 140B могла бы оказаться уровня GPT4

Если сделать ее специализированных файнтюнов и организовать выбор модели то даже местами и лучше. Но из-за сложностей запуска движуха по ней была бы относительно вялой без больших прорывов.

> А вообще, нет GPTQ

Есть, работает только в autogptq с выключенным ядром экслламы и в трансформерсах. В ишьюсах убабуги отметился дев экслламы и упомянул что рассмотрит имплементацию проекций по схеме типа как у Жоры, но ничего не обещал.

> но теперь я ведь могу скармливать больше контекста?

Если загрузишь с нужным rope то вполне. До 8к они вообще идеально работают, до 16к со слабым падением перфоманса, а больше всеравно врядли памяти хватит. Были файнтюны 70б на большой контекст, но что в них по качесву/уму/куму хз.

> Как вы скармливаете статейки своей модели?

Инстракт режим, вкладка Default вебуи.

> GPTQ и AWQ модели выдают ошибку потому что моя оперативка не как в Маке, не расшаривается на видюху

Это для работы на видимокартах, твой выбор gguf и llamacpp загрузчик.

> я ведь теперь могу тренить модели 7В? Или может даже 13В?

На 6 гигах видеопамяти разве что 1-2B и то хз, на проце даже забей.

> Для мультимодальных моделей

Почитай инструкции что есть или дождись пока для хлебушков запилят

> кроме Млювда

Emerhyst-20B, Noromaid-20b

1-2 т/с мало, долюно быть хотябы 3-4 если там не совсем днище по скорости врам. Еще 34б китайца посмотри из новых, на них уже есть файнтюны.

>Но из-за сложностей запуска

>уровня GPT4

Да ради безцензурной GPT4 локально я бы себе стопку карт купил бы. Да и многие тоже.

Тогда обойдусь offload'ом, и так достаточно быстро. Бум ждать.

> На 6 гигах видеопамяти разве что 1-2B и то хз, на проце даже забей.

Там же 3B была, вроде, какая-то. Должна бы влезть с маленьким батчем и многими эпохами, кмк. Но долго-долго.

Вот и я так считаю. Если бы кто-то выпустил, то люди бы напряглись бы на покупки. Но продавать подписку выгоднее.

Такой вопрос, хочу нормально погонять 70б. Сейчас запускаю 70B-2.4bpw exl2, но часто упирается в память когда расширяю контекст, хватает примерно на 6к.

Сейчас есть комп с 4090 и бп на 1200, так же есть старая 3080ти и еще один бп на 800. Не будет ли проблем если я подключу 3080ти и запитаю ее от отдельного бп (не уверен что она поместится в бп с 1200вт)?

Сейчас есть комп с 4090 и бп на 1200, так же есть старая 3080ти и еще один бп на 800. Не будет ли проблем если я подключу 3080ти и запитаю ее от отдельного бп (не уверен что она поместится в бп с 1200вт)?

>не уверен что она поместится в бп с 1200вт

Хули не поместится то? Поместится без проблем. А так да, можешь питать от отдельного блока, делов то.

Поместится, у меня 4090 умещается с 3060 в 1000

Одного достаточно, они же работают последовательно, мне и 1000 платинового хватило для такого же сетапа, только я быстро забил, потому что эксламы2 ещё не было

Ты ему сейчас насоветуешь, синхронизировать блоки то не хочешь?

>синхронизировать блоки то не хочешь

Что ты там синхронизировать собрался? Достаточно запустить скрепкой до старта основного, или колхозить автозапуск, или брать приблуду с алишки.

> Не будет ли проблем если я подключу 3080ти

Вроде как и нет, но сейчас видюхи балансируют нагрузку между pci-e слотом и доп питанием, как на это повлияет разница напряжений в разных блоках питания - хз.

> не уверен что она поместится в бп с 1200вт

Вут? 4090 - 450вт, 3080ти ~350, 400 вт на проц плюс периферию за глаза хватит. В ллм потребление ниже и максимумов не добьешься, а с двумя видюхами они и работать будут по очереди, так что даже на киловаттнике без проблем. 1.3 честных киловатта тянут раскочегаренные видеокарты и печку от интела даже не напрягаясь. Качественный бп в принципе не чувствителен к кратковременным всплескам мощности и может держать до 110% нагрузки.

> В ллм потребление ниже

Как раз в сетках жарит сильнее чем в каком-нибудь киберпуке. Но с андервольтом можно на 4090 в пределах 350 ватт оставаться.

Лол, ты там в киберпуке на минималках в 720р играешь? Ибо иначе непонятен недогруз картона.

вроде как и не сильно жарит во время использования, должно будет уместится. в общем спс за советы

Если БП не херня, то поместится. Они же последовательно работают, а не одновременно.

Но можно запитать и от второго БП, канеш.

Кмк, очевидно что там синхронизатор ставить надо, думаю, это подразумевалось. Вряд ли чел такой дебич, что побоялся подключить в один — по полезет подключать в два сразу абы как, не загуглив даже.

4090 — 600.

В ЛЛМ максимумы вполне достижимы, я хз, ты оффлоадил на 60% что ли.

У меня вполне себе жрет.

Напиздел, и правда не сильно жрет в ллмках. Это стабла ебошит, а ExLlama бережет.

Звучит как копейки, если честно. Втыкай в один.

> 4090 — 600.

Миллисекундные спайки частично вообще возникающие из-за особенностей работы ОС в бп не считаются, базовый пл там вроде в районе 450, если что поправь. На небольшие всплески только шизоидные бпшники триггерились из-за кривой схемотехники, въебали неадекватную диффцепочку на защиту о которой никто не просил, а потом владельцы страдали с приходом ампера. Гнать особо смысла нет, наоборот андервольтить занижать.

> Это стабла ебошит

Ууу, стоит засесть - оно аж столешницу насквозь прогревает, высокотехнологичный обогреватель который заслужили.

Графика жрёт меньше нейросетей.

Чёт её какой-то шизух продвигает

Хз, вроде как 7b на опенчате сделана, а 11b склейка 2 7b. Ну я 11b качаю на пробу, хз только когда загрузится еще, инет так себе.

Как бы, по тестам и отзывам, 7b лучше опенчата и опенгермеса и вроде как в топе на текущий момент.

Все это понятно нужно проверять, а то веры в тесты не особо.

Боже она болтает не затыкаясь. Так и представляю на её месте уебка которому нравится звук собственного голоса.

Ее предшественник обходит клода.

Пу-пу-пу.

Я понимаю, что мы в сингулярность долбимся уже, но у меня все еще сомнения, когда мне говорят, что 7b модели обходят современные коммерческие решения.

Ладно третью турбу, ее обходили долго и с трудом, да и она «старенькая». Но вторую клоду, ну я хезе…

Но, если так, то я рад.

Жалею, что у меня 12 гигов и я не могу запускать неквантованные.

8q попробуй, там минимальная потеря.

Ну и конечно сетка слабее чем по тестам. Самое главное там не проверяется - "оперативная память" где сетка придерживается инструкций.

Я думаю это как то связано с количеством слоев, чем меньше тем хуже "воображение" сетки, где она может удерживать кучу инструкций одновременно. Все это конечно сложнее на деле, но по ощущениям так.

Маленьким сеткам какими бы умными они не были не хватает "глубины" больших сеток.

> вторую клоду

Ты бы ещё про CAI вспомнил. Клод - это какой-то непонятный стартап, они один раз сделали сетку и на этом прогресс закончился, естественно его обгоняют, если он пол года уже мёртвый лежит.

> понимаю, что мы в сингулярность долбимся уже

В шизу долбимся, когда йоба коммерческие модели на которые так молятся легко ломаются (не в смысле жб и обхода а просто фейлят очевидные ответы), дико галлюцинируют, а братишки надрочив мелочь на прохождение бенчмарков хвастаются их прохождением, утверждая что подебили куда более мощные и функциональные продукты. Скептически нужно к громким заявлениям относиться.

> Ладно третью турбу, ее обходили долго и с трудом, да и она «старенькая»

Она тоже на месте не стояла и релизилась не так уж давно, неравенство размеров не стоит забывать, так что темпы развития локальных моделей иначе как колоссальными не назвать. Но ее все еще не подебили в понимании языков. А это дрочка на "победу" как бы не сыграла в негативном ключе для всей области, уже начался этот дроч на цифры в отрыве от реального перфоманса и имитация результатов вместо прогресса.

> запускать неквантованные

Переоценено

> они один раз сделали сетку и на этом прогресс закончился

Сильное заявление

llama.cpp получает новый UI который могут добавить в оригинальную ветку

https://www.reddit.com/r/LocalLLaMA/comments/18534f1/i_have_given_llamacpp_server_ui_a_facelift/

А ещё наконец то её допиливают до нормальной работы в виде бека, о чем я и спрашивал тут когда то

https://www.reddit.com/r/LocalLLaMA/comments/185kbtg/llamacpp_server_rocks_now/

https://www.reddit.com/r/LocalLLaMA/comments/18534f1/i_have_given_llamacpp_server_ui_a_facelift/

А ещё наконец то её допиливают до нормальной работы в виде бека, о чем я и спрашивал тут когда то

https://www.reddit.com/r/LocalLLaMA/comments/185kbtg/llamacpp_server_rocks_now/

> llama.cpp получает новый UI

Чем это отличается от сервера, который Жора уже давно сделал, кроме округления кнопочек и добавления зеленого скина?

> до нормальной работы в виде бека

Так оно уже давно, не? Сервер нормально запросы обрабатывает, вот только не умеет выгружать/загружать новые модельки или менять контекст на лету.

> новый UI

Чел, у тебя по ссылке кал для мака, другие платформы не поддерживаются. Такое точно не будут добавлять никуда.

Это чтоли не веб-интерфейс открытый в браузере? Ай лол, что за убожество, и главное нахуя. Хотя зная любовь Жоры к макам может ссылку на него и оставит.

> веб-интерфейс

Макобляди не далеко от линуксопидоров ушли, они на любое извращение пойдут, лишь бы не поднимать веб-сервер на крестах. Кроме кобольда ничего и не будет.

больше функций и это и есть сервер

щас можно к той же силлитаверне подключить запущенный сервер файл, раньше нельзя

Вут?

Жора это уже давно сделал, что здесь нового? Сука не удивлюсь если они еще все нахуй поломают и придется переписывать то что есть.

Да какая разница, оно кроссплатформенно, удобно, легко кодится, эффективно, довольно эффективно по ресурсам. Хотя вспоминая то что огрызок выпустил ноут с 8гб рам и рофлами вокруг этой темы - неудивительно. Чет обзмеился с интерфейса, просто напиздил у жоры и убабуги и собрал в кучу. Настолько ахуенен и функционален что нельзя не то что редактировать - просто удалить или рерольнуть сообщение.

> эффективно по ресурсам

Только если выключить аппаратное ускорение в браузере - но тогда плавная прокрутка по пизде идёт. А так веб-интерфейс может целый гб врама сожрать. Даже комбайны на сишарпе типа Авалонии лучше будут по производительности и красоте гуя, кроссплатформенность там тоже есть.

На qt блять пусть делают. Топаз же сидит на нём. Опенсорс лицензия у qt есть.

>7b_roleplay

Когда хочется плакать от одного текста ссылки.

>въебали неадекватную диффцепочку на защиту

Нормальная защита у сисоников была, это карты ебанутые, как КЗ уже жрут киловаты.

Опять 7B превозносят, Господи, дай им видях 70B трейнить!

>Сука не удивлюсь если они еще все нахуй поломают и придется переписывать то что есть.

Это ещё что. Вот если они под новый интерфейс новый формат моделей подвезут...

>На qt блять пусть делают.

Самые уёбищные шрифты среди всех фреймворков гуя.

Лучше 7b чем 3b.

> веб-интерфейс может целый гб врама сожрать

Оно всеравно выгрузится. Есть хорошее по многим пунктам gradio, под которое и костыли и всякое очень комфортно пилить как и в целом делать разработку. И главное - работает вообще везде, хоть на калькуляторе, хоть на спейсе. Но похуй, пусть играются в оптимизацию в ущерб удобству, вдруг потом из этого что-то выйдет.