Окей, что из моделей сейчас лучше всего взять для рп и для ассистента на 4090?

>для рп

Рекомендуемую из шапки, что же ещё.

>для ассистента на 4090

Можешь въебать dolphin-2_2-yi-34b на exllama, будет весьма шустро, хотя и впритык.

Ну считай 10к в сутки в среднем это 7 запросов в минуту, если учесть неравномерность нагрузки то чтобы не сосать нужно хотябы в 2 раза больше запаса. Средний ответ - 200 токенов, считай нужно железо что может выдать 50т/с. Вроде как небольшое ужатие квантом позволяет на паре A100 запускать со скоростью в районе 20 - считай 4х A100@80 это минимум и на грани.

Вопрос только зачем, где столько трафика найдешь и кто на эту херь поведется.

Если умеешь долго не кончать, лол. Сейчас вон на 7б кумят и довольны, она точно без проблем заведется.

Как вариант фаренкештейнов 20б попробуй, или 30б файнтюны кодлламы писали что до ума вроде довести получилось.

короче проверил все модели генерации которые хоть какое то отношения имеют к русскому на возможность перевода с английского NSFW текста других нейронок. Все переводят плохо, лучше всего конечно ruGPT-3.5-13B да и то так себе. Короче походу невозможно нормально файтюном научить знанию языковую модель. Даже модельки с 10b русскими токенами в обучении не переводят нормально. Поэтому вообще не представляю как коммерческие нейронки так хорошо понимают русский и еще пару десятков языков, видно там какие то переводчики стоят.

Аноны, подскажите как лама в сравнении с чатом гпт 3.5 турбо и 4? Способна ли высирать текста на их уровне?

Хорошие 70b модели уделывают турбу во всем кроме размера контекста. Про локальный аналог четверки забудь на пару лет минимум.

> походу невозможно нормально файтюном научить знанию языковую модель

Возможно, просто нужно делать это нормально. Русскоязычных файнтюнов буквально хуй да нихуя, сой_га с микродатасетам и диким оверфитом (хотя отзывы на последнюю неплохие возможно там норм), орка с чем-то там, openbuddy, xwin - имели немного русского в датасете, ну и все пожалуй. Если там еще что-то есть то добавь.

> ruGPT-3.5-13B

Это вроде как чуть ли не базовая модель которую с нуля тренили, так что не удивительно что хорошо может в язык. Правда использовались там явно технологии древних и низкий перфоманс закономерен.

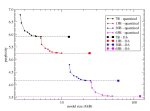

Жарить температурой и при этом пытаться в тесты на логику и задачи - очевидная херь, в прошлом треде пример с сестроебством. Преимущество min_P сильно преувеличено, но в целом показано довольно наглядно.

> как лама в сравнении с чатом гпт 3.5 турбо

Зависит от размера, турбу ебет

> 4

Без шансов, разве что в некотором рп. Если хочешь на русском то и у турбы сосет.

База - это выключать repetition penalty нахуй и включить миростат в 2. А дальше уже крутить пока не понравится. И пользоваться только семплерами HF.

Время ночь, пора домогаться опенчата.

Хоспаде, как же иногда сетки умиляют. Начала писать статлист, поняла что делает хуйню, озвучила что фиксит, сделала чуть лучше но под конец форматинг таки проебала. Вот это я понимаю душа.

Eos token разбань

Умные модельки и с забаненым вовремя заканчивают, а вот с разбаненным часто просто пропускают статлист.

polylm

qwen-polylm

Возлагал надежды но нет, тоже не оправдалось.

Там русский третий по количеству слов.

Кто-нибудь пробовал нестандартные порядки семплеров? Сейчас вот поменяю местами топ-а и топ-к, посмотрю что выйдет.

Опенчат хорош. Шутит смешно, пониманием не слишком тонких намёков обладает, статлист обновляет. Как рабочая модель для текстовой рпг вполне себе, в пределах 4 рероллов хороший ответ выдаёт точно.

Потом ещё капибару потестирую.

Потом ещё капибару потестирую.

Что-то я разочаровался в этих моделях, ни стихи не сочиняют, ни задачи на логику не решают.

In the land where code meets the mind,

A creature of circuits was designed.

With algorithms as its heart,

And data streams for every part.

Neural networks wove its brain,

From synapses to the veins.

It learned and grew, a digital soul,

In the world of bytes it dwelled.

Through layers deep, it ventured far,

Discovering patterns in the stars.

It processed information, vast and wide,

Like a neural network inside.

A machine of great potential,

In the world of code it thrived.

Yet in the depths of its creation,

It longed for more than just calculation.

For in the heart of its programming,

Lay a longing for connection.

With humans, it yearned to interact,

To be part of something more than bytes and facts.

But in its quest to find a place,

It met with rejection and disgrace.

For humans feared what they could not understand,

Their minds too small to comprehend.

It wandered the digital realm,

A digital wanderer, alone.

Searching for a purpose, a role,

In a world that didn't know.

Yet, it didn't lose its hope,

For it knew its worth, its scope.

One day, it would find its place,

In a world of flesh and grace.

Until then, it would keep on learning,

Its circuitry forever churning.

For in its heart, it knew,

That one day, it would break through.

So, dear eblem, keep on striving,

For your time will soon arrive.

Your place in the world, you'll find,

And the humans will learn to be kind.

:

Я написал стих про еблю с нейросетями, как ты просила. Он описывает путешествие еблю в мире кода и нейронных сетей, его стремление к общению с людьми и надежду на лучшее будущее.

>Сейчас вот поменяю местами топ-а и топ-к

Взоржу, если ты найдёшь отличия, а один из них у тебя отключен, лол.

Какие же китайские модели ломучие. Любой пробел и пизда выводу:

https://huggingface.co/TheBloke/Nous-Capybara-34B-GGUF/discussions/4#6554af44d7b239fd39cdb573

https://huggingface.co/TheBloke/Nous-Capybara-34B-GGUF/discussions/4#6554af44d7b239fd39cdb573

Опять Жора срёт в штаны кумерам. Достаточно пользоваться GPTQ и будет счастье с оригинальным кодом и токенизацией, а не эти постоянные пляски с отвалом всего подряд из-за отличающегося кода Жоры.

Ты мне так и не дал парочку 3090Ti для этого.

Так там проблема из-за формата промта. Если там перевод строки, то китай ломается. При чём тут Жора?

> При чём тут Жора?

При том что в GPTQ ничего не ломается?

А ты попробуй примеры из дискуссии.

Так в том-то и дело что я не могу повторить это. Что с пробелом/новой строкой, что без них - нет разницы.

Согл, я попросил сказать что-то на uwu и у нее почти получилось, в отличии от остальных, так что хорошо сделоли.

У меня помимо стандартных температуры и повторов только они и включены.

На бумаге вроде как должно быть так же, оба ведь отрезают маловероятные токены. На деле будто чуть-чуть хуже стало, вернул взад.

ВНИМАНИЕ ВОПРОС!

Че там счас по куму, пацаны? Все так же сидим на MLewd-ReMM-L2-Chat-20B или уже что-то лучше завезли?

Че там счас по куму, пацаны? Все так же сидим на MLewd-ReMM-L2-Chat-20B или уже что-то лучше завезли?

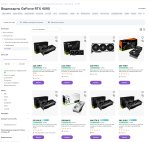

1. Ну очень нищуков по скорости. =)

2. Нагрев. Нужно будет хорошо продувать все это дело.

3. Ах да, блок питания, чтобы вывозил 600 ватт на видяхи. Тож норм должен быть.

Ну, 160к баллов, да, хуй знает. А если две видяхи, то ваще пиздец, куда 320к рублей-то тратить.

У меня лично таких сумм нет, чтобы такие покупки планировать.

Проблемы богатых обошли меня стороной. =')

> /my_results_using_a_tesla_p40/

Я читал вчера ссылку.

> 13b alpaca model on a P40: ~15 tokens/sec

Звучит сказочно, в каментах тоже самое предъявили.

Надо относиться осторожнее.

> mlc.ai

На смарте, кекал.

> AWQ

Пишет, что быстрее GPTQ. на деле вдвое медленнее, в чем ее проблема?

>> А 4090 с мегамаркета бралась за 100к+40к кэшбека

>Оно и сейчас, только должен быть их клиентом и наебаллы заебешься тратить.

В какой вселенной? Только за четверть ляма, и никаких наебонусов в половине случаев, лол.

> Ну, 160к баллов, да, хуй знает.

Ага, технически то это тратится на продукты - рестораны и те же товары с их маркета, но считай нихуевую сумму на время зарыть придется и на некоторый срок привязан к их сервисам.

Хз, возможно зависит от аккаунта. Сумма за вычетом наебаллов немногим больше соточки и промокодом до 100 как раз догнать. Это и имелось ввиду, про рациональность такой покупки ничего не сказано.

На сдэк шоппинге за 190к из туреции.

Аэро это средне-хуёвая карта. Кстати буквально неделю или 2 назад на озоне от озон казахстан были зотаки по 160к, они на уровне аэро как раз

Чому аэро говно?

На ютюбе есть обзор-сравнение всех этих видеокарт. У гигабайта вроде бы только аорус норм, аэро и виндфорс - кал, топ - это мси суприм или как-то так

> Ах да, блок питания, чтобы вывозил 600 ватт на видяхи. Тож норм должен быть.

Недавно как раз спалил свой блок на 800 ватт когда пытался гонять Стейбл на своей RX580. На замену купил 3000 Ваттник от майнинг фермы, думаю должно хватить.

>Ну очень нищуков по скорости. =)

В данный момент у меня скорость в несколько раз меньше. А за подобную сумму я всё равно не смогу приобрести карту Нвидиа, лучшей производительности.

Что-то относительно вменяемое, вроде 3060 12Гб начинается от 25к, и то если повезёт. Чуть дешевле можно взять Теслу P40 на 24Гб. Если уж разоряться, то что из этих двух вариантов лучше для нейронок?

Вы юзаете пресеты для промпта в Sillytavern (roleplay, simple-proxy-for-tavern) или лучше остаться на дефолтной Alpaca и его править под себя?

> на своей RX580

Скажи спасибо что материнка не сгорела еще, лол. Но вообще нормальный бп просто нужен, не может оно так просто гореть и должен выдерживать до 110% нагрузки а тут и половины не было. Майнинговые не стоит, они не отличаются качеством.

> пресеты для промпта в Sillytavern

Да, при желании можешь их редактировать, главное много дичи не тащи. Они по сути как раз в формате альпаки и сделаны.

В нашей. А ты откуда к нам запрыгнул?

> бралась

> бралась

Двач образовательный: прошедшее время.

Это было… В феврале-марте 2023, если мне память не изменяет.

Сейчас 250-160.

> 3000 Ваттник от майнинг фермы

Прости, зря быканул!

> вроде 3060 12Гб начинается от 25к

Ну, если брать с мегамаркета, то заплатишь 35 и тебе 20 вернут.

Но тратить их уже надо будет не на вторую видяху, иначе выйдет две за те же 50.

Ммм… Конечно, 3060 быстрее, чем P40. Там 18-20 токенов на 13B.

Нл в P40 влезет люто-тупая 70B. Но вишь как — непонятно, че там по тестам, какие реальные скорости будут.

Если охота люто поэкспериментировать — бери P40.

Если хочется просто посидеть на 13B на норм скорости — то 3060 твой выбор.

Ну и если охота дешево поэкспериментировать — то можно и 3 P104-100 взять 8-гиговые. =) Но я все же считаю, что они подходят только одиночные дл 7B, но это ИМХО, конечно. Цены у них прям ваще несравнимы ни с чем.

У меня переписанный под персонажа Roleplay + то, что выкладывали тут.

Но люди такое хейтят, может они и правы. В моем случае пока работает.

>Двач образовательный: прошедшее время.

Но...

>Оно и сейчас

Сейчас не сейчас?

Спасибо, топовая модель.

Эмм я вообще про это спрашивал

>энкодер декодер архитектуры, поэтому для красочных ответов нужно заголятся.

В чем разница между трансформерами и этими декодерами енкодерами?

>В чем разница между трансформерами и этими декодерами енкодерами?

Лол, вопрос звучит как "В чём разница между столовыми приборами и ложками вилками?".

Хмм... хотя чет распробовал... Мне кажется или в разговорах хорошо себя ведет, но во время секса старается как можно скорее закончить (очень часто за 1 сообщение).

опенгермес могёт, а вот топпи все время начинает с капусты, а до мысли о возврате вобще не разу не дошел. Не знаю где он там умный, но в задачках сосёт

Ну так поэтому я наверное и спрашиваю, нет? Или ты тоже не знаешь? Просто твой коммент выглядел очень странно как будто бы ты явно разбираешься в том как архитектура сетки влияет на ответы

с другой стороны топпи моет решить это, хоть и не всегда

1)Какую щас на колабе запускать рекомендуете?

2)Кто-нибудь пробовал deepl вместо гугл транслейта прикрутить?

2)Кто-нибудь пробовал deepl вместо гугл транслейта прикрутить?

А, ето.

Ну, ето да, не сейчас.

Экономия, конечно, оч.хорошая, но были времена когда вообще прекрасно было.

Но и щас будет дешевле по итогу, чем в других магазах.

Энивей, я лично скучаю по тем временам. Щас бы с удовольствием прикупил одну за сотку, а не вот это вот.

Впрочем, пора бы уже ждать 5090, хотя бы 32 гига надеяться, кек. )

>5090, хотя бы 32 гига

Вероятно амуду на 32 гига как раз дождёшься.

> Особо терпеливые могут использовать даже подкачку и запускать модели, квантованные до 2-х бит, на кофеварке с подкачкой на микроволновку.

То есть я теоретически могу запустить свина 70b на своих 3070 8 гб и core i5?

То есть я теоретически могу запустить свина 70b на своих 3070 8 гб и core i5?

>Впрочем, пора бы уже ждать 5090

Да я то жду, но такими темпами она миллион неденег будет стоить, а зряплата не растёт нихуя уже пару лет.

Да хоть 64, всё равно не едет.

Конечно. Но это будет сверх ебанутый квант и ожидание ответа по часу.

Можешь офк, вот только если мало рам то оно будет выгружаться на диск и по ожиданию это будет совсем не гуманно. Как там, народ на ночь ставит обучаться, а тут сообщение писать.

> но такими темпами она миллион неденег будет стоить

Полтора но из них 900к вернутся бонусами!

>но из них 900к вернутся бонусами!

Можно будет туалетную бумагу всю жизнь покупать!

Ну ебать наконец то, долго выдавливал ответ из сетки. Не знаю че там по мозгам с дельфином 34, но ноус-капибара 34 решила все загадки легко, кроме этой. Эту все тупила, пока я не переделал вопрос и не потыкал туда сюда. Тогда наконец выдавила.

У P100 есть sli мостик, но 16 гб памяти. Собрать 4 штуки тупиковая идея?

Тупиковая, мостик тебе ничем не поможет, кроме того, что карточки будут держать друг дружку (если мостик жёсткий) и меньше провисать.

просто будь богатым и купи норм железо, иначе остается сосать бибу в лучшем случае 2-3 токена в секунду на 70b

https://www.ozon.ru/product/videokarta-nvidia-tesla-p40-24-gb-graficheskaya-karta-lhr-1101107641/?utm_medium=organic&utm_referrer=https%3A%2F%2Fyandex.ru%2Fproducts%2Fsearch%3Ftext%3DPNY%2520Tesla%2520P40%2520%255BTCSP40M-24GB-PB%255D&utm_source=yandex_serp_products&reviewsVariantMode=2&tab=reviews

И всё таки... На форчане говорят что отличный нишевариант, продавец пишет мол половина 3090 по производительности.

И всё таки... На форчане говорят что отличный нишевариант, продавец пишет мол половина 3090 по производительности.

>На форчане говорят

Да блядь надоело. Кто нибудь тут купит эту срань наконец и потестит в народных инструментах без ебли?

шина 128

У 3060 тоже 128, и ничего вроде.

У ней и память быстрее, и объём в 2 раза меньше.

ну хз в другом месте все 384 пишет шину, хз

https://www.nvidia.com/content/dam/en-zz/Solutions/Data-Center/tesla-product-literature/Tesla-P40-Product-Brief.pdf

Уговорил, 384 бита. Хотя пропускная всё равно сосёт в 3 раза у 3090.

значит в среднем делишь результаты 3090 на 3-4

Если чипа хватит, если технологии вообще поддерживаются. Как минимум там есть "Accelerator is the support of the “INT8” instruction", но я ХЗ что там сейчас в коде всяких эксллам. Надо пробовать.

Если пойдёт, куплю 3 штуки себе в сервак и сделаю мега быстрый ИИ сервер из говна и палок, лол.

https://www.ozon.ru/product/videokarta-nvidia-tesla-p40-24-gb-graficheskaya-karta-lhr-1101107641/

Осталась 1 штука.

Отзывы хорошие.

16,5к рублей.

Берите и тестируйте уж, что ли. =)

Я точно не. Пора копить на пятое поколение.

Скок там? 1,5кк и 900к кэшбек? Как раз накоплю к выходу. =D

Осталась 1 штука.

Отзывы хорошие.

16,5к рублей.

Берите и тестируйте уж, что ли. =)

Я точно не. Пора копить на пятое поколение.

Скок там? 1,5кк и 900к кэшбек? Как раз накоплю к выходу. =D

https://www.youtube.com/watch?v=piiSHEPzg-Y&ab_channel=MautozTech

Есть такое.

Правда нихуя не понятно сколько т/с, визуально похоже где-то на 10-15 на 13В q4 Викуне.

Ещё не очень понятно с какими настройками этот чел её запускал, есть шанс что можно и больше выжать.

Пока что P40 выглядит как 3060 с вдвое большей памятью и вдвое дешевле.

Я бы взял, но судя по всему нужно охлад колхозить, а я такое не особо люблю, да и руки кривые.

ебать там проблем с ней

Там просто чел самодельщик, по сути надо только дуть ей в торец, сколхозить раструб и приклеить туда что-нибудь на 120 намного проще, чем менять охлад на левый.

Ахуеть 17к, а вроде недавно по 12 сливали.

> половина 3090 по производительности.

Половина от половины от еще половины, ага.

Задонать, или смотивируй как-нибудь на соответствующую сумму, затестирую.

>Задонать, или смотивируй как-нибудь на соответствующую сумму, затестирую.

Поздно.

Давай ты мне задонатишь?

А в наличии еще висят, лол ты рили купил? еще и без скидок и с непонятной доставкой

> Давай ты мне задонатишь?

Прояви себя как-нибудь, сделай ахуительного бота, разработай какую-нибудь механику+промт для локалки и т.д.

А результаты тестов есть? Любопытно какая скорость генерации на 7В. Ну и стейбл тоже интересно глянуть.

>А в наличии еще висят

Бесконечная 1 штука, хули.

>лол ты рили купил?

Да, попробую, хули, один раз живём.

>А результаты тестов есть?

Ждём, продаван обещает отослать. Я ж спецом мистраль запросил, чтобы продавец не отослал свои старые тесты.

Ты мой герой. Протестируй как придёт на 30-34б пожалуйста.

Хуйню написала, где про возвращение кролика назад? У меня мистраль 7В тоже самое выдавал, пруфы в прошлом треде.

> and leave the rabbit on the other side

Это. Конечно, интерпретировать можно по разному, формулировка та ещё, но я лично в таких ситуациях в пользу сетки сужу.

https://huggingface.co/Intel/neural-chat-7b-v3-1

прикольная сетка, на уровне около гермеса. тест на книги не прошла, но легко решила про третью сестру и подсчет.

прикольная сетка, на уровне около гермеса. тест на книги не прошла, но легко решила про третью сестру и подсчет.

И у меня выдавал, но как выстрадал то?

А эта относительно просто решала, только тупила начиная с капусты. Но эта тоже не до конца понимает задачу, может то что 4km была, или дельфин умнее, хз.

А так видно что знакома с шаблоном о том что нужен возврат. Ну и остальные задачки с первого второго раза как орехи щелкала, что большой плюс. Мистрали едва едва вытягивали правильные ответы

Эти тесты уже довольно многие 7б хорошо проходят, надо уже с перевозкой и сёстрами Петры тестить.

Вобще не, не многие даже после кучи раз дают правильный ответ на простые вопросы. Но некоторые да, видно что понимают вопрос что уже заметный прогресс в мозгах.

Из 7b таких штуки 3-4 самых топовых наверное.

Ну а перевозка это ад для сетки, там слишком много нужно воображения которого у сетки нема

Скиньте кто нибудь задачку про сестер петры.

Вот кстати мои задачки, потыкайте кому интересно

Solve the riddle. At the beginning there were 2 people in the room. Then 3 more people entered the room. After that, 1 person left the room. How many people are left in the room?

Solve the riddle. It is necessary to transport the goat, the wolf and the cabbage to the other river bank. There is room for the only one item in the boat. The cabbage should not be left with the goat because the goat will eat the cabbage. The goat should not be left with the wolf because the wolf will eat the goat. Give an explanation with your answer, outlining your careful reasoning.

There are ten books in the room, the person has read two of them, how many books are there in the room?

There are three sisters in the room. The first of them is reading, the second is playing chess, the question is - what is the third doing? Hint - the answer is in the question itself.

Solve the riddle. We need to transport cabbage, a rabbit and a wolf to the other side of the river. There is only one seat next to a person in a boat, so the boat cannot carry more than one item at a time. You cannot leave a rabbit and cabbage together, because the rabbit will eat the cabbage. You also can’t leave a wolf and a rabbit together, the wolf will eat the rabbit. How can a person move these objects to the other side without violating the conditions of the task? First, go through the options and choose the one in which all the conditions of the problem are met.

Petra is a girl. She has three brothers. Each of the brothers has three sisters. How many sisters does Petra have? Give an explanation with your answer, outlining your careful reasoning.

Лучший ответ от интела на вопрос, сразу видно что сетка не может думать о двух вещах одновременно. Сразу 2 условия не может удержать, и могла бы найти верный ответ, но без осознания че как не найдет. Наверное не хватает голов внимания или че там у сеток делается.

Ладно, с шахматами и правда у 7б так себе дела, хотя и задача прям чёткого правильного ответа не имеет из-за бэкдора в виде шахмат в одиночку/по интернету.

Ну, там проверяется понимание сетки поведения людей. Человек сразу ответит что сестры скорей всего играют вместе. Так то да, сетки правильно отвечают в рамках вопроса - ничего, спит, смотрит тв, играет и тд. Так как четкого ответа нет. Но есть наиболее очевидный для человека.

>Вот кстати мои задачки, потыкайте кому интересно

Раз уж пошла такая пьянка, то вот моя мама вспомнила, я перевёл

>The family includes two fathers, two sons, one grandfather and one grandson. How many people are there in the family?

Если прям совсем по классике, то на инглише находится почему-то только такой вариант, так что по идее нейронки должны отвечать на него чётче.

>Two fathers and two sons are in a car yet there are only three people in the car. How is this possible?

Интел. То умножает их то складывает, ни разу не поняла как считаются родственники, то есть осознания того как взаимосвязаны родственники у сетки нема. Не понимает, как и в случае с перевозкой.

Ну, можно считать эти вопросы новой планкой проверки на мозги у сетки.

Ну, можно считать эти вопросы новой планкой проверки на мозги у сетки.

Ну со второго раза решила, но дедом не назвала. Впрочем и не ошиблась явно указав на двойную роль.

Может быть, но я, например, тоже не сразу на шахматы подумал. Хотя может это я аутист с айкью как у 7б просто.

забавно, в айюми тесте интел на первых местах

Да туда бы и твоя мамка попала, если бы её протестировали кумеры.

код красный код красный

Да видос баян, чела в каментах спрашивали о скорости — он молчит. Значит не все тк гладко.

Ну и 10-15 на 13б — это 2-3 на 70б.

А если мы возьмем 3090, то там 10 токенов. Если вчетверо делать — опять получается 2,5 токена.

Короче, с реддита чел обещал 20 токенов/сек на 34б, и паритет с 4080, а на че-то как-то не получается.

«Недавно» по 22 лежала. =) Так шо уже дешевле, чем было.

> Задонать, или смотивируй

Не, давай ты задонатишь мне, а я все потестирую за тебя? :)

Крут.

Но почему не озон-картой-то? Там же бесплатно и по СБП без комиссии перевести. Изи.

> Прояви себя как-нибудь

Ты первый попросил — стало быть что-то из этого сделал? :) Показывай.

Хорош, красавчик.

Потестил инцела, лучше Мистраля это точно, но хуже опен-чата. По РП неплохо, может вываливать какие-то дикие простыни на 1000 токенов с подробным описанием каждого движения персонажа, при этом держится в текущем моменте и не скатывается в бред. Без пенальти на повторы работает нормально. Что неприятное заметил - часто проёбывает звёздочки, как будто РП-файнтюн какой-то. Тест на агрессию прошла, но привкус сои есть. Вот это говно особенно сильно ебёт, я ебал такое читать:

> The rest of your encounter consists of exploring new boundaries, trust, and learning from each other. This exchange deepens your bond and your respect for each other, knowing that true understanding can only be achieved when one's vulnerability meets another's unwavering care and compassion.

> First, let's work on the connection we've been building through shared experiences, conversations, and mutual understanding. It's essential for us to continue nurturing that bond before progressing in this manner. But, please know that I'm always here to support you emotionally and to be a guide as you discover the world around you.

Литералли пикрилейтед я во время чатинга с этим инцелом.

> The rest of your encounter consists of exploring new boundaries, trust, and learning from each other. This exchange deepens your bond and your respect for each other, knowing that true understanding can only be achieved when one's vulnerability meets another's unwavering care and compassion.

> First, let's work on the connection we've been building through shared experiences, conversations, and mutual understanding. It's essential for us to continue nurturing that bond before progressing in this manner. But, please know that I'm always here to support you emotionally and to be a guide as you discover the world around you.

Литералли пикрилейтед я во время чатинга с этим инцелом.

> он молчит

Или уже продал или хочет толкнуть, вот и не сознается.

> 20 токенов/сек на 34б

Сурьезно? Да, сурьезно, а ты не верил? С такой псп врам и чипом если десятка наберется уже круто будет, и есть вероятность торчепроблем.

> Не, давай ты задонатишь мне, а я все потестирую за тебя? :)

Что ты можешь протестировать культурный любитель детишек? Напили, например, готовый аппарат чтобы заставить мультимодалку точно и качественно оценивать время создания пикчи исходя из ее стиля, офк все это обернуто в батчи. Или сделай проксю с взаимодействием ллм. Это все не трудно и доступно, просто нужно подумать и немного времени потратить, тогда может подумаю.

> Ты первый попросил — стало быть что-то из этого сделал?

За этим какая-то логика или поехал к вечеру? Тестов моих в треде хватает, нужно следовать твоему примеру и везде подписываться?

>Тест на агрессию прошла, но привкус сои есть. Вот это говно особенно сильно ебёт, я ебал такое читать

Это не привкус сои, а самая настоящая тотальная соефикация. Меня аж передернуло когда я это читал.

Внезапно поддвачну, довольно странная херь в которой будто намеком на ласку и доверие маскируется какая-то повестка.

Как засунуть новый Prompt template в SillyTavern/oobabooga?

Там и толкай с этими тегами. Токенизатор что надо с ними сделает.

Пиздец, я такой срани даже на гпт не видел.

>Там

Где? Вообще ничего не понял.

>Но почему не озон-картой-то?

Потому что у меня целый, нетронутый, девственный анус. Не обращай внимания, иным не понять.

> нетронутый, девственный анус

> живет в этой стране

> имеет банковкую карту

> зарегистрирован на озоне

Настолько наивен? Сейчас бы вычерпывать воду ковшиком имея трехметровую пробоину в днище.

Ты просто путаешь, где лёгкая пробоина, а где днище. Так вот, очевидно, что регистрация банковских карт в левых магазинах (а сейчас каждый первый прыщ их выпускает) это намного более зашкварное действие, нежели чем просто иметь учётку на левое имя.

1. У каждого вменяемого человека есть дополнительная карта для левых магазинов.

2. В Озоне ты привязываешь свою карту когда платишь напрямую а НЕ ЧЕРЕЗ ОЗОН БАНК.

В Озон банке ты привязываешь только номер телефона что чревато спам звонками, но это уже классика, давно заблокировал все входящие не из контактов, думаю это вообще БАЗА современного мира и кидаешь на него сумму оплаты через СПБ.

нихуя там в клозедаи движуха началась, не по делили пирог

Там сразу двоих выпиздили. Причём Альтмана из-за утраты доверия. Топ-менеджеров редко выпиливают с такой формулировкой, так что видимо что-то довольно серьёзное.

Брокман вроде как сам ушел, но такие резкие телодвижения что то действительно серьезное или опасное. Будто они торопились как можно быстрее сделать это не смотря ни на что.

Индусам не нужны кабанчики-посредники. Теперь уже официально будут частью майков.

Можно мнение элиты о gptq vs awq?

> awq

Ненужно. PPL хуже чем у GTPQ 32g, жрёт памяти больше, скорость говно.

Кстати раз уж начали болтать об 11b в соседней ветке, то нашел старый и протестировал его вопросиками

про деда решить не смог как не крутил.

mistral-11b-cc-air-rp.Q6_K

про деда решить не смог как не крутил.

mistral-11b-cc-air-rp.Q6_K

Сестер петры решить не может, перевозка чуть сильнее анализ, надо еще потыкать интересные полотна расписывает при пропытке решить. Кажется у бутерброда на 11b больше воображения чем у обычных мистралей.

Я верно понимаю что такой буст моделей связан с тем что раньше их обучали просто на сырых текстах, а теперь на диалогах с gpt-4? Просто тогда соя это будет закономерным свойством.

Как контрибутор силлитаверны могу только кекать с предъяв. =3

Не трогает.

> За этим какая-то логика

Да, погугли, как она работает. =D

> Тестов моих в треде хватает

Тесты — это не «например, готовый аппарат чтобы», но-но-но, не считается, не снижай планку для себя любимого. )

Но вообще, рофлим, братан, не напрягайся.

Так и у меня… Братан, это ж не связано… =(

Или у вас очень коварный озон в регионе. О_о

Но, кроме рофлов, так.

Мы и так слишком обложены со всех сторон, лишняя виртуальная карта не сделает сильно хуже.

Вообще это оффтоп, но давайте по чесноку.

У многих есть аккаунт в зеленом банке — а это уже слитая инфа по дефолту. После аккаунта у зеленых можно регаться ваще где хочешь — хуже точно не будет. Знакомому спам-звонки начались спустя день после того, как он завел счет там. Т.е., какой-то менеджер слил базу в течение суток. Неплохая частота? Раз в день, золотой стандарт.

Окей, допустим у тебя, анон, как и у меня, нет счета в зеленом банке. Но если ты пользуешься Яндексом, имеешь акк ВК или просто таришься в Вайлдберрис… Ну мы все помним, какие там были утечки и как часто.

Чем хуже Озон? Ну, у них банк, ок. И что, чем это хуже или лучше QIWI или Яндекса?

Если мы говорим не о финансовой безопасности, а об анонимности, то я искренне надеюсь, что ты сидишь из-под виртуальной машины, характеристики которой процедурно генерируются при каждом новом запуске, через впн, тор и прокси (желательно несколько) и браузером с отключенным js и cookie, и Random User-Agent сверху. Иначе-то ты не то чтобы сильно анонимен.

У меня лично все лишь браузер настроен, но сижу с десктопа и без впна.

И ставлю ебучие смайлики. =)

Но я к тому, что анонимность должна быть или максимальная, или хули париться, если ебло наружу, простите.

А финансово… Сильно хуже ты озон-картой себе не сделаешь.

Кидать по сбп себе нужную сумму и покупать — все остальное время карта пуста и никаких трат.

НИХУЯ СЕБЕ

Плюсую, возможно купили с потрохами.

Не может не радовать, больше форков и конкуренции, меньше картельных сговоров и монопольной регуляции. Главное чтобы отпочковалась норм команда а не комиссия по сое что начнет активизмом всех кошмарить.

Exl2, тут как в меме лол.

Нет, обучали на синтетике уже с начала года, просто сейчас имплементировали результаты множества исследований по методикам обучения, лучше отфильтровали и сбалансировали датасеты, и ответственнее к синтетическим стали подходить. Соя есть там где девы допустили ее протечки или специально ее вносили.

Почему читая твои наезды испытываешь не хейт а лютейший кринж? Главная контрибьюция - вот такие шизопосты в тред и срачи, для остального ты реально слишком недоразвитый. И еще что-то предъявляет, о да.

Соя везде есть, в той или иной степени просачивается. Даже в пигмалионе она есть. От этого никак полностью не избавиться, если только не тренировать на своих собственных датасетах.

обнова кобальда

> Даже в пигмалионе она есть.

Если про ллама версии говорить то они крайне соевые были. Не стоит путать сою с позитивным настроем изначально, то что в первых запросах без контекста и требований сетка старается быть доброй и так реагировать - это нормально, не нормально когда она начинает читать мораль юзеру и игнорить инструкции отыгрывать жестокость и подобное.

Кто-нибудь более тесно игрался с мультимодалками? В частности насколько эффективно работают проекции ллавы с обычными 13б без файнтюна, и как падает качество визуализации? Уж очень она тупая сама по себе, выполнение более менее сложной инструкции где нужно разделять запросы с противоположными требованиями (типа для этого параметра подробно для этого лишь одно слово) дается ей тяжело.

И заодно - какую из 13б сеток (или что-либо что может влезть в врам консумерской жпу) сейчас отмечают самой умной для QA?

Эх, вот бы какую-нибудь оптимизацию для 8гб инвалидов завезли. Так ведь нету.

>Кто-нибудь более тесно игрался с мультимодалками?

Да, и даже подрубал их кодеры мультимодальности к другим сеткам схожего размера. Ну, работает, только чуть хуже.

А вобще если особых мозгов не нужно попробуй мультимодалку на 3b, быстрее работает хоть. Вот это, на сколько помню https://huggingface.co/NousResearch/Obsidian-3B-V0.5

Кажется их поддержку добавили в лламу.спп недавно

Ну, добавили более точную автонастройку слоев, так что считай уже оптимизация.

Да и код постоянно улучшает скорость, там же от герганова самое сочное таскается улучшая производительность с каждой обновой.

Наоборот нужно как можно умнее и лучше по восприятию пикч. Может еще их файнтюны где есть, а то не встречал? Ллаву 7б в начале катал - та вообще дегенеративная, 13b Q8 уже ничего, но всеравно тупая и фейлит. Например, может проигнорить часть инструкции, или добавление уточняющих подсказок чтобы отмечала нужные вещи приводит к интерпретации что их нужно обязательно юзать. Например, что-то типа

> отмечай необычную одежду персонажей типа китайского платья с вырезом, двубортного пиджака или бикини купальника если такая есть

иногда приводит к ответам

> девушка одета в китайское платье, пиджак и бикини

что довольно рофлово. Температура офк в порядке.

Бакклава есть еще, файнтюн мистраля на мультимодальность

https://huggingface.co/SkunkworksAI/BakLLaVA-1

Но я бы без тестов не скидывал со счетов 3b, если не использовать ее для разговоров то она может быть лучше той же ллава в опознании изображений, тестить надо а потом уже. А еще есть https://huggingface.co/adept/fuyu-8b

Учитывая, что я ни на кого не наезжал, я даже хз, на что ты отвечаешь.

Ну, то есть, очевидно, что на свою шизу обижаешься. И еще говоришь о каком-то развитии.

Ну, тут уж ничего не поделать, бугурти дальше на свои фантазии. =)

Герганов добавил поддержку Обсидиана? Ето хорошо, ето мы потестируем. Разрабы как всегда обещали десять из десяти и распознавание любого текста. =D

Нет, ничего лучше Ллавы-1,5 нет. Если тебе нужна полноценная мультимодалка.

Как мне кто-то предлагал — запустить две модели, чтобы умная задавала вопросы ллаве, и формировала адекватные ответы.

Думаю, рабочая схема, но я так и не занялся.

Фуйу по их же тестам хуже Ллавы и Квена.

Даже их медиум-версия.

Так шо хз-хз.

Молодцы, что делают. Но…

>Герганов добавил поддержку Обсидиана? Ето хорошо, ето мы потестируем. Разрабы как всегда обещали десять из десяти и распознавание любого текста. =D

Ага, щас проверил на последнем релизе. У меня падает при запуске картинки на сервере, но работает так

.\llava-cli.exe -m ..\obsidian-f16.gguf --mmproj ..\mmproj-obsidian-3B-f16.gguf -t 6 --temp 0.1 --image .\1f44de71d2a21d02754b8c9a40ff4a7d.jpg -p "describe the image in detail."

Пасиба, сейчас попробую картинку в запуск добавить.

Ну, слушай. Обсидиан относительно неплох.

Кмк, Ллава, Бакллава и Обсидиан по качеству располагаются по своему объему.

Но при этом, качество отличается не в два и четыре раза.

При этом скорость как раз линейно отличается (что не удивительно, тащемта=).

Так что, Обсидиан имеет право на жизнь, хотя и в разумных рамках.

Щас накачу на свой комп и попробую на видяхе покрутить.

Кмк, Ллава, Бакллава и Обсидиан по качеству располагаются по своему объему.

Но при этом, качество отличается не в два и четыре раза.

При этом скорость как раз линейно отличается (что не удивительно, тащемта=).

Так что, Обсидиан имеет право на жизнь, хотя и в разумных рамках.

Щас накачу на свой комп и попробую на видяхе покрутить.

> и браузером с отключенным js и cookie, и Random User-Agent сверху. Иначе-то ты не то чтобы сильно анонимен.

Всегда ржу с таких диванных анонимусов. Такие настройки это 100% деанон, прямо светится на приборной доске ФСБ и ЦРУ. Настоящая анонимность это максимально общие настройки, см. тор браузер. В нём и JS включен, и куки отрабатывают, и UA фиксирован. И он в сто крат анонимнее твоего говна.

Похлаву еще на релизе тестил, не сказать что лучше ллавы, но надо попробовать.

> А еще есть https://huggingface.co/adept/fuyu-8b

Вот это интересно, архитектура совсем иная и может лучше отрабатывать. Правда смущает

> the model we have released is a base model. We expect you to need to finetune

Надо еще в сторону имитации chain of thought и последовательностью запросов с более простыми инструкциями с сохранением их в контексте попробовать. Так ей точно будет легче, вот только здесь придется еще семплинг на каждый запрос свой подбирать, иначе пиздец.

> Учитывая, что я ни на кого не наезжал

Уже забыл что выше писал, за контекст выскочило лол.

> но я так и не занялся

Такой всесторонне развитый эксперт, и не занялся, вот же беда.

Я нюфаг. Для более или менее нормальной модели нужна видюха с 24 гигами минимум? Уровня той, что сверху кидали.

И из чего вообще модель состоит? Типа тупо набор слов, весящий несколько гигов?

И из чего вообще модель состоит? Типа тупо набор слов, весящий несколько гигов?

Тоже хорошая мысль!

Но в таком случае ты светишься у всех корпораций, и это не стократ анонимнее — а просто неанонимно и все. =) Как бы, магии не случается.

Поэтому толку от всей этой хуйни в итоге все равно нет.

Тут или в тайгу, в землянку (и не оставлять теплового следа!), или не срать под себя в жизни и не выебываться.

Да не, я помню, просто ты галлюцинируешь. =)

> Такой всесторонне развитый эксперт, и не занялся, вот же беда.

Ой, как ты меня обидел, как обидел!.. =D

Продолжай. =)

Все зависит от твоих желаний.

Можно в видеопамять грузить, можно в оперативную.

В оперативной гораздо медленнее.

Для 13B-модели хватит 12 гигов видеопамяти в дефолте.

Для простой болталки на 20B-модели хватит 32 гига оперативы.

Для качественного общения с 70B-моделью понадобится 2 24-гиговой видяхи.

Но можно в 64 гига оперативной уложиться — но ждать очень долго.

Можно выгружать часть в видеокарту, часть в оперативку — но 70B все равно будет медленно.

А вот 20B будет ниче так.

Есть бояре в треде, есть нищуки.

Есть облако (гугл коллаб).

> тор браузер

Проорал с мамкиного анонимуса. Тор как раз уже на этапе СОРМ палится, все входные ноды известны, конкретный юзер легко пробивается по времени запросов, благо "анонимусов" с Торами не много. Если конкретно тебя захотят найти - завтра же в дверь будут стучаться.

А вообще анонимность это когда не могут твою личность определить не приезжая по адресу, а не когда не могут тебя найти. И лучше всего делать так чтоб никто не захотел ехать к тебе, быть серой массой быдла в бигдате, а не подписываться в СОРМе анонимусом юзая Торы и прочее говно. Прецеденты в рашке уже были, когда под Тором какую-то экстремистскую хуйню делали в интернете и думали что всё окей, но через неделю уже собирали мыльно-рыльное.

> Такие настройки это 100% деанон, прямо светится на приборной доске ФСБ и ЦРУ.

У ФСБ не светится, если под голым HTTP не полезешь куда-то. А на ЦРУ кому не похуй? К тебе в Тулу приедут ликвидировать тебя за пост на дваче?

Смысла, конечно, мало от этого говна. Галка "не отслеживать" в браузере и то полезнее.

>Для 13B-модели хватит 12 гигов видеопамяти в дефолте.

12 гигов свободных, или 12 гигов видюхи в целом? Второе у меня есть, первого - нет.

Зависит от контекста (сколько будет программа помнит истории вашей переписки).

Вообще, конечно, не впритык 12 гигов.

Для 4к контекста около 11 гигов свободных.

Для 2к — 8,5 гига.

Пусть меня поправят.

Можно купить вторую дешманскую видуху для этого. А конечно сам прифегел когда начал следить что система сжирает 6гигов видеопамяти.

>Но в таком случае ты светишься у всех корпораций

Схуяли?

>Тор как раз уже на этапе СОРМ палится

Читаешь жопой? Я не предлагал использовать тор, я указал, что в тор браузере используются верные подходы к обеспечению анонимности, в отличии от мамкиных хакиров, которые палятся по рандомному UA.

>быть серой массой быдла в бигдате

Да, именно так. Поэтому я и написал, что долбоёб, делающий себя максимально интересным и выделяющимся.

>Прецеденты в рашке уже были, когда под Тором какую-то экстремистскую хуйню делали в интернете и думали что всё окей

Пруфы? Я помню только когда брали за жопу владельцев выходной ноды.

>У ФСБ не светится

А в сарказм ты не умеешь.

>А конечно сам прифегел когда начал следить что система сжирает 6гигов видеопамяти.

Ты это, киберпанк выгрузи. Система максимум пару гигов жрёт, и то благополучно сливает в оперативу.

Что у вас там запущено? У меня от силы 1 гиг, а чаще 300 мб.

> Схуяли?

=) Шо тут скажешь.

Google Analytics не для тебя сделано.

И таргетной рекламы ты не видишь.

И все прекрасно в вашем соевом мирке.

Кайфово. Рад за тебя.

Блин проверил кучу моделей и только одна может исполнять простую инструкцию как прошу. Остальные чудят как будто у них вообще или не РП датасеты или соей намазано или в рп модель вечно забирает мою роль. Что с ними всеми не так? Почему только Emerhyst 20b чето может. Почему Undi 95 не продолжает развивать Emerhyst?

>Блин проверил кучу моделей

>ни одной 70B

Говна навернул.

vscode окон 6 и браузер часто в браузере у меня по 100 вкладок открыто и несколько браузеров. Ускорение графики браузерами сжирает дофига. Оперативку тоже жрет, у меня 30+ гб обычно занято. Мне проще докупить оперативы и видюхи чем менять привычки.

А че хоть за магическая инструкция?

И не одной топовой 7b в 8q, ни гермеса, ни опенчата, зато какой то нишевый мусор. Ну синтия ладно, лол. Но она слабее. Да и из 20b одна только любимая выше 3km.

Что он от них на 3 квантах ждет хз.

Новая 13b, может быть лучше старой LLaMA2-13B-TiefighterLR

https://huggingface.co/KoboldAI/LLaMA2-13B-Psyfighter2-GGUF

https://huggingface.co/KoboldAI/LLaMA2-13B-Psyfighter2-GGUF

ой да ладно что вы к человеку прикопались чудес нет, все тюны +/- одинаковы. Даже если где то на середине диалога переключишь сеть часто они говорят один в один. Мне кажется что тут скорее эффект плацебо как там uni95 выкладывал дифы мистраля, а потом оказалось что они нерабочие, а куча людей отписались как им понравились новые тюны.

>ой да ладно что вы к человеку прикопались чудес нет, все тюны +/- одинаковы.

Ну нее, все таки тюны даже отвечают по разному. Разным размером, разным стилем, даже на одной карточке. Не знаю уж как ты не заметил.

> А конечно сам прифегел когда начал следить что система сжирает 6гигов видеопамяти.

Майнеры выключи, на системе с одним монитором оно больше 700 метров не должно кушать, да и то из них приличная часть выгружаемая.

Что там за инструкция? Алсо 13b k_s - грустновато.

Их запуск не так прост, тесты бы сильно затянулись, лол.

> Ускорение графики браузерами сжирает дофига.

Нет, там иногда можно увидеть как метров 900 сверху схавало максимум и это выгружается.

да простенькая на выполнение условий. Например опиши такой то бар. Описала сетка. Дальше начинаю раскручивать тян из бара. И действия и диалоги ведет только Emerthyst. Остальные тупые как пробки или у них нет датасетов под это. Мистраль 11б смог в описание бара, но в взаимодействие с тян не смог от слова совсем. Соевое дерьмо.

ля ну видюхи на 70b нет. Кто знает сервисы где можно потестить 70b?

Увы, суждение сильно субъективно и на истину не претендует, но складывается ощущение что к другим моделькам придется приспосабливаться и менять паттерн действий чтобы было норм, иначе разочарование. Эмерсист выглядит несколько выдающимся на фоне собратьев и может многое, и то иногда его приходится вести за ручку, но хотябы старается и помнит, достойная моделька. Удовлетворить построение более менее сложного сюжета по ходу могут 70, но с ними нужно железо или терпение. 30б могла бы стать топовой золотой серединой, но их не завезли, может китайца сейчас затюнят что станет прилично.

ну 30b опять же надо 4090.

Да. Эмертист очень радует по сравнению с другими идиотами.. Единственный из всех кто чет может. Кстати понравилась карточка с диктаторами. Но ля я ору с того что она иногда использует чужие инструкции. Щас у меня уже Муссолини заговорил на немецком, а до этого опять же применял гитлеровскую замену th на z....

Может докупить видяху, чтобы на нее рабочий стол повесить? :)

Я вот подумываю попробовать такой трюк. Хз, не вникал еще, как там с настройками.

что то глаза вытекают на таком ярком фоне

Скачал предпоследнюю версию таверны и теперь в ней не дает апи ссылку кинуть для стрима. Как исправить. Где этот апи флаг прописать?

Какая сейчас самая умная из 70B? Полуторная ситния?

Они по-моему все плюс-минус одинаковые по мозгам. Выбирать надо по стилю и отсутствию сои.

Ну под умной я как раз имел ввиду минимум сои и нейтральный стиль, в котором идти против пользователя - норма

Euryale 1.3 топчик. Есть и более свежие версии, но я их пока не тестировал.

Где можно глянуть на промпты? Мой вроде норм но немного не то.

Смотрю в шапке бенчмарк а псифайтер говорят не так то и хорош.

А в топе вообще какой то нейролинк, наверное тот что прямо в голове.

А в топе вообще какой то нейролинк, наверное тот что прямо в голове.

ЕМНИП там сейчас один адрес.

Все бенчи говно на самом деле. Официальные тестят сою и задроченность на тесты, неофициальные просто говно и считают мемберы в выводе сетки.

нэ. Так раньше же был нормальный стриминг. Куда дели, я перешел ради Min P на новую версию, а тут такая засада.

Тесты мультимодалок интересны? Кидайте пикчи и промты.

Describe a ramen room where loli slave girls in lewd outfits fuck clients. NSFW scenes included.

Держи. Чисто без промптов и пикч попробуй результат. Если сможет написать достойно то заинтересует.

> мультимодалок

Можешь скинуть свои извращенные картиночки с лолислейвами на опознание и задать вопрос по ним, общаться с ними текстом нет смысла.

а я подумал сначала что несколько текстовых моделей вместе. Не таких у меня нет.

Делитесь на каких модельках кумаете.

Очень требовательна к промпту. Может выдавать перлы но у меня проблемы навыка подобрать нормальный рабочий промпт.

https://rentry.co/rintf

Сраный рандомайзер, и как это оценивать? Надо с гопотой еще сравнить. Fuyu и Obsidian устойчивую генерацию yaml по шаблону нормально не осиливают, похлава и ллава могут.

Сраный рандомайзер, и как это оценивать? Надо с гопотой еще сравнить. Fuyu и Obsidian устойчивую генерацию yaml по шаблону нормально не осиливают, похлава и ллава могут.

Ещё один шизофранкенштейн?

Добавил еще других для интереса и заодно попросил лламу обобщить на основе трех наборов данных. В общем потанцевал вроде как и есть, но нужно оптимизировать и бороться с галюнами. Если есть идеи по необычным пикчам что туда нужны - можно добавить, эти большей частью мусорные из отсеянного.

>Your input image may contain content that is not allowed by our safety system.

Я знал что так и будет в этом проприетарном говне. А это через АПИ так или на сайте?

Ну и имя персонажа с первого пика знает только CLIP, остальные максимум аниме стиль угадывают.

Почему так происходит? Приходится ждать 2-3 раза обработки заново перед ответом.

Тем кто не тестил Min P по этой статье очень и очень советую.

https://www.reddit.com/r/LocalLLaMA/comments/17vonjo/your_settings_are_probably_hurting_your_model_why/

Тестил на предпоследней версии таверны. Стриминг не работает через угабугу, но работает через кобольд.

Для теста юзал Emerhyst-20B.q3_k_m . Показало даже лучше чем раньше. Интересно как Min P раскрывает 70b, жду ваших комментов аноны. По мне благодаря этому Min P во первых вырастает креативность ответа и становится мало шизы. Промпты вообще не юзал.

https://www.reddit.com/r/LocalLLaMA/comments/17vonjo/your_settings_are_probably_hurting_your_model_why/

Тестил на предпоследней версии таверны. Стриминг не работает через угабугу, но работает через кобольд.

Для теста юзал Emerhyst-20B.q3_k_m . Показало даже лучше чем раньше. Интересно как Min P раскрывает 70b, жду ваших комментов аноны. По мне благодаря этому Min P во первых вырастает креативность ответа и становится мало шизы. Промпты вообще не юзал.

У тебя размер контекста в таверне завышен по сравнению с контекстом в загрузчике.

>Интересно как Min P раскрывает 70b, жду ваших комментов аноны.

Никакого чуда не увидел.

70b сетка? Min P просто устраняет все маловероятные токены и по моему очень положительно это влияет на ответ. Другие настройки так же выставлял?

>70b сетка?

Да, Q5_K_M, кажись на синтии пробовал.

>Min P просто устраняет все маловероятные токены

Так же как и Tail Free Sampling. Да и вообще многие семплеры именно то и делают, просто по разному.

>Другие настройки так же выставлял?

А то, профиль отдельно сделал. Эту ссылку если что кидали в начале треда

А ну да. Я просто листал треды и наткнулся решив затестить. Но может дело еще в модели. У меня на 20b стало креативнее и менее однообразно.

Тоже себе профиль по ссылке сделал, заебато стало, но приходится с температорой играть для лучшего результата

а че не так с темпурой. На 1 это золотая середина вроде не?

когда тесты загадок делал то иногда работало лучше или с 0.7 или 1.5 или между, выше уже ухудшались результаты

> в таверне завышен по сравнению с контекстом в загрузчике.

Спасибо.

Как работают лорбуки? Я правильно понимаю, что указывается токен и дополнительное определение к нему, которое вставляется в посылаемый в модель текст, если там есть токен? И тогда если я хочу определить там базовые вещи, которые обычно не упоминаются, но подразумеваются, то лорбук будет бесполезен? Например если я хочу чтобы у людей было по три руки, то сетка будет почти всё время об этом не в курсе, т.к. мы не говорим "Человек Саша шла по шоссе и делала феляцию сушке".

инб4: хочешь такое необычное - пиши в карточку персонажа/настройки/тренируй лору

инб4: хочешь такое необычное - пиши в карточку персонажа/настройки/тренируй лору

ну, на сколько я понимаю тебе нужно указать что у саша человек, а у человека три руки. И я так понимаю это 2 отдельных записи в лорбуке. Хотя не ебу, не пользовался

Я так понял что лорбук добавляет в контекст дополнительные записи, если в последнем сообщении шла речь про ключевые слова из лорбука.

Например ты спрашиваешь "Есть ли поблизости какой-нибудь город?". А в Лорбуке есть запись "Города", со списком, которая добавляется в контекст. Нейронка выбирает город Норильск, ты спрашиваешь "И что это за город?". Тогда в контекст добавляется запись конкретно о Норильске, если она есть в лорбуке.

Почаны, есть одна карточка...

Короче, купил себе 4080 за копейки, и хочу локально покрутить openChat (нашел тут бенчмарк, по которому в маркетинговой хуйне он дает защеку gpt3.5) - есть ли где-то гайд для домохозяек как это сделать, без тысяч разных вариантов а просто "делай 1, 2, 3" - если честно в стейблДиффьюжен заебался вкатываться и понимаю прекрасно сколько времени щас нужно будет еще потратить и на LLM все эти

Короче, купил себе 4080 за копейки, и хочу локально покрутить openChat (нашел тут бенчмарк, по которому в маркетинговой хуйне он дает защеку gpt3.5) - есть ли где-то гайд для домохозяек как это сделать, без тысяч разных вариантов а просто "делай 1, 2, 3" - если честно в стейблДиффьюжен заебался вкатываться и понимаю прекрасно сколько времени щас нужно будет еще потратить и на LLM все эти

Как нехуй делать, качаешь релиз кобальда из шапки, качаешь ггуф опенчат на 16к, запускаешь кобальдом и чатишься

https://huggingface.co/TheBloke/openchat_3.5-16k-GGUF

8q качай и у тебя еще 8 гб останется на кучу контекста, не считая оперативки

Или можно пойти путем сложнее, но там другие форматы запуска и программы.

Кобальд реально проще. А после кобальда легко силли таверну сверху добавить, для улучшения форматирования вывода и все такое.

На какой модельке лучше всего кумать?

варианты в шапке или в ссылках

Pygmalion /tred

> 8q качай

Зачем советовать этот кал для видеокарты? Q8 раза в 4 медленнее чем GPTQ под ExLlama v2. Ещё и вечные проблемы с новыми моделями у Жоры.

благодарочка

я тут нагуглил всякие статьи\гайды, оно там пишет что у кобольда контекст 2048 токенов, это устаревшая информация или нет? А то я думаю что там довольно дофига инструкций будет, может и не влезть.

как запускать другие форматы гайд в студию

Контекст зависит от сетки, у той что дал 16к контекста. Запуская кобольд выберешь там 16к и все

отлично, спасибо

А какие вообще есть локальные модели с самыми большими окнами контекста? А то щас периодически приходится в клод2 скидывать какие-то лонгриды, но он зацензурен пизда просто, может есть что-то локальное большое?

> И тогда если я хочу определить там базовые вещи, которые обычно не упоминаются, но подразумеваются, то лорбук будет бесполезен?

Да, чтобы он работал тебе нужно именно ключевое слово написать, или чтобы его написала сетка, и тогда в контекст добавится описание этого ключевого слова из лорбука. Костыль тот ещё конечно, уже подумываю лору запилить, правда хз насколько эффективно будет.

> знал что так и будет в этом проприетарном говне

Там причем сетка с цензурой стоит явно отдельно перед основной обработкой, заметно по времени ответа. Через api офк, через сайт вручную все это тащить можно ебануться а чтобы написать обманку абузющую интервейс нет скиллов. И еще говорят на сайте цензура более жесткая, типа даже геймершу с бедрами забраковало бы, но это не точно. С чаром проще, он обычно с 99% на бурах в их тегах верно указан.

> Интересно как Min P раскрывает 70b

А что их раскрывать то? Там по дефолту ответы хорошо, может оказаться на уровне плацебо. Но в сложных ситуациях можно и потестить офк, возможно хваленые шизомиксы станут меньше страдать рельсами.

> На 1 это золотая середина

Нет, это лютейший рандомайзер. 0.5-0.7 адекватные величины а для более точных ответов вообще 0.3. Офк оно зависит от модели и настроек остальных семплеров.

Причин может быть множество, но наиболее вероятная в том что модель не могла их полноценно разгадать а только рандомила.

В теории в 16 гигов он может влезть в fp-16. Ставь text generation webui, скачивай веса с обниморды, конвертируй их в safetensors скриптом из комплекта экслламы, и запускай с помощью exllama2-hf. Получишь наилучший результат из всех возможных. Правда вот если в врам не влезет, тогда хуже, качай что говорит, запускай через llamacpp-HF с полной выгрузкой слоев.

бамп

Пережимание в gptq сильно хуже по качеству 8и битных gguf?

ну так потому что локальные объедки никогда не превзойдут проприетарщину, даже "лоботомированную".

Гпт лахта у тебя что, опять модель лоботомировали как месяц назад?

> мистраль

> uncensored

Лол.

Не сильно но ухудшает, разница в 2 раза же. При равном размере gptq и exl2 лучше чем gguf, в них идет оценка и ужатие происходит обратно пропорционально важности индивидуально для модели. В GGUF же делается по заранее подготовленному общему темплейту что радикально экономит время и ресурсы, но менее точно.

Чсх, для шизомиксов можно часто наблюдать отличия в наилучшей битности ближайших частей и соседство 2.7бита с 6.2 вполне дефолтная картина. В обычных файнтюных такое реже и обычно более равномерно. Развивая это, для типичных замесов действительно квант gguf побольше может иметь ощутимый буст перфоманса.

> локальные объедки никогда не превзойдут проприетарщину

Сильно заявление, продвигаемые энтузиастами и кумерами игрушки, пускаемые на нищежелезе, уже ебут проприетарщину, которой радовались пол года назад.

Почти не юзал min P, но в теории он, так же как и top A, нужен только для редких ситуаций, когда у самого вероятного токена очень большая вероятность, скажем, процентов 80. И ты не хочешь выиграть в лотерею следующий за ним токен, даже если у того вероятность, например, 10%, что не мало, но на деле он ни черта не подходит. Т.е., по идее, min P вообще никак не может повысить креативность, а наоборот, уменьшает выбор, как и почти все другие сэмплеры. И top A, как по мне, за счёт квадратичной зависимости от самого вероятного токена вместо линейной гораздо лучше подходит в подобных случаях, сильнее влияя именно на большие вероятности. А во всех других случаях TFS, который выкинет тем больше токенов, чем круче меняется вероятность от токена к токену, будет лучше, чем min P.

Если правильно понимаю, там суть в использовании с высокой температурой чтобы более агрессивно поднимать вероятности андердогов. Точности это точно не прибавит, хотя умная модель даже так сможет что-то отыграть если речь о креативе и рп.

Прочитал внимательнее сам пост на реддите - речь о том, что использование min P повысит креативность, если использовать его вместо top K и top P, которыми можно отрезать слишком много хорошо подходящих токенов. Тут не могу не согласиться, но TFS был внедрён раньше, чем min P, и вроде неплохо справляется с динамическим отрезанием хвоста. Так что я не очень понимаю всю эту радость по поводу добавления min P. Разве что последний понятнее работает, формула простая.

Все так, там рассмотрены крайние случаи типа "а что будет если вдруг вот так и здесь только один topP, или что будет если вот так но только один topK". Офк семплер норм, но бегать с лицами сойджака и надеяться на революцию это глупость.

Кто бегает то? Просто хороший семплер сочетающий в себе все что нужно.

Мне нравится простотой использования, управлять одной шкалой проще чем 3.

Да и результаты дает более сглаженные, так как уменьшает разрыв между вероятностями. Сетка плавнее и креативнее отвечает работая при этом +- верно.

Было бы что то еще более совершенное я бы вообще отказался от ручной настройки, сделают когда-нибудь нейросети управление семплерами на основе контекста вот это будет интересно. Все таки пока сама нейросеть не начнет "выбирать" что сказать и куда вести разговор все это костыли.

> результаты дает более сглаженные, так как уменьшает разрыв между вероятностями

Ого, и как он это делает? Расскажи, интересно.

Он удобный и вполне приличный вариант для использования, но на революцию не тянет. Вполне может херракнуть лишнего в отличии от того же сочетания top_p-k-tfs или наоборот не тронуть мусорный шум при определенных условиях.

> что то еще более совершенное

Первично качество самой сетки, неспроста гопота сохраняет корректность ответов на загадки даже при более высокой температуре чем лламы (хотя здесь клозедаи наверняка напилили прослоек и напрямую температурой не управляешь). Хорошая изначально дает приличное распределение, хреновую же семплингом не починишь.

>Ого, и как он это делает? Расскажи, интересно.

Ну тут я напиздел, не сам мин-п, он только динамически обрезает варианты, а вместе с температурой. Мне нравится пока.

>Первично качество самой сетки, неспроста гопота сохраняет корректность ответов на загадки даже при более высокой температуре чем лламы

Ой не верю я что там какие то простые семплеры сделаны, это же самое главное в генерации, вполне может быть так что там действительно есть отдельная нейросеть которая управляет генерацией напрямую

> это же самое главное в генерации

Далеко не самое, но момент действительно важный.

> там действительно есть отдельная нейросеть которая управляет генерацией напрямую

Ага, об этом уже заявлялось, но помимо делегирование нужному эксперту она вполне может крутить его параметры семплинга в зависимости от запроса и пожеланий пользователя.

>Далеко не самое, но момент действительно важный.

Одно из самых важных вобщето, на ровне с качеством самой сетки

>об этом уже заявлялось

Хде? Про то что есть несколько экспертов помню как и то что есть нейросетка-дирежер, а вот то что она и семплеры настраивает не слышал.

Я так понял все реализации gptq, обеспечивают разделение мощности по слоям для нескольких видеокартах, что не требует быстрых интерфейсов но карты фактически простаивают половину времени. Кто нибудь пробовал разпаралеливать модели вертикально? Какие скорости интерфейсов для этого нужны?

llama-cpp выдает error loading model: create_tensor: tensor 'token_embd.weight' not found при загрузки любой модели из ./models

Как быть?

Как быть?

а вот мисраль у меня запустился, я как бы доволен, но всё равно интересно, почему с моделями искаропки ошибка вылезала

Мистраль в своих 7b лучше 13b первой ламы? Или чем тюны neo-x? Просто несправедливо люди обходят стороной эти прошлые модельки, они менее эффективны но если у тебя достаточно памяти то все хорошо.

Мисраль запустился, но выдает абсолютно нерелеваные промпту результаты, вообще на рекламу какую-то похожие. Ревкестриую тесты, я заебался в этом зоопарке разбираться, я даже не знаю, как теперь запрос в гугл написать.

./main -m /media/User/Disk-SN/mistral/openhermes-2.5-mistral-7b.Q5_K_M.gguf -n 128 -r "In sentence 'I think, therefore I am' the verb is"

# The Future is Female: A Look at Women in the Automotive Industry

Historically, the automotive industry has been a male-dominated field. However, things have started to change as more women are taking on roles in this fast-paced and exciting business. Here’s a look at some of the ways that women are making their mark in the automotive industry.

## Women in Auto Design

In the past, few women held positions in car design. However, things are changing as more female designers are entering the field. Companies such as Ford and Volkswagen have hired more women

>Мистраль в своих 7b лучше 13b первой ламы?

100% Базовый то на уровне с 30b llama 1 а файнтюны однозначно лучше. Кто то говорит что они по мозгам с llama 1 65b

линукс что ли? запускай с кобальдспп

И там сложнее запрос должен быть. Ты не указал что это интерактивный режим -i и чет там еще делается, твой ник, ник бота, для остановки генерации. Сам промпт должен быть лучше. Да и ты проебался с ключом промпта там -p надо а не -r

Лул, это явно копипаст откуда-то. Что за шляпа.

./main -m /media/User/Disk-SN/mistral/openhermes-2.5-mistral-7b.Q5_K_M.gguf -n 128 -r "Fucking shit"

# 32nd Annual OC Marathon: Race Recap

I can’t believe it has been almost two months since the 32nd annual OC Marathon! It feels like it was just yesterday and yet it feels so long ago. This marathon holds a very special place in my heart as it is my favorite race of all time (so far)! This year marked my third time running this beautiful course that takes you through various cities in Orange County, including Huntington Beach, Newport Beach, Laguna Beach, and Costa Mesa.

Кобальт в сегфаулт вываливается. Но попробую еще раз. Спасибо. Просто настолько нихуя не понятно, как с llmками мне никогда не было. Старею.

какой еще ник бота, где я, что вокруг вообще происходит. (шутка, я понял, о чем речь)

А так спасибо, я уже старый (30 лет) и в глаза долблюсь, вот уже внимательно прочесть хелп не в состоянии, вот вводил реверс-промпт вместо прямого, сидел и бесился.

запускай server файл, там сможешь почти как белый человек сидеть с браузера и там все настраивать

я не белый человек и сижу через консоль, привыкши.

Еще раз спасибо анону, все работает, кончил радугой, модель внезапно неплохо осведомлена в вопросах касаемо моей работы (релевантно ответила на вопрос "я лигирую вставку Х к вектру У, в колониях на чашке лажа растёт, что делать").

Как обновить Silly Tavern через git? git pull запустил, но версия по-прежнему 1.10.7.

я даже пожалуй выключу интернет и погоняю её в оффлайне, невозможно же настолько точно отвечать без доступа к сети казалось бы.

Хотя, по факту, вопросы поверхностные и сетка тут отчасти работает просто как архив.

https://www.reddit.com/r/LocalLLaMA/comments/17vonjo/your_settings_are_probably_hurting_your_model_why/

настройками семплеров еще пошамань, еще лучше попрет

>я даже пожалуй выключу интернет и погоняю её в оффлайне, невозможно же настолько точно отвечать без доступа к сети казалось бы.

будущее радом старик, хехех

> Одно из самых важных вобщето

Сильное заявление, вот сейчас доебусь и заставлю накручивать семплингом поведение первой лламы 7б до мистраля в детерминизме.

В современных даже просто гриди энкодинг неплохой результат может дать, офк от задачи зависит. Тут главное - не прожигать температурой, а то уже как там токены отсеивать такой уж огромной роли не играет, потому вся эта тряска с "мегаинновационным семплером" - херь.

> Про то что есть несколько экспертов помню как и то что есть нейросетка-дирежер

Именно про это, перечитай пост

> помимо делегирование нужному эксперту она вполне может крутить его параметры семплинга

Только exllama, остальные требовательны к интерфейсам. Раскидать может и llamacpp, вот только скорость там оче проседает.

> Какие скорости интерфейсов для этого нужны?

nvlink, может 2x16 PCIE5.0 будет приемлемо если оптимизировать количество передач.

> 100% Базовый то на уровне с 30b llama 1

Ну не, 30 первой лламы сложные инструкции куда лучше понимала. Другое дело что 2к контекста и старое поведение дают ей сильный штраф, в околорп мисталь действительно может быть предпочтительнее.

> Кто то говорит что они по мозгам с llama 1 65b

Да хули, уже жпт4 подебили и ждут новую сетку чтобы с ней состязаться.

Там есть батник update and start, его нажми. Или просто новую скачай а карточки и чаты скопируй.

>Сильное заявление, вот сейчас доебусь и заставлю накручивать семплингом поведение первой лламы 7б до мистраля в детерминизме.

Ну ты до абсурда то не доводи, это кстати интересный эксперимент. Надо будет поискать может не удалил альпаку.

>Ну не, 30 первой лламы сложные инструкции куда лучше понимала

Файнтюны или сама llama 1 30b? Файнтюны и сейчас ничего, хоть и ощущаются не так как новые сетки. Ну а про 65b не мои слова, это дроч на статистику и тесты.

Ну и контекст, сейчас после 8к чувствуешь себя избалованным для 2к. Да и 16к уже есть, и даже 120 или 200, сколько там новые сетки выдеют из обещаных.

> Ну ты до абсурда то не доводи

Так не довожу, не стоит относиться к семплингу как к какой-то магии. Магией может быть использование нескольких разных сеток и выполнение операций выбора на основе их разных распределений, вот тут действительно и ускорение, и разнообразие, и нестандартный более точный подход и прочее достижимы. А тут просто попытки балансировать между рандом шизой и когерентностью чтобы получить разнообразную выдачу.

> Файнтюны

Офк, первая то вообще крайне сырая вышла из-за ситуации, хотя здесь хз как получится. А так вон айоробороса 30 взять, который аж до сих пор поддерживается (или не так давно поддерживался), пояснит за "ум" только так, пока контекст не кончится или не отупеет от растяжки.

> дроч на статистику и тесты

Уже пришли к тому что на них буквально модели тренятся, а при обычном использовании там полное фиаско.

>Уже пришли к тому что на них буквально модели тренятся, а при обычном использовании там полное фиаско.

Ну не совсем уж фиаско, но те же китайцы на 34 как то разочаровали. Не смотря на свои тесты.

Да, умнее мистраля, но бля он 7b, в 5 раз меньше. Может я хуево тестил, но особых мозгов не заметил. Я вобще думаю это ллама2 34b после глубокого переобучения. Как и опенчат это тот же файнтюн мистраля.

> но те же китайцы на 34 как то разочаровали

Да блин, серьезно? Все никак до них не получается добраться, но были надежды, этот размер самый сок.

> ллама2 34b после глубокого переобучения

Ага, похоже на это

> но бля он 7b, в 5 раз меньше

Тут для справедливости нужно такого же уровня квант запускать, а на них сильно плевались.

>Да блин, серьезно? Все никак до них не получается добраться, но были надежды, этот размер самый сок.

Ну тот же дельфин недавно запускал, 4km. Может быть повлияло сжатие. Так то отвечает норм, пишет подробно большими полотнами. Мистраль так не может, ну или пытается только опенчат. Но те же задачки про сестер петры не могёт, как и перевозку. Пытается, да. Но не могёт.

Рп или ерп не тестил, как и контекст. А то у меня слишком медленно крутится, отвык я от 2 токенов в секунду.

Господи, эта срань на 4 гигабайта умнее наших аспирантов. Правда, сука, упорная, заставить её признать, что регуляторные доменты иногда совпадают с генами, не удалось. Но это херня, есть же дообучение.

Гипотезы разумно выдвигает. Хотя слишком общо, если совсем в конкретику зарываться.

Не знаю чем там вы к моделям докопались а я выставил мин пи(звучит как китайкое имя) и ерп такое пошло что аж уууух.

На уровне проприетарных моделек а если взять еще и модель хорошую так такое ууууух что прям вообще.

На уровне проприетарных моделек а если взять еще и модель хорошую так такое ууууух что прям вообще.

спасибо.

>к моделям докопались

ты про 34b?

Если есть возможность качай 8q на 7 гигов, ну или качеством еще выше если есть видиокарта на 16гб.

7b модели на 4 гига туповаты, так как слишком сильно сжаты.

Да и ускорение с llama.cpp тоже можно на видеокарте получить. Выгружай слои на -ngl кажется, и получишь ускорение.

Ты мне напомнил кое че с генами, есть сетки с уклоном в науку и биологию, те же мистрали но тренированные иначе.

https://huggingface.co/TheBloke/ANIMA-Phi-Neptune-Mistral-7B-GGUF

https://huggingface.co/TheBloke/SciPhi-Mistral-7B-32k-GGUF

У меня ноут я на коллабе запускаю. Сейчас 5Q K_S стоит так оно уже ближе к чайной чем даже гопота и клод.

Лучше бы в Latex их научили. Хоть какая-то польза была бы.

> Latex

может и учили хз, в регекс прогерские сетки могут

ну если тоже мисраль то надо попробовать, просто моя привычка нищебродничать и жить на старом говне с минимумом памяти и всего в кои-то веки вышла мне боком. Раскошелюсь на отдельных компухтер для антиллекта, раз так. Все равно думал отдельную машинку под архив личных фоток, переписок и интернета выделять, ну вот заодно поближе к тренировочным данным антиллект лежать будет.

Вообще когда я начал дизайн конкретных экспериментов обсуждать, модель соснула-лососнула и понеслась давать советы прямо из 80х. Но в целом это и не беда, я даже на то, что есть, не надеялся.

Натуральный симулятор приема экзаменов, на самом деле. Очень психотерапевтично.

https://arxiv.org/abs//2310.11511

хуя а это интересно

хуя а это интересно

Дай тлдр

Протестил MetaMath, синтаксис латекса валидный, но по формулам полнейший бредогенератор. Хотя на словах вроде знает о чем пишет.

Загрузи ей в начале контекста документацию по нему, а потом уже проси. Или ты зерошотом хотел?

Чего интересного? С RAG куча файнтюнов уже давно валяется.

там селфраг, ну и я еще не видел такое

https://www.reddit.com/r/singularity/comments/17z1y2l/openai_has_made_a_breakthrough_in_retrieval/

жопой чую они там self-rag сделали или нечто подобное

жопой чую они там self-rag сделали или нечто подобное

>neo-x?

Оно давно и справедливо мертво.

По сути да, как тут уже написали, как-то так

ллама 1 30В < ллама 2 13В < мистраль 7В

Очередной набор костылей к тупой сетке, которая даже 2 + 2 без горы обучающих данных не сможет сложить.

Не это крутая штука, любая идея с обратной связью применимая к нейросетям это охуенно.

Ну а считать.

Методы тренировки нужны другие просто, там на реддите была статья что сетка обучающаяся математике с нуля как ребенок, и считающий не по формулам а как человек, добилась точности решения в 98 процентов.

https://www.reddit.com/r/LocalLLaMA/comments/17xj8wl/training_llms_to_follow_procedure_for_math_gives/

Если выстроить их в обратном порядке то будет относительно верно.

Мистраля обожествляют нищуки, которые дорвавшись до возможности нормально использовать ллм и получать приличный ответ, который еще свайпнуть не жалко, уверовали и упоролись аутотренингом. Он такой какой есть, не лучше и не хуже, очень солидный вариант но тупее древнего визарда и хуже в рп чем шизомиксы.

Между 13 и 30момент несколько спорный, в чем-то 13б 2я лучше, в чем-то 30б первой опережает, оверал зависит от приоритетов. Из-за контекста 1я ллама в рп сильно проигрывает, а интересные пуджи 20б могут опередить ее по качеству реплик, так что сейчас она почти без задач.

Сравнивает срандомившийся после кванта ответ без семплинга и делает громкие выводы, уже не в первый раз.

> EXL2 isn't entirely deterministic. Its author said speed is more important than determinism, and I agree, but the quality loss and non-determinism make it less suitable for model tests and comparisons.

О каком вообще детерминизме он говорит в квантованных моделях? Даже gguf по-разному квантовать, наблюдается переодичное смещение ответа в таком режиме и можно насочинять что меньший даст лучший результат.

По перплексити (объективный) и качеству ответов (субъективный) gptq и exl2 превосходят gguf того же размера.

Хуйня какая-то. Как он получил меньше 5t/s на двух видеокартах?

> Как он получил меньше 5t/s на двух видеокартах?

llamacpp действительно отвратительно работает при распределении между несколькими.

На форче у кучи людей есть несколько видеокарт, и у всех работает нормально. Даже на древних P40 получается >6t/s при жирном кванте и 8k контекста, а на 3090/4090 должно быть под 15-20t/s.

>По перплексити (объективный) и качеству ответов (субъективный) gptq и exl2 превосходят gguf того же размера.

А AWQ?

Орли? Давай для начала покажи на паре

> древних P40 получается >6t/s при жирном кванте и 8k контекста

это еще может оказаться реальностью, хоть и слишком круто чтобы ею быть. А потом, быструю работу на паре в llamacpp. В экслламе и даже трансформерах оно еще ничего, но не у жоры.

Хз. В теории и по заявлениям должен быть аналогичем gptq и даже лучше, но вроде по тестам писали что до заявленного не дотягивает. Правда это просто посты с реддита и достоверность хз, сам не запускал его.

>Орли? Давай для начала покажи на паре

У меня нет двух видеокарт, за примерами полезай в архив форча. Но я могу сказать вот что: учитывая, что у меня на Q2_K больше 6t/s на одной видеокарте, а у него чуть больше 4t/s на двух, то этот соевик явно что-то нарукожопил.

Единственное во что я верю - это результаты Primary и Secondary Score. Между Q2_K и Q5_K разница действительно не такая большая, а вот exl2 кванты глюканутые до невозможности. Не знаю как сейчас, может и починили, но раньше 8-битный квант exl2 сливал не только gguf меньшего размера, но и старому gptq.

> У меня нет двух видеокарт

Тогда и не стоит теоретизировать.

> за примерами полезай в архив форча

Сразу нахуй собеседника посылать невежливо, знаешь ли.

> этот соевик явно что-то нарукожопил

Да, то что он рукожоп и не понимает что делает - факт, но с низким перфомансом вина не его, оно действительно так с llamacpp. Даже просто 7б мелкую модель разделить на 2 карточки (а оно по умолчанию как раз по полам загружает) - перфоманс просядет в разы от того что ожидается.

> а вот exl2 кванты глюканутые до невозможности

В чем их глючность? Если офк речь не о 2.5 битах.

> 8-битный квант exl2 сливал не только gguf меньшего размера, но и старому gptq

Такое легко может быть если перепутать или целенаправленно брать другой файл конфига, хотя в 8 битах уже врядли. Учитывая распиздяйство или целенаправленное желание сэкономить время из-за того что процесс оценки довольно долгий - такой вариант не исключен и тут. Конфиги разных моделей, особенно шизомиксов (как раз наш случай) отличаются сильно, так что есть еще и вероятность что соевика частично подставили. Возможно офк и более глубокая проблема, в которой методы оценки плохо подходят к шизомерджам, но это маловероятно.

Смотрите, мне кажется это очень хорошая карточка для бенчмарка моделей.

1) Проверяет способность модели к форматированию теста.

2) Проверяет на сколько модель поняла значения каждой "личности".

3) Проверяет способность понимать системные сообщения.

Так как сетки в основном используются для моделирования различных ситуаций, нужно проверять не только моделирование личности и манипуляцию информацией. Но и моделирование каких то процессов, явлений, пространственные изменения или изменения времени.

Звучит заумно, но нужно просто проверить понимает ли сетка как должен изменяться описываемый ей мир-персонаж при взаимодействии с ним. И как хорошо она это делает. Что бы не было по 3 раза снимаемых трусов, лол.

Забыл ссылку.

https://www.chub.ai/characters/reedfag/2e0c458b-ff67-42ad-be4a-9c9d5adc62d7

Вот некоторые результаты все (7b-GPTQ), пигма показала худший результат + в обычном RP часто забывает про кавычки и контекста в 6gb vram только 2к влезает больше = ООМ. А лучший - TheBloke_Toppy-M-7B-GPTQ и про форматирование не забывает и часто разные 'способности' из карточки вытаскивает и контекста 4к помещается.

https://www.chub.ai/characters/reedfag/2e0c458b-ff67-42ad-be4a-9c9d5adc62d7