Аноны, укоротите бабе платье плз до середины жопы примерно

С меня нихуя, только интернеты

С меня нихуя, только интернеты

Потому что это не MJ-тред.

>С меня нихуя

охуенно, но не совсем то

До чего технологии дошли.

ну вот, амудетям тоже подвезли CUDA-вычисления

Может проще будет гонять нейронки и всё такое

https://www.opennet.ru/opennews/art.shtml?num=60591

Может проще будет гонять нейронки и всё такое

https://www.opennet.ru/opennews/art.shtml?num=60591

помогите. как инсталлить? и чо за файл в 10 гигов? он у всех?

хз, что за файл, но возможно у всех.

А xformers так и инсталить, как написано. Ты что ставишь вообще?

Качай фокус и мозг себе не еби.

На Ютубе нормальный гайд. Там-то хоть справишься?

на фокус есть бесплатные коллабы?

Не проверял.

Ставить на англоязычном Ютубе, капчевать на русскоязычном здесь.

Спасибо огромное, но только это не до середины попы, а вся попа на виду, ну и трусы не нужно было рисовать :(

Напиздил промтов и нагенерил

>Напиздил

Держи нас в курсе

С текстом пишут понимание у Каскады лучше

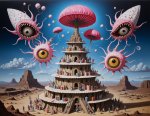

Ловите ультрарарку.

Ну и напоследок, перед сном, от Мастера Воинды вам.

А что так быстро перекатиличсь?

Ты мой гугол, няша.

Лисичер, какой гуй нов и актуален? Есть вариант в виде осборника с выбором любой нейронки, чтобы в выпадающем списке в проге были опции СД, МД и прочие?

В каскад можно модели загружать, а то не разобрался еще

Нуевонахуй, пока СД не будет на уровне dalee, на это говно время не буду тратить. Пойду и дальше блендер ковырять. Бывайте

какой шиз придумал этот интерфейс? почему он не в дурке еще?

Как же заебало нахуй, второй день тыкаю эту хуйню, генерит какой-то мусор, хотя все 1 в 1 по гайду делаю.

что именно генеришь? покаж

Левая нога окончательно взбесилась, и сбежав из бункера отрастила себе себе нового Путина)

огонь

Cascade это что блять? И зачем? Выглядит как смесь 1.5 с недотрененой 2.1.

Касад это и есть сама модель, только ее пока не запустить локально, так как поддержку не запустили.

Да и скорее всего в начале без файнтюна от умельцев, она будет говном.

>шиз аутист

Для начинающих лучше использовать вообще Fooocus, там не нужно сильно много разбираться.

>только ее пока не запустить локально, так как поддержку не запустили.

прекрасно запускается она локально через пинокио.

твоя проблем в этом. поставь автоматик, если компьютер мощный. или фокус

>олько ее пока не запустить локально

https://www.reddit.com/r/StableDiffusion/comments/1apy55i/stable_cascade_oneclick_installer/

А, не, отмена. Это хуета.

https://github.com/AbdBarho/stable-diffusion-webui-docker

1. Установить Docker

2. Ввести 2 команды

3. Подождать 40 мин.

1. Ставишь докер а винду

https://docs.docker.com/desktop/install/windows-install/

2. Клонируешь репу

git clone https://github.com/AbdBarho/stable-diffusion-webui-docker.git

3. Заходишь в диру и вводишь две команды (по очереди)

docker compose --profile download up --build

docker compose --profile auto up --build

4. Ждешь 40 мин

5. Наслаждаешься результатом

Ты тупой, тебе не поможет.

>Клонируешь репу

>git clone

>в диру

чо?

это как прийти к балеринам и сказать, вы тупые, потому что не шарите в органической химии. иди нахуй.

и почему нельзя просто запустить exe или батник? а????? аа???

Потому что SD, как и любая нейронка, сложнейший продукт.

Самое главное почему нельзя сделать "один ехе-файл", это потому что оно написано на говно-пайтоне, у которого 100500 пакетов и зависимостей.

Вот когда это все перепишут на Rust'e — тогда будет тебе "один ехе-файл".

Ставь ComfyUI, на сколько я знаю он не требует установки.

вчера поставил. проиграл с него.

любовь зла

>или батник? а????? аа???

Можно.

>Вот когда

Было уже год назад.

>С текстом пишут понимание у Каскады лучше

Это опендалле 1в1. сидииксел соответственно.

>Ебало сверхразумов из интел?

Интел профильный производитель топ-тир видеокарт? Лучше про ебало амуде говори, которые решили точно так же при этом планируя конкурировать с нвидиа не в офисном сегменте.

>батник запусти

сам хуйло тупое. не буду. для фокуса есть архив рар со всеми файлами и питонами. уже установленными.

Я считаю, что люди, не знающие что такое git и python, не должны пользоваться сд. Им вообще компьютером опасно пользоваться

Я считаю, что люди, которые не могут разложить пропионовую кислоту на карбоксильную и гидроксильную группы, не должны использовать пищу. Им жить-то опасно.

кису погладь лучше

Аноны, помогите пж.

Сгенерил перса через DALLE, а у него часть фуражки обрезана. Можно дорисовать её при помощи SD или других нейронок? И как?

Кроме того, можно ли дорисовать тело, не меняя имеющегося ебала? Извините за тупой вопрос, я вообще залётный, генерирую спрайты для игры

Сгенерил перса через DALLE, а у него часть фуражки обрезана. Можно дорисовать её при помощи SD или других нейронок? И как?

Кроме того, можно ли дорисовать тело, не меняя имеющегося ебала? Извините за тупой вопрос, я вообще залётный, генерирую спрайты для игры

Блять, установить гит и питон (автоматик далее сам все склонирует, создаст venv и тд) - это даже ко не тоже самое, что разработать хоть строчку кода

Детей не обижай. Смешно, откуда вообще на картинке ребенок взялся.

Фокус установи, там самый охуенный оутпейнт.

А он на амд норм работает?

Бля реально, лол. ВТФ? Даже нет ничего такого на что сетка так может реагировать. Почему именно это сочетание дает такой странный эффект?

>А он на амд норм работает?

Нет, для него нужна видеокарта.

Про сд тоже так говорили

пробовал инстант ставить через пинокио сраное. так он требует 24 гига от видюхи. и места занимает столько же. модели там огромные и их много.

за что???!!

Ну, жди пока можно будет запускать на куске сыра. Но лучше купи видеокарту.

причем результат в инстанте такой слабый, что проще лору натренить через леонардо.

>пробовал инстант ставить через пинокио сраное. так он требует 24 гига от видюхи. и места занимает столько же. модели там огромные и их много.

Не должен он столько видюхи жрать. Его на колабе запускали. А там всего 12 гиг. К тому же это как инсайтфейс свап, только там антилопа модель вместа буфалло. Даже с учетом сидиэксел модели он должен влезать в 9 врам.

>причем результат в инстанте такой слабый, что проще лору натренить через леонардо.

Чел, нет. Во-первых, дримбут на полной модели особенно ванили - был лучше лоры, но ты лоры сейчас хаваешь и тебе норм. Во-вторых, это некст дженерейшон (сорт оф) модель, она в принципе делает правдоподобней, чем та что стоит в реакторе, фейсфьюжене, рупе и т.д. Ну и он может открытые рты делать и т.д., раньше это не получалось, вид сбоку он генерит идеально. И никакие лоры дрочить не надо, где еще надо и вращать, и помнить чтоб похоже было. Так что мне лично это нравится больше. Скорей бы в фокус добавили.

Блядский цирк. Кудесники уже месяц трезвонят про ололо новая нейронка супер инпейнт, и никому в голову не пришло просто сообщить, что вышел инпейнт контролнет для сдхл.

Ой, а что тут написано? Мы все и так сидим на фокусе.

Написано контролнет, а что?

Ты читать не умеешь? Как ты 12 лет всех обманываешь?

Если ты думаешь что он лучше, то он хуже.

У меня шесть. Вылет. Не судьба.

Я вижу, что хуже 1.5 версии. Но сам факт блаженных пользователей, убежденных, что sdxl и sd-webui - это две разные нейронки как бы удручает.

модель просто знает тесачка

если в фокус добавят инстант, это будет лучший гуй.

Она созревшая.

Модель.

Вооу, спасибо. Надеюсь заработает в отличие от какой-то destitechInpaint, которая в автоматике тупо не работает, и она еще сомнительные 2гб весит. Как раз искал недавно

Не должно, у меня на 8гб VRAM InstantID идет совместно с обычной генерацией + апскейл в рамках одного воркфлоу.

В крайнем случае, попробуй запустить на твоем пинокио Automatic1111 или ComfyUI и загрузи для них расширения на InstantID (у меня на ComfyUI результаты выдает получше).

Волосики на письке есть?

>если в фокус добавят инстант, это будет лучший гуй.

Если автор не добавит - хач добавит. Инсайтфейс он кеак бы добавил уже, я выше линк кидал. https://github.com/machineminded/Fooocus-inswapper

Но в кал-лабе с его костялми не работает, потому что дебс не вкурсе, что кал-лаб МОДКЛЬ ТО ЗОБАНЕЛ, её надо переименовывать (и все зависимости), а он там прям щас онлайн без смс мокрая писька к носу ильхам зулькарнеев тупит. Но еще он сказал, что добавит инст туда, короче, сидим, ждём, в раскладушку пирдим.

Сам я даже демку инста не смог в кал-лаб скопировать, хотя другие девки копировал и все работало. А щас тупо пишет какую-то хуйню и градио не грузит.

>Я вижу, что хуже 1.5 версии.

Что ты видишь, дебс? Демка крутится на говняной модели от этого же китайца. В пайпллайн посмотри, Ай оф бихолдер, проткнутый.

> проткнутый

Как всегда, спасибо, что подписываешь свои посты.

>я выше линк кидал.

Я пропустил. А можно еще раз?

>Cascade это что блять?

Представь что ты пикрил.

Ты возглавляешь Stability AI.

Ты решаешь выпустить новую модель.

Называешь ее SDXL и делишь ее на две части.

Второй частью (refiner) никто нихуя не пользуется.

Твоя новая модель до сих пор менее популярная чем SD 1.5.

Ты решаешь выпустить новую модель.

Называешь ее Stable Cascade и делишь ее на ТРИ ЧАСТИ.

на дваче какой-то дебил спрашивает >Cascade это что блять?

наступает сегодняшний день.

Там плохой графон, но зато понимает промпты лучше, чем SDXL.

>модель просто знает тесачка

Я тоже подумал, что они в клип какую-то инфу для автотегирования фоток подтянули из интернета, но как ты видишь ниже это только на словосочетании "русский полицейский чиновник" на той фотке. В других вариантах детей нет.

Нельзя.

Ахахпахаха иди нахуй!

Я победил, кажется, систему. надо было всего лишь поднять тут..

тьфу-тьфу.

тьфу-тьфу.

>Твоя новая модель до сих пор менее популярная чем SD 1.5.

Это откровенное вранье довена застрявшего головой в прошлом году. В 2к24 полтораха только для таких как ты и бомжиков. Иди дальше обнимайся со своими сутулыми собаками, а у здоровых пацанов есть стройные жирафы.

>Там плохой графон

Потому что без вае, голая ваниль, на них на всех так.

рычажок дерни и колесико покрути, тогда снова нарисует. только не забудь положения рычажков и колесиков в блокнотик записать

Чет не работает. Скачал все файлы, закинул в модели контролнета, фордж, и нифига, крашится. Ну а конвертированные в обычном webui, не в формате кучу моделей patch, тоже не работают

ну хватит, а

Для ComfyUI сделали специальное расширение чтобы скопировать инпейнт из fooocus.

Там тоже на основе контролнета.

https://github.com/Acly/comfyui-inpaint-nodes

> крашится

А памяти хватает? Эта хуйня прожорливая. Заодно посмотри в консоли, с какой ошибкой крашится.

Зырьте, что выдаёт на такой промпт Anthropomorphic penguin girl holding a sign with a photo of cat

Друки, подскажите, есть ли нормальная лора или чекпойнт/модель, для генерации нормальных вумен-гениталий для SDXL 1.0? Недавно вкатился, пока осваиваю Fooocus, и если с разными лорами/чекпойнтами вид спереди ок, то сзади хуйня какая-то получается. Анусы вообще не генерятся нифига..

Хм. Посмотрел скрины оттуда и пришла некоторая идея.

Получается такая-то подключаемая дура на 11Гб, зато с полноценным инпейнтом где угодно.

Анусы только в аниме-моделях генерятся, увы.

BO IT

YOUR

BEE

CAT.

В реализме лучшее это вот эта пока

https://civitai.com/models/139562/realvisxl-v30

Но у аниме моделей есть гарантированный способ получить анатомически правильную пизду, даже лучше чем на реалистик моделях

https://civitai.com/models/257749

Ты не смотри на то, что это фурри модель, главное аниме-людей тоже может генерить и пизду выдает что надо (рисованную конечно, а че ты ожидал от аниме?)

а смысл?

Спасибо за инфу!

>латент 1980х1080

>всратая вая

Гайд, по которому ты делаешь - говно.

"vae-ft-mse-840000-ema-pruned" - вот это ищи.

Латент выставляется тот, который жрет модель. Так как для тебя найти эту инфу будет нереально. Открываешь менеджер и пишешь "ComfyUI_Comfyroll_CustomNodes"

Устанавливаешь. Идешь по пути с скриншорта. Там для тебя будет все что нужно. Розовенькое тянешь к своему семплеру, вместо "эмпилатентспейс"

С этими нодами какой-то особо охуенной разницы не видно. Но чтобы её детейлеру скормить для инпейнта не всей пикчи, это еще изъебнуться надо с чем-нибудь типа SEGSPreview и подсчетом ресайза, чтобы для нее латент получить. И то гарантии нихуя, ибо детейлер своей жизнью живет и ресайзит, как ему захочется.

А в чем смысл так называемого CLIP Skip, который постоянно советуют то ставить на 2, то не ставить, хуй поймешь. Я ради эксперимента из одного сида сделал сначала картинку со скипом 2, потом с дефолтным 1. И картинки получились ИДЕНТИЧНЫЕ, полностью, даже без микроизменений, какие бывают при смене сэмплера. В чем соль?

Совет использовать клип скип 2 актуален только для файнтьюнов, основанных на сливе NovelAI, который произошёл в октябре 2022 и от которого наследуется подавляющее большинство аниме моделей для 1.5

Буквально первые три минуты глянь: https://www.youtube.com/watch?v=oh2TgZ8eQuU

XL на автоматике/фордже? Он не работает с XL походу, хз что там с кумфи

Ясненько. Зря я значит вообще запаривался по поводу этой настройки.

Да, я как дурак на XL это проверял. Там, походу, вообще эта тема не действует.

Руки переделывал?

А что, слишком палевно? Вроде швов не заметил.

Они же прямо другого цвета, не такие как руки дальше запястья.

Так они же на свету, как и грудь с плечами. А остальное рассеяно крапивой.

Дайте задание. Короткое, можно на русском. Что-то такое, что вы не видели сгенерированное, но интересно было бы посмотреть на попытки. Говорят новая сеть, каскадия, лучше понимает запрос? Хочу сделать что-то мало возможное или трудное в SDXL. Только не что-то типа перевёрнутых людей, текста(понятно, что с этим сейчас не очень), абстракций(например "душа человека") или "эмоции на лице".

Может есть примеры из каскадии, которые показывают что-то, что не возможно или трудное сделать в SDXL?

Может есть примеры из каскадии, которые показывают что-то, что не возможно или трудное сделать в SDXL?

Барак Обама ебет Ленина в жопу.

Литерали каждый второй пик отсюда https://civitai.com/images - фэйлы генерации забившей на промпт.

Там в основном длинные промпты.

С 1гирл и 1.4 справлялась.

Сцена из Титаника. Баба стоит на самом-самом носу корабля, расставив руки в стороны. На фоне заката.

Хардкор режим: сзади стоит парень и обнимает её за талию.

Там ещё есть нода VAE Encode & Inpaint Conditioning.

Через нее можно заэнкодировать имэдж на выход из двух латент, далее нужно будет заново декодировать для Ддетейлера.

Не совсем изящно, но что есть то есть.

Нашел забаву себе: генерю картинки в стиле комиксов или аниме, а потом прогоняю их через инпаинт обычными стилями и получается как фото косплеев лол. Просто такие ракурсы, тела и позы сложно генерить сразу фотографичными, оно как то скучнее делается, а комиксные выглядят эффектно. Но мультяшки конечно лучше смотрятся.

Надо попробовать.

Надо будет попробовать, но что-то подозреваю, что всё равно не то. Если заэнкодить 4к пикчку целиком и передать модель детейлеру он же не разберется, что какой кусок ему надо, т.к. он только вырезанный кусок получает и сам апскейлит? Или я не так понимаю?

Так себе задачка. Добавить закат и терпение, и можно целый титаник нароллить, вместо лодки.

scene from titanic movie, wide shot of happy mona lisa spreading her arms apart and being groped by a man behind her while standing on the bow of the ship while BREAK film still from 80s b-movie . highly detailed, panavision, moody, foggy film, soft glare, cold colors, sharp focus, film grain, grainy

Negative prompt: boring, blurry

Steps: 24, Sampler: DPM++ 2M SDE Heun Karras, CFG scale: 18, Seed: 3026400261, Size: 1536x640, Model hash: 368bcd108f, Model: epicrealismXL_v10, RNG: CPU, dynthres_enabled: True, dynthres_mimic_scale: 1, dynthres_threshold_percentile: 1, dynthres_mimic_mode: Power Down, dynthres_mimic_scale_min: 0, dynthres_cfg_mode: Power Down, dynthres_cfg_scale_min: 0, dynthres_sched_val: 4.5, dynthres_separate_feature_channels: enable, dynthres_scaling_startpoint: MEAN, dynthres_variability_measure: STD, dynthres_interpolate_phi: 0.7, Discard penultimate sigma: True, Version: f0.0.12-latest-155-gd81e353d

Две девушки едут на велотандеме. Зимой.

Скорость 2 вместо Титаника.

Как у тебя легко выходит-то, обычно заебешься взаимодействие двух персонажей делать, а тут просто написал, что мужик сзади хватает, и он стоит сзади и хватает.

>CFG scale: 18

И как у тебя с этим пережарки не происходит?

dynthres_enabled

Работает так же, как и стороннее расширение для а1111. Для комфи тоже есть.

Алсо, если будешь писать hugging, получится хуйня. Нужно именно groping.

>Две девушки едут на велотандеме. Зимой.

side view of two girls go on (cycle tandem:1.7). In winter.

Как ехоть? Трудное задание.

Чому они поперёк дороги ride a bike?

Так вопрос - можно уже каскад запустить?

>каскад

Шиза, тебя уже твой opendale отпустил?

У тебя уже новая навязчивая идея?

Шо?

>Дайте задание.

Тред тому назад: "Калиточник, иди на хуй со своими челенджами, мы тут все, как один свободные художники, генери, что хотим, засунь свою тематику себе в жопу, пок-пок-покаааа...."

Мнение?

Не знаю, я сейчас локально потестил и у меня говно какое-то вышло. Ещё и на стопы не натренировали. Далеко пиздец до DALLE-3

Приветствую местных.

Подскажите сервис какой-нибудь, чтобы можно было загрузить кастомное изображение и и получить что-то крутое и плюс-минус реалистичное.

В частности вот этот результат очень понравился

но я не нашел как в инпаинте такое делать, возможно, я наткнулся на не тот инпаинт.

Подскажите пару простых сервисов, плз.

Спасибо.

Подскажите сервис какой-нибудь, чтобы можно было загрузить кастомное изображение и и получить что-то крутое и плюс-минус реалистичное.

В частности вот этот результат очень понравился

но я не нашел как в инпаинте такое делать, возможно, я наткнулся на не тот инпаинт.

Подскажите пару простых сервисов, плз.

Спасибо.

С первого раза. Фокус же сдхл? Но уверен, что это дело попыток, наверное если поролить, то тоже будет ошибаться. Проверил, да ошибается.

Челик в киберпанковом доспехе несет на руках тяночку с синей кожей, желтыми глазами и белыми волосами, кадр из фантастического фильма.

привет из DALL-E треда

У меня fooocus. Ставится и работает из коробки сразу на компе локально и он очень простой. Я давно ставил сам по гайду какому-то с ютуба, скорей всего в шапке есть актуальные ссылки. Инпаинт тоже оттуда. Ну вот гайд, вдруг кому ещё интересно:

1. пишешь промт. Если хочешь ноги, то лучше описать что-то про них, а то будет портрет. Например ботинки, каблуки или как у меня колготки. Выбираешь в стилях что-нибудь не реалистичное, например comic. Генеришь и когда что-то нравится нажимаешь инпут (1), перетаскиваешь туда готовую картинку (2) или сразу можешь туда перетащить свою, затем выбираешь либо vary (strong), если картинку хочешь поменять посильнее, либо vary (subtle) чтобы "оживить" её.

2. Ну и потом в стилях выбираешь уже более реалистичные пресеты какие хочешь. Не уверен что там много ставить имеет смысл, как у меня. Если картинка сильно комиксная или аниме, то лучше прогонять несколько раз - посчитал, снова перетащил и уже её снова перегоняешь и так дальше, пока не станет как фотка. Лучше количество генераций побольше поставить, чтобы было из чего выбирать и куда дальше развиваться. В промтах желательно оставлять исходный текст (хотя тут хз), а то у меня в последней дьяволица превратилась в кошку, т.к. там только cat случайно оказалось написано.

3. Для примера дописал latex, pale skin в промт и прогнал несколько раз. Но тут надо учитывать, что чем больше прогонов, тем дальше будет от исходника, что очевидно.

Ну вот собственно и весь гайд для начинающих.

Ну и если где-то свернул не туда, то можно не боятся. Если кто не в курсе, то фокус ВСЕ генерации сохраняет к себе в папку:

\Fooocus_win64_2-1-791\Fooocus\outputs\

Ну и да, я сам новый в этом и ничего особо не знаю. Если кто мне хитрости по фокусу подскажет или расскажет, что он говно и надо ставить сд или автоматик, то интересно будет послушать.

Скажите, а есть ли какой-то способ перенести выражение лица с одного портрета на другой. Для видюшек есть Thin Plate Spline, который это делает. Но он, кажется, не умеет переносить со статичной картинки, только с видео может или я просто тупой, хз.

Если возможность хоть какую то копеечку заработать на генерации картинок?

Так а нахуй, балерина, ты к прогерам поперлась? Сиди в своем загоне.

Какую блядь? По памяти режут все свежие, или ты с 4090 капчуешь? Нету ни видеокарт ни игорей нормальных!

Почему нет?

А что умеешь что не умеют другие генеральщики с пиксива.

ПИСЯ ПОПА

ПОПА ПИСЯ

Нету. В инстаграмах уже лет 10 есть такая опция по изменению выражения лица, а в опенсурсе простого ничего нету. Только AR библиотеки, где это все самому надо разрабатывать

Вы с чего решили, что проблема именно в такой руке - ясно показанной с четко разделенными пальцами? С такими косяки лишь изредка бывают. Крышу нейронке сносит из-за переплетения пальцев.

Ну так openpose - face + prompt

Openpose_faceonly для кого придумали?

Какая лажа, блядь...

Как мне этот поможет сделать так, чтобы у женщины на первом пике стало такое же выражение лица, как у женщины на втором пике?

Скажи, что она жирная

Ну это свап лица. Речь про эмоцию, выражение лица

>свап лица

с эмоцией

Ты хотел кореёзу, получи - распишись...

Блять, есть просто faceapp, только опенсорсный?

У азиатов лица другие, и улыбаются они по своему.

Задание ебанутое.

Подключи к генерации InstantID, скопировав лицо женщины с первого пика и используя его для инпейнта картинки с маской нанесенной на лицо.

Если еще короче: пошевели извилинами.

Это не замена выражения на картинке.

>к прогерам поперлась

>Stable Diffusion тред

И вот так, при помощи двух контролнетов, ип-адаптера и легких предварительных манипуляций в гимпе мы получаем faceapp.

sarcasm mode off

Никаких фейсвапов-хуяпов

поднял денойз на 0.01 и уже другое выражение

Чекпоинт?

Уже есть сайт который ворует контент с ИИ патреонов.

> пик

А ведь кто-то реально за это платит...

Зачем разработчики пишут в названии "Stable"? Ни хуя не стабильно же, ррря-я-я.

Вообще, неплохо, конечно.

телки с сиськами и пиздой

Красивые телочки, телочки это всегда хорошо.

Одетый мужчина, голый женщина.

Помнится, анон в треде хотел целую лору для этого тренировать, а оно и так из чистого промта получается без проблем

Помнится, анон в треде хотел целую лору для этого тренировать, а оно и так из чистого промта получается без проблем

Меньше видеопамяти, меньше размер, быстрее особенно тренировка, лучшее понимание контекста, лучше результат для ванили.

Сап, котаны. Начал понемногу изучать для себя Стаблу, решил стартануть с Фокуса и постепенно доползти до ComfyUI. Хочется стилизовать-генерить видосики да оживдять картиночки, дабы прийти в итоге к релейтед ролику (там автор использовал Animatediff и ComfyUI). Вопросов пока два:

1) Можно в этом покус-кокусе сделать так, чтобы генерируемое тобой определенное кол-во изображений сильно отличалось по крупности планов и РАЗНООБРАЗИЮ СЮЖЕТОВ соотв? Идея - каким то общим промптом быстро накидать раскрытие темы. Типа вот я ввожу "Продюсирование" или "Природа" и получаю различные олицетворения данных явлений, а не кучу блять камер крупняком или баобаб с разных углов.

2) Кстати да, баоБАБ - почему при использовании определённых стилей он начинает мне генерить одних женщин, при этом даже ИГНОРИРУЯ негативный промпт "womans"?

1) Можно в этом покус-кокусе сделать так, чтобы генерируемое тобой определенное кол-во изображений сильно отличалось по крупности планов и РАЗНООБРАЗИЮ СЮЖЕТОВ соотв? Идея - каким то общим промптом быстро накидать раскрытие темы. Типа вот я ввожу "Продюсирование" или "Природа" и получаю различные олицетворения данных явлений, а не кучу блять камер крупняком или баобаб с разных углов.

2) Кстати да, баоБАБ - почему при использовании определённых стилей он начинает мне генерить одних женщин, при этом даже ИГНОРИРУЯ негативный промпт "womans"?

Фокус для совсем простофиль.

Если в нем разобрался, можешь перейти на новый Forge (который является более производительной копией Automatic1111).

1) прописывай планы в сам промпт. Если не хочешь каждый раз менять слово в промпте, можешь настроить вайлкард. Можешь снизить также CFG чтобы нейронка больше отходить от промпта.

2) стили это ни что иное как просто камбинации слов для добавления в промпт. В фокусе такое сделано для тех, кто не может сообразить и написать в промпт теги, которые будут описывать определенный стиль. Но лучше самому учиться и понимать, какие слова могут "вызвать" женщин, а какие нет, со стилями в Фоокусе ты так и не поймешь какие наборы тегов используются для каждого "стиля".

Алсо учись добавлять вес слову, к примеру напиши в негатив ,(woman:1.3),

я думаю что есть. но пути не прямые.

я сделал что, я взял свои всратые фотки на нищенский телефон. взял рефейс. и напилил себе хорошие фотки. залил в дайвинчик и охуел. 2/3 взаимных лайков.

за 2 недели даже пару раз поебался с новыми тянками. чего не было в моей жизни лет так с 25.

и вот подозреваю, что если провернуть тот же фокус с сгенерированной тянкой, создать ей социальную жизнь в соц сетях, то можно общаться и собирать донаты от рабов пизды.

но я пока не пробовал. но многие так делают. епте, на онлифансе и в инсте некоторое количество моделей оказалось сгенерированными.

в такое время живем

>поебался с новыми тянками

чет проорал

Этого не слушай. У них, в комфи, нет такого как пресеты стилей и потому отрицается ими.

По пути Fooocus\sdxl_styles находятся файлики в которых прописаны эти все стили. Открывай их просто в блокноте. Твой промпт, при добавлении стиля, будет подставляться вместо слова {prompt}. Это очень удобно.

Более того ты сам можешь сделать подобные файлики со своими стилями и они появятся в интерфейсе Fooocus. Это мега шикарно.

Pony V6 на сдохле, лора для неё на oil painting

Пиздец, стабле каскад весит 34 гигабайта

>У них, в комфи, нет такого как пресеты стилей и потому отрицается ими.

Стили везде есть, и в поломатике, и в комфи. Фуукус просто с набором уже готовых идёт.

Как считал?

Выложили её на цивитае, там написано.

Они выпустили еще bf16 и lite версию, а также их комбинацию.

Если брать совсем эконом (lite + bf16), то получается

stage_a (73 MB) + stage_b_lite_bf16 (1.4 GB) + stage_c_lite_bf16 (2 GB) = 3.4 GB, что не много.

Правда мы пока не знаем, какие будут потери качества у данной эконом версии нейроносодержащего продукта.

До субботы обещали завести официальную поддержку на ComfyUI, которая по слухам может быть по VRAM экономнее чем даже XL на этой версии.

Если брать совсем эконом (lite + bf16), то получается

stage_a (73 MB) + stage_b_lite_bf16 (1.4 GB) + stage_c_lite_bf16 (2 GB) = 3.4 GB, что не много.

Правда мы пока не знаем, какие будут потери качества у данной эконом версии нейроносодержащего продукта.

До субботы обещали завести официальную поддержку на ComfyUI, которая по слухам может быть по VRAM экономнее чем даже XL на этой версии.

Ну это скорее всего какие-то случайны люди решили сыграть в заливаторов, так как стабилити сами на civitai ничего не публикуют.

Может люди не разобрались как собирать модель из разных версий.

Пикрил сюда

Суммарно все версии что ли посчитал? А мозг включить не?

Ну, комплект из обычного фп16 без "лайт" весит десять с четвертью, с третьей стадией в 7 гигов, думаю, на него стоит ориентироваться.

>пресеты стилей

Костыль, на котором не научишься правильно составлять промпты.

>Костыль

Это называется прогресс, дяденька)

> я взял свои всратые фотки на нищенский телефон. взял рефейс. и напилил себе хорошие фотки.

Можно вокрфлоу с названиями моделей, дополнений и т.п.?

>Фокус для совсем простофиль.

Да я на большее и не претендую, надо руку набить.

>новый Forge

А там я смогу

>генерируемое тобой определенное кол-во изображений сильно отличалось по крупности планов

или таки придётся в промт прописывать для каждой пикчи отдельно? У меня задача - сказал "природа" - получил всякой разной соотв хуйни, а не как в моём случае один объект в разных вариациях.

>вайлкард

Ето что?

>какие слова могут "вызвать" женщин

Да я уже посмотрел в outputs, охуеть как понятно откуда там бабы лезут... Хотяяя, кажется я понял, судя по истории генераций и папке sdxl_styles, спасибо , был виноват стиль Fooocus Masterpiece. Но вот уже при следующем РАССЛЕДОВАНИИ (пик не влезает) я вижу, что бабы полезли всего при двух 'SAI Digital Art', 'MRE Comic', а у этих стилей нет ничего релевантного, чтоб мне выдало 3 полуголых бабы и 1 средневековый сука замок лол. У них "breathtaking illustration from adult comic book presenting {prompt}. fabulous artwork. best quality, high resolution", и digital artwork, illustrative, painterly, matte painting, highly detailed", Тут получается только adult comic сработало? Да это же пиздец, я охуею так 200 стилей перебирать, не понимая что откуда куда лезет...

>Алсо учись добавлять вес слову, к примеру напиши в негатив ,(woman:1.3)

Попробовал ещё на простейшем примере с котами на дереве - ему похуй, перепробовал разные варианты, он игнорирует и всё равно делает котов с белой шерстью. Как и изначально я не смог сгенерировать Аянами Рей без японского ебла, как только ни прописывая (asian)...

>Твой промпт, при добавлении стиля, будет подставляться вместо слова {prompt}. Это очень удобно.

Не понял, что именно удобно? Ок, вижу я внутрянку стиля, где

>"prompt": "Abstract Expressionism Art, {prompt}, High contrast, minimalistic, colorful, stark, dramatic, expressionism",

и что такого? Удобство в том, чтобы я, как сейчас, по айпи своих ЖЕНЩИН вычислил?

>сам можешь сделать подобные файлики

О, а это пиздато, да.

я особо не заморачивался анон.

модель epicphotogasm брал.

для замены лица ReActor использовал. он не плох, не хорош. придется перебрать несколько фоток своих. с каких то хорошо лицо улавливает. с каких то не очень. у меня максимальная похожесть вообще была с фотки где я полубоком стою хуйте где.

потом еще контролнет использовал, чтоб фон пофиксить в инпейнте

>ReActor

Эта древняя, через жопу работающая залупа могла только с древней версией пайторча. Ты хочешь сказать, что не обновлял свою полтораху больше, чем год как минимум? Либо, ты просто пиздишь, как дышишь) Топлю за второе))

Я не совсем понял, чего он там написал, но нормальные годные фотки на знакомствах - половина успеха. Я за год на знакомствах где-то штук 20 встретил и 8 тянок переебал, прежде чем нашёл свою жену стройняшу, умную, с 3м размером груди и на 7 лет моложе.

А всё потому, что у меня фотки были красивые, ну и я не урод, хоть и карлан, жена на 10см выше, но я пользовался лайтрумом и зеркалкой, а были бы нейросети, то наверное проще было бы всё это лол. Это было 8 лет назад лол, тогда нейросетей не было вроде в общем доступе.

Господи, как же тяжело заставить SDXL нарисовать простейшую позу с руками за спиной, это пиздец какой-то. Я уже забелся промт подбирать, чтобы это работало стабильно. Раз в сотню картинок удается на чистом рандоме, потом с тем же промтом - нихуя. Речь про реалистик модели, конечно, с анимешными вряд ли такие проблемы есть.

Это просто ПИЗДЕЦ.

https://openai.com/sora

Prompt: Reflections in the window of a train traveling through the Tokyo suburbs.

https://openai.com/sora

Prompt: Reflections in the window of a train traveling through the Tokyo suburbs.

Ну и нахуй это говно с тотальной цензурой и неграми нужно?

Стиль Fooocus V2(пик4) в Фокусе описан на гитхабе, как что-то типа маджик на гпт2 расширяющий промпт. На самом деле, я думаю, там что-то рандомно накидывает бьюти-слова. Если хотите что-то страшное, то этот стиль будет мешать. Надо отключать и еще он включен по умолчанию. Может кто-то в дискуссии на гитхабе им навалить про это?

пик2 с V2 стилем, пик3 отключен.

пик2 с V2 стилем, пик3 отключен.

Тоже хотел сюда закинуть. Конечно, вряд ли оно хорошо слушается промпта, будет делать вразнобой хуиту, которую трудно контролировать, да и к мощностям будет требовательно наверняка. Лет 5-7 пройдет, пока на рядовой среднекартофельной пекарне заведется. А иначе зачем оно нужно, у корпокрадов сидеть. Но потенциал колоссальный, конечно. Крутая штука.

>на новый Forge

В колабе работает?

>Ето что?

Текстовый файл со всеми словами на определенную тему, к примеру та же природа, из которой случайно выбирается одно слово и вставляется в промпт, чем больше вайлкардов вставишь на разные темы, тем больше вариации будет.

Говорю же, это для тех кому нужно написать несколько слов и потом получится результат на который они скажут заебись, но при этом понимание того как промпт влияет на генерацию они не получат.

>Мам, я хочу чтобы вот этот был CEO Stability.

>Тише, у нас уже есть CEO дома.

>CEO дома:

>Тише, у нас уже есть CEO дома.

>CEO дома:

Вот это фокус-покус 😁 Гениально

Какой же твитер всетаки помойка

+15 руб.

В РАХЕ ВВОДЯТ УГОЛОВКУ ЗА ДИПФЕЙКИ

Предложения готовит Минцифры совместно с МВД и Роскомнадзором, сообщает (https://storage.googleapis.com/gsc-link/47956998.html) издание. 1 ноября их планируют представить правительственной комиссии под председательством главы МВД Владимира Колокольцева.

О наказаниях за дипфейки говорили и в Госдуме в конце января 2024 года. Тогда председатель комитета Госдумы по информационной политике Александр Хинштейнзаявил, что в России может быть введена ответственность за несанкционированное использование чужого голоса и изображения.

По мнению экспертов, опрошенных «Ведомостями», единственным вариантом защиты от неправомерного использования дипфейков может служить маркировка материалов, созданных с использованием искусственного интеллекта, которую должен устанавливать сам разработчик технологии.

Пока дипфейки в России выявляют вручную, а вопрос их использования законом не регулируется. При этом юристы, с которыми поговорило издание, отмечают, что в российском законодательстве уже есть понятия обмана и злоупотребления доверием, поэтому за использование дипфейков и сейчас можно привлечь к ответственности, например, за мошенничество, в том числе в сфере компьютерной информации.

При этом дипфейки в России используются, помимо прочего, для дискредитации выступающих против войны. Так, в конце ноября о звонках с использованием дипфейка якобы от имени главы офиса президента Украины Андрея Ермака рассказали писател Дмитрий Быков и актер Артур Смольянинов.

Предложения готовит Минцифры совместно с МВД и Роскомнадзором, сообщает (https://storage.googleapis.com/gsc-link/47956998.html) издание. 1 ноября их планируют представить правительственной комиссии под председательством главы МВД Владимира Колокольцева.

О наказаниях за дипфейки говорили и в Госдуме в конце января 2024 года. Тогда председатель комитета Госдумы по информационной политике Александр Хинштейнзаявил, что в России может быть введена ответственность за несанкционированное использование чужого голоса и изображения.

По мнению экспертов, опрошенных «Ведомостями», единственным вариантом защиты от неправомерного использования дипфейков может служить маркировка материалов, созданных с использованием искусственного интеллекта, которую должен устанавливать сам разработчик технологии.

Пока дипфейки в России выявляют вручную, а вопрос их использования законом не регулируется. При этом юристы, с которыми поговорило издание, отмечают, что в российском законодательстве уже есть понятия обмана и злоупотребления доверием, поэтому за использование дипфейков и сейчас можно привлечь к ответственности, например, за мошенничество, в том числе в сфере компьютерной информации.

При этом дипфейки в России используются, помимо прочего, для дискредитации выступающих против войны. Так, в конце ноября о звонках с использованием дипфейка якобы от имени главы офиса президента Украины Андрея Ермака рассказали писател Дмитрий Быков и актер Артур Смольянинов.

>Твой промпт, при добавлении стиля, будет подставляться вместо слова {prompt}. Это очень удобно.

СУУКА! Я не особо разбирался с фокусом, но думал что стили это какой-то аналог лор, а это оказывается пресеты промптов - пиздец!

В какой-то степени удобная штука, особенно если вайлдкарты в неё интегрировать. Но я всё равно разочарован.

Алсо, кто разобрался с фокусом, есть в нем возможность автоматизировать апскейл, чтобы сразу после генерации, каждая пикча автоматически апскейлилась Х2? И можно ли туда как-то прикрутить нормальный апскейлер?

>прикрутить нормальный

А такие существуют?

>но при этом понимание того как промпт влияет на генерацию они не получат

Да что ты говоришь? У тебя наверняка есть любимый негатив, который ты..из блокнотика вставляешь? Или каждый раз набираешь его по памяти?

Google не догодались забанить Stable Cascade Коллаб вернулся

https://colab.research.google.com/drive/1XmOScAU_0kjvlQ6veRKhS0cs--f2jTQr

https://colab.research.google.com/drive/1XmOScAU_0kjvlQ6veRKhS0cs--f2jTQr

> Коллаб вернулся

А он никуда и не уходил, как генерил в автоматике в колабе , так до сих пор работает.

YES

Мне даже хайрезфикс автоматика бы подошел.

>OutOfMemoryError: CUDA out of memory. Tried to allocate 32.00 MiB. GPU 0 has a total capacity of 14.75 GiB of which 5.06 MiB is free. Process 7729 has 14.74 GiB memory in use.

Видимо не для нищуков эта приблуда.

Простите за тупой вопрос, но меня он беспокоит.

Модели лоры в stable diffusion работают в песочнице? Они могут выполнять функции выходящие за рамки рисования, например шариться по моей системе? Если да, есть ли модерация моделей на civitai?

Не получится ли так, что я подключу модель для рисования жоп, а она найдет мой файл браузера с форм-паролями и перешлет его автору лоры?

Модели лоры в stable diffusion работают в песочнице? Они могут выполнять функции выходящие за рамки рисования, например шариться по моей системе? Если да, есть ли модерация моделей на civitai?

Не получится ли так, что я подключу модель для рисования жоп, а она найдет мой файл браузера с форм-паролями и перешлет его автору лоры?

>I suggest you use an A100 for this one

Модели в формате .safetensors не могут, так как это чистые тензоры нейронки.

А все что в другом формате может содержать в себе не только тензоры, то есть сторонний код.

Если модель или лора safetensor, то должна быть защищена от такой хуйни. Если нет, то внутри может быть что угодно, да.

Заебись, спасибо.

я недели как две вкатился вообще. до этого думал что ну нейросеть это смешные картинки в дискорде делать.

скачал автоматик портабл. посмотрел на ютубе че с этим делать. там нашел roop. не смог установить. зато смог установить reAktor. работает без пердолинга.

и все. ничего ни куда я не обновлял. не понимаю о чем ты говоришь

Что, опять закон, который мешает только законопослушным гражданам?

>поэтому за использование дипфейков и сейчас можно привлечь к ответственности

И опять закон лишний. Число законов надо сокращать, а не раздувать.

Как сделать чтобы тег влиял только на n-количество шагов, в комфи?

Половину шагов будет one two three, остальные будет one three. Ну или есть кастом нода, которая имитирует поведение а1111 и ебашит это всё прямо из промпта, в прошлом или позапрошлом треде кто-то показывал её.

Пиздец, а просто через промпт нельзя это сделать?

> есть кастом нода, которая имитирует поведение а1111 и ебашит это всё прямо из промпта, в прошлом или позапрошлом треде кто-то показывал её

Вот эта нода должна работать так же как и чтение промпта в Автоматике1111

https://github.com/shiimizu/ComfyUI_smZNodes

есть смысл вообще проходить курсы SD, компом практически не пользовался,( винда для меня что то уже далекое стало, привык пользоваться IOS ) сейчас для работы понял что в перспективе нужны эти знания, инфы рил много разной о SD с какой стороны зайти хз

нашел курсы за 15 тр .брать нет хз

нашел курсы за 15 тр .брать нет хз

Да, курсы хорошая тема, можно стричь бабло с лохов типа тебя.

Спасибо, поставил. Еще вопрос какой самый правильный способ найти нужные ноды? По названию они явно не ищутся.

Блять что за бред, нигде не вижу упоминаний того что эта модель должна работать в автоматике.

Троллинг какой-то, у меня даже модель в контролнете не появляется.

анонче, почему 2ая картинка из батча генерится в сто раз медленнее

>инпейнт контролнет для сдхл

Похуй на инпейнт, как там с тайловым?

>курсы SD

>за 15 тр

Скажите что это троллинг такой.

Врам чекай, кончился небось.

Неплохо.

> как там с тайловым?

Нихуя. Полгода висит его пост, что он вот-вот планирует делать.

10 гидроцефалов из 10.

Лол. Ну что ж, сколько там времени прошло уже с выхода сдохли? Оказалась, она нахуй не нужна, как и предсказывали с самого начала.

Ору я с этого Стейбл Каскада. Иногда он неплохо делает, но иногда полную дичь с анатомией воротит. По первому впечатлению, он хорошо всякие казуальные портретики и халфбади шоты делает. А вот с полным телом у него беда. Плюс, сиды сильно похожи друг на друга, в полторахе больше разнообразия. На полную я его вряд ли покрутил, но делюсь тем, что смог накрутить. С промптами сильно не мудрил, они довольно простые.

Ее даже с цензурой и неграми ширнармассам не дают. Только цензорам и особо доверенным соевикам.

>Today, Sora is becoming available to red teamers to assess critical areas for harms or risks. We are also granting access to a number of visual artists, designers, and filmmakers to gain feedback on how to advance the model to be most helpful for creative professionals.

>assess critical areas for harms or risks

Я могу дать оценку сразу- никакого ёбанного вреда нет и быть не может, снимаем фильтры и в прод.

А какими эксеншинами вы пользуетесь?

Есть ли такое дополнение, чтобы кнопку "generate" не жать каждый раз, а сгенерировать нужное кол-во изображений?

Есть ли такое дополнение, чтобы кнопку "generate" не жать каждый раз, а сгенерировать нужное кол-во изображений?

Batch count

1,3 Старые ноды.

2,4 Новые ноды.

Пикчи пережаренные получаются с этими нодами.

НИХУЯСЕБЕ

МОАР!!!!!!!!!!!

Анончики, помогите плз, я уже не могу............. Кто-нибудь шарит за AnimateDiff + PromptTravel? Весь день ебусь с этим говном - нихуя не заводится как надо.

Установил всё по гайдам - для работы всё есть. Алгоритм - открываю Pinokio, в чекпоинт использую дефолтную sd_xl_base_1.0 в модель вставляю animatediffMotion_sdxlV10Beta, по итогу - хуй. В консоли: The file may be malicious, so the program is not going to read it. Хотя брал вот с civitai, верифицировано, все качают. Спасибо нахуй. Ок, пробую другую комбинацию, что мне подсказал автор тутора и что, судя по civitai (одно прям ссылается на другое) точно друг с другом работает: fantasticmix_k1 + vae-ft-mse-840000-ema-pruned, в итоге - куча картинок кошек +- похожих, но не анимация ни разу. В консоли: куча всякого говна и что-то о том, что AnimateDiff не подцепился. Ок. ЕДИНСТВЕННЫЙ заработавший вариант это dreamshaper_8+классическаяmm_sd_v15_v2, который в итоге всё равно выдаёт мне ОДНУ ССАНУЮ КОШКУ. При этом в консоли ни в одном из случаев (хотя может плохо смотрел, здесь же сука нету нормального лога в текстовый файл, где можно поиском пройтись) я никакого упоминания PromtTravel не наблюдаю, хотя вроде должен. И это я не говорю уже о сложной сцене (3 пик), где я пытался то самое ПРОДЮСИРОВАНИЕ отобразить через промпты разных сюжетов - один хуй всё в одно склеил. АПРфынгпшфнпынф, как эту ссань всю завести??? ПАМАГИТЕ

Установил всё по гайдам - для работы всё есть. Алгоритм - открываю Pinokio, в чекпоинт использую дефолтную sd_xl_base_1.0 в модель вставляю animatediffMotion_sdxlV10Beta, по итогу - хуй. В консоли: The file may be malicious, so the program is not going to read it. Хотя брал вот с civitai, верифицировано, все качают. Спасибо нахуй. Ок, пробую другую комбинацию, что мне подсказал автор тутора и что, судя по civitai (одно прям ссылается на другое) точно друг с другом работает: fantasticmix_k1 + vae-ft-mse-840000-ema-pruned, в итоге - куча картинок кошек +- похожих, но не анимация ни разу. В консоли: куча всякого говна и что-то о том, что AnimateDiff не подцепился. Ок. ЕДИНСТВЕННЫЙ заработавший вариант это dreamshaper_8+классическаяmm_sd_v15_v2, который в итоге всё равно выдаёт мне ОДНУ ССАНУЮ КОШКУ. При этом в консоли ни в одном из случаев (хотя может плохо смотрел, здесь же сука нету нормального лога в текстовый файл, где можно поиском пройтись) я никакого упоминания PromtTravel не наблюдаю, хотя вроде должен. И это я не говорю уже о сложной сцене (3 пик), где я пытался то самое ПРОДЮСИРОВАНИЕ отобразить через промпты разных сюжетов - один хуй всё в одно склеил. АПРфынгпшфнпынф, как эту ссань всю завести??? ПАМАГИТЕ

Жирные, потные лица(магический промпт): froome oxycephaly girl on fecklessness, art by ajhar

Полуосьмеричные дорийцы с несостоятельными парамагнетиками на первом курсе, чокнутые, гувервильские, искусство семиовоидальных.

suboctuple dorians with untenable on paramagnetic in freshmanship, gonked, hooverville, art by semiovoidal

suboctuple dorians with untenable on paramagnetic in freshmanship, gonked, hooverville, art by semiovoidal

Конечно, ведь в ComfyUI и A1111 по разному читаются весы.

Хотя странно, учитывая что в варианте A1111 должно работать усреднение весов в промпте.

В общем 4-ый пик это настройки, которые должны наиболее точно имитировать автоматик (кроме CFG, он на нем тоже по другому чуть скейлится).

Ну попробуй поставить Closed loop на N и Frame interpolation на FILM

Ты походу на Forge запускаешь да?

> 2 пик

А можно попросить нейронку нарисовать в анфас и профль этого монстра, чтобы замоделить?

НОВАЯ ЭРА STABLE DIFFUSION (пук)

1. ComfyUI запилил поддержку Stable Cascade (да и похуй).

2. НАКОНЕЦ-ТО ВЫПУСТИЛИ КОД ДЛЯ X-ADAPTER

АВТОР ГОВОРИТ, ЧТО С ПОМОЩЬЮ НЕГО МОЖНО ИСПОЛЬЗОВАТЬ ЛОРЫ И КОНТРОЛНЕТЫ (да, Tile контролнет тоже) ДЛЯ SD 1.5 НА SDXL.

https://github.com/showlab/X-Adapter/tree/main

Сам не пробовал конечно, пук среньк.

1. ComfyUI запилил поддержку Stable Cascade (да и похуй).

2. НАКОНЕЦ-ТО ВЫПУСТИЛИ КОД ДЛЯ X-ADAPTER

АВТОР ГОВОРИТ, ЧТО С ПОМОЩЬЮ НЕГО МОЖНО ИСПОЛЬЗОВАТЬ ЛОРЫ И КОНТРОЛНЕТЫ (да, Tile контролнет тоже) ДЛЯ SD 1.5 НА SDXL.

https://github.com/showlab/X-Adapter/tree/main

Сам не пробовал конечно, пук среньк.

как теперь уснуть

Вот придумал задание. Сам с ним ебался долго и все тщетно. Может ты какие-то секреты знаешь. Короче, сцена сожжения ведьмы на костре. Ведьма стоит привязанная к столбу, руки за спиной, под ней костер горит, ведьма орет, ну или стоически терпит с напряженным ебалом. Самое главное, чтоб она выглядела именно привязанной с руками за спиной, вот этого я никак не смог добиться, хоть расшибись. Костер, горящая баба, орущее ебло - это все без проблем. Но чтобы она при этом была привязана - ну просто, сука, никак. Она у меня постоянно руками махала как ебанутая.

Вообще, как обычно. Но ты можешь попробовать в такой же позе, как на пиках.

https://github.com/AUTOMATIC1111/stable-diffusion-webui/discussions/14942

1.8.0-RC #14942

Features:

Update torch to version 2.1.2

Soft Inpainting (#14208)

FP8 support (#14031, #14327)

Support for SDXL-Inpaint Model (#14390)

Use Spandrel for upscaling and face restoration architectures (#14425, #14467, #14473, #14474, #14477, #14476, #14484, #14500, #14501, #14504, #14524, #14809)

Automatic backwards version compatibility (when loading infotexts from old images with program version specified, will add compatibility settings)

Implement zero terminal SNR noise schedule option (SEED BREAKING CHANGE, #14145)

Add a [✨] button to run hires fix on selected image in the gallery (with help from #14598, #14626, #14728)

Separate assets repository; serve fonts locally rather than from google's servers

Official LCM Sampler Support (#14583)

Add support for DAT upscaler models (#14690)

Extra Networks Tree View (#14588, #14900)

NPU Support (#14801)

Propmpt comments support

1.8.0-RC #14942

Features:

Update torch to version 2.1.2

Soft Inpainting (#14208)

FP8 support (#14031, #14327)

Support for SDXL-Inpaint Model (#14390)

Use Spandrel for upscaling and face restoration architectures (#14425, #14467, #14473, #14474, #14477, #14476, #14484, #14500, #14501, #14504, #14524, #14809)

Automatic backwards version compatibility (when loading infotexts from old images with program version specified, will add compatibility settings)

Implement zero terminal SNR noise schedule option (SEED BREAKING CHANGE, #14145)

Add a [✨] button to run hires fix on selected image in the gallery (with help from #14598, #14626, #14728)

Separate assets repository; serve fonts locally rather than from google's servers

Official LCM Sampler Support (#14583)

Add support for DAT upscaler models (#14690)

Extra Networks Tree View (#14588, #14900)

NPU Support (#14801)

Propmpt comments support

Посмотрел на голых девок и возбудился, теперь стояк спать мешает?

> ComfyUI запилил поддержку Stable Cascade

> Make Stable Cascade work on old pytorch 2.0

Торча 1.13.0 не завезли.

А X-ADAPTER то завезли в комфи?

Кот, ты что делаешь под водой? Ты же кот, ты даже не можешь там дышать!

affirmances morisonianism's with muttonheads on khutba in taffies, harpersfield, profferers, art by pil

>3

Лесной драугр на костылях.

grotesque eclectic hardening 2 neutrino boogaloo sprinkled with bauhaus leitmotifs, art by oompa loompa

>Closed loop

>Frame interpolation

Так это вообще не должно влиять, особенно интерполяция. Это крутят, когда уже есть какой-то результат.

>на Forge запускаешь

Через Пинокио: https://pinokio.computer/

Несмотря на проходе через два Ксэмплера в ComfyUI bf16 Stable Cascade генерит в lowvram mode быстрее чем SDXL в medvram mode с одним сэмплером.

Только я одно не могу понять, с какого хуя позитивный промпт заходит в negative на stage_b и почему stage_c идет перед stage_b?

Только я одно не могу понять, с какого хуя позитивный промпт заходит в negative на stage_b и почему stage_c идет перед stage_b?

А, всё, ясно, я ебло........... Внимательнее изучил консоль - ему требовался сука установленный КОНТРОЛНЕТ)))))))00000

Поехавший реквест.

Пожалуйста, попробуйте сгенерировать портрет молодого Венсана Касселя (или человека с похожей внешностью) в цветастом платочке, как у Алёнки с обертки шоколада. Венсан должен держать на руках маленького козлёнка (!). И чтобы портрет выглядел как библейская картина эпохи Возрождения.

Большущая благодарность!

Пожалуйста, попробуйте сгенерировать портрет молодого Венсана Касселя (или человека с похожей внешностью) в цветастом платочке, как у Алёнки с обертки шоколада. Венсан должен держать на руках маленького козлёнка (!). И чтобы портрет выглядел как библейская картина эпохи Возрождения.

Большущая благодарность!

На ComfyUI запустилась с 8 гб VRAM.

Вот предварительный воркфлоу

https://gist.github.com/comfyanonymous/0f09119a342d0dd825bb2d99d19b781c/

Странные у вас запросы батенька, но к сожалению SD не знает как нацепить платок на голову.

афигительно, шеф!

чтоб тебе самые красивые женщины давали всю жизнь.

> с какого хуя позитивный промпт заходит в negative на stage_b

ZeroOut же, что ближе было, то и присунули.

> почему stage_c идет перед stage_b

Ты бы еще спросил, почему stage_a идет последней.

Кстати, на 1.13.0 торче работает. А вот латент от stage_c нихуя не декодируется, видимо это воистину двухмодельная хуйня, в отличие от сдхл с её рефайнером.

Заметил одно, lite версия каскады отличается так же как оригинальная sd 1.5 от SDXL. При этом разница в скорости 5 раз на одно и то же разрешение картинки.

НО, при этом lite и обычные версии stage_c и stage_b можно комбинировать друг с другом.

Когда обе стадии на lite версии выходит пик 1.

Если stage_b сделать обычным а stage_c lite то получаем пик 2, так как этап постобработки (stage_b) видимо все таки не так значительно влияет на результат.

Если stage_b оставить lite а stage_c сделать обычным то получаем пик 3 со значительной разницей в качестве, так как все таки stage_c проделывает основную работу.

Если вам интересно каким будет результат если обе stage будут обычным, то вот вам пик 4.

И опять же, остается вопрос, все такия нахуя stage_b нужен? Они опять запихнули рефайнер, который едва ли что-то менял и никому нахуй не сдался в SDXL но теперь еще сделали его обязательным.

Так как от этого псевдо рефайнера нельзя отказатсья, предлагаю всем использовать lite версию stage_b, так как его влияние на картинку незначительно.

НО, при этом lite и обычные версии stage_c и stage_b можно комбинировать друг с другом.

Когда обе стадии на lite версии выходит пик 1.

Если stage_b сделать обычным а stage_c lite то получаем пик 2, так как этап постобработки (stage_b) видимо все таки не так значительно влияет на результат.

Если stage_b оставить lite а stage_c сделать обычным то получаем пик 3 со значительной разницей в качестве, так как все таки stage_c проделывает основную работу.

Если вам интересно каким будет результат если обе stage будут обычным, то вот вам пик 4.

И опять же, остается вопрос, все такия нахуя stage_b нужен? Они опять запихнули рефайнер, который едва ли что-то менял и никому нахуй не сдался в SDXL но теперь еще сделали его обязательным.

Так как от этого псевдо рефайнера нельзя отказатсья, предлагаю всем использовать lite версию stage_b, так как его влияние на картинку незначительно.

Это пиздец аноны.

Я придумал новую игру, угадайте сколько шагов было потрачено на каждую из прикрепленных картинок на этапе stage_b (не lite версия)?

Покажи что даст это? realistic skin texture of girl 21yo, moles, skin hair

Не то, что ты ожидаешь.

Такое ощущение, как будто-бы модель тренили на скринах из Unreal Engine.

Вижу на цивитае пик 1, копирую промт не глядя, чтоб че-то такое же сгенерить. На выходе у себя получаю пик 2. Думаю, что за поебень, моя нейронка ебанулась? А нет, ведь если приглядеться к промту, то там написано:

chibi-style mature adventurer girl

Просто у черта с цивитая модель хуй забила на чиби-стайл, а у меня подхватила с радостью. Ну ебать.

chibi-style mature adventurer girl

Просто у черта с цивитая модель хуй забила на чиби-стайл, а у меня подхватила с радостью. Ну ебать.

Руки за спину действительно сложно убрать. Только на каких-то отдельных шотах, но сделать специально сложно когда нужно именно ведьму и на костре.

nsfw же тут разрешено?

nsfw же тут разрешено?

Ваще там промт настолько не имеет ничего общего с картинкой, что это похоже на какой-то пиздеж

https://civitai.com/images/6457362

>ты даже не можешь там дышать!

Я даже воздухом не дышу.

>nsfw же тут разрешено?

да, кроме порнографии.

классический шизопромпт классичен

>Her outfit is a cute, stylized version of a traditional knightâs armor, complete with a short cape fluttering behind her. The lighting is bright and even, mimicking the soft glow of a magical crystal. Her hair is a vibrant color, done in two bouncing pigtails that defy gravity. She is surrounded by (chibi-style mythical creatures:1.35), including a mini dragon perched on her shoulder. The background is a whimsically colored forest, teeming with oversized flowers and candy-like trees. The entire scene is framed by a sparkling aura, and her sword,

Ну тогда вот мои попытки. Руки за спиной действительно хер поставишь, только случайно где-то само ставило само раньше, а когда специальный промт, то игнорится. Это я пытался сделать, как этот просил

Я не тот, кому адресовалось, просто интересно стало. Понятно, что наверное по готовой пикче можно попытаться инпаинтом добавить веревок, но как сделать такое сразу.

> Не то, что ты ожидаешь

Как раз ожидаемо. realistic - это про рендеры.

>да, кроме порнографии.

Меня за гурятину тёрли, так что тоже нельзя.

Да не было там ничего такого, это был парик, а не чей-то скальп.

Чатом ГПТ сгенерено. Всегда поражали такие люди, х.з. как подобное может показаться хорошей идеей.

Шёл второй год СД тредов, а сд-дауны до сих пор пытаются сгенерить реалистичное дженерик ебло бабы. Какой пиздец.

Попробовал сгенерировать бабу, прячущую руки. Но я-то понимаю, что играть нужно по-крупному, думаю, ну нахуя ей руки? Руки не нужны, рукоблядь не человек. Пусть будут ампутированные. Оказалось, что все ампутантки в датасете были без ног и абсолютно голые. Тревожно.

Бля. Сисяндры Каскада светить не хочет.

Промт свой.

Ну ладно, норм. Но не хватает полугода дотренировки кастомов.

Сдохни, пидар

Cascade нормально работает со словами, которые существуют в английском языке. Чем более сложное или менее распространенное слово, тем сложнее ему его сгенерить.

и да, это нативно без контролнета

и да, это нативно без контролнета

Ведьма бахнула

>stone with word "STONE" on it

>cake with word "CAKE" on it

>Word "LAVA" maded from lava

>Word "CUM" maded OF CUM

word "suck my penis" made of stone

sd 1.5 - пик 1

SDXL - пик 2

Cascade - пик 3

>maded

пик 4

>>maded

Думаешь, умный такой?

>the word "lava" made from lava

Для него нужно аналог Harrlogos запилить. Ну или кастомный контролнет обучить, который будет принимать текст, а не картинку.

Это всё хуйня, лучше протести протекание текста в промпт и наоборот. Типа asian woman holding sign with text "black woman" и покажи какого цвета тянка. XL генерит смуглых азиаток с кудрявыми волосами.

Забыл уточнить, что ето XL.

Его выпустили с минимумом нужных контролнетов уже

canny, inpaint

+ добавили какой-то новый super_resolution контролнет, правда не разобрался еще как его использовать.

https://huggingface.co/stabilityai/stable-cascade/tree/main/controlnet

Word "fire" made of water

Ну как всегда в общем

Аноны, научите быть крутым, плиз. Вот нагенерил я всякого на LCM. Композиция, освещение, гамма, общий стиль - все нравится. Но качество изображения плохонькое. Хочется найти оптимальный способ трансформировать картинки типа пикрелейтед в йоба-качество, как здесь:

- но по возможности сохранить те характеристики изображения, которые нравятся.

Как бы вы подошли к такой задаче?

- но по возможности сохранить те характеристики изображения, которые нравятся.

Как бы вы подошли к такой задаче?

Я, конечно, не специалист, но раз уж ты тегнул. Я бы не заморачивался - заебёшься это всё вытягивать. Если имеешь дохуя свободного времени и прямо упёрся рогом сделать с пиками хотя бы что-то без гарантированного результата, то это низкий денойз в img2img, даунскейл-апскейл и так по кругу.

Ну так контролнета под текст нет.

Короче берешь фильтруешь любой большой датасет на предмет надписей и текста на картинках, любой быстрой сеткой. Распознаёшь этот текст, получаешь кэпшены. Выходят пары картинка-текст для тренировки контролнета.

Тренируешь его и получаешь контролнет, который может пихать заданный текст в выхлоп диффузии.

Большого кол-ва часов это не потребует, контролнет под SD тренится с нуля несколько А100-часов, подготовка тренировочного сета на 100к пикч обойдется в пару десятков A100-часов.

Если тебе нужно за LCM шум подчистить, пройдись обычной моделью 6-8 шагов с денойзом 0.2-0.25 и с тем же промптом. А вообще, из LCM много не выжмешь. Лучше турбу бери, если ты таким образом время пытаешься экономить.

Хуясе у тебя там Намаюнас в Тунберг превратилась.

Бля. DynamicThresholding совсем не работает с каскадом.

Ты всех подряд что ли тегнул? Лучше дядек дождаться местных. Я в фокусе-лохусе сижу, там особо настроек нет вроде, а те что есть не особо помогают картинку под свой вкус сделать, по-крайней мере позы. Ну либо я не разбираюсь ещё. Какие-то случайные прикольные да, а целенаправленно - нет.

Не всех, только тех, чьи результаты выглядят так, как хотелось бы научиться самому делать. Это не столько личное обращение, сколько просто хотел привести примеры годноты.

Оно, кстати, может быть и не LCM, а турбо. Генерил на https://app.decohere.ai/

Такое ощущение, что тамошняя модель получше справляется с композицией, позы и выражения лица какие-то более живые что ли. Ни на 1.5, ни на XL у меня такое не получалось. Кроме того, удобно, что можно видеть изменения от редактирования промпта почти в реальном времени, есть ощущение, что так проще получается напромптить нужное.

См. пикрелейтед. Нормальный пистолет в нормальной руке, и в целом осмысленная сценка, как будто и не СД.

Первая картинка в твоем посте - примерно то, что мне и хотелось бы получить. Кое-какие детали подправить придется, но в целом ОК. Спасибо за совет.

Забыл добавить. Летучий череп - охуенный!

-кум

Какая сейчас самая реалистичная модель для раздевания женщин?

Слышал что-то про появление типа SDXL, они лучше? Если да, то как их юзать?

Слышал что-то про появление типа SDXL, они лучше? Если да, то как их юзать?

А в чем цель вообще?

а чё сам раздеть не можешь? рычи и двигай тазом, хули как омеган

Мне кажется, что оно лучше слушается промпта, чем прошлые версии. Но сделать что-то действительно комплексное из коробки пока не получается. Ждем еще пару поколений.

Ну хуй его знает. Тебе нужно для начала выяснить, что там под капотом, а уже потом пытаться как-то влиять на результат, если это вообще возможно. Но лучше таки на своем ПК делать с полным контролем, если есть такая возможность.

1-3 - рандом генерации на рандом сдохлях плюс древний universestable_v50 с таким разрешением не справляется (пик4).

Цель в том, чтобы совместить достоинства двух моделей. Композицию, позы и стиль из одной, общее качество графона из другой.

Интересно, что пистолет всрало на всех трех твоих генерациях. Что нагладно показывает различия между моделями. Исходный пик всратый, но пушка там нормально получилась.

Вот опять. Графон - отличный. А пушку в руках не смогло нарисовать в 100% случаев. В то же время, decohere пушку рисует хорошо, но в низком разрешении, все размазанное и изгаженное артефактами. Пытался найти, что там у них за модель, но либо это не опубликовано, либо я тупой и не умею искать.

Каскад худо-бедно справился с тем, чтобы нарисовать пистолет в руке, но стиль у него уебищный.

Есть гипм и инпейнт, если нужно получить заебца из хорошего, в том числе переместить muzzle flash в нужное место. А там надо полагать пушку с пальцами рисует в 100% и роллить не нужно?

>А там надо полагать пушку с пальцами рисует в 100% и роллить не нужно?

Нужно, нормально получается 1 из 10-15 где-то. Но с учетом того, что каждая генерация занимает пару секунд, нароллить несколько проще.

Вторые два пика - еще одна штука, которую СД обычно фэйлит: лежащий персонаж. В этом случае роллил вообще минимально, годных генераций 1 из 2-3.

Понятно, что можно просто взять какую-то СД модель, обмазаться контролнетами, сгенерить обычную для СД-кривоту, потом ее фотошопить и инпейнтить, пока не получится что-то приличное. Я на подобные развлечения уже потретил уйму времени. Хочется менее геморройный и затратный по времени вариант.

я не понял чо такое lcm. но явно не ls-models.

насчет меня, то все просто.

1. фоооокус

2. рандомная cdxl с цивитая.

3. референсный пик.

4. апскейл на квалити

5. аутпейнтинг

это даже ребенку понятно

Даже художественный psyfiXL пытается в кинографоний, если ему въебть cfg двадцаточку.

> Но с учетом того, что каждая генерация занимает пару секунд, нароллить несколько проще

Сомнительная выгода, кроме тех случаев, когда ты считаешь, что это good enough и можно остановиться, чего ты очевидно не считаешь, иначе не спрашивал бы, как улучшить результат. Во всех остальных случаях проще занпейнтить пару раз пальцы и ебло на полноценных генерация, и этого будет достаточно, чем пытаться исправить результат из онлайн сервиса. И таки да, любой способ превратить это во что-то, что тебя устроит займет в ебаную тучу раз больше времени, чем сгенерировать кривые пальцы, а потом исправить их.

Алсо, выглядит так, будто это обычная модель, для которой выставили примерно в 10 раз меньше шагов, чем ей нужно.

> Но с учетом того, что каждая генерация занимает пару секунд, нароллить несколько проще

Сомнительная выгода, кроме тех случаев, когда ты считаешь, что это good enough и можно остановиться, чего ты очевидно не считаешь, иначе не спрашивал бы, как улучшить результат. Во всех остальных случаях проще занпейнтить пару раз пальцы и ебло на полноценных генерация, и этого будет достаточно, чем пытаться исправить результат из онлайн сервиса. И таки да, любой способ превратить это во что-то, что тебя устроит займет в ебаную тучу раз больше времени, чем сгенерировать кривые пальцы, а потом исправить их.

Алсо, выглядит так, будто это обычная модель, для которой выставили примерно в 10 раз меньше шагов, чем ей нужно.

Похоже, что ты прав, и дело это гиблое. Повозился с контролнетами, что ни делаю, без вариантов распидорашивает руку с оружием и портит лицо. Если сохранил руку и лицо более-менее, всирает что-нибудь еще, например, фон и цветовую гамму.

Аноны, помогите пж

Вот допустим есть спрайт персонажа в единственном экземпляре. Можно ли в ST используя только это поменять ему позу, но чтобы одежда и лицо остались такими же?

Например, вот я хочу чтобы она руками держалась за голову, типа голова болит. Всё перерыл, через фейссвап не работает, он вообще анимешных персонажей почему-то руинит на всех моделях.

Вот допустим есть спрайт персонажа в единственном экземпляре. Можно ли в ST используя только это поменять ему позу, но чтобы одежда и лицо остались такими же?

Например, вот я хочу чтобы она руками держалась за голову, типа голова болит. Всё перерыл, через фейссвап не работает, он вообще анимешных персонажей почему-то руинит на всех моделях.

SD

быстрофикс*

Строго рекомендуется к ознакомлению https://youtu.be/6i417F-g37s?si=_sY7EXKujZps-wXE

Но ведь это не помешает тебе, анон, выложить ещё ра 20 эту уродливую бабу, и попутно заебать всех окружающих, даже самых толерантных, правда ведь?

привет нейровики))

Вопрос таков: есть-ли лора или моделька для Торпедных aka ‘’Дыньки’’ сисек (Cисек под прямым углом сильно выпирающий вперед)???

даже в /б/ был тред о них. https://2ch.hk/b/res/300443810.html

пик для примера

Вопрос таков: есть-ли лора или моделька для Торпедных aka ‘’Дыньки’’ сисек (Cисек под прямым углом сильно выпирающий вперед)???

даже в /б/ был тред о них. https://2ch.hk/b/res/300443810.html

пик для примера

Бля, какая же этот комфи хуйня задротская.

Причина подрыва?

Пиздец, я посыпался под конец. Как это задрочить все? Ну и железо конечно ебейшее надо, там у чела мгновенно этот воркфлоу срабатывает. А так прикольно конечно.

Спасибо, стало лучше.

На счет железа - это да, у меня с двумя ип-адаптерами уже всё трещит даже без контролнетов. А запилить вокрфлоу не сложно, просто последовательно добавлять всю хуйню, что у него, но сопли выводить на рероуты, как минимум, а лучше в пайпы, где возможно, чтобы не запутаться. Пару раз сам соберешь, и станет проще.

отсутствие мозга у тебя в черепной коробке

>2. НАКОНЕЦ-ТО ВЫПУСТИЛИ КОД ДЛЯ X-ADAPTER

>АВТОР ГОВОРИТ, ЧТО С ПОМОЩЬЮ НЕГО МОЖНО ИСПОЛЬЗОВАТЬ ЛОРЫ И КОНТРОЛНЕТЫ (да, Tile контролнет тоже) ДЛЯ SD 1.5 НА SDXL.

Так подобные адаптеры и раньше были - по крайней мере для лор

IP-adapter это просто контролнет модель, можно и на Automatic1111 накатить.

Такого, чтобы можно было лоры для SD 1.5 запускать на SDXL - нет.

Аноны помогите, есть ли для автоматика такойже импрув детейлер как в фукусе?

Бро, слушай, а на фокус случайно не получится накатить?

И что? Чувак, будучи СЕО не может почиллить под кулинарное шоу? Или увлечься готовкой домашней пищи?

Где логика? А нет её.

были. Одна banana tits на цивите, и ещё breast helper для инпейнта помогал с ними вроде.

это контролнеты, face detailer, hand refiner, возможно mediapipe facemesh сегментирует глаза и рероллит в повышенном разрешении.

В автоматике это всё городить неудобно, перекатывайся в комфи, если хочешь вообще максимума доступных решений

В комфи пробовал разобраться, но там муторно работать с нодами , в автоматике всё проще, пробовал ADeteiler но он сильно меняет, а в фокусе как то аккуратно делает, я просто новичек ещё в этом всём.

> IP-adapter это просто контролнет модель

Nyet. Контролнеты конкатятся к кондишену, ип-адаптер встраивается в unet. Можно в фордже попробовать, где он куда надо встраивается и поддерживает маски, в отличие от а1111, но там нет возможности добавить шума в эмбэд, что очень помогает, если нужно изменить позу.

Juggernaut XL Version 9 RunDiffusion Photo Model 2

Juggernaut XL Version 9 RunDiffusion Photo Model 2

Juggernaut XL Version 9 RunDiffusion Photo Model 2

Что касается V9, я сам прошел только базовую подготовку. Это включает в себя некоторую работу над деталями кожи, освещением и общим контрастом. Однако самое большое изменение в модели произошло благодаря обновлению RunDiffusion Photo Model, которое стало доступно мне в V2 благодаря RunDiffusion. По нашему опыту, фотографическая мощность модели должна быть даже сильнее, чем в предыдущих версиях.

Теперь небольшое обновление «дорожной карты» или общее обновление статуса о том, как продвигаются дела с Джаггернаутом. Как вы, возможно, заметили, с V9 произошла небольшая задержка. С каждой последующей версией тренировать Джаггернаута, не жертвуя при этом качеством в некоторых областях, становится все труднее, что в некоторой степени уже имело место с V8. Не волнуйтесь, V9 действительно хорош, и я доволен версией, которую могу вам сегодня представить :) Однако я решил провести полную «перезагрузку» V10. Я хочу просто переобучить базовый набор Джаггернаута. Условия для улучшения субтитров тогда были не такими благоприятными, как сегодня, поэтому я хочу полностью переписать базовый набор (5 тыс. изображений) с помощью GPT-4 Vision. Я ожидаю большого скачка в направлении оперативного руководства и качества.

Но, как вы наверняка заметили на прошлой неделе, выпуск Stable Cascade немного помешал. Поэтому в ближайшие недели я сосредоточусь на подготовке Джаггернаута для Стабильного Каскада. Подход остается тот же, что и при плановой «перезагрузке»; В будущем я хочу добавлять подписи/теги ко всем изображениям только с помощью GPT-4 или вручную. Сроки всего этого пока неясны. Я надеюсь, что смогу представить вам первую стабильную версию Juggernaut Cascade где-то в марте. V10 Juggernaut XL выйдет через несколько недель.

https://civitai.com/models/133005/juggernaut-xl?modelVersionId=348913

Juggernaut XL Version 9 RunDiffusion Photo Model 2

Juggernaut XL Version 9 RunDiffusion Photo Model 2

Что касается V9, я сам прошел только базовую подготовку. Это включает в себя некоторую работу над деталями кожи, освещением и общим контрастом. Однако самое большое изменение в модели произошло благодаря обновлению RunDiffusion Photo Model, которое стало доступно мне в V2 благодаря RunDiffusion. По нашему опыту, фотографическая мощность модели должна быть даже сильнее, чем в предыдущих версиях.

Теперь небольшое обновление «дорожной карты» или общее обновление статуса о том, как продвигаются дела с Джаггернаутом. Как вы, возможно, заметили, с V9 произошла небольшая задержка. С каждой последующей версией тренировать Джаггернаута, не жертвуя при этом качеством в некоторых областях, становится все труднее, что в некоторой степени уже имело место с V8. Не волнуйтесь, V9 действительно хорош, и я доволен версией, которую могу вам сегодня представить :) Однако я решил провести полную «перезагрузку» V10. Я хочу просто переобучить базовый набор Джаггернаута. Условия для улучшения субтитров тогда были не такими благоприятными, как сегодня, поэтому я хочу полностью переписать базовый набор (5 тыс. изображений) с помощью GPT-4 Vision. Я ожидаю большого скачка в направлении оперативного руководства и качества.

Но, как вы наверняка заметили на прошлой неделе, выпуск Stable Cascade немного помешал. Поэтому в ближайшие недели я сосредоточусь на подготовке Джаггернаута для Стабильного Каскада. Подход остается тот же, что и при плановой «перезагрузке»; В будущем я хочу добавлять подписи/теги ко всем изображениям только с помощью GPT-4 или вручную. Сроки всего этого пока неясны. Я надеюсь, что смогу представить вам первую стабильную версию Juggernaut Cascade где-то в марте. V10 Juggernaut XL выйдет через несколько недель.

https://civitai.com/models/133005/juggernaut-xl?modelVersionId=348913

> Photo Model

А где фото? Вижу только ебучий реалистик рендер и дефолт дженерик ёбла.

> работу над деталями кожи

Какие же блять дегенераты, комьюнити имбецилов, 2 года пытаются сгенерить ебло бабы с детальной кожей, какой пиздец.

Выпал из темы генерации картинок примерно на полгода, какая сейчас мета? Автоматик всё ещё топ? Поясните, если не трудно, аноны.

>какая сейчас мета?

Cascade

>Автоматик всё ещё топ

Смотря для чего. Все разработчики перекатились в комфи.

Это сюда.

Сделали улучшенный автоматик под названием Forge, но комфидауны пытаются затравить его создателя, так что неизвестно, куда все выльется, могут задушить поддержку.

>Cascade

Спасибо, посмотрю это.

>Смотря для чего.

Да мне в целом просто пикчи для себя и работки генерить. Раньше генерил на автоматике, всё было неплохо, а сейчас решил вернуться и смотрю что тут новое и полезное запилили, заодно и скилл хочу подтянуть.

Если есть какие-нибудь полезные гайды для комфи и вообще, то дайте ссылки, может рентри какие-нибудь есть от анонов, а то в шапке как-то мало по этой теме инфы.

Посмотрю Forge, спасибо за совет, анон.

> Если есть какие-нибудь полезные гайды для комфи

Из максимально доступного - ютуб, там дохуя всего. Обычно несложно найти нужное, если кратко сформулировать запрос в поиск. Но слишком дохуя гоняющихся за лайками, которые тупо качают откуда-то вокфлоу и начинают его гонять в прямом эфире, не понимая, что там и зачем.

Из обязательного канал автора IPAdapter_plus https://www.youtube.com/@latentvision где есть также немало информации про комфи в целом. И https://www.youtube.com/@NerdyRodent тоже шарящий, есть и автоматик, и комфи, и про фордж (в основном для вкатунов) пару видео нормальных недавно вышли.

Как такую же кожу сделать, че писать, в какой модели? Или может лора секретная какая?

Спасибо, Анон, большая тебе благодарность.

>Спасибо, посмотрю это.

Можешь не смотреть, там адовый кал, который зашакаливает латент спейс до 24х24, результаты соответствующие - ёбаная нейрокаша вместо картинок.

Как такую же кожу сделать, че писать, в какой модели? Или может лора секретная какая?

Да я бы не сказал, что у меня хорошая кожа получается...

Ну, в любом случае генерю в cyberrealistic, пишу (human skin texture detailed:1.2), потом еще инпеинтом дорабатываю - сэмплером DPM ++2m или Heun

говно эти ваши нейронки. неконтролируемая хуйня

ты пытаешься натянуть сову на глобус.

Stable Diffusion это в первую очередь модель по генерации картинок. Если нужно генерить видео жди когда дадут доступ к Sora от OpenAI.

> 2 года пытаются сгенерить ебло бабы с детальной кожей, какой пиздец

Все мы можем! Не надо пиздеть

>Stable Diffusion это в первую очередь модель по генерации картинок.

Звучит как отговорка

>Sora

Для каких нибудь ёба-студий с топовым железом. Нищеебы в пролете как всегда

схуя ли они будут давать модель даже студиям? Будут продавать сервис.

> Для каких нибудь ёба-студий с топовым железом. Нищеебы в пролете как всегда

Ну как бы да, обычный пека вряд ли потянет, может не в таком разрешении будет генерить, хз, но Далли ведь уже запускали на обычных компах,и генерили картинки, хотя все говорили что там требования заоблачные, так что всё может быть.

Анончики, как в ComfyUI только выбранную часть изображения сгенерировать? Вот есть у меня обычная картинка (не сгенерированная), хочу выделить заменить там объект/часть объекта на свой промпт.

>жди когда дадут доступ к Sora от OpenAI

... с нулевым контролем и анальной цензурой.

>дадут доступ

>OpenAI

Хорошо пошутил.

Detailer (SEGS) из https://github.com/ltdrdata/ComfyUI-Impact-Pack

Почему так?

https://github.com/comfyanonymous/ComfyUI

То же самое выскакивало, когда пытался пигмалион запустить.

https://github.com/comfyanonymous/ComfyUI

То же самое выскакивало, когда пытался пигмалион запустить.

> потом еще инпеинтом дорабатываю - сэмплером DPM ++2m или Heun

Что именно дорабатываешь, кожу по всему телу, что ли? Это как?

в Комфи с инпейнтом все сложно (как в принципе и со всем в Комфи).

Почитай что-ли тут

Ну вот прям щас бесплатно пользуюсь ChatGPT и Dall-e

> windows7

> дадут доступ

Ну так дали ведь открыли доступ, дадут и к соре