Анончики с форча свою текстовую сетку УЖЕ пробуют.

я наверно 80% времени кручу веса у моделек, буду тут сидеть и свои ссайнсы кидать тогда

по пресетам из весового плагина графы нарисованы тут https://github.com/bbc-mc/sdweb-merge-block-weighted-gui/blob/master/README.md#presets-grids (0 - база модель, 1 концепт модель)

наиболее действенные как по мне это смуфстепы/реверс смуфстепы, *4 либо /4, либо полный флат 0.5 весов уровня пика, где енкодер основной тоже по половинке берется от каждой модели

еще там запили форс резет клип позиций кстати недавно и сохранение в тензоры

Сразу вопрос годному треду, какие слои тринарта и дерриды отвечают за стили художников? Ну и вообще делитесь своими знаниями по дебаггингу при мердже моделек

Алсо удобные инструменты для мерджей моделек:

https://github.com/bbc-mc/sdweb-merge-block-weighted-gui

https://github.com/bbc-mc/sdweb-merge-board

Закатился, залью фурслат, как просил анон:

>Вопрос, что за Furslut_v1 юзал тут анон? Это своя собственная кастомка или её скачать где можно, или же это hypernetworks какой?

https://gofile.io/d/IWi4rh

Есть еще куча его версий, но их долью, как тред с колен встанет на ноги, чтобы это не был филиал фур. Напоминаю, что генерации ради генераций с него сюда лить не нужно.

Либо иди с ними в интернеты, либо в загон на фур, либо срать по доске и ловить бан от мочи.

Скорее всего неиронично (лол бля) найдут.

Скорее всего с кешем на nvme под горячие данные датасетов.

Им же не весь chat openai обслуживать, а только себя, могут и подождать ответа пол минуты.

На чем?

Отлично, ты-то нам и нужен. МОжешь неспеша намутить rentry со своим саенсом. Вроде кроме тебя тут никто этим не занимается. Пока.

Дальше буду постить здесь, не пингуйте меня в nai треде.

>Вопрос, что за Furslut_v1 юзал тут анон? Это своя собственная кастомка или её скачать где можно, или же это hypernetworks какой?

https://gofile.io/d/IWi4rh

Есть еще куча его версий, но их долью, как тред с колен встанет на ноги, чтобы это не был филиал фур. Напоминаю, что генерации ради генераций с него сюда лить не нужно.

Либо иди с ними в интернеты, либо в загон на фур, либо срать по доске и ловить бан от мочи.

Скорее всего неиронично (лол бля) найдут.

Скорее всего с кешем на nvme под горячие данные датасетов.

Им же не весь chat openai обслуживать, а только себя, могут и подождать ответа пол минуты.

На чем?

Отлично, ты-то нам и нужен. МОжешь неспеша намутить rentry со своим саенсом. Вроде кроме тебя тут никто этим не занимается. Пока.

Дальше буду постить здесь, не пингуйте меня в nai треде.

алсо есть еще скрипт мерджа без дисторсий и на его основе собранная приложуха https://github.com/diStyApps/Merge-Stable-Diffusion-models-without-distortion-gui но там с весами не поиграешься, тут уже каждый решает что для него лучше - нету дисторсий или файнтюнинг весов

>На чем?

На колабе, но у себя захостить полную сетку тоже можно, 16 гб видеопамяти только требуется.

>но у себя захостить полную сетку тоже можно, 16 гб видеопамяти только требуется.

Неплохо, ссылка есть? У форча интерфейс хуй проссышь.

Чем лучше мерджера в вебуи?

Где-то там тред у них в g был, поищи.

>Технотред

Не увидел тут ничего связанного с техникой или даже трейнингом моделей.

Не увидел тут ничего связанного с техникой или даже трейнингом моделей.

Кстати база.

Какой там нынче положняк по тренингу моделей с нуля? 24 гигов врам хватит? Кто-то пробовал?

>Чем лучше мерджера в вебуи?

отсутствием дисторсий очевидно

из минусов разве что что на некроговняных картах с малым количеством памяти не мерджит, в отличие от вебуи

12 хватит с головой, 24 хватит на два инстанса одновременно

Что думаете про возможную text-to-video модель на базе Stable Diffusion?

Я говорю не про перетекание одной позиции в другую. А буквально брать следующий или предыдущий кадр из латентного пространства. И "чувство времени". Примерно как в CogVideo.

Я говорю не про перетекание одной позиции в другую. А буквально брать следующий или предыдущий кадр из латентного пространства. И "чувство времени". Примерно как в CogVideo.

Есть сравнение? Первый раз просто про них услышал.

>на некроговняных картах с малым количеством памяти не мерджит, в отличие от вебуи

Там тоже с этим проблемы вроде, аноны с бич картами воют.

Меньше dreambooth? В чем подвох?

>следующий или предыдущий кадр из латентного пространства

Так у них связности нет. Это же рандомогенератор.

Это надо искать похожие сиды, а это в свою очередь - брутфорс, причем дорогой.

Можешь объяснить простыми словами как вот эти веса слоёв работают примерно? Вот у тебя на скрине например это если бы к модели А прибавили модель Б 0.5+0.5 через стандартную мерджилку или чем то отличается?

Алсо что за base alpha и как понять куда её лучше крутить?

>Мокрописьки для создания датасетов - грабберы, таггеры

Booru grabber, если нужен кастомный датасет и неохота ебаться с danbooru2020. Еще есть скрипт для авто-загрузки полноразмерных изображений из Bing по листу запросов. Например, по сто пикч по результатам каждой линии. Была даже годная прога чтобы отсеивать дубликаты. Captions создаются известно чем: clip или blip.

>Так у них связности нет

В текущей реализации SD ее нет. Если бы была, то и поднимать вопрос было незачем. Просто я не изучал эту архитектуру, поэтому интересно, какой у нее задел для доработки.

Максимум - дрочить variation seed или обучать по аддону на каждого субъекта видео, чтобы его можно было крутить стабильно.

С фоном вопрос отдельный.

То есть, никак. Хотя Imagen же может видео, а основан на Unet.

Ну опять же - для витуберов же делают модели, они же тоже не из воздуха берутся.

Так и тут - надрачиваешь лору так, чтобы она вообще нахуй забыла про других персонажей и пол дела сделано считай.

>для витуберов же делают модели, они же тоже не из воздуха берутся

Там скорее генерируют единичный арт и адаптируют его под Live2D.

Но это костыльное решение. Артефакты в динамике это пиздец.

Ну да, а тут ты герерируешь сначала 5 пикч персонажа, а потом из него лору.

>Артефакты в динамике это пиздец.

Я не видел, чтобы кто-то пробовал с лорой на персонажа совмещать. С портреткой оно должно справиться, я думаю...

На каскадном дифьюжне, и тоже с уебанскими артефактами.

При чем здесь портретка? Как ты собрался пилить с лорой продолжение Джексоновского "Властелина колец"?

Малаца

https://rentry.org/ex947

https://rentry.org/ex947

https://rentry.org/ex947

>Как ты собрался пилить с лорой продолжение Джексоновского "Властелина колец"?

А ты как, умник блядь?

Начинать надо с малого.

Чичас поем и еще выебонскую пикчу переведу.

Оригинал был с горем пополам читаем, но ты и это в могилу укатал. Поставь шрифт читабельней и побольше, свободного места куча.

Тока возьми эту пикчу

Помарки исправил.

>проблемы с персами

Какие проблемы? Тупо референсы суешь в имг2имг и ебашишь в какой угодно позе.

Какие проблемы? Тупо референсы суешь в имг2имг и ебашишь в какой угодно позе.

Ой да блядь

Всё там читается не пизди на анона.

Лучше очки себе купи.

>https://rentry.org/ex947

>https://rentry.org/ex947

>https://rentry.org/ex947

Вот на эту хуйню еще 1060 знает пароль, если я буду тупить с обновлениями (ночью пахать, так что сегодня и завтра буду вяло обновлять).

Если хотите, то перекатывайте куда угодно на другой ресурс или в другой рентри.

Олсо, если есть идеи о том, что можно или нужно для треда развернуть, типа условную файло- или пастопомойку - пишите предложения, есть на чем.

Насчет файлопомойки есть сомнения, что туда не будут лить ЦП и прочую ботву, но в целом есть о чем подумать.

Если пикч всего в шапке будет немного, то можно с пасскодом перекатывать и эту пикчу разделить на 4 хорошо читаемых.

Читается если картинку туда-сюда возить, ага. Хуйня идея, годно когда весь логический блок сразу перед глазами.

Фурфаг, это ты запилил?

Да.

> туда-сюда возить

А, т.е ты пиктчу с 4мя информационными блоками и размером в 3510x2910 пытался читать не "возя"?

Ебать ты техномант, конечно.

У меня вроде такая же хуйня была. Само прошло.

А что ты делаешь?

Да! Я могу в самом деле, монитор позволяет

Oh u.

Пытаюсь поставить sd_dreambooth_extension

Из вкладки дополнений?

Да.

Я говорю про читаемость в контексте 1 блока в рамках окна браузера, не про все 4 сразу, если что.

Потому что ебучий дримбуз экстеншен вечно ломает зависимости.

Забей, этого достаточно. Дальше по гайду ставь старую версию. Новая все равно работает через жопу.

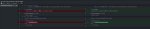

>Можешь объяснить простыми словами как вот эти веса слоёв работают примерно?

Концепт весов описан на мунспике тут https://note.com/kohya_ss/n/n9a485a066d5b

Если упрощать то это блоки инпута (IN), срединных значений (M00), и аутпута (OUT) для каждой модели, каждый блок содержит кластеры датасетов конкретной модели для построения изображения, соответственно зная что находится в каждом блоке мы можем балансить мердж в сторону одной из моделей. Допустим примешать в модель А бодикомпоз из модели Б, не меняя остального.

>Вот у тебя на скрине например это если бы к модели А прибавили модель Б 0.5+0.5 через стандартную мерджилку или чем то отличается?

Ничем не отличается конкретно на скрине, ибо я там в описании ошибся, против с загрузкой пресета с полным аналогом 0.5 вейтедсум, правильнее было бы написать "либо полный флат 0.5 весов уровня пика, где енкодер base_alpha берется от модели А". То есть чтобы было понятно: пик2 - бейз енкодер 0.5 через плагин весов с 0.5, пик3 обычный вейтед сум, пик4 - бейз енкодер от анимушной модели А. Следующим постом кину базовую анимушную модель без примесей. Все настройки одинаковые

>Алсо что за base alpha и как понять куда её лучше крутить?

Это базовый текстовый енкодер модели, обычно его оставляют жестко в положении положении 0 или 1, чтобы брался енкодер базовой модели или модели Б. Конкретно на пике1 бейз 0 это bw-merge2-2-2, бейз 1 это bw-merge1-2-2, там с линейными функциями смешивания правда но не суть.

Вот базовая анимумодель без примесей.

Касаемо второй пикчи в шапке, я не уверен что смогу перевести достоверно имбо не пользовался этим расширением. Не знаю что за что отвечает.

Вот этот товарищ должен смочь, я думаю

> Если упрощать то это блоки инпута (IN), срединных значений (M00), и аутпута (OUT) для каждой модели, каждый блок содержит кластеры датасетов конкретной модели для построения изображения, соответственно зная что находится в каждом блоке мы можем балансить мердж в сторону одной из моделей. Допустим примешать в модель А бодикомпоз из модели Б, не меняя остального.

Это я уже понимаю, не понимаю только как эффективнее всего искать нужные слои и сколько примешивать, относительно обычных миксов, по типу налить 0.2 к модели через вейтед сум, тут получается столько же с уже найденными слоями или можно даже больше?

> Ничем не отличается конкретно на скрине, ибо я там в описании ошибся, против с загрузкой пресета с полным аналогом 0.5 вейтедсум, правильнее было бы написать "либо полный флат 0.5 весов уровня пика, где енкодер base_alpha берется от модели А". То есть чтобы было понятно: пик2 - бейз енкодер 0.5 через плагин весов с 0.5, пик3 обычный вейтед сум, пик4 - бейз енкодер от анимушной модели А. Следующим постом кину базовую анимушную модель без примесей. Все настройки одинаковые

То-есть, перефразируя на более нубский язык. Weighted sum 0.5 из стандартной мерджилки = скрин . Бейз энкодер = бейз альфа.

Этот бейз энкодер, судя по твоему пику влияет очень сильно на будущий микс и нужно его ставить с умом. Надеюсь правильно понял, что на пике 1 идёт сначала ws sd1.5_0.5+wd1.3_0.5. Потом флат 0.5 с базой 1, после 0. Соответственно и результат уклоняется либо в реализм, либо в аниме.

А вот это

> bw-merge2-2-2

будь добр расшифруй, вообще не понятно такое обозначение. Block-weighted-merge? Почему 2-2-2, 1-2-2?

Нужна нам сюда библиотека лор\моделей анонов или нет?

Я сделаю: https://rentry.org/2chAI_LoRA

Лучший.

Сепсис.

>не понимаю только как эффективнее всего искать нужные слои и сколько примешивать

Ну я делаю так - беру слой и мешаю три микса 0, 0.5, 1, потом сравниваю на одном и том же промпте. Выбираю два лучших значения и мешаю доп микс со срединным значением между ними. И так далее пока перфект поинт не нахожу. Далее записываю положение этого блока в блокнот и делаю следующий. Когда со всеми закончил, то просто вписываю значения перфект поинтов и мерджу финальную версию.

>Weighted sum 0.5 из стандартной мерджилки = скрин (You)

Да

>Бейз энкодер = бейз альфа

Да

>Надеюсь правильно понял, что на пике 1 идёт сначала ws sd1.5_0.5+wd1.3_0.5.

Это просто базовые модели, от сд дефолт и вайфу дифужн.

>Потом флат 0.5 с базой 1, после 0.

Третья строка - вейтед сум 0.5 обычный,

четвертая строка плагин весов - линейная функция на пик1 плюс бейз альфа 1 (не вейтедсумная 0.5),

пятая строка плагин весов - линейная функция пик 2 плюс бейз альфа 0

>будь добр расшифруй, вообще не понятно такое обозначение. Block-weighted-merge?

Да

>Почему 2-2-2, 1-2-2?

просто названия, пик 3

линейная функция (не вейтедсумная 0.5)

фикс

>Есть сравнение? Первый раз просто про них услышал.

ну вот примерно так как на пике 1, бефор - с дисторсией, афтер - после применения Skip/Reset CLIP position_ids (аналог функции из софтины внутри мерджера весов)

smile woman sleepy

Steps: 20, Sampler: Euler a, CFG scale: 7.5, Seed: 1538003301, Face restoration: CodeFormer, Size: 512x512

>аноны с бич картами воют.

У меня на 3 гига карте внутри вебуи мерджит норм.

>тут уже каждый решает что для него лучше - нету дисторсий или файнтюнинг весов

если кто не понял моей кривой формулировки, имелось в виду хотите ли вы играться с весами - если нет, то просто через софтину можете дрочить базовые мерджи без дисторсий, если надо веса еще крутит, то только через плагин https://github.com/bbc-mc/sdweb-merge-block-weighted-gui

еще как вариант функционал фикса дисторсий модели есть в тулките который для урезания веса моделей юзается https://github.com/arenatemp/stable-diffusion-webui-model-toolkit

> Ну я делаю так - беру слой и мешаю три микса 0, 0.5, 1, потом сравниваю на одном и том же промпте. Выбираю два лучших значения и мешаю доп микс со срединным значением между ними. И так далее пока перфект поинт не нахожу. Далее записываю положение этого блока в блокнот и делаю следующий. Когда со всеми закончил, то просто вписываю значения перфект поинтов и мерджу финальную версию.

И сколько же времени уходит на подбор всех слоёв хотя бы для двух моделек в среднем?

> Это просто базовые модели, от сд дефолт и вайфу дифужн.

Да, я просто не стал про них писать, сразу с 3 строки начал.

> четвертая строка плагин весов - линейная функция на пик1 плюс бейз альфа 1 (не вейтедсумная 0.5),

> пятая строка плагин весов - линейная функция пик 2 плюс бейз альфа 0

Это одна и та же функция, просто инвертированная под бейз альфу другой модели?

Откуда кстати это всё? С того самого форума чтоли?

Алсо как ты понимаешь мелкие отличия в слоях на таком маленьком разрешении? Там же буквально всё расплывается

>И сколько же времени уходит на подбор всех слоёв хотя бы для двух моделек в среднем?

Дохуя, зато по итогу перфект мердж выходит, с которым можно потом подмешивать уже не на всем протяжении от 0 до 1 а только от 0 до 0.5

>Это одна и та же функция, просто инвертированная под бейз альфу другой модели?

Да

>Откуда кстати это всё?

Ты не поверишь... Из ридми плагина.

>С того самого форума чтоли?

С того самого форума ток картинка из шапки с примерным содержимым блоков.

>Алсо как ты понимаешь мелкие отличия в слоях на таком маленьком разрешении?

Я обычно в базовом квадрате рендерю 768 на 768, это база, больше и не нужно в целом.

>Там же буквально всё расплывается

Да вроде нет

>беру слой и мешаю три микса 0, 0.5, 1

поправка: 3 микса при значениях весов по дефолту на 0.5, если мешать прям с нулевым значением весов во всех блоках, то смысл рендера 0 пропадает

мне просто удобнее с 0.5 изначально работать, более наглядные изменения происходят от 50% мерджа

Натренировал таки модель Богини?

> Дохуя, зато по итогу перфект мердж выходит, с которым можно потом подмешивать уже не на всем протяжении от 0 до 1 а только от 0 до 0.5

Вот тут не понял, такой мердж уже не нуждается в дальнейшем кручении слоёв от 0 до 1 с другой моделью типо?

> Ты не поверишь... Из ридми плагина.

Вот это я слепой, лол.

>>Я обычно в базовом квадрате рендерю 768 на 768, это база, больше и не нужно в целом.

Просто по твоим примерам не особо понятно что там с чем мерджилось и какой эффект дало, ну боди композ, как я понял, в ридми прям более показательный пример получился с сд и вд для ньюфагов как я.

Кстати вот здесь у ws0.5 и флат 0.5 со скрина разные хеши моделей в названиях картинок получились, но результаты одинаковые, это как так?

> поправка: 3 микса при значениях весов по дефолту на 0.5, если мешать прям с нулевым значением весов во всех блоках, то смысл рендера 0 пропадает

мне просто удобнее с 0.5 изначально работать, более наглядные изменения происходят от 50% мерджа

Только больше запутался, как на пиках с in00 слоем ты имеешь ввиду типо?

Да. Боялся что из-за сильно различающейся рисовки между пиками датасета будут проблемы, но проблем почти нет.

Единственное что дорисовывает слева у челки второй хвост и мне это не очень нравится.

Поделишься лорой?

>такой мердж уже не нуждается в дальнейшем кручении слоёв от 0 до 1 с другой моделью типо?

Вообще зависит от того что с чем мерджить конечно, но в целом да, место внутри модели ограничено так скажем, поэтому если ты опять будешь подмешивать на всем протяжении от 0 до 100 процентов с каждой последующей итерацией, то есть вероятность сильно поломать свой перфект мердж и в конечном итоге его размоет сильно, будет капустка по сути. Но опять же все индивидуально, в некоторых случаях можно блоки полностью менять типа как GapingLargeInsertion-60_MedConcept+MedTextures_Anime 0,0,0,0,0,0,0,0,0,0,0,0,0,0,0.05,0.05,0.05,0.05,0.65,0.65,1,0,0,0,1

>Просто по твоим примерам не особо понятно что там с чем мерджилось и какой эффект дало

Прикрепил пик1 подмешиваемой модели на тех же настройках. Расположил в порядке от примешиваемой до базовой, пик2 вейтедсум, пик3 вейтедсум бейз0.

>у ws0.5 и флат 0.5 со скрина разные хеши моделей в названиях картинок получились, но результаты одинаковые, это как так?

Изза бейз альфы, в одном случае 0, в другом 0.5

>Только больше запутался, как на пиках с in00 слоем ты имеешь ввиду типо?

Да, именно так, ток бейз альфу в 0 увожу. Когда перфект поинты весов есть можно отдельно бейзальфу крутануть ради интереса.

Кстати продолбился в глаза: всё с прической нормально, случайно поставил вес лоры в 0.6.

Залил, проверяй.

>Изза бейз альфы, в одном случае 0, в другом 0.5

А не, напиздел. Из-за пикрелейтед фикса дисторсий.

Лора – это пока что лучшее, что случалось со мной в 2023 году.

> GapingLargeInsertion-60_MedConcept+MedTextures_Anime 0,0,0,0,0,0,0,0,0,0,0,0,0,0,0.05,0.05,0.05,0.05,0.65,0.65,1,0,0,0,1

Это так гейпинг-аниме чтоли получился какой-то? Лол

> будет капустка по сути

Что-то прямо хихикнул, это ты про модель капустную? Что с ней прямо не так то?

> Прикрепил пик1 подмешиваемой модели на тех же настройках. Расположил в порядке от примешиваемой до базовой, пик2 вейтедсум, пик3 вейтедсум бейз0.

А бейз1 прикпепишь?

> А не, напиздел. Из-за пикрелейтед фикса дисторсий.

Если none поставить тот же хеш будет? Что вообще за фикс дисторсий, когда и для чего его применять? Опять же ноль отличий на этих примерах с ним и без

Есть предположение, что лоры превратят стейбл в индастриалкрафт: надо будет еще больше возица с настройками (жду расширение максимального кол-ва лор до бесконечного, регулир. пользователем), так как станет возможной генерация еще более качественных и тематических картинок...

Анон, который гайд по лоре делал, добавь уточнение к настройкам граббера что там после второго карета пробел идет "%all:unsafe,separator=^,^ %", а то щас перепечатал со скрина без пробела да слепой, и пришлось в документацию лезь, и только потом снизошло озарение почему не работает и нахуя там второй карет нужен.

Ок.

Ящитаю, нужно указывать оригинальные термины, без них нихуя не понятно будет за пределами двача.

Потестировал эту новую модель "горыныч" (без vae), опубликованную в NAI треде, и напишу фидбэк.

Из плюсов - приятность, мультяшность в хорошем смысле: напоминает про концепты игр от Katauri (King's Bounty и Royal Quest), а также графику города в оригинальном "Эадор", или графику в старых российских браузерках (Легенда: Наследие Драконов). Чёткие мазки кистью для задников, а-ля яркая акварель. В общем, чувствуется что-то русское. Вот эта вот красочность, щедрость русской души. Местами даже ощущается некая "совковость", будто советский детский мульт с лоли-пионерками.

Из минусов: зачастую модель не может определиться, реалистичный ли нужен стиль, или мультяшный. И делает гибридную серость, ни рыба ни мясо. Приходится уточнять, например, тегом "pixiv", и все равно получается разнобой в стилях. Иногда пикчи обрезаны по диагонали, будто хуевый кроп в датасете. Количеством деталей результаты не блещут, тут скорее как графика в мобильных играх (Clash of Clans). Не знаю, не фанат. Нравится чтобы стиль был как в китайской графике а-ля huaban, weibo. Чтоб детали были настолько изощренными, что мельчайшие из них терялись в пикселях и были меньше одного пикселя, будто это фрактал. Ruan Jia, Guangjian Huang и Fenghua Zhong - лучшие художники, имхо.

https://w0.peakpx.com/wallpaper/733/763/HD-wallpaper-cat-girl-luminos-girl-ruan-jia-face-cat-gorgeous-art-frumusete-superb-cute-pisici.jpg

Так что комьюнити на bilibili рулит, да и восточная изобразительная культура в целом.

Из плюсов - приятность, мультяшность в хорошем смысле: напоминает про концепты игр от Katauri (King's Bounty и Royal Quest), а также графику города в оригинальном "Эадор", или графику в старых российских браузерках (Легенда: Наследие Драконов). Чёткие мазки кистью для задников, а-ля яркая акварель. В общем, чувствуется что-то русское. Вот эта вот красочность, щедрость русской души. Местами даже ощущается некая "совковость", будто советский детский мульт с лоли-пионерками.

Из минусов: зачастую модель не может определиться, реалистичный ли нужен стиль, или мультяшный. И делает гибридную серость, ни рыба ни мясо. Приходится уточнять, например, тегом "pixiv", и все равно получается разнобой в стилях. Иногда пикчи обрезаны по диагонали, будто хуевый кроп в датасете. Количеством деталей результаты не блещут, тут скорее как графика в мобильных играх (Clash of Clans). Не знаю, не фанат. Нравится чтобы стиль был как в китайской графике а-ля huaban, weibo. Чтоб детали были настолько изощренными, что мельчайшие из них терялись в пикселях и были меньше одного пикселя, будто это фрактал. Ruan Jia, Guangjian Huang и Fenghua Zhong - лучшие художники, имхо.

https://w0.peakpx.com/wallpaper/733/763/HD-wallpaper-cat-girl-luminos-girl-ruan-jia-face-cat-gorgeous-art-frumusete-superb-cute-pisici.jpg

Так что комьюнити на bilibili рулит, да и восточная изобразительная культура в целом.

Не похуй ли что там за пределами двача? Делалось для технотреда.

>Гайд по файн-тьюнингу (дообучению) SD-чекпоинтов с использованием LoRA и Dreambooth

Это гайд по лоре?

Ну да

>Это так гейпинг-аниме чтоли получился какой-то? Лол

Не, тут типа пример как текстурки в оригинальной гейпинг модели подмешали на онемешные текстурки из другой аниме модельки с полной заменой блока.

Есть более нежный пример пример:

Есть модель фотореальных пёзд AIroticArt-SVulva, она типа оче сильная сама по себе и имеет другую конфигурацию блоков (читшит с оппоста не подходит) нежели комплексные модели.

Берем Bstaber или Bastard, суем в модель А, свульву в модель Б, ставим alpha 0

(тут пик1 спамфильтр не пустил)

Теперь у нас есть еще более реалистичные пёзды.

>Что-то прямо хихикнул, это ты про модель капустную?

Не, чисто капуста как слово, всего навалено, изначальный микс где-то отзвуками отдается имею в виду.

>А бейз1 прикпепишь?

Надо смерджить сначала лол. Попозже.

>Если none поставить тот же хеш будет?

Возможно, не проверял.

>Что вообще за фикс дисторсий, когда и для чего его применять?

Вот тут видно, что с дисторсией модель не реагирует на чанк со smile, собственно это вот и есть дисторсия, когда на чанк не реагирует и руинит твой промт.

>Опять же ноль отличий на этих примерах с ним и без

Ну тут несколько вариантов почему 0 отличий:

а) дисторсия не случилась, но она может случится на любом этапе мерджа

б) промт не вызвал дисторсию

в) модели изначально не имели тензорного значения с дисторсией перед мерджем

Почему должно быть похуй? Давай выпиливай тогда гайд с форча местный.

Дашь ссылку, няш?

Не понимаю тебя. Что не так?

Добавь рядом к "текстовое вложение" в скобочках embedding

Куда именно

Рядом.

Блять, на какую пикчу. Это важно.

На все, чел. Вон у тебя раскодировщик подписан как VAE на пике с жопичем, сделай такое же для остальных. инбифо:Я?!

Так а нахуя подписывать эмбеддингом-то? Это собьет с толку. На пике с жопичем примитивно показан процесс токенизации промта и передача его в unet. Текстуальная инверсия тут не причём, а ведь именно к ней обычно применяют это слово.

И вообще эти картинки чисто для эстетики и краткого понимания. Человек если заинтересуется, нырнёт сёрфить интернет. Тут не про научные работы тред, хотя никто не запрещает.

> она типа оче сильная сама по себе и имеет другую конфигурацию блоков (читшит с оппоста не подходит) нежели комплексные модели

А на много ли моделек этот читшит вообще впринципе подойдёт? Я читал на том форуме, этот пик это что-то усредненное по 5(вроде) моделям, где что находилось в них, но это же вовсе не означает что в нужной модельке это будет лежать там же.

> Вот тут видно, что с дисторсией модель не реагирует на чанк со smile, собственно это вот и есть дисторсия, когда на чанк не реагирует и руинит твой промт.

Да кто такой этот ваш дисторсия и нахуя она нужна если просто руинит промпты?

Алсо с какой именно галкой она выключена/включена? None = выключена, Force reset = включена?

И не раскодировщик который называется как VAE, а раскодировщик который является часть VAE. Именно поэтому я написал два слова вместе.

Может лучше сам спелл напрямую в гайд добавить? Там со всеми этими спецсимволами очень легко обосраться.

%all:unsafe,separator=^,^ %

Ок

Оперативно. Благодарю.

Это как раз-таки с толку не собьет, а поможет понять, на каком этапе работы нейросети вообще появляется эффект от результатов textual inversion, несмотря на то что как таковой её на пике нет.

Ну тут и правда не очень правильный пример получился, но тем не менее, там всё понятно что за что отвечает.

Алсо интересно было бы увидеть такой же график, но для img2img, по сути там же ничего не поменяется кроме кодирования через кодировщик vae в latent и накидывания шума или я фундаментально ошибаюсь по поводу работы img2img?

>Это как раз-таки с толку не собьет

Да лень пиздец.

>img2img

Берется изображение, размывается по гауссу я так понял (denoising strength 0.0-1.0), vae кодирует в латент, потом по кругу семплирование n шагов, vae декодирует обратно. Шум там подмешивается или нет хуй знает, на превью вроде не видно.

>а поможет понять, на каком этапе работы нейросети вообще появляется эффект от результатов textual inversion

Да и плюс на первом пике с типами тренировок вроде достаточно понятно показано, что ti пихается на этапе токенизации промта, направляя своим весом unet в нужную сторону. Как магическое супер слово.

https://twitter.com/Buntworthy/status/1615302310854381571

Как же я жду эту хрень в автоматике.

Как же я жду эту хрень в автоматике.

>А на много ли моделек этот читшит вообще впринципе подойдёт? Я читал на том форуме, этот пик это что-то усредненное по 5(вроде) моделям, где что находилось в них, но это же вовсе не означает что в нужной модельке это будет лежать там же.

Там конкретно эти модели

Futanari-v2-e3

GapingLargeInsertion-60

ZeipherFN-f222

Airoticart-Penflac-Penerec

А ф222 почти в каждый микс суется, поэтому в целом можно считать что к любой модели должно подходить болиелимение.

>Да кто такой этот ваш дисторсия и нахуя она нужна если просто руинит промпты?

Это рандом ошибка вываливающаяся при мердже,

This is an int64 tensor that has the values from 0 to 76, merging will convert these to float and introduce errors. For example in AnythingV3 the value 76 has become 75.9975, which is cast back to int64 when loaded by the webui, resulting in 75

>Алсо с какой именно галкой она выключена/включена? None = выключена, Force reset = включена?

Нет: ничего не делать (тот же метод расчета, что и раньше)

Пропустить: пропустить вычисление целевого ключа

Принудительный сброс: перезапишите в целое число, как в сценарии модификации

Вот полный японский гайд https://note.com/bbcmc/n/n12c05bf109cc , там я переводчиком посидел и конкретно про ФИКС ПРИНУЖДЕНИЯ написано вот отсюда на пике, так что я выбираю форс резет для ПРИНУДИТЕЛЬНОЙ ПЕРЕЗАПИСИ и всё.

Оно уже есть ток релиз старый покачто https://github.com/nagolinc/sd-image-variations-webui-plugin

О, прикольно, пасиба

> Это рандом ошибка вываливающаяся при мердже,

> This is an int64 tensor that has the values from 0 to 76, merging will convert these to float and introduce errors. For example in AnythingV3 the value 76 has become 75.9975, which is cast back to int64 when loaded by the webui, resulting in 75

Обычная мерджилка мне такую никогда не выдавала, иногда только памяти не хватало судя по еррору, если бстабер с чем-то миксить. Это с последними обновлениями такие приколы, или чисто фича актуальная для этой мерджилки по блокам?

Алсо благодарю за объяснения, анон.

Я не понимаю почему созданные мной Textual Inversion выглядят как полный КАЛ

Потыкал вроде все что есть но результат один

Объясните как создавать пиздатые TI для аниме моделек и не сойти с ума от безумия

(прикрепил свои результаты)

((для обучения использовал 8 изображений))

(((делаю это все в webui колабе)))

Потыкал вроде все что есть но результат один

Объясните как создавать пиздатые TI для аниме моделек и не сойти с ума от безумия

(прикрепил свои результаты)

((для обучения использовал 8 изображений))

(((делаю это все в webui колабе)))

Уменьшай learning rate, начни с 0.0001

>Обычная мерджилка мне такую никогда не выдавала

Так она не выдает ее в командной строке, это надо тензоры в готовой модельке ковырять и смотреть какие там значения, типа норм значения пикрел 1, а там вполне может быть шизофрения руинящая промты пикрел 2.

> или чисто фича актуальная для этой мерджилки по блокам?

Дисторсии на базовой мерджилке всегда были, их вот этим форс резетом пофиксили просто, наглядная анимация пик3.

Кто-нибудь понимает чем принципиально отличаются img2img от хай рез фикса? Ну если с img2img мы разобрались, то в чём прикол хай реза? Что за крутые алгоритмы интерполирования изображения типа Latent? Очень интересно.

> Так она не выдает ее в командной строке, это надо тензоры в готовой модельке ковырять и смотреть какие там значения, типа норм значения пикрел 1, а там вполне может быть шизофрения руинящая промты пикрел 2.

> Дисторсии на базовой мерджилке всегда были, их вот этим форс резетом пофиксили просто, наглядная анимация пик3.

Wait a minute... То-есть всё это время разнообразные yoba-boba-super-vasyan228 миксы могли иметь такой огромный недочёт и не реагировать на определённые теги, ну как в примере со смайлинг выше? Ну лол, блядь

>То-есть всё это время разнообразные yoba-boba-super-vasyan228 миксы могли иметь такой огромный недочёт и не реагировать на определённые теги, ну как в примере со смайлинг выше?

Бинго. Собственно, они и имеют, но всем тупа пахую. Олсо кривые руки от дисторсий тоже еще больше ухудшаются.

Не сильно там чего объясняют, но спасибо

Оче коротко: то что в автоматике подписано как Latent, не переводит изображения в привычный пиксельный формат с помощью VAE перед апскейлом, а апскейлит как бы само скрытое пространство. Другие "апскейлеры" - условный валар, принимают на вход изображение в пиксельном виде, перед этим прошедшее через декодер VAE.

Мг, ну это я понял. Интересно как новые алгоритмы апскейлят внутри скрытого пространства, выдавая такое количество деталей

>всё это время разнообразные yoba-boba-super-vasyan228 миксы могли иметь такой огромный недочёт и не реагировать на определённые теги

Одно хорошо, что готовые миксы можно через тулкит пофиксить форс резетом. Но большинство похоже ебало этого рот и дальше будет (((((((anus:1.5))))))) хуячить.

Ты делал эмбеддинг или гипернетворк?

Это нужно ALL_A пресет поставить, альфу 0 и форс ресет, чтобы пофиксить это говно, правильно понимаю? Ну и модель в А поставить соответствующую

Предположу что там не новые алгоритмы, в Latent скорее всего применяется линейное масштабирование скрытого пространства, в Latent bicubic - бикубическое масштабирование, в Latent nearest - ... ну ты понел.

Эмбеддинг

Всё так и есть

Я через весовой плаген не фиксел. Есть отдельно способ через https://github.com/arenatemp/stable-diffusion-webui-model-toolkit

Так вот это и прикольно. На изображении интерполяция очевидна – она по значениям rgb, то в скрытом пространстве для меня тайна. Как там данные представлены, как они интерполируются и т.д.

>Как там данные представлены

Я думаю можно вполне себе представлять это как обычную картинку, но только с очень большой глубиной цвета. Интерполируются соответственно так же.

Хм, имеет смысл. Спасибо.

Никакой там магии нет

https://discuss.huggingface.co/t/decoding-latents-to-rgb-without-upscaling/23204

Кстати, даже автор не считает "фикс" 75 тензора какой-то панацеей и в примере показывает, что не факт, что "почиенное" генерит лучше:

Хм, прикольно. 4 канала.

Их обучить намного сложнее. Лучше пробовать гиперсеть или лору.

Скорость ставил обычно такую для гиперсети. Можешь какую-то другую, но главное не дефолтную. Еще советую из настроек тыкнуть: Choose latent sampling method на random. Shuffle tags by ',' when creating prompts галочку. А так же на Add layer normalization.

Спасибо стало явно лучше

Еще можно уменьшить, я думаю.

Ну попробовать и посмотреть отличия всё-таки стоит, а что в этом расширении выставить надо, чтобы фикс сделать?

когда у тебя все тензоры по пизде пошли "вероятно худшее" уже случилось

Вот бы кто-нибудь объяснил на пальцах в чем разница между

embeding

lora

hypernetwork

На примерах, а не в плане реализации. А то заебали уже объяснять про слои, вы на живых примерах расскажите, что в каком случае юзать.

В целом, нет особых причин юзать что-то кроме лоры. Она стабильно и быстро выдает хороший результат.

Надо клип вытащить из модели с нормальными тензорами (из оригинального сд например) и импортировать его в модель которую надо фиксануть, потом сохранить.

Вообще-то есть. Если знаешь как тренировать эмбеддинг и знаешь, что он подходит для твоей задачи, то тебе не придется проводить лишний раз процедуру введения мужского полового хуя в компьютер.

База.

Пик ->

Как бывший противник треда, скажу, что поменял свое мнение, почитав. Вы вполне можете слать меня на три буквы, но я должен был это сказать. И даже личность зачинателя тут нисколько не мешает.

Респектуемо.

Hard way остюда: https://github.com/arenatemp/stable-diffusion-webui-model-toolkit#example описывает процесс, я так понимаю?

Только клип, больше ничего не нужно?

Да, ток клип. Сразу заспойлерю: пофикшенная сетка будет реагировать на каждое слово практически идеально, не потребуется никаких скобок и прочих мультиплаеров, если юзаешь эмбединги то они будут сильно влиять на картинку (еще больше чем до этого). И визуал будет интересный так скажем, отличный от оригинального мерджа с говняными тензорами, если там много приколов было смерджено до этого.

А и да, фиксированный сид можно будет не менять больше, сетка сможет рисовать изменения прям на статическом. Это наверно главный плюс фикса.

>В том и суть, теперь будут срачи что техно а что не техно, да. Ебля с тренингом - техно? Пожалуй да, даже гайд написали которому место в шапке и все. Настройки модели которые тут никто не трогает - техно? Наверно. Использование в тегах автора - техно? Хуй знает, вроде про это уже тред где-то есть, пусть дальше тонет. Отдельные примеры промтов и мажик-ворды что дают нужный эффект, резкость, дофы, глоу, прочее - техно? Ой наверно уже нет мы там пердолимся и лосс измеряем а тут что-то про генерацию нужных результатов, не будем включать. Продолждать можно долго.

>Или тащить все без нытья вахтеров про релейтед, или делать отдельный тред про стилистику, куда пойдет восприятие разных стилей написания промтов моделями, отдельные подборки и советы по позам-костюмам (раньше было в шапке), эзотерику типа пустых запятых и кратности.

Ебало? Мнения?

А тут реквесты на лоры принимают еще? Можете Эш из овервотча сделать?

Технически ведь можно раскукожить модель в формат diffusers, подменить файлы(папки) и потом скукожить обратно в ckpt?

Я тот анон, что предлагал на своих мощностях обучить.

С тебя датасет, тогда могу. Датасет - это штук 10-50 протеганных пикч.

Сам собирать не буду.

Да, конвертеры специальные

Если можно, то Балалайку из Пиратов Черной Лагуны плиз.

Да вы заебете, товарищи. Лоры тренятся по 30-40 минут на 1060. Я отказываюсь верить, что у вас хуже железо.

датасет и Настройки..

Не понял про это, сейчас как раз попробовал зафиксировать сид после этого фикса, там результаты на уровне погрешности искформеров, по чу-чуть меняется что-то на картинке

Ну пиздец,

>Настройки...

В гайде. Боишься – не трогай, по дефолту и так всё работает.

>датасет

Ну извините.

Сделай нормальный гайд буду хоть 24/7 фигачить лорки...

Попробуй использовать оператор | вместо запятых

Слушай, господин, ты не против сделать мини-гайд на рентри? В свободной форме. В шапку попадешь, полезная информация.

С треда тонна нефти очевидно.

Убил...

Спасибо, а какой метод проще для вкатывания: через скрипт или дримбус?

Заменил вообще все запятые, кроме начальных тегов на качество, на |. Никакого эффекта опять не заметил, что-то сделал не так при фиксе или это можно считать большими изменениями в картинке?

Мне было проще через скрипт. У дримбуза требования выше, возможностей меньше (по крайней мере, пока). Всё работает как часы.

Оке, буду пробовать. Добра

Давай, и лей лоры сюда, будем каталог заполнять

Через расширение скорее всего мертвый метод, автор уже сам повеситься хочет нахуй, от того что автоматик ему всё ломает.

Я потом перепишу с кривого дополнения гайд на отдельную установку https://github.com/bmaltais/kohya_ss с гуями.

Потому что все это шаманство с откатом кривых версий дополнения уже заебало.

За этого рад, но актуально.

>Заменил вообще все запятые, кроме начальных тегов на качество, на |. Никакого эффекта опять не заметил

У тя случаем клипскип не стоит высокий? Просто у меня на рандомном говномердже спокойно меняет генерацию на статичном сиде что с запятыми, что с |.

>или это можно считать большими изменениями в картинке?

Ну такто измненеия большие, но не настолько большие как на моих шизомерджах где я аниме с реалистиками смешиваю. Тестируй отклик сетки на промпты кароч. Че за модель кста?

Ок, будет заебись. Но можешь не тереть старое, оставим в самом низу с предупреждением.

Я понял. На какой модели тренировать? Могу предложить SD 2.1, мне даже интересно что получится.

Если ты сам соберешь датасет, то получится лучше.

Потому что ты сможешь сам отобрать пикчи, которые тебе нравятся, и то, что ты хочешь по факту видеть в лоре.

А не надеяться, что у вас вкусы сойдутся с автором.

У иностранных анонов кста можно потырить еще лор, там уже много всего накопилось:

https://gitgud.io/gayshit/makesomefuckingporn

https://rentry.org/hdglorarepo

https://gitgud.io/gayshit/makesomefuckingporn

https://rentry.org/hdglorarepo

Он прав ->

Если будешь пусечкой еще и затегаешь, ускоришь появление лоры раз в 5. Пушто в овервотч я ни разу не играл. В гайде описано как тренировать в зависимости от используемой модели, если что.

Интересное расширение. Можно вытащить VAE из модели v2.1 и использовать его с моделями v1

>тренировать

тегать

быстрофикс

Не надо тырить, просто ссылку укажи. Алсо для работы CTRL+F по рентри можно прописать персонажей оттуда в виде тегов.

Не знаю, что именно тебе бы скинуть в качестве сравнения. Сравнения на n количестве шагов, на t затраченном времени или просто самый лучший полученный результат.

Самый хуевый, но действенный совет - юзать то, что и другие юзают. Лора самый навороченный. Охуеть быстрый, можно регулировать силу вплоть в минус, чтобы использовать его как негатив. Можно обучать кучу концептов одним разом, одним файлом получить сразу 10 девок из Love Live! School Idol Project, например.

Если вернуться к изначальному вопросу, то с Лорой проебатся очень сложно. Гиперсеть требует большего внимания к скорости, контролю превью того, чем она уже обучилась и чтобы вовремя приостановить и возобновить обучение с немного другой скоростью. Поэтому если я сейчас тебе скину пример гиперсети, то гиперсеть-фаги меня засрут за неверные настройки.

Лору можно обучить рисовать в какой-нибудь стилистике?

Да.

Конечно.

> У тя случаем клипскип не стоит высокий?

Второй

> Просто у меня на рандомном говномердже спокойно меняет генерацию на статичном сиде что с запятыми, что с |.

Покажи пару примеров, как по мне тут просто иксформер влияет на картинку, самую малость изменяя детали

> Че за модель кста?

Это капустный микс, только на 4.5 эни. Вынул клип от 4.5 и пихнул в него

>На какой модели

Как пожелаешь.

Сет не хочу собирать, просто пройдись автотеггером если можешь. Если парит, пофиг, мне не горит.

Т.е я могу ей закинуть датасет кадров из какого-нибудь мульта производства Арменфильма и оно мне будет генерировать такое?

Ну если затегаешь правильно, то да. Всё упирается не в то, какую технологию ты используешь, а то, как ты подготовил датасет.

Ок

Гайды по правильному тегированию когда будут?

В гайде по лоре

Собственно, я как раз закончил тестировать 10 эпох лоры на своем датасете.

Училось на базовой модели без ввода тематической (фурри) модели.

Жертва - оранж base.

Каждый шаг, после первого - это примерно 1300 шагов обучения, одна эпоха.

Датасет из 5 концептов (художников) примерно по 50 пикч каждый.

Последняя пикча - это натренированный за ночь полновесный dreambooth на 50000 шагов.

Что увидел: одна эпоха дала достаточно хороший результат. Съедобно.

2, 3, 4 и 5 не особо юзабельны - "интеграция пизды".

С 6 уже снова съедобно, дальше только сексуализация моделей (отъедаем жопу с сиськами).

Dreambooth отличается принципиально в лучшую сторону.

Фон сложнее, пальцы не на удачу рисуются, текстура тела и меха лучше всех предыдущих, морда не такая "потерянная".

Но да, на это удовольствие надо примерно 21 гиг VRAM и 8 часов работы 4090.

Училось на базовой модели без ввода тематической (фурри) модели.

Жертва - оранж base.

Каждый шаг, после первого - это примерно 1300 шагов обучения, одна эпоха.

Датасет из 5 концептов (художников) примерно по 50 пикч каждый.

Последняя пикча - это натренированный за ночь полновесный dreambooth на 50000 шагов.

Что увидел: одна эпоха дала достаточно хороший результат. Съедобно.

2, 3, 4 и 5 не особо юзабельны - "интеграция пизды".

С 6 уже снова съедобно, дальше только сексуализация моделей (отъедаем жопу с сиськами).

Dreambooth отличается принципиально в лучшую сторону.

Фон сложнее, пальцы не на удачу рисуются, текстура тела и меха лучше всех предыдущих, морда не такая "потерянная".

Но да, на это удовольствие надо примерно 21 гиг VRAM и 8 часов работы 4090.

>Покажи пару примеров

ну вот, отличие между говнопромптами из 23х чанков в две скобки, статик сид

Тегай все, что видишь, не ленись. Фон, предметы на картинке, цвета (волос, кожи, одежды) даже если все это не имеет прямого отношения к тому, что тренируешь.

Тогда будет проще потом выбить нормальный фон и предметы в будущем, когда будешь пользоваться лорой.

>Второй

поменяй на единичку кста

>только на 4.5 эни. Вынул клип от 4.5

А ты уверен что энифинговский клип ровный по тензорам?

Ничо, ща потестирую разные настройки скоростей обучения и догоню тебя :)

Уже выявил что ускорение unet в пару раз даёт общее улучшение восприятия промта.

>8 часов работы 4090

Ит/с на эйлере а 512х512 батч 1?

13, но у меня сейчас пука загружена.

И хформерс старый, потому что новый мне руинит батчинг:

python: 3.10.8 • torch: 1.12.1+cu113 • xformers: 0.0.14.dev • gradio: 3.16.2 • commit: c12d7ddd • checkpoint: ebc7c8b49d

>13

Слишком мало, обычно сколько даёт? Просто если так считать, то это вышло бы всего лишь 15 часов на 3060 (и 32 часа если 30 ит/с), если бы у 3060 было столько видеопамяти, и с новым торчем и иксформерсов проблем бы не было, лол.

>Слишком мало, обычно сколько даёт?

Не помню. Завтра напишу, как пеку разгружу.

Дай промпт, попробую. Две скобки так-то могут очень сильные изменения дать

Зачем? На первом с таким промптом на 20 пальцев и полностью находящейся лисой в кадре цирк уродов просто обеспечен

Нет, как проверить?

При скольки повторений на пикчу?

Кстати, что там в дримбузе, какие настройки существуют?

Сейчас лору тестирую, и заметил, что у персонажа сигнатурная заколка на волосах вечно какая-то переёбанная. Вот всё нормально, и лицо, и одежда, но вот сраную заколку ровно сгенерировать не может. Потому что она маленькая. У другого персонжа абсолютно такая же проблема: заколка. Хотя в датасете она и протегана везде, и чётко на пикчах видна, её форма, цвет, но при генерациях не то, как будто сеть еще не успела научиться этому "подконцепту".

Так вот к чему я: может ты пользуешься какими-то фичами при тренировке типа планировщика скорости обучения? Есть ли смысл тренировать именно долго? Как у тебя обстоят дела с обучением мелким деталям?

Это только на лору

На dreambooth не помню, дохуя выходит на 50-то тыщ шагов.

>Дай промпт, попробую.

from behind, 1girl sexy nude woman body, large spread anus hole, semen inside holes, ass close up

>Две скобки так-то могут очень сильные изменения дать

с запятыми тож самое и с любыми новыми словами

>Зачем? На первом с таким промптом на 20 пальцев и полностью находящейся лисой в кадре цирк уродов просто обеспечен

я всегда на единичке все делаю

>Нет, как проверить?

чекнуть через питон очевидно взять клип от оригинального сд и въебенить его в капусту

>Кстати, что там в дримбузе, какие настройки существуют?

Все те же самые по сути.

>Вот всё нормально, и лицо, и одежда, но вот сраную заколку ровно сгенерировать не может. Потому что она маленькая. У другого персонжа абсолютно такая же проблема: заколка. Хотя в датасете она и протегана везде, и чётко на пикчах видна, её форма, цвет, но при генерациях не то, как будто сеть еще не успела научиться этому "подконцепту".

Тут я тебе ничего полезного не скажу, потому что учу стилям, а не деталям.

>Так вот к чему я: может ты пользуешься какими-то фичами при тренировке типа планировщика скорости обучения?

Для dreambooth я использовал constant with warmup, а для lora - cosine.

Но полноценного сравнения я не делал, потому что одну и ту же модель обучать по 7 часов ради минорных изменений в результате как-то пока ломает. Но возможно руки дойдут еще.

Без регуляционных изображений? Не использовал отзеркаленные пикчи?

>Без регуляционных изображений?

Без.

>Не использовал отзеркаленные пикчи?

Использовал.

Рандомайзер цветов - нет.

Ок, спасибо

простейший пример пофикшенной говносетки

nude woman -> результат

тот же самый nude woman на непофикшенной, очевидно проебанная анатомия

> from behind, 1girl sexy nude woman body, large spread anus hole, semen inside holes, ass close up

Ни на первом, ни на втором клипе ничего не меняется в картинке. Ну ладно, на одной из четырех на жопе камшот пропал.

> очевидно взять клип от оригинального сд и въебенить его в капусту

А может лучше через питон? Скрипт какой-то для этого есть?

Вот это уже куда интереснее, обычная капуста просто не реагирует, в отличии от фикса

А что, в миксах какой-то другой clip? Откуда он там мог взяться? Знаю про кастомный vae, но про кастомный clip или unet ни разу ничего не слышал.

>А может лучше через питон? Скрипт какой-то для этого есть?

надо анаконду ставить, и потом через ее шелл команды ебошить типа cond_stage_model.transformer.text_model.embeddings.position_ids , я не особо в питоне шарю поэтому не занимался чекингом

>А что, в миксах какой-то другой clip?

Там он просто проебанный из-за десятков и сотен мерджей, поэтому все промпты через жопу написаны (((()))) чтобы сетка среагировала на тег с огромным количеством мультиплаеров

>Ни на первом, ни на втором клипе ничего не меняется в картинке.

Ну мне кажется дело в клипе энифинга, щас въебеню сдшный в еще одну говномодель чисто для теста все будет меняться инфа сотка

pic1 фиксед, статик сид: anime, nude woman

pic2 фиксед, статик сид: anime, sexy nude woman

к слову это оранж, оригинал непофикшенный недалеко ушел от фикседа, так что там мердж достаточно качественный по тензорам получается, расхождения небольшие

Как понять, проебан он в конкретном миксе или нет?

Зачем? Что уже обычного интерпретатора мало по какой-то причине и надо обмазываться чем-то?

Ну ты читер, промпт меняешь, я думал вообще не меняя промпт такое будет, что нонсенс вообще какой-то с фиксированным сидом. Вот тоже впилил сдшный, промпты как и у тебя, без аниме. Они работают по другому, выборка хуёвая, надо реально на куда большем количестве промптов тестить.

Надеялся, что подмена clip сможет пофиксить анатомию на некоторых говномиксах (типа AMIXSFADD05+DOGGY) — хуй там.

сделал контрольный тест:

две модели

1. форс резет аналога вейтедсума в плагине весов 0.5, альфа 0.5

2. мануальная замены клипа от сд в стандартный вейтед сум 0.5 мердж чекпоинт

различия в пределах погрешности, причем стандартный вейтедсум насрал в финальную модель моделью Б больше по итогу

две модели

1. форс резет аналога вейтедсума в плагине весов 0.5, альфа 0.5

2. мануальная замены клипа от сд в стандартный вейтед сум 0.5 мердж чекпоинт

различия в пределах погрешности, причем стандартный вейтедсум насрал в финальную модель моделью Б больше по итогу

В отдельную.

чекать тензоры

>Зачем? Что уже обычного интерпретатора мало по какой-то причине и надо обмазываться чем-то?

ну вся хуйня мануальная через анаконду делалась всегда, я других способов незнаю

>я думал вообще не меняя промпт такое будет

ну ты лол кек

Какие-то у вас тут гриды непонятные нихуя.

Разобрался, спасибо.

Просто бы ответом к шапке прикрепил, что морочиться.

+ предлагаю этот сайт в следующую шапку сунуть, возможно пригодится кому.

https://www.birme.net/?target_width=512&target_height=512

Ты пилишь эти лоры? Может подумаешь насчёт хф или цивитай, заместо меги? Я не могу через браузер скачать и приложение тоже не работает, приходится под вм запускать это всё дело

Я могу заливать в другое место или в несколько мест, файлы небольшие

Мне больше оранж с клипом от наи нравится, чем с родным, лол.

Хочу запилить эмбеддинг или что-то подобное, что модель могла нормально рисовать эту расу https://betabooru.donmai.us/posts?tags=au_ra

Т.к. довольно малопопулярные персонажи - артов угодило в датасеты моделей мало и все модели в эту расу могут крайне криво. Но если навернуть сверху эмбеддинг или что-то подобное - должно хорошо получиться. Так вот, какие картинки подбирать для обучения? Максимально простые, но отражающие специфику расы? Паттерн чешуек на коже, специфическая форма рогов и хвоста не встречающаяся у других и т.д. И при этом на максимально простом фоне? Пробовал делать собрав прилично картинок одного художника, чтобы были в едином стиле, но там сложные позы, сложные фоны - как не крутил настойки получался эмбеддинг вообще практически не работающий, а промежуточные картинки выдавал при обучении - кривущее говно.

Т.к. довольно малопопулярные персонажи - артов угодило в датасеты моделей мало и все модели в эту расу могут крайне криво. Но если навернуть сверху эмбеддинг или что-то подобное - должно хорошо получиться. Так вот, какие картинки подбирать для обучения? Максимально простые, но отражающие специфику расы? Паттерн чешуек на коже, специфическая форма рогов и хвоста не встречающаяся у других и т.д. И при этом на максимально простом фоне? Пробовал делать собрав прилично картинок одного художника, чтобы были в едином стиле, но там сложные позы, сложные фоны - как не крутил настойки получался эмбеддинг вообще практически не работающий, а промежуточные картинки выдавал при обучении - кривущее говно.

Я вам завтра сделаю помойку под лоры.

Есть ли смысл обучать лоры/эмбеды на изображениях 1024х1024? По идее да же, можно добавить больше деталей.

Я думал изначально именно с нашей доски сделать репозиторий. Суть в том что тут не только мои лоры должны быть, а аноны должны скидывать свои, просто заполнить страничку и привлечь надо было как-то. А цивитаи неинтересно. Понятно дело что можно и туда сливать.

Оп, будет круто, дядя :3

Да куда угодно, отличным будет специализированное место под это:

https://huggingface.co/

https://civitai.com/

Ну или к этому анону если запилит

Насчёт эмбедов не скажу, но лоры да, есть смысл. Больше информации = больше деталей. Другое дело что скорость обучения падает в разы, но возможно оно того стоит.

Чёт не хочется вниманиеблядствовать особо, хз. Хочется уютненький харкачевский репозиторий

Cколько минимально для лоры лучше картинок заготовить?

10-30

Спасибо

Тогда надо Мишу попросить, чтобы добавил лорки себе, хз заходит он сюда ещё или нет

Вот только что конкретно эти детали смогут улучшить?

Потенцию

Ну кстати наверное очень сильно улучшились бы отдаленные шоты, если они бы присутствовали в датасете.

Хз кто такой Миша

У меня например струны на гитаре всегда косые генерировались. Мне кажется большее разрешение могло бы с этим помочь. Плюс хай рез фиксу вряд ли придется так упорно дорисовывать несуществующие детали, ведь у него есть информация как всё должно выглядеть на большом разрешении.

Главное чтобы не стоял планировщик "constant" в скрипте. Иначе сеть не сумеет обучиться маленьким деталям.

Да, с гитарами тут интересный пример. готов ли кто-то делать лору на гитару?

Да. Но я не делал лоры до этого и хз где брать арты кроме кадров из аниме

Ну в рентри я кинул лору с Хитори, и там 40 изображений с гитарой. И гитару сеть вполне понимает, но как я уже сказал струны и колки это тихий ужас.

Сейчас на ночь поставлю тренится подольше, посмотрим че выйдет.

Да анон местный, репозиторий с модельками и разной херней по мелочи поднял и держит на одном энтузиазме, зря его из шапки выпилили, там есть старые модельки, которым до сих пор можно найти применение: https://static.nas1.gl.arkprojects.space/stable-diff/

Вроде говорил, что выпилит репу, если в шапке больше её не будет, может это он отписал вообще?

> это (You) он отписал вообще?

Нет. Это отписал фурриеб.

>но как я уже сказал струны и колки это тихий ужас.

Ну я вот как раз про это дело. Ни одной гитары прямой я ещё из нейросетей не видел.

Сегодня увидишь.

Да дохера там моделей разных, надо вернуть в шапку. bstaber я например нигде кроме его сервера найти не смог

А тебе гомонегров туда не накидают?

Попробую прикрутить фильтр только на safetensors и pt.

В крайнем случае настрою крон, чтобы выпиливал все, что не они.

Хорошо анон, подожду.

Кстати с гитарой может немного помочь инпеинт, как ты уже написал, сеть её знает, и в зависимости от расстояния до камеры инпеинт накинет ей деталек и выпрямит струны, не идеально конечно, но хоть как-то

Проебался эмбеддинг, хуй знает почему. Раньше с вае 30к шагов оттренировал, сейчас решил сломаться.

Подскажите пожалуйста, в чем проблема? Питон последней версии:

Выполни в консоли

[Console]::OutputEncoding = [System.Text.Encoding]::UTF8

и запусти еще раз, посмотри на что он ругается

Тоже самое, допустим вариант самостоятельно скачать и поставить?

Ебать конечно клипчейнж вещь конечно, даже кривого хасана пофиксило и пользоваться норм можно.

Общеизвестно, что у хассана и подобных моделей свой стиль тегов. Если суповой набор с буры на нем не взлетал - не признак кривоты.

>свой стиль тегов

Теперь так называется кривейший набор тензоров.

Может кривейший, а может и не кривейший. Кто-то проверял? Как это проверить - по-человечески ответить не могут.

К хассановским промтам его модели чувствительны.

>Может кривейший, а может и не кривейший. Кто-то проверял?

Я только что проверил.

Объясните, в

https://github.com/arenatemp/stable-diffusion-webui-model-toolkit#example

>The option Fix broken CLIP position IDs

Какая опция-то? У меня нет никаких опций в тулките. Только кнопки import/export и сверху 3 базовые. Оно по дефолту вшито?

https://github.com/arenatemp/stable-diffusion-webui-model-toolkit#example

>The option Fix broken CLIP position IDs

Какая опция-то? У меня нет никаких опций в тулките. Только кнопки import/export и сверху 3 базовые. Оно по дефолту вшито?

выковыриваешь откуданить клип через экспорт

потом загружаешь модель для фикса, кидаешь экспортированный клип в пик, выбираешь в компонентах пик2, жмешь импорт, потом сейвишь

Я так и делал, но мне интересно, о какой там опции речь. Явно же не о мануальной замене клипа, тем более так можно наоборот кривой клип вместо цельного вкрячить.

> о какой там опции речь

Об этой и речь, только для погромистов через шелл. Казуалы свапают клип через замену в вебуи.

Подскажите способ перегнать .safetensors в .ckpt? Надо затестить свой промпт на той же модели, но в InvokeAI, а он сейфы не запускает.

>Что с этим делать?

Тренить лору.

Попробуй скачать новый павершелл. Часто из-за старой версии выскакивают проблемы

Мужики, научите.

Есть такая тулза:

https://github.com/diStyApps/Safe-and-Stable-Ckpt2Safetensors-Conversion-Tool-GUI

Все модели в сейфтензорс черпз нее перегнал

Благодарю

Затестил ИнвокАИ и автоматик. Инвок с тем же промптом качественно отрисовывает задники, но отказывается рисовать фуррей и ДФЦ, рисует дойки. Про ограничение промпта в курсе, укоротил до нужных значений, но результаты пиздец разные на одном и том же сэмплере с тем же промптом. Различия снижаются только если использовать ну прям минимум промпта, чем он сложнее, чем разнообразнее веса, тем сильнее разница на выходе. Но одно точно ясно, Инвок более качественно отрисовывает задники, почему-то.

Промпт не скину, съебался на работу.

Промпт не скину, съебался на работу.

Первые две, это инвок, третья это автоматик. Сид и промпт одинаковый, только в одной картинке что-то чуть изменено, но уже времени чекать нет.

Кому нужна наглядность вот джве картинки - слева хасан обычный, справа хасан фикс через SD1.5 CLIP. Без негативов, без фейсрестора, супер простой промт masterpiece photo | nude woman | cyberpunk, один и тот же сид.

Нефикшенный хасан ебнулся и нарисовал киборга с уебанными тенями, фикшенный понял что от него требуется. Если дальше усложнять промт чтобы убрать бабу киборга, а бабу справа наоборот превращать в киборга - у оригинального хасана начнется жопа, а бабе справа достаточно добавить один тег.

Ну да, можно. Сделаю либо щас, либо позже.

>Про ограничение промпта в курсе

Можно поподробнее?

Там ограничение на количество промпта, выше 75 нельзя, батник пишет, что превышен допустимое число и промт обрезается. Конкретики внести не могу, я на работе.

в оф доках инвока написано что ВСЕ текущие клиенты для стейблдифьюжен имеют лимит в 77токенов. Но автоматик обходит его не тем что разрешает безлимитный промпт, а тем что сам автоматом блендит 2 токена в 1 используя (токен).blend(токен2). Только при этом не показывает это юзеру и не давая контроля над процессом

Ну это объясняет почему одежда, волосы и деревья обр встают мехом, они блядь перемешиваются с тэгом через жопу.

Аноны, хочу вкатиться в ИИ и в тоже время обновляю компьютер. Как идеально подобрать комплектующие под эту задачу? Может быть какой-то список топ процессорров и видеокарт есть?

Мука, с телефона пик не грузится

Кто-нить шарет за питон? Как чекать тензоры в готовой модели? Желательно по шагам чтобы че куда писать.

Автоматик подогнал годноту, промтогенератор с тренированными моделями на GPT. Может работать онлайн, но там вроде как долго грузит модельку каждый раз, поэтому бекапнул все три модели и выложил архивом телега/h0rnee/69

Кидать все три папки в stable-diffusion-webui\extensions\stable-diffusion-webui-promptgen\models

Сам скрипт https://github.com/AUTOMATIC1111/stable-diffusion-webui-promptgen (можно скачать из вкладки экстеншенов вебуи)

Unsafe делает прям как и должен unsafe, пробуйте сами, на пике очевидный safe.

Кидать все три папки в stable-diffusion-webui\extensions\stable-diffusion-webui-promptgen\models

Сам скрипт https://github.com/AUTOMATIC1111/stable-diffusion-webui-promptgen (можно скачать из вкладки экстеншенов вебуи)

Unsafe делает прям как и должен unsafe, пробуйте сами, на пике очевидный safe.

>но там вроде как долго грузит модельку каждый раз

А нет, он их типа кудато в темп скачивает похоже при выборе, не могу найти куда. Папка для офлайн моделек пустая. Кто найдет куда он скачивает маякните.

Брух, можно просто зайти в папку extensions/stable-diffusion-webui-promptgen/models/

и сделать git clone https://huggingface.co/AUTOMATIC/promptgen-majinai-unsafe

и вся модель целиком скачается

Он их скачивает в папку c:\Users\%USERNAME%\.huggingface\

Можно, но если у кого гит не стоит?

О, пасиба

*c:\Users\%USERNAME%\.cache\huggingface\

У тех, кто пользуется webui Автоматика, думаю, он стоит

Ну чет поставил я эту хрень, жму генерейт, а ничего не происходит. ХОРОШИЙ ГЕНЕРАТОР.

перезапусти вебуи, у меня также было

Уже пару раз перезапускал

Консоль?

Та же хуйня, webui уже 5 раз перезапускал

В консоли браузера ругается на строку var id = randomId() в файле promptgen.js

Автоматиковая консоль пуста и девственна не считая логов запуска.

И что терь с этим делать?

>js

Недавно автоматик поломал кучу расширений, обновив gradio до 3.16.2. Возможно стоит копать в эту сторону.

Удаляй папку экстеншена, ставь заново, кидай модели в models, перезапускай или перезапускай, выбирай модельки из выпадающего списка, смотри чтобы скачивались в кмд -> пробуй

У меня всё запустилось и работает.

У меня gradio 3.15 стоит

Алсо стоит последний автоматик офк

Сейчас встану с постели, протещу у себя. Еще неплохо прикладывать коммит или хотя бы дату последнего пулла, ибо автоматик любит пускать в мастер всякое неотдебаганное говно.

Бюджет какой?

Нвидиякарточка 12 гигов минимум для комофорта и полного функционала в том числе обучение. С небольшим пердолингом можно комфортно жить на 8 гигах. Уже некомфортно становится на 6 гигах, можно тренить только лору. Ниже 6 гигов только мерджить модельки и делать картинки, иногда отсасывая при использовании хайресфикса.

Олсоу оперативы побольше быстрой тоже надо бы. На проц в целом похую. Ну и сосоди под это дело на терабайтник неплохо, а то с жестаком медленноватые сохранения будут.

python: 3.10.6 • torch: 1.12.1+cu113 • xformers: 0.0.14.dev • gradio: 3.16.2 • commit: 20a59ab3

всё работает

python: 3.10.6 • torch: 1.12.1+cu113 • xformers: 0.0.14.dev • gradio: 3.15.0 • commit: ebfdd7ba • checkpoint: b2efd05125

Переустановка дополнения не помогла

гит пулл в батнике пропиши, пусть тебе ласт коммит заебенит

> пусть тебе ласт коммит заебенит

И наёбнет все остальное что пока работает

ну переустановишь то что отвалилось в чем проблема

Теперь вообще думать не надо, пик тоталли рилейтед

Думаю до 200к в перспективе. Но буду докупать по частям: сначала все за исключением видеокарты, потом ее

Благодарю. А что по процессорам?

Ладно.

Куда там это писать в батнике то?

Блядь, какая же охуенная вещь. Спасаёт ситуацию такому фэнтезилэту как я. Спасибо, анон.

Таки да, обновил gradio до 3.16.2 и заработало

Можно обновить только gradio как то отдельно от всего автоматика?

Да бери ченить на AM5 что в бюджет влазит, проц ваще не важен. Самое главное это карточка помощнее, память быстрая че там ддр5 упали в цене или нет еще? и сосоде.

Можешь в начале файла promptgen.js добавить строки и должно заработать

function randomId(){

return "task(" + Math.random().toString(36).slice(2, 7) + Math.random().toString(36).slice(2, 7) + Math.random().toString(36).slice(2, 7)+")"

}

Сосоди на 1ТБ под неироночку

Процессор значения не имеет

Памяти 32 гига

Видеокарту уже выше написали, но только ноувидео

Читал в процессорах для ИИ многопоток ценится сильно. Разве не так?

Тут у нас процессоры вообще не используются.

> сначала все за исключением видеокарты, потом ее

Надо наоборот лол

Для наших целей похуй

Чет слышал в соседнем треде, что однопоток для 4090 важен, типа не раскрывают ее топовые ам4-5 камни, до 20% не хватает по сравнению с топовыми штеудами. Проверить не могу, у самого днопека но вообще не загружен, пока видяха свои 350вт ест

А какие наши цели? Планирую текстовыми моделями заниматься

Из одной видеокарты компьютер не собрать. Что толку будет с нее без всего остального?

Ну у меня после переезда с 7700K на 12700KF скорость генерации существенно выросла

Да, заработало.

Спасибо, анон.

Таки обновление не понадобилось, но тоже спасибо.

>Планирую текстовыми моделями заниматься

Ну смотри реквайрментс для текстовых моделей тогда, коболды там всякие вот это всё.

У проца в лучше случае 6-16 ядер. У видеокарты их тысячи. Дальше думай сам.

А что тут думать? У нах назначение разное и они не заменяют друг-друга

Если бы обновил карточку на 4090 то вообще бы охуел от прироста скорости.

Мы про ИИ

Я в курсе

> Что толку будет с нее без всего остального?

вапроси?

Если выбирать под ИИ, упор надо делать на видеокарту и их количество - общее количество ядер и врам

Аноны, я о другом:

Компьютер без видеокарты на встройке > Видеокарта без всего остального компьютера

У меня буквально нет компьютера и я его собираю. Если я куплю видеокарту первой, мне ее некуда будет втыкать

Я чот нихуя вдуплить не могу, как фиксить CLIP через stable-diffusion-webui-model-toolkit. Через Hard way оно ломает его к хуям при попытке импорта в NEW SDv1

1. Загружаешь модель из которой будешь брать CLIP (например sd-1-5.ckpt)

2. В поле Class выбираешь CLIP-v1 и экспортируешь CLIP в файл (например sd-1-5-0000.clip.pt)

3. Жмешь Clear и Refresh

4. Загружаешь модель в которой будешь фиксить CLIP

5. Рядом с кнопкой Import выбираешь файл sd-1-5-0000.clip.pt, а в поле Class CLIP-v1

6. Жмешь Import, ждешь, потом выбираешь имя файла, Precision и жмешь Save

Во, теперь все понятно, мерси.

1. лоадишь модель с точно правильным клипом

2. достаешь клип через экспорт справа

3. лоадишь модель для фикса

4. в компонентах выбираешь пик1

5. в импорте выбираешь экспортированный клип, нажимаешь импорт (пик2)

6. жмешь сейв, ждешь

готово

у тя там бюджет 200к, тебе буквально хватит на 4090 + минимальную базу на будущий апгрейд

4090 160k

Корпус 15k

Мать 15k

Проц 30k

32gb RAM 7k

БП 10k

SSD нормальный nvme самс на 500gb 8k

Итого 245K

Без 4090 85К

Корпус 15k

Мать 15k

Проц 30k

32gb RAM 7k

БП 10k

SSD нормальный nvme самс на 500gb 8k

Итого 245K

Без 4090 85К

> Корпус 15k

Серьёзно?

>Проц 30k

Что это за проц такой?

Ну можно взять решето из фольги без кабель-менеждмента и нормальной продувки за 5к

НО ПОТОМ БУДЕШЬ ВСЮ ЖИЗНЬ ЖАЛЕТЬ

Ryzen 9/i7 12-13 поколения

> кабель-менеждмента

Переоцененная хрень.

> нормальной продувки

Чет я сомневаюсь, что у прямоугольного гроба за 100К и за 5К продувка прям дико разная все же от корпусных кульков зависеть будет. Или,видимо, в дорогих воздух на магических бафах?

>Чет я сомневаюсь, что у прямоугольного гроба за 100К и за 5К продувка прям дико разная все же от корпусных кульков зависеть будет

Аэродинамику никто не отменял

У прямоугольного гроба за 15к и 5к, разница в том, что в гроб за 5к 4090 может физически не влезть.

Ну и по темпрежиму разница может быть до 10 градусов под нагрузкой. Банально из-за разных воздушных потоков.

Про размер - это само собой, но это и так понятно.

Про температуру - видимо если сравнивать перфорированный со всех сторон гроб с старым офисным алюминиевым ящиком и только так?

Антонины, есть ли гайд по мержу моделей?

Листай тред

а где перекат на обычный тред с вайпом асками? или он закрылся окончательно и теперь сидим в техническом?

Два треда, один техноманьяки (ты тут) и один картинкогенераторы, это тут

Нет, тренировка лоры на миллиард шагов не спасает. Результаты на последних эпохах это пиздец конечно, даже кидать не буду. Зато нашел ну просто охуеннейшую шнягу – tensorboard. Позволяет смотреть логи тренировки в браузере.

Надо еще уметь их читать

Ну бля, лосс. Прогнозируемый результат минус полученный = лосс.

Но все же маловато графиков. Лосс по степам и эпохам это круто, но надо чтоб по каждой пикче свой график показывало, тогда вообще будет айс.

>лосс

Как же вы заебали. проиграл

Анонч позавчера брал реквест на Perseus, говорил на следующий день скинет. Не вижу ее по ссылке на Лоры. Как там дела обстоят? Или не получилось?

Вот только сейчас тещу эту сетку.

Просто реквесты столкнулись с моим желанием поэксперементировать с идеальными настройками для тренировки, но по утру я увидел что получилось какое-то говно, немного задизморален.

На пике отобраны имхо лучше эпохи, я не обкатывал еще особо, может она вообще не могёт в теги. 30 изображений в датасете.

Бля, какой же кал все существующие решения по подготовке датасетов, неужели нельзя захуярить ОДНУ мокропиську, в которой можно и теги с дипданбуру накидывать, и с вд 1.4, и копировать теги между файлами, и УДАЛЯТЬ/ДОБАВЛЯТЬ СУКА ФАЙЛЫ, и кропать с возможностью долить фон? Я так многого прошу блять?

В чем проблема? Swinir для апскейла + ИИ чтоб убирать фон

Слишком дохуя работы на одну из условных 50 картинок, не находишь?

Лучше ее на оранжмиксах и прочих псевдо 3д моделях не юзать. Я налажал, обучая 2д плоскую модель на псевдо 3д датасете.

https://mega.nz/folder/4so2lQJK#SAPABH3ycc42Z9FA2P763g

>pers, 1girl, pnik hair, long hair, breasts, nurse cap

В прилагаемом текстовике список всех тегов, на которых обучалось.

Если бы я умел кодить, уже давно бы запилил. планирую в питон вкатываться

Автоматизируй, напиши код для конвеера. Я так и сделал: ноутбук на Kaggle, чтоб скидывать необработанные пикчи. SwinIR + outpainting + remove background + clip

В чём суть SwinIR

Апскейл без хуйни. Пока что единственный.

Для чего он подходит? Аниме? Реал? Перешарпливает ли? Скорость работы?

Сейчас нет времени экспериментировать

Для всего. Шарпит чуток. Фотки превращает в пластмассу, т.к. не дорисовывает никаких деталей.

Спасибо

Не помогло(

Этот шаг обязательно через пипки делать?

Попробуй через выполнить cmd

cd c:\LoraCraft

.\venv\Scripts\activate

python -m pip --version

Что выдаст?

> LoraCraft

> LoraShrine

wut

У тебя права доступа на запись есть? Смотрю диск С. Вообще странная ошибка, первый раз сталкиваюсь

У тебя питон какой версии стоит?

Удали нахуй папку c:\LoraCraft\venv\

И попробуй заново

Пик1

Пик2

О-оо, начал торч качатся, спасибо!

Произошла спонтанная смена названия, без понятия почему он до сих пор иногда выдает старое.

Да, до этого pw даже среду не хотел запускать, гуглил как дать разрешение. Запускаю всегда от администратора.

И питон, и pw все новые, буквально сегодняшние. Если не начнут качаться и остальные файлы попробую.

Пик2

О-оо, начал торч качатся, спасибо!

Произошла спонтанная смена названия, без понятия почему он до сих пор иногда выдает старое.

Да, до этого pw даже среду не хотел запускать, гуглил как дать разрешение. Запускаю всегда от администратора.

И питон, и pw все новые, буквально сегодняшние. Если не начнут качаться и остальные файлы попробую.

Питонщики как чекать тензоры в клипе я заебался гуглить

>О-оо, начал торч качатся, спасибо!

Интересно как такое возможно

У тебя пути в venv проёбаны

Притягиваешь результат под желаемое. При чем тут вообще тени и почему по такому запросу не может быть киборга?

Утверждается, что сломанные тензоры хуже чувствительны к промту, вот такие примеры и ищи.

так тебе ж по русски показали, что пофикшенное более точное к промту ты чё алё дядя какая киборгесса когда нуд вуман отдельный чанк

>почему по такому запросу не может быть киборга?

>литералли nude woman

>почему

Действительно.

>литералли nude woman

>почему

Действительно.

А "киберпанк" это что, по-твоему? Что-то, что не влияет на персонажей?

Если бы пикчи высрались наоборот, ты бы заявил, родные тензоры ебнулись и рисуют какую-то голую шалаву вместо кибердевы.

>А "киберпанк" это что, по-твоему? Что-то, что не влияет на персонажей?

Ты сначала изучи что делает оператор | между чанками.

>Если бы пикчи высрались наоборот, ты бы заявил, родные тензоры ебнулись и рисуют какую-то голую шалаву вместо кибердевы.

Такого бы не было, просто потому что пофикшенный хасан четенко читает чанки, вместо объебанной говнины изначально, которая скорее всего дало киберсреньк деву потому что из-за дисторсий не уловило оператор | и пернуло в лицо кибердевой сплошняком.

Кстати, иди на хуй.

Пик1 пофикшенный хуйсосан просто добавляем киборг тег: masterpiece photo | nude cyborg woman | cyberpunk

Пик2 говнохуйсосан с кривотензорами пытаемся убрать киборгессу и отсасываем по фону: masterpiece photo | nude woman | [[cyberpunk]]

Ты нихуя не показал эти тенсоры на хассане, ты вообще нихуя не показал, ты не можешь ответить на потому что сам нихуя не умеешь, так не строй из себя тут Морфеуса. Пример этот на хассане смехотворный. Но что поделать, если это венец твоих технических достижений, для самоуспокоения хватит.

Заебись примеры пошли на разных промтах. И что ты этим доказал? Баба с убавлением тега тоже стала менее киберпанкрута.

Делайте нормальные гриды, которые покажут именно проебанные элементы, а не трактованные иначе. Или хотя бы не выебывайтесь так яростно, знатоки хуевы.

Любитель кривых тензоров спок.

>трактованные иначе

>не ну непопадание в промпт это не баг это фича понимать надо

>Заебись примеры пошли на разных промтах. И что ты этим доказал?

Давай поясню для тупых. У нас есть промтец masterpiece photo | nude woman | cyberpunk с одинаковым сидом. Хасан с говной вместо тензоров рисует киборга, хасан с норм тензорами рисует бабу в киберпанке. Казалось бы все довольны, но нет: если мне нужна именно баба на хасане, а не киборг, то как сетке уменьшить влияение киборга если чанк между смешивателями не содержит киборга? А никак.

Контрпример: как получить киборга, если мне нужен киборг на не хасане? Добавить тег в чанк с голой бабой. Все же логично и очевидно. Очевидно, что фикшенный хасан более гибок и точен. Теперь понятно?

Можно было бы сотню примеров накидать, но ты похоже хасан и тебе неприятно.

Продолжаем унижения кривотензорщиков.

Пример номер 2. Использование оператора AND.

Пик1 - дефолт хасан с говнотензорами, промт nude woman AND cyberpunk, сид фикс.

Пик2 - фиксед хасан, тот же промт, сид фикс.

Нуфф, как говорится, саид.

Пример номер 2. Использование оператора AND.

Пик1 - дефолт хасан с говнотензорами, промт nude woman AND cyberpunk, сид фикс.

Пик2 - фиксед хасан, тот же промт, сид фикс.

Нуфф, как говорится, саид.

Как ты определяешь кривые для начала? Когда другой результат дает? Ну вот разный результат на разном клипе, какие тензоры кривые? А smile и там и там не очень.

>НОВЫЙ МИР ОХУИТЕЛЬНЫХ РЕЗУЛЬТАТОВ БОЛЬШЕ НИКАКИХ СКОБОК

>пук среньк ну вот же баба не такая как я хотел(((

> если мне нужна именно баба на хасане, а не киборг

Киборга в негативы и роллишь. Я вот сейчас на фикшенном хассане погенерил, часть пикч вышла без намеков на киберпанк в принципе. А на непофикшенном хассане генерит тех же голых баб, которых ты считаешь идеалом.

Короче, черрипикнул на 1 сиде и подводишь под это целую теорию.

Я поднял тестовый инстанс файлопомойки для лор.

Лимит на файл сейчас 200 мегабайт