>а основной выход изображения через встройку.

Где-то с десятки всё пофиксили, и достаточно просто воткнуть кабель, а выбор видяхи для запуска ПО осуществляется в местной панели управления, что позволяет даже играть без проблем.

>дружбы с серверным оборудованием

Это просто тот же десктоп, просто с немного другими чипсетами. Если не брать двухпроцессорные конфигурации, проблем не будет вообще.

>если количество потоков на проце не решает для llm

Ваще похую на потоки.

>взять 20 слой и напичкать его более большим количеством экспертов

>купил б/у ASUS x99-E WS

Моё уважение

владелец простой ASUS x99-E, который безработный и которому лень брать P40, потому что в первый раз заказ отменили

> можем например взять 20 слой и напичкать его более большим количеством экспертов

Профит с этого какой?

О, кайф, наконец можно будет ясность внести. Сэмулировать х4 шину можно будет просто выставив в биосе ограничение на 1-е поколение протокола, чтобы не сравнивать данные на разном железе.

> и достаточно просто воткнуть кабель

Какой кабель? И куда пихать кабель с теслу?

> тот же десктоп, просто с немного другими чипсетами

Под шинду на теслы-квадры и прочее отдельные драйвера, и они могут конфликтовать друг с другом и требовать вмешательства. Под линукс просто добавляешь репу нвидии и apt install cuda вне зависимости от того что у тебя там.

> →

>>взять 20 слой и напичкать его более большим количеством экспертов

Цитату не забыл, ответ забыл. Нахуя? А главное зачем. Интересно конечно, но звучит по-наркомански.

>Какой кабель?

VGA любой видео.

>куда пихать кабель с теслу

Его нет...

>и они могут конфликтовать друг с другом и требовать вмешательства

Рецепты исправления давно известны.

>Цитату не забыл, ответ забыл. Нахуя? А главное зачем. Интересно конечно, но звучит по-наркомански.

Разумеется сделать сетку умнее и заставить людей покупать новые GPU

Опубликован инструментарий ZLUDA, позволяющий запускать CUDA-приложения на GPU AMD

https://www.opennet.ru/opennews/art.shtml?num=60591

https://www.opennet.ru/opennews/art.shtml?num=60591

> х4 шину

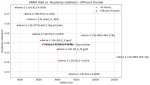

Пересадил 4090 из х16 5.0 в х4 4.0 - ни в угабуге, ни в автоматике изменений нет.

Еле-еле быстрее, не особо впечатляет.

На шинде запустится? Уже бежать за 2х7900хтх?

Так рокм быстрее ж будет, это для страдальцев вариант. И то, неясно, может вулкан быстрее будет ещё.

Поясните нубу, если 120b мутанты такие охуенные, чому их не делают еще больше? Дело только в железе?

Чего-чего? Chat With RTX: собственный чат-бот для ПК с искусственным интеллектом NVIDIA RTX

Техническая демонстрация дает любому, у кого есть графический процессор RTX, возможность персонализированного чат-бота GPT.

Chat with RTX, который теперь можно загрузить бесплатно, представляет собой технологическую демонстрацию, которая позволяет пользователям персонализировать чат-бота с использованием собственного контента, ускоренного локальным графическим процессором NVIDIA GeForce RTX серии 30 или выше и оснащенным как минимум 8 ГБ видеопамяти с произвольным доступом или видеопамятью.

Чат с RTX использует генерацию с расширенным поиском (RAG), программное обеспечение NVIDIA TensorRT-LLM и ускорение NVIDIA RTX для реализации возможностей генеративного искусственного интеллекта на локальных ПК с ОС Windows под управлением GeForce. Пользователи могут быстро и легко подключать локальные файлы на ПК в виде набора данных к большой языковой модели с открытым исходным кодом, такой как Mistral или Llama 2, позволяя выполнять запросы для получения быстрых, контекстуально релевантных ответов.

Вместо поиска по заметкам или сохраненному контенту пользователи могут просто вводить запросы. Например, можно спросить: «Какой ресторан порекомендовал мой партнер, когда он был в Лас-Вегасе?» а Chat с RTX просканирует локальные файлы, на которые указывает пользователь, и предоставит ответ с контекстом.

Инструмент поддерживает различные форматы файлов, включая .txt, .pdf, .doc/.docx и .xml. Укажите приложению папку, содержащую эти файлы, и инструмент загрузит их в свою библиотеку за считанные секунды.

https://blogs.nvidia.com/blog/chat-with-rtx-available-now/

Техническая демонстрация дает любому, у кого есть графический процессор RTX, возможность персонализированного чат-бота GPT.

Chat with RTX, который теперь можно загрузить бесплатно, представляет собой технологическую демонстрацию, которая позволяет пользователям персонализировать чат-бота с использованием собственного контента, ускоренного локальным графическим процессором NVIDIA GeForce RTX серии 30 или выше и оснащенным как минимум 8 ГБ видеопамяти с произвольным доступом или видеопамятью.

Чат с RTX использует генерацию с расширенным поиском (RAG), программное обеспечение NVIDIA TensorRT-LLM и ускорение NVIDIA RTX для реализации возможностей генеративного искусственного интеллекта на локальных ПК с ОС Windows под управлением GeForce. Пользователи могут быстро и легко подключать локальные файлы на ПК в виде набора данных к большой языковой модели с открытым исходным кодом, такой как Mistral или Llama 2, позволяя выполнять запросы для получения быстрых, контекстуально релевантных ответов.

Вместо поиска по заметкам или сохраненному контенту пользователи могут просто вводить запросы. Например, можно спросить: «Какой ресторан порекомендовал мой партнер, когда он был в Лас-Вегасе?» а Chat с RTX просканирует локальные файлы, на которые указывает пользователь, и предоставит ответ с контекстом.

Инструмент поддерживает различные форматы файлов, включая .txt, .pdf, .doc/.docx и .xml. Укажите приложению папку, содержащую эти файлы, и инструмент загрузит их в свою библиотеку за считанные секунды.

https://blogs.nvidia.com/blog/chat-with-rtx-available-now/

> и инструмент загрузит их в

библиотеку хуанга

Китайцы с их 1,08 )))

> кобольдццп фронт и таверна в виде бэкэнда

Звучит наоборот.

> Стоит качать угубугу? Далее подрубить её к exllama2?

Убабуга и содержит экслламу.

Подрубаешь ты все к таверне.

7B модельки, тебе ответили.

Mistral, openchat, что-то там рпшное, не знаю.

Ты или тролль, или не читаешь, что тебе пишут, или глупенький.

Звучит как да.

Ну, тебе линии PCIe не нужны, чисто залить модель туда, а там она сама будет крутиться.

Но вот заведется ли такой бокс с Теслой на ноуте — фиг знает.

Это база.

Ну-у-у… Скорее 7-10… Но в общем, если добирать ссд, бп и корпус, то да, цена дотянется.

Но тут выбор — оно стоит и работает само, или только от ноута.

Я заебался с выводом биоса, в итоге просто взял 11400 с материнкой новые (какие в днсе местном лежали), ради гарантии и все.

Ну и ради 2 слотов PCIe, да.

А как насчет БАСТИОНА, и вообще удобно по RDP по всему дому лазить. =) Подсел.

Хотя лучше VPN на роутере, наверное.

На оперативе можно поднять доп.модельку.

Я вот взял 3600 планки (2*32) и Микстраль иногда 3,5 т/с выдает чисто на проце.

А я уже умею, поэтому похуй на линуху.

Ну я выше кидал способ, который сработал лично у меня, пердолинг там не страшный, вопрос пяти минут.

Но у кого-то он не сработал.

Ну ты силен!

Но я все еще не уверен в пользователях. =)

Но — успехов!

> Какой кабель? И куда пихать кабель с теслу?

Который ты пихаешь в ноутбук. Во встройку.

Да че-б им быть.

Проверять надо на 2-3-4 картах, а на одной их и не будет.

Даже на 2 будет почти незаметно, интересны 3+

И не PCIe 4.0 x4, а хотя бы PCIe 3.0 x4, а лучше x1 и версии ниже.

Че там, ExLlama или Жора по итогу?

Ладно, качаем, проверяем.

Я так и не поставил ни лэнгчейн, ни лламаиндекс, мне эту вашу RAG охота потрогать.

Ну и заодно узнать, какие форматы поддерживает и работает ли с теслой.

Еба 35 гигов, отмена нахуй.

Интернет седня хуевый, блин, еще. =( 128 кб/сек, че за нах.

>Че там, ExLlama или Жора по итогу?

Для этого качать не надо.

>This repository showcases a Retrieval-augmented Generation (RAG) pipeline implemented using the llama_index library for Windows. The pipeline incorporates the LLaMa 2 13B model, TensorRT-LLM, and the FAISS vector search library. For demonstration, the dataset consists of thirty recent articles sourced from NVIDIA Geforce News.

Говоря по опыту, TRT достаточно быстрая штука, так что возможно оно стоит того. Плюс сам rag, звучит вкусно.

Их реально долго и пока дорого учить.

Получается, лламаиндекс без ебли, на трт, которая шустрая?

Звучит хорошо.

Впрочем, важно, насколько это будет удобно, по итогу. Они выступают в роли догоняющих, но нацелены на потребительский рынок, а не на красноглазиков. Вопросов к скорости их нет — там всегда гении сидят, а вот насколько это будет удобно… Посмотрим. (уже через 5 дней, скорость упала хд )

>без ебли

Размечтался.

по любому хуита со встроенным фильтром

А где скорость? У всех так медленно качает? С другими файлами ок.

>иконки от винрар

Всё дело в нём, удаляй.

Сейм. Под клаудфларовской проксей сильно выше но в ее ограничения, похоже, упирается.

Всем хай. не понимаю из-за чего ошибка. Было у кого такое?

4090.

4090.

Int4, серьезно?..

Кто-нибудь использует vLLM?

https://github.com/vllm-project/vllm

Exploring the fastest open source LLM for inferencing and serving | VLLM

https://www.youtube.com/watch?v=rng-3NOmZ9k

Вроде поддержка CPU-only в каком-то виде уже есть: https://github.com/vllm-project/vllm/pull/1028

Ну, думаю, ебать, хорни нейронка вчера не дала - так мы сами возьмём. Загнул её раком, значит, а ей в самый раз, не сопротивляется и типа как-то вся в предвкушении. Сначала даже скучно стало, но потом

>she wraps her legs around his waist, pulling him closer still

>she wraps her legs around his waist, pulling him closer still

>нацелены на потребительский рынок, а не на красноглазиков. Вопросов к скорости их нет — там всегда гении сидят, а вот насколько это будет удобно… Посмотрим

Посмотрел. 38 гигов для установки. Там мистраль int4, лламы нет. Так оно еще и качает снова при установке. Наверно еще 38 или 138... Убабугу за то же время можно 10 раз снести-поставить и еще моделей накачать успеешь. Вот это красноглазики. А у клиентоориентированных надо скачать гору хуйни размером в лламу 70b а внутри хуй мистраль простой еще и в 4-х битах тогда как он же в fp16 вроде 13-14 гигов всего. Если больше 2-х часов будет устанавливаться то лучше продолжу поделия от пердолей жрать

>лламы нет

Хотя посмотрел, есть. Но к установке почему то не предлагается.

Аноны, какая самая годная языковая модель будет для моей системы?

32гига оперативки

rtx3060ti 8gb

i7 8700 проц

32гига оперативки

rtx3060ti 8gb

i7 8700 проц

Меня больше это интересует https://huggingface.co/nvidia/nemotron-3-8b-base-4k что это за зверь такой.

> больше 2-х часов будет устанавливаться

Меньше однако. Но не тут то было - при запуске, это снова начинает качать! И закрадывается подозрение: А не будет ли оно на каждый промт обязательно скачивать что-нибудь? :D

Я вижу ты тут новенький.

12-ядерный 24-поточный процессор, NVMe 4.0 (7000 чтение, 6400 запись), 100 мб интернет, время установки: 30 минут.

Та же мысль посетила, что за это время убабуга несколько раз поставиться успевает.

Удивительная хуйня, если честно.

Плюсую.

Утро началось с реинсталлов.

Еще винда решила под конец плюнуть на все и ребутнуть систему ради обновы, наплевав на установку.

Но те всегда конченные были, что с них взять.

Вообще на похуй скачал ещё вечером, установку так и не запустил и не запущу, наверное, тупо удалю к хуям, лол. Поебать, сколько оно там ставится.

Олсо, здесь нужно помнить, что по всем стандартам наименования int4 это четырёхбайтный инт, то есть двое больше информации, чем fp16.

Окей, давайте забьем на скорость и качество. Будем честны, Мистраль на RTX-картах всегда работает быстро. Особой разницы 25 токенов или 25000 токенов в секунду и нет. У меня заняло 6 гигов, может быть в 4-6 битах грузится, но на английском-то норм.

Не суть.

1. Долгая установка.

2. Невозможность изменить промпт с фронта.

3. Работа только с английским языком. Нет, допроситься русский у нее можно, но RAG работает только с английским, русские текстовые файлы он игнорит.

Как результат, мы получили простое поделие на градио, которое может показать только дефолтные демо-возможности. Да, для работы с англоязычными текстами, очевидно, норм, удобно, из коробки. Но на этом задачи приложухи заканчиваются.

Революции не случилось.

Не суть.

1. Долгая установка.

2. Невозможность изменить промпт с фронта.

3. Работа только с английским языком. Нет, допроситься русский у нее можно, но RAG работает только с английским, русские текстовые файлы он игнорит.

Как результат, мы получили простое поделие на градио, которое может показать только дефолтные демо-возможности. Да, для работы с англоязычными текстами, очевидно, норм, удобно, из коробки. Но на этом задачи приложухи заканчиваются.

Революции не случилось.

>работает только с английским, русские текстовые файлы он игнорит.

Проверял на русских pdfках. Оно работает с русским. В целом приемлемо для мистраля.

В остальном все так и есть - демка ни о чем. Вообще ожидал от такого анонса нвидиа чего-то более поразительного. А это какой-то недобуга.

Русские txt игнорирует начисто.

Говорит «я порылся в этом файле и ничего не нашел».

Спрашивал как на русском, так и на английском, и на смеси.

Ваще по нулям.

Если у них там еще и с кодировкой косяк — это вообще ебанный стыд, конечно.

Файнтюны мистральки, может быть что-то на 13б.

Какую скорость оно вообще выдает? Если это опенсорц то стоит ждать успешные элементы в той же убабуге или альтернативах.

там в пендосском /lmg/ всё стабильно, никакой политики, даже если модели которые они юзают - тупо пропитаны соей и прочим дерьмом.

как говорил один мудрец "ну тупыые!"

как говорил один мудрец "ну тупыые!"

И так нахуй, оно почти готово. Осталось только прикрутить загрузку весов с huggingface и proof of concept готов.

В консольки у меня не писали, визуально не супербыструю, обычную.

Тыщу раз, хейтеры убабуги и кобольда любят рассказать за охуенность сабжа. Аргументов пока не было.

Микстраль/34б всякие.

Что с Блоком?

>Что с Блоком?

-заболел?

-грант кончился, нечем платить за аренду йоба-железа для квантов?

-попал в дтп?

-выгорел на работе хобби?

-?

Может быть были новости?

> Аргументов пока не было.

Ну ты посмотри какая красивая тема интерфейса. А еще ставится привычно и удобно, скачиваешь установщик уже можно обзмеиться, выбираешь куда и все готово. А еще он может использовать тот же бек что и у остальных, правда его настройки запрятаны.

У них вроде дискорд был, можешь зайти и посмотреть что там пишут.

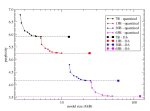

https://www.reddit.com/r/LocalLLaMA/comments/1apvbx5/

Можете поинтересоваться сколько там quadro 8000 выдает т/с, всетаки самая дешевая карточка с 48гб (пока). Там же в комментах у братишки риг из пачки 2080ти@22gb, правда цена на последние что назвал как-то совсем не вдохновлет.

Можете поинтересоваться сколько там quadro 8000 выдает т/с, всетаки самая дешевая карточка с 48гб (пока). Там же в комментах у братишки риг из пачки 2080ти@22gb, правда цена на последние что назвал как-то совсем не вдохновлет.

Ха-ха, глупый уйгур покупать на 350 жэньминьби дороже, чем можно найти за 10 секунд.

https://www.taobao.com/list/item/701817321124.htm

>Какую скорость оно вообще выдает?

Только если на глаз прикинуть. Где-то от 30 т/с и выше точно (это уж усмотря какая карта). Оно и понятно - модель небольшая и целиком во врам.

Вобщем штуковина монструозного размера относительно запускаемой модели и интересна только из-за RAG, но слишком качественного результата врядли можно ждать - мистраль все же маловат, хотя он и мистраль. Проверено на ру пдффках - книгах, статьях. Причем натолкать ей можно сразу кучу книг, указав каталог с пдфками.

1 В отдельных моделях есть, они нахуй никому не нужны, в приличных ее нет.

2 Можно обучить свою, но это настолько сложно что ты не захочешь.

3 Можно, прикрутить интернет или базу данных можно, но не для ньюфага.

4-5 Читай шапку и вики

Тут или юзерфрендли в ущерб возможностям и функционалу, или потратить 15 минут на чтение и разбор что к чему, и сразу все понятно.

Чето на некоторые простые запросы оно выдает хуже чем если чистого мистральку спросить из его знаний, даже дополнительно нагрузив отыгрышем персонажа и постоянно отвлекая другими действиями, которые с радостью выполняет не теряясь. Может дело в кванте, или оно нормально документы не восприняло, надо разбираться.

Посаны, мне нужно впилить бота в локальный телеграм-чатик, чтобы с этой стороны была запущена нейросетка и срала туда ответами. Через что это можно сделать?

Ресурсов неоч много, но с самими сетками я как-нибудь разберусь - мне бы узнать какие инструменты для этого пользовать, через что запускать нейросетку локально и как пробросить ее в тележного бота. Хост на шиндус, но если поднапрягусь то могу и на прыщах развернуть.

Ещеб было неплохо чтобы она рандомно генерировала какие-нибудь сообщения просто так время от времени.

Ресурсов неоч много, но с самими сетками я как-нибудь разберусь - мне бы узнать какие инструменты для этого пользовать, через что запускать нейросетку локально и как пробросить ее в тележного бота. Хост на шиндус, но если поднапрягусь то могу и на прыщах развернуть.

Ещеб было неплохо чтобы она рандомно генерировала какие-нибудь сообщения просто так время от времени.

Со стороны бота смотри telegram bot api. Есл хочешь обертку, то для питона есть telethon, для яваскрипта telegraf, оба норм.

Со стороны ллм кури https://github.com/oobabooga/text-generation-webui/wiki/12-%E2%80%90-OpenAI-API модель крути на ней же.

>рандомно генерировала какие-нибудь

Поставишь рандомный таймер с вызовом "скажи чо-нить рандомное".

>oobabooga

Как этому утырку вообще пришло в голову назвать свой софт, претендующий на

>Its goal is to become the AUTOMATIC1111/stable-diffusion-webui

таким уебанским, не гуглящимся, не запоминающимся именем? Абсолютный дегенерат.

И да, блядь, почему в 2024 веке настроить связность двух приложений это настолько невероятно сложная задача? Приложение открывает API, другое его подцепляет КАК В ЭТОЙ СВЯЗКЕ МОЖЕТ ЧТО-ТО НЕ РАБОТАТЬ. СУКИ БЛЯДСКЕИЕ ТЬУПЫЕ ПИДОРАСЫ ГОВАНОМААКИ НГИХУЯ НАПИСАТЬ НОРМАЛЬНО НЕ МОГУТ ЗАЕБАЛИ БЛЯДИ

Как этому утырку вообще пришло в голову назвать свой софт, претендующий на

>Its goal is to become the AUTOMATIC1111/stable-diffusion-webui

таким уебанским, не гуглящимся, не запоминающимся именем? Абсолютный дегенерат.

И да, блядь, почему в 2024 веке настроить связность двух приложений это настолько невероятно сложная задача? Приложение открывает API, другое его подцепляет КАК В ЭТОЙ СВЯЗКЕ МОЖЕТ ЧТО-ТО НЕ РАБОТАТЬ. СУКИ БЛЯДСКЕИЕ ТЬУПЫЕ ПИДОРАСЫ ГОВАНОМААКИ НГИХУЯ НАПИСАТЬ НОРМАЛЬНО НЕ МОГУТ ЗАЕБАЛИ БЛЯДИ

Можно просто поднять убабугу и https://github.com/innightwolfsleep/text-generation-webui-telegram_bot

Можно самому на питончике набросать скрипт, а в качестве бэкенда — ту же убабугу, или сразу llama.cpp или exllama2 (ну вдруг).

Все довольно просто, если умеешь прогать более-менее.

> Поставишь рандомный таймер с вызовом "скажи чо-нить рандомное".

+

Да, кстати, я вчера таверну открывал, она обосралась хз почему, мне было лень разбираться.

Убабуга максимально запоминающееся название, я хз, у тебя проблемы с головой, сочувствую.

CMD_FLAGS.txt

--api --public-api

>печальные сантименты

Таков ворлд оф питон в целом

Там какое то легаси апи тоже какая то проблема была я уже забыл.

Опен сорс без денег. Не выебывайся.

Это не повод придерживать критику и эмоции, особенно вызванные тупой хуитой.

Он же не просит вернуть ему деньги.

В голосину, сделал мой вечер!

Чтобы вешать подобные ярлыки, нужно самому не быть ультрадолбоебом, который пытается коннектится на 0.0.0.0

> --public-api

Оу май

Чего? Эта херня не работала пока я не добавил паблик апи по совету из ишшуе треда где-то на пятой странице.

>0.0.0.0

Может и получиться, судя по интернетам

> Эта херня не работала пока я не добавил паблик апи

Ты захостил свой апи всем желающим кто решит посмотреть что там нынче на фри клаудфларе. Вероятность мала, но есть. Это никак не связано с работой апи, если хочешь подключаться с другой пекарни - нужен параметр --listen, чтобы прослушивало что-то кроме локалхоста.

> Может и получиться, судя по интернетам

Это значит что идет ожидание соединения по указанному порту со всех возможных ардесов-интерфейсов. Там даже в экзамплах написано и вроде максимально очевидно что нужно писать для соединения.

> Убабуга максимально запоминающееся название, я хз, у тебя проблемы с головой, сочувствую.

Кал ебаный, а не название, не пизди.

>--api

Как тебе вообще в голову пришло, что я это мог не попробовать? Думаешь это не стоит у меня прямо сейчас в CMD_FLAGS.txt? ТЫ СКРИНШОТ ВИДЕЛ ВООБЩЕ?!

> --public-api

Хочешь, чтобы мне анус взломали?

>Таков ворлд оф питон в целом

Я в ахуе. Что со сваперами ебля без внятной документации, без бинарников под ROCM, без внятной пошаговой инструкции, что куда. что тут опять кал. Вечная нервотрепка.

Один только автоматик оставил положительное впечатление - завелся с полпинка с подробнейшей документацией, сразу видно Человек писал софт.

Да я их все перепробовал, один хуй.

>пытается коннектится на 0.0.0.0

Славно, хотел доебаться до меня, а в итоге насрал себе в штаны с умным видом.

Я И УСТАНОВИЛ ПРОСЛУШКУ С

>0.0.0.0

ПРИЧЕМ ЭТО ПРЕКРАСНО ВИДНО НА СКРИНШОТЕ

МОЖЕТЕ ТЕБЕ ЕЩЕ ОБЪЯСНИТЬ ЗАЧЕМ ЭТО НУЖНО В ПРИНЦИПЕ, ТУПОРЫЙ УЁБОК?!

Накатил короче SilliTavern, там всё подхватилось. СЛЫШАЛ УЁБИЩЕ? ПОДХВАТИЛОСЬ С 0.0.0.0 ОЙ А КАК ЖЕ ЭТО ТАК, МАГИЯ НАВЕРНОЕ

Интерфейс тут конеш по мобилке плачет

За мат извените, жосско фрустрируюсь после взаимодействия с этим говно софтом всем.

Подскажите ньюфагу моменты:

1. Есть ли цензура и подобные ограничения?

2. Можно общаться только с готовыми модельками которые скачаю или есть возможность обучить свою?

3. Можно спрашивать что-то для поиска или обучения? Может ли искать инфу в инете?

4. Что за таверна?

5. Подскажите какие модели могут подойти под систему: AMD Ryzen 3 Pro 3200G, 16 gb оперативки, RTX 4060 Ti и/или как в дальнейшем понимать/искать пойдут ли они мне?

Я понимаю, ты порвался, но в чем конкретно обосрался Я, если одни и те же параметры в TavernAI просто не работают, а в SilliTavern просто работают? Где тут ошибка с МОЕЙ стороны?

Ответ можешь засунуть себе в очко - надо было раньше думать, прежде чем писать хуйню. Да я слил сюда свою фрустрацию, но ответил хуйней мне именно ты, а мог бы промолчать. Так что сиди и думай о своём поведении. А я пока пошёл разбираться, почему модель выдает односложные ответы, вместо развернутых.

> вы все порвались я а нет но почему у меня не работает!

ай лол

> одни и те же параметры в TavernAI просто не работают, а в SilliTavern просто работают

Тебе уже объяснили исходную причину. То что в силли уже успели наставить заглушки от выребухов - никак не оправдывает твоих фейлов, было бы рофлово получить следующим ходом нытье "почему браузер не открывает 0.0.0.0:8000" лол и ведь такой случай не единичен https://github.com/SillyTavern/SillyTavern/issues/1368

И зачем вообще использовать легаси таверну при наличии силли?

> Так что сиди и думай о своём поведении

Или что? Опять напишешь пасту с визгами? Наоборот это доставит удовольствие, вперед.

> Да я слил сюда свою фрустрацию, но ответил хуйней мне именно ты, а мог бы промолчать

Бля, ты рили с расстройствами? Делал бы в конце припуску что просто сгорел и не воспринимать всерьез, или просто бы поныл что нихуя не получается помогите, сразу бы получил совет и утешения. А когда начинаешь с

> вы все долбоебы а я Д'артаньян, нука быстро чините и делайте чтобы у меня работало

иного ответа и не стоит ждать.

> было бы рофлово получить следующим ходом нытье "почему браузер не открывает 0.0.0.0:8000

Было бы еще рофлянее узнать, что он всё открывает.

Или ты, еблан, инкриминируешь мне, что я ссылку на API буду в браузере открывать?

Что ты несешь вообще, ты сам понимаешь-то, собака сумасшедшая?

>И зачем вообще использовать легаси таверну при наличии силли?

Затем, что именно она первая указана в ШАПКЕ для НОВИЧКОВ, а я новичок? Что, блядь, я и за вашу шапку ответственен теперь?

>вы все долбоебы а я Д'артаньян, нука быстро чините и делайте чтобы у меня работало

Ссылку на мой пост, что я кого-то итт ПРОШУ чинить. Я на двач прихожу просто посетовать на то какое всё говно и пидоры, потом засучиваю рукава и фикшу всё сам.

Достаточно просто просмотреть на ответы, которые я тут получил - ты и тебе подобные это просто человеческий мусор с абсолютно нулевым пониманием матчасти и магическим мышлением. Какое нахуй просить помощи у вас, вы и сами себе помочь не в состоянии, насмешил бля.

Анон у тебя какое то неадекватное отношение к опенсорс софту. Блядь ну конечно все в говне и "работает на моей машине" че ты еще хотел то?

Шапка у нас тоже опенсорс и ясен хрен с лютой скоростью развития сетей быстро устаревает.

мимо

>Ты захостил свой апи всем желающим

Ну вот так заебись насоветовали значит мне, я ж не сам придумал.

> Было бы еще рофлянее узнать, что он всё открывает.

Значит заглушки от долбоебов стоят и там, или ты сам добавил редирект чтобы оправдаться.

Еблан здесь только ты, страдай, полыхай со всего и мучайся, это твой удел.

> она первая указана в ШАПКЕ для НОВИЧКОВ

Единственная из ссылок - на силлитаверну, опять пытаешься выставишь других виноватым в своей глупости.

> Я на двач прихожу просто посетовать на то какое всё говно и пидоры, потом засучиваю рукава и фикшу всё сам

Опять обзмеился с мамкиного фиксера. Раз таким промышняешь - значит без аутотренинга даже сам себя мусором считаешь. Подсознание оно помнее будет, его так просто не обманешь.

>Есть ли цензура и подобные ограничения?

Есть файнтюны без цензуры (на самом деле с "затертой" цензурой, т.к. сами по себе предобученные модели с цензурой и файнтюном выкорчевать ее нельзя, разве что "заигнорить" более менее) А что именно надо от модели без цензуры? Письки жопы и хуи или гои иудеи и жиды? Первое легко анцензорится а вот второе... это вообще нельзя даже обдумывать

>Можно общаться только с готовыми модельками которые скачаю или есть возможность обучить свою?

Свою можно. Как - об этом много где расписано

> Можно спрашивать что-то для поиска или обучения? Может ли искать инфу в инете?

Локалки нет, гопота или клод могут

> Что за таверна?

Это UI для РП или ЕРП

>Подскажите какие модели могут подойти под систему: AMD Ryzen 3 Pro 3200G, 16 gb оперативки, RTX 4060 Ti и/или как в дальнейшем понимать/искать пойдут ли они мне?

Любые до 13b включительно с квантованием и выгрузкой части в рам.

Смотрите по размеру и подбираете кванты чтобы влазило в память врам и рам, плюс место под контекст, а хотя 7b gptq или gguf влезут полностью в 4060

>Это значит что идет ожидание соединения по указанному порту со всех возможных ардесов-интерфейсов

>ожидание соединения

Да, в случае bind() + listen().

В случае connect() пишут что на ляликсе заменяется на 127.0.0.1. В винде похоже не заменяется и никуда не ведет.

Если щас пикчи прилипнут, то это не я

С цензурой сложно из-за ее разных трактовок. Некоторые модели изначально не цензурены сами по себе. В любом случае, заставить модель писать про оргии, резню трансонигр-феминаци и je.. - можно.

> Любые до 13b включительно с квантованием и выгрузкой части в рам.

Версию видюхи он не указал, если вдруг там на 16гб то сможет и 20б. Но скорее всего 8 и все именно как написал.

> на ляликсе заменяется на 127.0.0.1

Действительно. Тогда вдвойне удивительно что линуксоид такие ошибки делает и с опенсорса горит. Кстати ни разу не встречал чтобы в сонсоле там писало нули, просто хостнейм вместо локалхоста.

и где пикчи?

Я сначал высирать скрины, что без паблик апи не работает, но оказалось, что работает. Харкач просто раньше любил оставлять удаленные из поста пикчи. А таверна не подключаться без паблик апи.

Вообще касательно листена считаю, что надо писать либо пикрил, либо форматировать как "listening on * port 5000". Не все же в курсе, что это не адрес, а спец.значение для бинда.

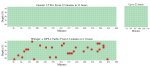

Анон, как объяснить нейронке, что у нас есть API? Требуется генерить кучу однотипных кусков кода, вот буквально превратить нечто вроде "при стоимости транспортировки 5 рублей за км за транспортировку на 600 км необходимо заплатить 3000 рублей" в

'при стоимости транспортировки ' + numer(unitPrice, 'рубль') +' за км за транспортировку на ' + dist + ' км необходимо заплатить ' + numer(price, 'рубль')

Но такой хреноты дохрена. Гопота может такое делать или ещë сложновато? Как правильно объяснять, что

функция numer уже есть, еë не нужно сочинять - а вот применять, наоборот, нужно.

'при стоимости транспортировки ' + numer(unitPrice, 'рубль') +' за км за транспортировку на ' + dist + ' км необходимо заплатить ' + numer(price, 'рубль')

Но такой хреноты дохрена. Гопота может такое делать или ещë сложновато? Как правильно объяснять, что

функция numer уже есть, еë не нужно сочинять - а вот применять, наоборот, нужно.

На пикче mixtral-8x7b-instruct-v0.1.Q4_K_M.gguf

Отсюда начинай, дописывай промт, пока не получишь нужное.

Про гопоту не знаю, но.. да сможет уж.

Hi, I want you to help me generate a bunch of similar code chunks. Like this source text: "with transportation cost of 5 yuan per kilometer, the transporation to 600 km will cost 3000 yuan" must be converted into this target expression: "'with transportation cost of ' + numer(unitPrice, 'yuan') + ' per kilometer, the transporation to ' + dist + ' km will cost ' + numer(price, 'yuan')". It's important to leave the text structure intact, it must not be rephrased, only parametrized.

Please convert the following texts:

1. "to buy 5 apples that cost 12 dollars each, I have to pay 60 dollars".

2. "the price of one laptop is 4000 dm, so 10 items will cost us 40000 dm".

Но вообще задняя мысль такая, что не проще ли это сконвертить регулярками.

Ищешь /\d+\s*(\w+)/g, делишь руками на три категории: итемы, валюты, нахненужно.

Далее

s/(\d+) (apples?|items?|...)/' + \1 + ' \2/

s/(\d+) (dollars?|yuans?|...)/' + numer(xxx, '\2') + '/

И сразу по месту смотришь, что из них цена, а что сумма, исходя из математики, и заменяешь ххх на нужное из unitPrice / price.

А почему не формализовать все это просто кодом? Зачем для этого нейронка? Это даже не гвозди микроскопом

Почему бы не квантовать с обучением? Тоесть квантанули слой, дообучили неквантованные слои на датасете, квантанули еще, еще дообучили, и так до последнего. Ведь тогда можно минимизировать ошибку, даже скажем на двух битах. Особенно если брать квантование QuIP#

Спасибо. О нейронке задумались, потому что... Стильно, модно, молодëжно. А так-то перед алгоритмом у неë один плюс - переменным имена подбирает адекватно. Остальное - сплошные минусы.

Я проспался. Прошу прощения у всех, кого хуесосил этой ночью, это было некрасиво с моей стороны.

Нихуя себе ты смешной дегенерат!

1. В дефолтных моделях как правило да (в Мистрали и Микстрали почти нет), но есть способы по избавлению от сои, костыльные, но работают. Так что, в общем, зависит от твоих запросов. Скорее нет, чем да, по итогу.

2. Возможность есть. Но не у тебя. Но дорого.

3. Искать в инете — нужен доступ в инет, это всякие приблуды. То есть, да, может, но для этого надо заморочиться. Из коробки — нет.

4. SillyTavern — приложение-фронтенд для удобного общения, ролеплея, с кучей плюшек, вплоть до режима визуальной новеллы, где всех персов и задники тебе рисует стейблдиффужн на лету.

Но вообще — полезная штука.

5. 4060ти надеюсь 16 гиговая, а не 8? :)

20B модели могут влезть, по идее. 13B точно пойдут. И меньше, естественно.

Конкретные — выбирай чо хошь.

> Локалки нет

Ты просто не умеешь их готовить. Могут, канеш.

Если ты про вывод — то тебе нейронки не нужны, а просто код написать.

А если ты про само написание кода — то да, могут, в твоем описании проблем не вижу, пример тебе первый комментатор привел.

Вопрос твоего навыка общения с LLM.

Кек.

В чем предпосылки улучшения? Сохранится ли "дообученная поправка" после квантования следующих слоев и не внесет ли лишних ошибок? Плюс, распределение важности по участкам после процедур может иметь другой вид, но обратно уже не вернуть.

Какая няша :3

Есть у кого гайды как модель квантовать через матрицы? Хочу miquliz-120b-v2.0 квантовать до 2-бит с матрицей, но куда срать кинуться понятия не имею. Очень уж понравилась идея, смерджил 70-ку и очень даже не плохо, щас по его конфигу собрал 120-ку.

Я не понимаю, эта шлюха пиздит или речь о китайском и там реально настолько хороший оптимизон?

нашел конечно место спрашивать, лол

нашел конечно место спрашивать, лол

Что тебя удивляет? 32к это так то много.

Ты китаец?

Ну, на китайском можно даже поверить. Там же одна закорючка от контекста много чего значить может, и урезание токенов пополам относительно правдоподобно. А на английском таки пиздит, только четвертинку вмещает.

Ебать ты через что считал? И что за модель? Понятное дело что эрни будет больше на английский тратить

Счётчик токенов в таверне, с лламовским токенайзером.

Чтобы проще обьяснить модно представить что мы квантовали всю модель кроме одного слоя, и один слой очевидно должен поменяться достаточно сильно чтобы компенсировать ошибку, но допустим он смог нивелировать всю ошибку, тогда квантовав его мы фактически получаем вместо суммы всех ошибок слоев, лишь ошибку квантования одного слоя. Но очевидно что один слой не сможет все компенсировать, значит тут могут быть разные стратегии, но смысл один подменить ошибку полного квантования на ошибку квантования лишь части слоев.

Важность при квантовании не играет такой роли, дообученые слои научатся использовать что им дают, просто если квантование вносит не большую ошибку в слой, то другим слоям нужно меньше обучаться для компенсации, просто влияет на время.

Нет , башкирец на 1/16.

>на 1/16

Извинись.

Извините, что я на 1/8 украинец. Без политики, такая судьба. Остальное вроде русский, но уверен, что чингизхан там тоже присутствует.

>значит тут могут быть разные стратегии

Через один квантовать? И чем это будет лучше выборочной оценки отдельных весов (или что там делают) в Exllama 2?

> и один слой очевидно должен поменяться достаточно сильно чтобы компенсировать ошибку

Как оценивать ошибку? Ты уверен что метрика, которая берет среднюю температуру по больнице, не всрет основные токены, которые сохраняются даже в ужатых квантах в угоду снижения отклонений для маловероятных? Урощенно офк описал, но суть должна быть понятна, возможно ли вообще одним слоем подобное компенсировать.

Далее, не произойдет ли накопления ошибки, когда для компенсации переобученных но квантованных слоев, потребуется вносить еще больше поправок, чем для оригинальных?

Может как работать, так и наоборот портить, или требовать каких-то особых техник. Проверять надо, не хочешь на 3-7б прогнать для демонстрации?

>самая дешевая карточка с 48гб

Ну бля... Когда их уже начнут сливать как Р40.

Когда они перестанут быть рентабельными в типичных задачах. Врядли пройзойдет это в ближайший год-два, если не случится какой-то революции и резкого скачка перфоманса и объемов памяти. С выходом нового поколения цена может еще упасть, но не до бросового уровня.

3. Есть уже какие то гайды как сделать?

4. SillyTavern может это сам "искаробки" или есть тоже гайды? стоит оно вообще того или пока посредственность?

Спасибо обоим за ответы.

И ещё хотел узнать есть ли годные модели на русском языке? Хочется занять частичкой будущего пожилых родаков

новая мультимодальная модель от гугла

https://blog.google/technology/ai/google-gemini-next-generation-model-february-2024/amp/

>Gemini-Pro with 10M context has 99.97% retrieval rate. Thats video, audio, and text.

пизда локальным моделям

https://blog.google/technology/ai/google-gemini-next-generation-model-february-2024/amp/

>Gemini-Pro with 10M context has 99.97% retrieval rate. Thats video, audio, and text.

пизда локальным моделям

в сравнении с gpt-4

Решение от NVIDIA для нативного запуска LLM моделей на RTX картах.

Пока только демка, доступны ЛЛама и Мистраль.

https://youtu.be/gdsRJZT3IJw?si=qKM8gOS06yAdtoNV

Пока только демка, доступны ЛЛама и Мистраль.

https://youtu.be/gdsRJZT3IJw?si=qKM8gOS06yAdtoNV

>But starting today, a limited group of developers and enterprise customers can try it with a context window of up to 1 million tokens

Неблохо. Google AI Studio недоступна в вашем регионе

2. Гайды есть, но это тысячи баксов, если готов тратить — вперед.

Но как вариант — файнтьюн уже готовой. Там значительно дешевле.

Даже можно у себя.

Гайдов — куча. Запускаешь oobabooga, открываешь там Train… Ну и гайды на эту тему погугли.

3. Смотря что именно. Но я бы рекомендовал ее 100%. Не знаю, кто там с ллмстудио и кобольдом дрочит, но таверна — это другой уровень. Есть две части — сама таверна и SillyTavern Extras. У второй части сложность установки чуть повыше, но тоже не суперсложно.

Хороших ролевых моделей на русском нет.

Есть Мистраль (или Микстраль если ты или богатый с тремя RTX3090, или терпеливый), но она ассистент, и есть Фиалка, или же оригинальная руГПТ, но они на старой архитектуре, глупенькие и ролевых файнтьюнов нет (но чистокровно русские). Еще есть опенчат, он умеет на русском, но не затыкается.

Похуй на все. Видео. Если там не покадрово, а прям потоково — то это звезда.

Обсосали уже, хуйня.

зато m*ta представила модель для генерации видосиков "в-жопа"

> 3. Есть уже какие то гайды как сделать?

Из того что доступно плебеям - в шапке https://rentry.co/llm-training

Ну и на ютубчике вбей llama qlora

> есть ли годные модели на русском языке?

Из мелких очень криво в русский могут мистраль и опенчат. А так - мику и квен, обе в 70б.

Вокруг прошлой тоже дикий хайп разводили, а в итоге просто пшик.

Судя по тексту, не генерации, а распознавания, и то, для обучения.

Потыкал 13b модельки, это нормально для llam, что когда приближаешься к границе контекста, то модель просто становится бредогенератором? Причём это не те 4к, которые подхватываются из метадаты, а какая-то другая граница. У некоторых файнтюнов реально можно дойти почти до 4к и только тогда начинается пиздец, у Wizard-Vicuna-13B получилось дойти то 3к токенов примерно и модель начала забывать сообщения не с начала диалога, а с конца, отвечать на вопросы из середины диалога, отвечать на то же самое второй раз и т.д. Причём если подрезать контекст заранее, то всё хорошо. На 7b мистралях такого поведения что-то не припомню.

Да, это совершенно нормально.

У тебя ничего не сломалось.

Можешь растягивать по альфе (в шапке картинка), может продержится чуть дольше.

Какой у вас тут ламповый тред.

Если превышать 4к - пиздарики. Если не выходить - должно быть все нормально, может ломаться на всратых файнтюнах или если в промте творится полный треш, который модель не понимает. Так вообще 8к оно отрабатывает нормально с rope, уверен что не превышаешь?

> отвечать на вопросы из середины диалога, отвечать на то же самое второй раз и т.д.

Такого быть не должно. Алсо

> Wizard-Vicuna-13B

Это случаем не первая ллама вообще? У той 2к базовых.

Чет страшно временами, пиздец. Не из-за манятеорий про скайнет, а просто от перспектив, неясности чо будет, чо можно будет. И чо можно будет тому, кто тебя захочет поиметь.

Плюс ко всему, сидишь вот, вкуриваешь, а конца и края не видно. И сложно все. Не в плане поставить-запустить, а именно как в этом всём разбираться, на уровне как погромист разбирается в системах.

Сами то что думаете? Гоню, не гоню?

Или это нормально, и у нас тут шанс стать первыми фемтосеками?

Плюс ко всему, сидишь вот, вкуриваешь, а конца и края не видно. И сложно все. Не в плане поставить-запустить, а именно как в этом всём разбираться, на уровне как погромист разбирается в системах.

Сами то что думаете? Гоню, не гоню?

Или это нормально, и у нас тут шанс стать первыми фемтосеками?

Приспособишься.

Ну или дропнешь всё и уедешь жить в деревню.

От прогресса не уйдешь, но можно сбежать.

https://www.reddit.com/r/LocalLLaMA/comments/1aqjra9/world_model_on_millionlength_video_and_language/

хуя новостей сегодня про видео ллм, клозед аи так же выкатили какую то адовую херню

хуя новостей сегодня про видео ллм, клозед аи так же выкатили какую то адовую херню

Я пробовал растягивать, но, по-моему, начинает намного медленнее соображать. В целом так-то печально.

>Если не выходить - должно быть все нормально

Намного раньше начинается, но я поставил max new tokens 512. На Wizard-Vicuna-13B доходит где-то до 2900 токенов, некоторые до 3800 дотягивают или около того. В целом, я рассчитывал, что они они нормально дойдут до 4к, а потом сработает автоматическая обрезка, но случается грязь. Это без rope вообще, на единице.

>случаем не первая ллама вообще?

v.1.1

> На Wizard-Vicuna-13B доходит где-то до 2900 токенов

> v.1.1

Это же первая ллама, она вообще больше 2к не должна выдавать без rope. Оставь это несвежее добро, оно ужасно в современных реалиях. Попробуй хоть того же wizard 13b v1.2, он тоже ужасно старый и с недостатками, но для своих годов еще могет, и невероятно лучше той. Что там из современных хз, для рп-ерп 20б норм.

Если что-то ломается, значит работает неверно. Как вариант, у тебя где-то настроена обрезка промта до 2к, и в один момент все начальные инструкции просто улетают в хер, и причина шизы в кривом промте а не лимите модели. Обрезкой контекста должна заниматься только таверна, чтобы сохранить нужное в начале, а пожертвовать историей чата, иначе будет полная хуйта.

Все более менее нормальные стабильно работают до 4к включительно.

Хто? Я? Ну а вообще конечно попробую, но пока я только в свободное время исследую инструменты обучения и вообще как работает и квантование и сети, может через пару месяцев дойду до того что бы сделать это самому.

Не локалка, сразу нахуй.

>и у нас тут шанс стать первыми фемтосеками?

0 шансов, если уже не наносек.

>клозед аи

Не локалка, сразу нахуй.

>Не локалка, сразу нахуй

в ссылке как раз таки локалка

>как объяснить нейронке, что у нас есть API? Требуется генерить кучу однотипных кусков кода

Файнтюн тебе нужен, дядя. RAG если дохуя входных данных.

Какая муха клозедов укусила? Они ж давно ничего не выкладывали. Видимо, такая хуита, что и не жалко.

Файнтюн как раз не поможет.

Если данных мало, то лучше в промт всё запихать.

А я наоборот эксайтед. Здорово же блин. До сих пор общаясь с сетями охуеваю от того как они прям понимают что от них хочешь. Самый сок - когда описываешь им какую-то вещь, а они взаимодействуют с частью которую ты не описывал, но которая должна быть.

Или когда даешь задачу расплывчато, а сеть как может логично действует.

Или создание новой инфы из старой.

И это все - на обоссаной карточке от куртки в моей сычевальне! Сейчас, сегодня вечером, а не в бреднях футуристов!

Ахуеть!

А то. У треда считай интеллектуальный ценз лол. Чтобы поставить сеть нужно немного попердолиться, это живо отсеивает совсем тупых.

Сделай для себя выбор — хочешь гнаться за этим или нет? Если хочешь — гонись. Учи, разбирайся, читай, пиши.

Не хочешь — не гонись, разбирайся чисто для себя.

Я выбрал второе. Это интересно. Я практикуюсь, делаю что-то.

Но на доске есть ребята разбирающиеся в основном вопросе (тренировки, слои, инференция) на уровень выше меня. Ну и молодцы, я их почитаю, ума наберусь. Для себя.

Или дауншифтинг, да, это ведь даже не ново уже.

Локалка V-JEPA, как я понял, а клозеды нет.

Так-то база, согласен.

>Локалка V-JEPA, как я понял, а клозеды нет.

Клозеды тоже логалка, а не локалка это Gemini-Pro (что очевидно).

Нихуя себе, ну ладно, как скажешь.

>Не локалка, сразу нахуй.

ну, в том то и прикол что не локалка, такой точности и стабильности у локалок никогда не будет, и уж точно никто со своим ведро-компудахтером это не запустит.

но для жидов это идеальная вещь, вот потому и торопят прогресс.

>такой точности и стабильности у локалок никогда не будет

Очевидно будет. Просто не сегодня. Нужно только подождать, и RTX 8000 будут продаваться на каждой авите по 20 тыщ рублёв, а логалки подтянут на уровень первых четвёрок.

>но для жидов это идеальная вещь

Для одного жида. Если жидов с сетками больше одного, то это автоматом пизда капитализму.

не не, про жидов имею ввиду что эта тема поможет им, ну и мошенникам всяким это тоже приглянётся.

пикрилы - реакция плебеев на "Sora" от openai, модель видео-генерации, короче говоря это лютейший потенциал для тонны феков а так же сладкий повод для власть-имущих запретить к чертям всякую опенсорс движуху во имя "безопасности".

Господи, что за пиздец.

>запретить

Как бы не выйдет.

Аноны, накидайте пожалуйста для чего сейчас пригодятся LLM. Желательно без историй о просчетах белков и гигагулага

1. Кодинг. Ну тут всё понятно. Удобный способ не ебать голову, но временами подтупливает.

2. Кумерство. Писать свою вайфу материал или похотливые истории аргонианской девы

3. Адвенчуры и написание книг. Отделю от кумерства. Главное что б токенов хватило для ахуеительных историй

4. Чат боты в магазах. Что б Васян думал что он пишет Виктории, заказывая себе конское дилодо 50 см.

6.Переводы. Ну тут всё ясно. Яндекс транслейт идёт нахуй через пару лет. СОси

7. Создание персонажей, описание локация и прочего игрового стаффа. Ну тут всё пока не оч. Дженерик вроде норм, а вот что-то посложнее уже залупа.

8. Пересказ книг??? LLM уже могут это делать качественно?

9. Собеседник одинокого анона, лежащего под пледиком. Для окукливания.

1. Кодинг. Ну тут всё понятно. Удобный способ не ебать голову, но временами подтупливает.

2. Кумерство. Писать свою вайфу материал или похотливые истории аргонианской девы

3. Адвенчуры и написание книг. Отделю от кумерства. Главное что б токенов хватило для ахуеительных историй

4. Чат боты в магазах. Что б Васян думал что он пишет Виктории, заказывая себе конское дилодо 50 см.

6.Переводы. Ну тут всё ясно. Яндекс транслейт идёт нахуй через пару лет. СОси

7. Создание персонажей, описание локация и прочего игрового стаффа. Ну тут всё пока не оч. Дженерик вроде норм, а вот что-то посложнее уже залупа.

8. Пересказ книг??? LLM уже могут это делать качественно?

9. Собеседник одинокого анона, лежащего под пледиком. Для окукливания.

>Это должно быть НЕЛЕГАЛЬНО!!!

>Это так ОПАСНО!!!!!!

Блоядь мне кто-нибудь вообще скажет почему кому-то должно быть не похуй? Типа фотошоп же есть, блендер там. Ну да станет полегче фейк сделать ну и че. Проклятая соя.

>Кумерство

THIS. И только это. Остальное хуета.

>Блоядь мне кто-нибудь вообще скажет почему кому-то должно быть не похуй?

ХЗ, но получается не похуй. Визгливое меньшинство крутит пассивным большинством.

Какая лучшая локалка для перевода с русского на англ? Есть только одна 4090, на которой это и собираюсь делать.

Ни для чего не годятся. Локальные могут генерировать рассказы про бабу которая по 3 суток непрерывно и стандартно кончает от одного вида твоего члена, еще если ты сидишь в деревне без интернета может имитировать стаковерфлоу на минималках для каких простых примеров. Проприетарные это такой сойджак с реддита, испускающий прошибающие на страшную зевоту безопасные банальности.

>it already is being used by pedophiles

А что собственно в этом плохого. Педобиры генерят себе виртуальных лолей и шотиков = не трогают реальных.

Бери любую, задача весьма проста. На 4090 можно вьебать YI 34B.

Так это, педобиры должны страдать, ты не знал? А на детей всем похуй.

Ничего не понимаю в этом. Где почитать про теоретическое основы современных, после 2018 моделец

>YI 34B

Она же на китайском/английском тренирована.

Бля, ну белки, и вообще медицина, химия и физика — это рил прикладная хуйня, камон.

Твоя теоретическая физика?

На чтение почти любая модель понимает русский. Можешь мистраль/микстраль взять, если смущает страна происхождения модели.

Белки же на спец моделях считают, LLM там разве что в качестве архитектуры, а так вряд ли какой-нибудь альфа фолд вообще способен тексты выдавать.

Моя нет, моя ассистент на вопросы отвечать и код писать.

А, там именно LLM. Сорян, не вчитался, да.

А кто-то реально пользуется локалками? Не на поиграться-подрочить, а что-то полезное? Какие у вас спеки и что делаете?

Да это и делаем.

На самом деле, спрашивающий неплохо расписал-то.

1. Кодинг. Правда, это экономит время. Делаешь код-ревью и копипастишь с правками.

2. Переводы. Некоторые переводят специальными модельками, ибо так получается красивше, чем обычными переводчиками.

3. Создание персонажей. Когда до сессии полчаса, а тебе надо накидать неписей второго плана, самое то.

4. Советы. Иногда просто полезное взглянуть, как выглядит ситуация, с точки зрения датасета той или иной модели. Порою подкидывает годные идеи.

Ну вот так как-то.

>владелец простой ASUS x99-E, который безработный и которому лень брать P40, потому что в первый раз заказ отменили

Пришла мать, проц и память. Два дня настраивал - очень проблемная оказалась мать, да и плашки памяти работали не все. На третий день начал пихать в неё Теслы - тут она и сдохла :) Короче, б/у мать с Алика вообще не вариант. Кто на эту тему задумывался - забудьте.

Но я очень хочу иметь домашний нейроускоритель, так что плюнул и заказал новую мать на x299 - ASUS WS X299 SAGE 10G :) Недели через две-три приедет процессор для неё (китайский Новый год всё-таки, дойдёт когда дойдёт), тогда и будут тесты.

Гробик под 4 теслы подскажите?

Скоро приедет еще одна Р40. Поздравьте меня.

Китаедебил с зеонами на красной подсветке.

Китаедебил с зеонами на красной подсветке.

Хочешь впихнуть 3-4 теслы?

Вот поэтому я и не собираю стока.

Материнки либо мусор, либо дорогие.

Хочется — но недостаточно. х)

Однако тебе желаю всяческих успехов!

И тебя поздравляю!

А я вторую все еще жду.

Уже охлад распечатал даж. Осталось кулеры купить.

Седня еще оперативы взял под третий комп. Чисто под озвучку, чтобы стоял и озвучивал все что я хочу, и прочие мелочи.

Тоже покаюсь, так сказать.

И тебя… поздравляем.

В предыдущих тредах кто-то писал.

>↑ Аноны как сумасшедшие покупают теслы и конструируют кошкожён.

Вы что творите, окаянные?!?!?!?!

Вы что творите, окаянные?!?!?!?!

Что сейчас актуально кобольт или генерация на видюхах? Насколько велика разница в качестве генерации? gf 1660s вообще не позволит в генерацию на видюхе? Какая модель для кобольта сейчас оптимальна по соотношению качество/время генерации?

Ты не понял. У тебя видимо проблемы с чтением но он написал конкретно локалки. Все что ты перечислил делается лучше не локалками

Да не, норм все.

«Делается лучше не локалками» — нихуя не очевидно из его вопроса.

Лучше — это как? Обязательно только и исключительно качественнее по ответу? Тогда вообще все отрезается GPT-4.

Но я пользуюсь и локалками, и гопотой, у них немного разный взгляд, и бывает время от времени, когда локалки полезнее.

Окей, если автор подразумевал, что для 100% случаев он юзает чатгопоту, нахуя тогда нужны локалки, — то ответом будет «для альтернативной точки зрения, больше низачем». Но, объективно, во многих случаях локалок хватает, и нет необходимости тыкать чатгопоту.

При этом, мы игнорируем вопрос цензуры, конечно.

Ответ «для генерации шуток про негров» сойдет? =D

Вообще, у меня всегда был вопрос — нахуя нужны всякие распберри пи, если есть андроид-боксы вдвое дешевле и вдвое мощнее.

Ради GPIO, судя по всему.

Так и тут. Ради анонимности, отсутствия цензуры, заточенности под задачи, интернетонезависимости, альтернативной точки зрения. Но лучше ли гопота? Ну да, четверка лучше, никто не спорит.

Там есть API и можно делать шо хошь.

Чёт я не вижу разницы между ними. Вот например Мистраль вроде, 7б, gguf но зачем их там столько и где адекватно написано в чём между ними разница? В их описании тупо сказано кем вроде создан и квантован какая мне разница с этого и почему я должен выбрать в итоге?

п.с. почему иногда фразы не могут быть длиннее 3 предложений и дальше будто на полуслове обрывается текст ответа? Мб настройки какие не поставил oobabooga только буду скоро ставить, пока игрался с кобольдом и настройки не трогал?

Есть голая Mistral.

Есть различные ее файнтьюны. Это Мистраль дообученная на разных датасетах. Там можно почитать, что за датасеты, или хотя бы какие у них цели и содержимое (примерно). Какие-то файнтьюны лучше ролеплеят, какие-то лучше пишут код, какие-то… просто лучше по словам авторов. ¯\_(ツ)_/¯

Что выбрать — хер знает, зависит от целей.

Длина ответа в токенах. Не помню, как это называется в кобольде. По умолчанию оно 512, кажись. Или 256. Че-то такое.

Хочешь ответ больше — увеличивай.

Еще можно нажать там куда-то и нажать «Continue» и он продолжит писать свой ответ.

В целом все правильно расписал. Только каждый из пунктов можно развить и некоторые объединить.

> с русского на англ

Вообще, почти любая может. Обратно уже сложности, а просто с восприятием там чуть ли не у стоковой лламы хорошо.

> Есть только одна 4090

up to 34b без выгрузки на проц

> очень проблемная оказалась мать, да и плашки памяти работали не все

Хуясе, это же вроде одна из последних когда бренд анус что-то значил, и тут такое.

> тут она и сдохла

Вут?

> и заказал новую мать на x299 - ASUS WS X299 SAGE 10G :) Недели через две-три приедет процессор

Brutal! И сколько это добро вышло?

Зачем?

> когда бренд анус что-то значил

Еще в 2000х кончилось это время

Спасибо, а на каких спеках вменяемые ответы? Например для кодинга надо хуярить 2х3090 чтобы не получать ответы на след месяц в стиле пук-среньк? Или божеские спеки тоже позволяют локалкам быть полезными?

Поздравлять надо когда доедет и получишь

Будто что-то плохое!

> кобольт или генерация на видюхах

Одно другому не мешает, кобольд без оффлоада на гпу всеравно не юзабелен. И он - форк llamacpp, на tesla p40 она показывает ну очень высокий перфоманс что радует. На более новых карточках exllama ощутимо опережает. Дешевле p40 нет, но с ней много компромиссов и нюансов. Особенно хороша в качестве второй карточки к йобе только ради llm.

Люто обзмеился, представив что на сой_гу потрачены тысячи bucks.

>тут она и сдохла :)

Пиздец конечно. Благо моя была новой, наверное последнюю новую в России взял.

Удачи с новой платой, и поддвачну вопрос про стоимость.

Будущее. Творим прямо онлайн.

>Все что ты перечислил делается лучше не локалками

Переводишь ты такой текст со словом "ниггер", и в ответе тебе "Извините, но от имени OpenAI я шлю вас нахуй".

>Например для кодинга надо хуярить 2х3090

Одной хватит, файнтюны кодлламы в основном до 34B, 70B релизнули недавно.

>Люто обзмеился, представив что на сой_гу потрачены тысячи bucks.

Зато статьи на Хабре есть, а про дипсекс нету )

> Зато статьи на Хабре

Мерило качества? Ранние версии были настолько всрато-зашкварными что новые никто даже тестить не хочет. Что там за статьи, васян осваивает лламу и в качестве примера пихает сой_гу или что-то интересное?

Чисто для кодинга — зависит от уровня.

Джуну хватит Mistral 5битной на 6 гигов со скоростью 100500 токенов в секунду.

Хочешь поумнее — всякие дипсиккодеры, визардкодеры, кодлламы на 34б в малом кванте на 24 гига видяхи, или на проце с вменяемой скоростью.

Или в большом кванте на 32+ гига для скорости, или потерпеть на проце.

Ну а прям брутал кодллама на 70б — во-первых, хуйня соевая по отзывам, во-вторых, там уже серьезные требования.

Если же ты хочешь универсала, то тут сложнее. Более-менее норм универсал — это Микстраль с ее 8*7Б и 50 гигами размера, а дальше всякие 70Б+.

Но может тебе и Yi-34B зайдет.

Ну и вообще, жизнь есть везде, даже на той же мистральке можно че-нить поделать и очень быстро.

Короче — пробуй. Начни с мистрали 7б в0.2. Потом иди на повышение.

Ну, там же вряд ли тысячи, он не квантовал 70б никогда, вроде. =) Только мелкие.

спасибо, я вот думаю какой комп собрать под это дело и у 4090 пойти на повышение походу уже не получится, ибо там нет nvlink. Хотя может подождать 5ххх и там будут 200гб для таких целей видяхи.

А вот эта на 50гб -там часть слоев суется в видяху а часть остается на проце? Кто-то пользуется вообще таким? Там скорость не падает до уровня проца?

> Ну, там же вряд ли тысячи, он не квантовал 70б никогда, вроде

Если судить по перфомансу - там qlora криво сделанная на фришном коллабе, не более.

> Mistral

> Чисто для кодинга

Крайне сомнительное действо. Как бы ни была хороша модель для своего размера, она сосет у 34б кодллам и аналогов, особенно если знаешь чего хочешь и можешь сфомулировать. Что там на меньших размерах - хз, вполне вероятно что кодлламу 7б и ее файнтюны обойдет.

Микстраль - странная, где-то она перформит хорошо, но даже с 34б (даже с учетом шизоидности последней) ее не стоит сравнивать, не говоря о 70б. В кодинге также посредственна.

>ибо там нет nvlink

Он не нужен.

>Кто-то пользуется вообще таким?

Я пользуюсь.

>Там скорость не падает до уровня проца?

Нет, при разделении слоёв 50/50 скорость тоже будет средней.

> у 4090 пойти на повышение походу уже не получится

Нуу, туда можно подкинуть вторую 4090 (оче дорого и чисто для ллм не оправдано, топ для других нейронок), 3090 (топ за свои деньги по всему, но придется порыться в бу), теслу p40 (пердолинг но топ по прайс-перфоманс для llm).

> подождать 5ххх

Подожди, всего-то 2025 год и 32-36 гигов наиболее вероятны

> и там будут 200гб для таких целей видяхи

Хуясе ебать

Алсо микстраль достаточно шустро работал за счет своей архитектуры даже просто на проце.

> вторую 4090

В какой корпус кроме динамик хл с дополнительным рейлингом? 3-слотовую 4090 днём с огнём или под водянкой. Остальные 4-слотовые

> динамик хл

Что?

Оно не влезет ни в какой корпус по дефолту чтобы верхняя не задыхалась, кроме нищих-узких или специальных двухслотовых с турбой. Вторую по дефолту придется утаскивать райзером и ставить вертикально в месте, где раньше размещали корзину для HDD и оптические привода, и ставить вертикально параллельно задней стенке. При этом еще основную скорее всего придется равезрнуть, чтобы в нее не упиралась. На том же озоне есть кронштейны сразу комплектом под райзеры, с ними реализовать такое не то чтобы сложно.

спасибо еще раз, ты прав.

А еще я слышал что роляет лишь частота цпу, а кол-во ядер пофиг якобы, но при этом если хочешь нормальный второй слот pcie, то тут только рязань. Имеет смысл интелы брать?

>Переводишь ты такой текст со словом "ниггер", и в ответе тебе "Извините, но от имени OpenAI я шлю вас нахуй".

Шел 2024 год а шизы до сих пор уравнивают наличие минимальных мозгов чтобы написать нормально промпт с альтернативой в виде покупки пачек 4090 ради аутпута который все равно будет кратно хуже.

Если что, я не обсираю всех тредовичков и сам тред, мне самому интересно потыкать локалки, но вот конкретно вы шизы ничего кроме охуевания от такой упертой тупости не вызываете

> я слышал что роляет лишь частота цпу

>если хочешь нормальный второй слот pcie, то тут только рязань

Вообще не так. Влияет частот озу, скорость прокачки в ней. Слот вообще пофиг - выше писал уже: 4090 в слоте 3.0 4х работает не хуже чем в 5.0 16х. В 1.0 1х наверное заметишь проблемы, но таких мп сейчас нет

Да, примерно вот так. В фекал дизайн мешифай s2 влезает нормально.

> роляет лишь частота цпу, а кол-во ядер пофиг якобы

Так уж выходит что вычислительной мощности современных процессоров достаточно, и все упирается с пропускную способность рам. Оно и неудивительно, ведь даже квантованные модели имеют размеры в десятки гигабайт и для каждого токена нужно обработать почти весь объем. Есть техники, которые держат в врам только часть модели, а те участки, к которым обращения редки или пропускаются - в обычной рам, но пока это слабо развито.

> нормальный второй слот pcie

Он не нужен. На взаимодействие с LLM и другими нейронками шина никак не влияет (офк при условии что не происходит выгрузки врам через драйвер).

> то тут только рязань

У нее все также нет второго полноценного слота, только деление процессорных линий по 8 или чипсетные. Хочешь полные слоты - велкам ту xeon W или threadreaper.

Так что выбирать интел или амд - тут вопрос сугубо конкретной ситуации что выгоднее в данный момент, персональных предпочтений, религии и т.д. поддерживать пока неудачную платформу компании-лжеца, что до сих пор не смогла ее обновить и починить - ну хуй знает, даже покупка штеуда в преддверии выхода нового сокета не выглядит настолько безумной

>написать нормально промпт

Писал я эти промты, юзал чужие. NSFW часть и прочие префилы уже за 1к токенов переваливают, а гопота всё равно периодически аполоджайзит. Спасибо, накушался.

> Шел 2024 год а шизы

> НУ НИ БАМБИТ У МИНЯ НИ БАМБИТ ЧТО СВОЕЙ ЛОКАЛОЧКИ НЕТ

Зачем так громко-то? Поняли-приняли

> шизы до сих пор уравнивают наличие минимальных мозгов

> с альтернативой в виде покупки пачек 4090

Вау, как же нибомбит у идейного нищука. Настолько поехал что вместо указания на слабости локалок вот такое приплел.

> но вот конкретно вы шизы ничего кроме охуевания от такой упертой тупости не вызываете

Чего сказать то хотел?

>Чего сказать то хотел?

Как же туго то а...

>Brutal! И сколько это добро вышло?

Пока на круг примерно 100к :)

> 100к

Пфф, даже не 1/2 от 4090 а ведь летом это ещё было почти 90% от неё

>Удачи с новой платой, и поддвачну вопрос про стоимость.

Ну я надеюсь, что в итоге общие расходы выйдут не дороже новой 4090 :) Что поделаешь, такие штуки всегда стоят дорого.

В случае с Микстралью — эффект не такой уж сильный, как хотелось бы.

Если совать часть в видяху, то лучше 70Б, но я могу быть не прав, это лишь мое мнение.

> Как бы ни была хороша модель для своего размера, она сосет у 34б кодллам и аналогов

Ну, человек в вопросе сделал упор на скорость, я и предложил ему для начала совсем скорость, при удобоваримом качестве.

Но для хорошего качества придется чем-то жертвовать. Деньгами или временем.

Стоит уточнить, что Тесла именно для GGUF моделей, но не для GPTQ/Exl2.

Так ведь водянки, очевидно, все так делают.

У кого есть деньги на вторую 4090 — уж на водянки наскребут.

> Хотя может подождать 5ххх и там будут 200гб для таких целей видяхи.

Для таких целей уже есть, покупай, 1,5кк всего лишь в рублях.

А на 5090, скорее всего, будет максимум 32. Хочу ошибаться.

Ну или райзер, да.

> кратно хуже

Без обид, но шиза точно у тебя.

Это тотальное неумение нормально промптать и крутить семплеры.

Мнение, что локалки кратно хуже гопоты — из разряда «%модель_нейм% выебала гопоту!»

Шо то хуйня, шо это хуйня.

Перформит, но не кратно, каждому на вкус и цвет.

Тебе второй нормальный слот не то чтобы нужен, на самом деле.

Это скорее касается четвертого нормального слота, чтобы х4 делилось, а не x8+x1+x1+x1. Хотя и так не ужас, тащемта.

И, как тебе уже сказали, важна пропускная способность памяти (оперативной или видео).

Про выбор — база.

> Пока на круг примерно 100к :)

Больно. Мог бы чуть добавить денег, времени и взять пару 3090 чтобы катать все без компромиссов.

>Новая 3090 в ДНС сейчас 200+ штучка.

Пиздос х2. Мне моя плата вышла в 12к, проц вообще по цене песка из Китая, память уже не помню точно, но где-то в 10к на 64 гига. Правда пока как файловый сервер пашет. Как же не хочется устраиваться на РАБотку...

>будет максимум 32. Хочу ошибаться.

Ты это, поосторожнее желай, а то вдруг твоё желание сбудется, и там будет ещё раз 24, лол со слезами на глазах.

>Новая

Как называется эта болезнь?

> >Новая

> 3090

Можно еще новую 2080ти найти а потом пытаться перепаять на ней чипы памяти, и жаловаться что не взлетело, ага.

> ещё раз 24, лол со слезами на глазах

Этот Хуанг делает больно иначе

Спасибо.

Поставил вот я себе SillyTavern, указал на koboldcpp и вроде даже работает с моделью из шапки frostwind-10.7b-v1.Q5_K_M.gguf, но на выбор у меня есть только персонажи которые предложены как на 1 скрине? И типо от модели что я использую зависит качество их ответов?

В общем откуда взять других персонажей или другие персонажи это и есть модели типа Мистрал?

Насколько адекватные сценарии в самом кобольде (скрин 2) и как их вытащить в SillyTavern если в них есть смысл?

>Как называется эта болезнь?

"Такой большой, а в сказки веришь" она называется :)

>В общем откуда взять других персонажей

https://www.chub.ai

>и как их вытащить в SillyTavern

Никак, они не нужны, закрой страницу с кобольдом и пользуйся таверной.

>или другие персонажи это и есть модели типа Мистрал

Ну шапочку почитай, ну позязя. И по ссылке пройди на вики, плиз, умоляю.

> откуда взять других персонажей

chub.ai или можно писать самому/попросить модель написать карточку

> "Такой большой, а в сказки веришь" она называется :)

За 49 там может и прогрев гоeв, а за 60 - уже достаточно нормальных. Одна прямо сейчас работает тут

Спасибо! Какой милый у вас тредик

> на выбор у меня есть только персонажи которые предложены как на 1 скрине

Это стандартные, можешь добавлять любых готовых, качая с чуба и других ресурсов, или создавать своих. Ну вон уже все объяснили.

> если в них есть смысл

Нет.

Насчет сценариев, не так давно анон писал про адвенчур мод таверны и промты к нему, он может быть интересн.

> "Такой большой, а в сказки веришь" она называется :)

Скорее защита от реальности из-за необходимости смириться с ошибками ранее в случае успеха подобного.

Да мы вообще милахи. =3

И ты милаха.

Пользуйся на здоровье!

>смириться с ошибками

Я до сих пор не смирился.

Главное - их вовремя исправлять

Кто-нибудь пробовал?

https://www.reddit.com/r/LocalLLaMA/comments/1ago2wq/russian_llm_siliconmasha7b/

Hi everyone! Please evaluate the merge model I made. It is aimed most of all at RP/ERP in Russian. As for me, with the tasks in Russian it copes. Do not judge harshly, something wrong, write)))) all the same first time doing this).

I use:

mergekit

SanjiWatsuki/Kunoichi-DPO-7B

MexIvanov/zephyr-python-ru-merged

IlyaGusev/saiga_mistral_7b_merged

Links:

https://huggingface.co/LakoMoor/Silicon-Masha-7B

https://huggingface.co/LakoMoor/Silicon-Masha-7B-GGUF

https://www.reddit.com/r/LocalLLaMA/comments/1ago2wq/russian_llm_siliconmasha7b/

Hi everyone! Please evaluate the merge model I made. It is aimed most of all at RP/ERP in Russian. As for me, with the tasks in Russian it copes. Do not judge harshly, something wrong, write)))) all the same first time doing this).

I use:

mergekit

SanjiWatsuki/Kunoichi-DPO-7B

MexIvanov/zephyr-python-ru-merged

IlyaGusev/saiga_mistral_7b_merged

Links:

https://huggingface.co/LakoMoor/Silicon-Masha-7B

https://huggingface.co/LakoMoor/Silicon-Masha-7B-GGUF

>I took as a basis the models that are trained on the Russian dataset.

>40 процентов токенизатора английский

>40 китайский

>Чуть-чуть русского

>trained on the Russian

Понимаю.

>Файнтюн как раз не поможет. Если данных мало, то лучше в промт всё запихать.

Схуяли вот? Лоры делаются на небольшом количестве примеров.

>in Russian

Не нужно, уноси.

Как ты портифьича в таверну подрубил?

>портифьича

Кого? Если ты про бота, то это старый рофл из CAI треда.

https://files.catbox.moe/6hsokd.png

На гопоте-клоде неплохо работает, генерит лулзы, на локалках обычно тупит, т.к. предназначен для русского языка.

Аноны, подскажите фронтенд для llama. Не в виде чата, а для текстового рпг. И желательно чтобы дайсы и статы перса были.

К таверне можно прикрутить fooocus чтобы картинки рисовал? А то этот хорд херня какая-то.

И вот как бороться с этим? Тут блядь буквально противоречащие друг-друг параграфы.

юзаю кобальд сс

казалось бы универсальная херня

юзаю формат ггуф как советовали итт

с Masterjp123-NeuralMaid-7b. любым количеством после кью

выдает типо пикрил

как эту херь лечить ??

казалось бы универсальная херня

юзаю формат ггуф как советовали итт

с Masterjp123-NeuralMaid-7b. любым количеством после кью

выдает типо пикрил

как эту херь лечить ??

Звучит пиздец. =)

Порфирьича же, ну.

Классику не знаешь.

Прикрути стейбл диффужн обычный. Не?

от чего зависит скорость генерации на проце?

Силиконовая Маша, ммм

> SanjiWatsuki/Kunoichi-DPO-7B

> MexIvanov/zephyr-python-ru-merged

> IlyaGusev/saiga_mistral_7b_merged

Ooof, скорее всего там все печально.

Если его api совместимо с автоматиковским - можно.

Выключи ban eos token

В большей степени от пропускной способности памяти (частоты) и инструкций процессора (AVX2, AVX, noAVX).

В меньшей — от количества ядер и частоты (от 4-5 ядер и больше).

Сколько токенов выдаст 3090 на yi34 q4km?

Я доделал эту дичь. Имеется квантизация в 4 бита с помощью bnb, загрузка весов с hf (для каждой моделки надо писать собственные правила для загрузки экспертов, иначе никак), и в случае загрузки без квантизации можно указать оптимизатор, чтоб эксперты еще и обучались. Пока я все это тестирую и пытаюсь обучить мелкую модельку на 4-10 слоев с 16 мелкими экспертами. Пока клиентский код крайне сырой и работает через монкей патч оригинальных transformers модулей под работу с экспертами. Пока тестил вот что понял: нужно добавить в оптимизаторы adafactor и 8бит адам так как обычные оптимизаторы дохуя жрут, накопление градиентов как костыль от переобучения из за мелких батчей, пофиксить два прикола из за которых можно убить эксперта на удаленном пире, и добавить дефолтное распределенное обучение что есть в hivemind чисто ради лулза.

На ExLlama 2 около 20-25 должно быть. У Жоры дели на 2-3, не думаю что больше 10 выдаст.

забыл добавить пикчу. на количество параметров не обращаем внимание, это визуальный баг и это тоже пойдет под фикс.

а частота проца особо не играет?

вот думаю апать частоту озу или тайминги крутить

Это чё вообще?

Кэш процессора еще важен.

Да, я так и сделал. Нужно разогнать множитель кэш лимита и немного поднять напряжение систем агента.

Это база, у меня нейросеть 13b начала работать быстрее на ~10%.

При равной псп и наличии технологий между зеоном на 3 ГГц и современными на 4+ ГГц разницы не замечено особо. Наверное, она все-таки есть, но не прям.

Латенси или размер? От размера вообще не увидил разницы.

Ну вот, наконец третий комп завел норм.

Теперь один игровой, один под теслы, один под мелочухи всякие.

И все работает.

Осталось все настраивать и писать код, а не ждать погоды у моря. хд

Теперь один игровой, один под теслы, один под мелочухи всякие.

И все работает.

Осталось все настраивать и писать код, а не ждать погоды у моря. хд

> монкей патч оригинальных transformers модулей под работу с экспертами

В оригинальном трансформерсе же добавляли поддержку MOE.

> нужно добавить в оптимизаторы adafactor и 8бит адам так как обычные оптимизаторы дохуя жрут, накопление градиентов как костыль от переобучения из за мелких батчей

Ты пилишь свой скрипт обучения, или пытаешься сделать распределенную обучалку?

> не думаю что больше 10 выдаст

На новой 15+ наверно будет, исключение - большой контекст с полной обработкой.

Че там за 2 месяца было что то из новых сеток норм?

До 20b, порекомендуйте че нибудь

Там кстати кобальд обновился, пока без фикса

До 20b, порекомендуйте че нибудь

Там кстати кобальд обновился, пока без фикса

Распределить экспертов по пирам в одноранговой сети, чтобы потом их можно было инференсить / обучать.

>Латенси или размер? От размера вообще не увидил разницы.

Я по вот этому треду сужу:

https://www.reddit.com/r/LocalLLaMA/comments/1ak2f1v/ram_memory_bandwidth_measurement_numbers_for_both/kp6xyu9/

Чел измерил пропускную способность памяти, получил ~215 GB/s, но токенов в секунду получает мало, добавлять больше 12 потоков не помогает, vtune'ом выяснил, что память утилизуется только на 43%, в итоге пришел к выводу, что ограничен скоростью L3 кэша.

Пропускная способность памяти не имеет никакого отношения к задержкам при чтении из неё.

имеет - учи матчасть

чтение не может быть моментальным

оно зависит от таймингов на чтение и частоты работы и передачи

> от таймингов на чтение и частоты работы и передачи

Задержки чтения и пропускная способность - совсем разные вещи.

всем насрать на твою пропускную пока по таймингам из чипа данные не прочтутся

Всего лишь 43 куска. Я думаю тут каждый за пару сотен месяцев накопит

По цене 1 проф карты с 40гб

Вот как раз обсуждают охуевших зеленых

https://www.reddit.com/r/LocalLLaMA/comments/1asfe83/highvram_gpus_for_us_nerds/

Я тебе о чём и пишу. Нахуй ты высрал тот пост про пропускную способность и кэш, который вообще не используется из-за кэш-миссов.

>clocking in at up to 284 times faster than x86

Инженер изнасиловал журналиста.

>1. Harass large manufacturers.

>2. Get a smaller manufacturer to do a Kickstarter.

>3. Get an Open-Source project started.

Чёт проиграл с этого говна в голове.

Леваки-с, сэр

>Чёт проиграл с этого говна в голове.

Где говно? Чел просто перечислил все возможные варианты

Там кстати в комментах обсуждают, что была бы возможность перепрошивки 3090 можно было бы заменить чипы и получить 64 гб врам

Технически это возможно хоть сейчас просто, пидору в куртке выгоднее продавать в 20 раз более дорогие проф карты

> 64

Сама разделишь на 24 или помочь?

Дурачек? Я просто повторяю то что там написано, иди спроси почему он так посчитал, лол

Даже если речь про 48 гб, этого уже достаточно для большинства задач, разве что 70b за бортом, ну или мелкие кванты брать

> продавать в 20 раз более дорогие проф

Да ладно, чё там на ga 102? A6000 и 3090. У первой MSRP в 4.5 раза выше, чем у первой. Где ты в 20 раз увидел.

я про кеш вобще не писал

Аноны я правильно понимаю, что если я в угабуге для инструкт-модели напишу чо мне от нее надо в промте, то она это забудет после n_ctx токенов?

И что если я вместо этого напишу это в карточке чара (parameters / character), то она не забудет, потому что это как-то магически передается с каждым моим запросом.

И что если я вместо этого напишу это в карточке чара (parameters / character), то она не забудет, потому что это как-то магически передается с каждым моим запросом.

Помогите хлебушку:

1. Посоветуйти пжл. хорошие модели для ролеплея, до 13б

2. Есть какой то смысл ставить на посмотреть oobabooga если сейчас есть коболд + SillyTavern? Лучше ли чем то oobabooga?

3. Нужно ли что-то менять в настройках кобольда при запуске для более оптимизированной работы ai?

Сейчас при запуске указываю только модель и ставлю context size: 6144, но ответы генерятся около минуты-полторы. Или это нормальная скорость я не разобрался, мб там нужно как-то распределять на проц/оперативку/карту?

4. Я правильно понял, что при установке SillyTavern Extras у меня появится только возможность генерить картинки по к каждому ответу нейронки?

5. Как можно прикрутить возможность воспроизведения голосом ответов или зачитывания их в SillyTavern? И нормально ли это реализовано по качеству сейчас?

1. Посоветуйти пжл. хорошие модели для ролеплея, до 13б

2. Есть какой то смысл ставить на посмотреть oobabooga если сейчас есть коболд + SillyTavern? Лучше ли чем то oobabooga?

3. Нужно ли что-то менять в настройках кобольда при запуске для более оптимизированной работы ai?

Сейчас при запуске указываю только модель и ставлю context size: 6144, но ответы генерятся около минуты-полторы. Или это нормальная скорость я не разобрался, мб там нужно как-то распределять на проц/оперативку/карту?

4. Я правильно понял, что при установке SillyTavern Extras у меня появится только возможность генерить картинки по к каждому ответу нейронки?

5. Как можно прикрутить возможность воспроизведения голосом ответов или зачитывания их в SillyTavern? И нормально ли это реализовано по качеству сейчас?

>хорошие модели для ролеплея

>до 13б

Невозможно теоретически. Противоречишь сам себе.

Как это в рамках не одной машины где весь обмен мгновенен и все синхронно не пробовал?

Там довольно странные выводы по токенам и скорости. Оценка загрузки там может быть довольно специфична, особенно если у него там несколько нума доменов.

Хотеть такую штуку

1. Лучше юзай колаб из шапки с 20В моделями.

2. У меня oobabooga локально работает быстрее кобольда, ещё в ней есть негатив, в кобольд вроде не завезли ещё.

3. Тут ХЗ.